随机森林回归模型与其他回归模型的较量:优势对比,选择最优模型

发布时间: 2024-07-21 18:02:17 阅读量: 28 订阅数: 48

# 1. 回归模型概述**

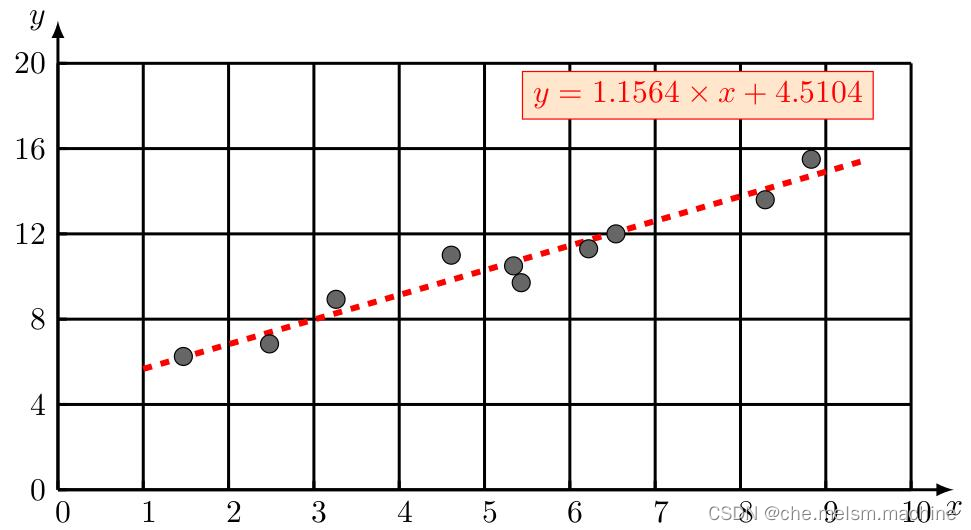

回归模型是一种机器学习算法,用于预测连续值目标变量。它通过拟合输入特征与目标变量之间的关系来工作。回归模型广泛用于各种应用中,例如预测销售、天气和股票价格。

回归模型的类型有很多,每种类型都有其优点和缺点。最常见的回归模型包括线性回归、决策树回归和随机森林回归。这些模型在复杂性、准确性和鲁棒性方面有所不同。

# 2. 随机森林回归模型

### 2.1 随机森林算法原理

随机森林是一种集成学习算法,它通过构建多个决策树来进行预测。每个决策树都是基于训练数据的不同子集和随机特征子集构建的。

**算法流程:**

1. **从训练数据中随机抽取 n 个样本(有放回)。**

2. **从所有特征中随机选择 m 个特征子集(无放回)。**

3. **使用选定的样本和特征构建一个决策树。**

4. **重复步骤 1-3,构建 n 棵决策树。**

5. **对于新的输入数据,将它输入到所有决策树中,并计算每个决策树的预测值。**

6. **将所有决策树的预测值取平均(回归问题)或多数投票(分类问题)作为最终预测结果。**

### 2.2 随机森林回归模型的优点和缺点

**优点:**

* **准确率高:**随机森林通过集成多个决策树,可以有效减少过拟合,提高预测准确率。

* **鲁棒性强:**由于每个决策树都是基于不同的数据和特征构建的,因此随机森林对异常值和噪声数据具有较强的鲁棒性。

* **可解释性强:**随机森林可以提供每个特征对预测结果的重要性度量,有助于理解模型的行为。

**缺点:**

* **训练时间长:**随机森林需要构建多个决策树,因此训练时间可能较长。

* **模型复杂度高:**随机森林包含多个决策树,因此模型复杂度较高,可能难以解释和部署。

* **容易过拟合:**如果决策树数量过多或特征子集选择不当,随机森林可能会出现过拟合现象。

**代码示例:**

```python

import numpy as np

from sklearn.ensemble import RandomForestRegressor

# 训练数据

X = np.array([[1, 2], [3, 4], [5, 6]])

y = np.array([10, 15, 20])

# 构建随机森林回归模型

model = RandomForestRegressor(n_estimators=100)

model.fit(X, y)

# 预测新数据

new_data = np.array([[7, 8]])

prediction = model.predict(new_data)

```

**代码逻辑分析:**

* `n_estimators=100` 指定构建 100 棵决策树。

* `fit(X, y)` 方法训练模型,使用训练数据 X 和目标变量 y。

* `predict(new_data)` 方法对新数据进行预测。

**参数说明:**

* `n_estimators`:决策树数量

* `max_depth`:决策树的

0

0