随机森林回归模型的最新进展与趋势:把握预测技术前沿,引领未来

发布时间: 2024-07-21 18:19:03 阅读量: 22 订阅数: 48

# 1. 随机森林回归模型概述**

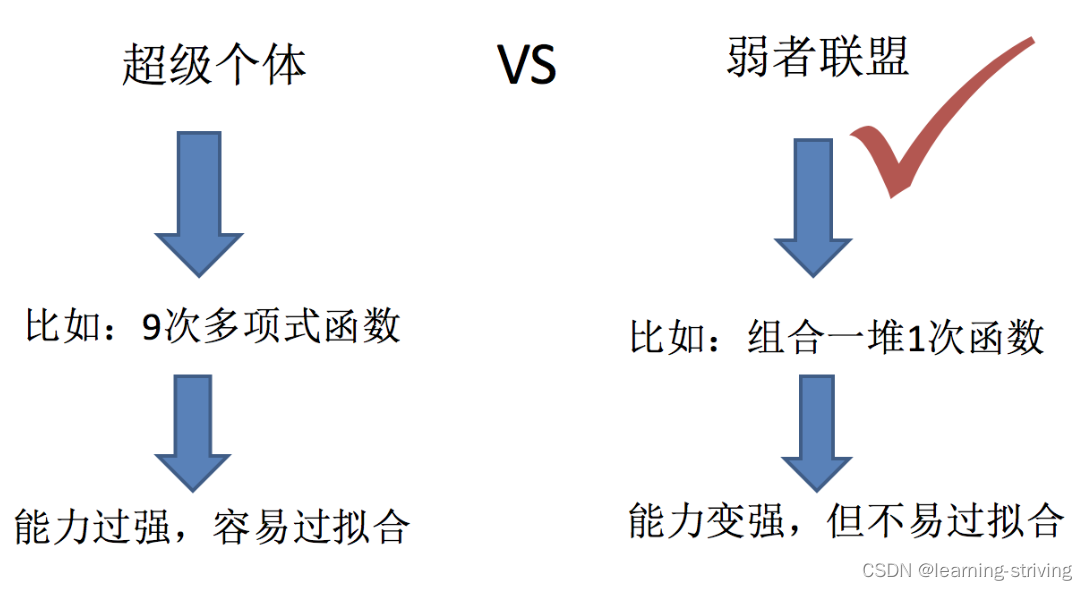

随机森林回归模型是一种强大的机器学习算法,用于解决复杂回归问题。它基于决策树算法,通过集成多个决策树来提高预测精度和鲁棒性。与传统的回归模型相比,随机森林模型具有以下优势:

- **高预测精度:**集成多个决策树可以有效降低方差,提高预测精度。

- **鲁棒性强:**随机森林模型对异常值和噪声数据不敏感,具有较强的鲁棒性。

- **可解释性:**随机森林模型易于解释,可以通过特征重要性分析了解模型预测的依据。

# 2. 随机森林回归模型理论基础

### 2.1 决策树算法原理

**2.1.1 决策树构建过程**

决策树是一种监督学习算法,用于预测连续或分类目标变量。它通过递归地将数据集分割成更小的子集来构建一个树形结构。决策树构建过程如下:

1. **选择特征:**从特征集中选择最优特征,用于将数据集分割成两个子集。最优特征通常是信息增益或信息增益比最大的特征。

2. **分割数据集:**根据选定的特征值将数据集分割成两个子集。

3. **递归构建:**对每个子集重复步骤 1 和 2,直到满足停止条件(例如,达到最大深度或子集大小太小)。

4. **生成叶节点:**当子集不能再被分割时,生成一个叶节点,并为该叶节点分配一个目标值。

**代码块:**

```python

import pandas as pd

from sklearn.tree import DecisionTreeClassifier

# 训练数据

df = pd.DataFrame({

"feature1": [0, 1, 2, 3, 4],

"feature2": [5, 6, 7, 8, 9],

"target": [0, 1, 0, 1, 0]

})

# 构建决策树

clf = DecisionTreeClassifier()

clf.fit(df[["feature1", "feature2"]], df["target"])

# 打印决策树结构

print(clf.tree_)

```

**逻辑分析:**

该代码块展示了决策树的构建过程。首先,它创建了一个包含两个特征和一个目标变量的数据集。然后,它使用 `DecisionTreeClassifier` 类训练了一个决策树模型。最后,它打印了决策树的结构,显示了特征选择和数据集分割的过程。

### 2.1.2 决策树剪枝策略

决策树剪枝是一种技术,用于减少决策树的复杂性和防止过拟合。剪枝策略通过移除不重要的分支或子树来简化决策树。常见的剪枝策略包括:

* **预剪枝:**在决策树构建过程中进行剪枝,避免创建不必要的子树。

* **后剪枝:**在决策树构建完成后进行剪枝,移除不重要的子树。

**代码块:**

```python

# 预剪枝

clf = DecisionTreeClassifier(max_depth=3)

clf.fit(df[["feature1", "feature2"]], df["target"])

# 后剪枝

clf = DecisionTreeClassifier()

clf.fit(df[["feature1", "feature2"]], df["target"])

clf.prune(df[["feature1", "feature2"]], df["target"])

```

**逻辑分析:**

该代码块展示了预剪枝和后剪枝策略。预剪枝通过设置 `max_depth` 参数来限制决策树的深度,从而在构建过程中进行剪枝。后剪枝在决策树构建完成后使用 `prune` 方法进行剪枝。

### 2.2 随机森林算法原理

**2.2.1 随机抽样和特征子集选择**

随机森林是一种集成学习算法,它通过结合多个决策树来提高预测准确性。随机森林的关键思想是:

* **随机抽样:**从训练数据中随机抽取多个子集。

* **特征子集选择:**从每个特征集中随机选择一个子集。

**2.2.2 决策树集成和投票机制**

对于每个子集,使用随机选择的特征子集构建一个决策树。这些决策树称为基本决策树。最终预测是通过对所有基本决策树的预测进行投票或平均来获得的。

**代码块:**

```python

from sklearn.ensemble import RandomForestClassifier

# 训练随机森林

rf = RandomForestClassifier(n_estimators=100)

rf.fit(df[["feature1", "feature2"]], df["target"])

# 打印随机森林的决策树数量

print(rf.n_estimators)

```

**逻辑分析:**

该代码块展示了随机森林的构建过程。它使用 `RandomForestClassifier` 类创建了一个随机森林模型,指定了基本决策树的数量。随机森林通过对多个决策树的预测进行投票来做出最终预测。

# 3.1 数据预处理和特征工程

#### 3.1.1 数据清洗和缺失值处理

数据预处理是机器学习项目中至关重要的一步,对于随机森林回归模型也不例外。数据清洗涉及识别和处理异常值、重复值和缺失值。

**异常值处理:**

* 异常值是极端值,可能对模型训练产生负面影响。

* 异常值可以手动识别,也可以使用统计方法(如 IQR 法则)自动检测。

* 处理

0

0