人工智能中的随机森林回归模型:展望未来,预测技术引领变革

发布时间: 2024-07-21 18:23:52 阅读量: 58 订阅数: 53

AI大模型技术:原理、应用和未来展望.docx

# 1. 人工智能与随机森林回归**

人工智能(AI)是计算机科学的一个分支,它使机器能够执行通常需要人类智能的任务,例如学习、解决问题和决策。机器学习是 AI 的一个子领域,它允许计算机从数据中学习,而无需明确编程。

随机森林回归是机器学习中的一种监督学习算法,用于预测连续值的目标变量。它是一种集成学习算法,它通过组合多个决策树来创建更准确和鲁棒的模型。随机森林回归模型在各种应用中表现出出色的性能,包括预测医疗结果、金融风险和制造缺陷。

# 2.1 决策树与随机森林

### 2.1.1 决策树简介

决策树是一种监督学习算法,用于分类和回归任务。它通过构建一个树状结构,将数据样本递归地划分为更小的子集,直到达到停止条件。决策树的每个节点表示一个特征,每个分支表示该特征的可能值。

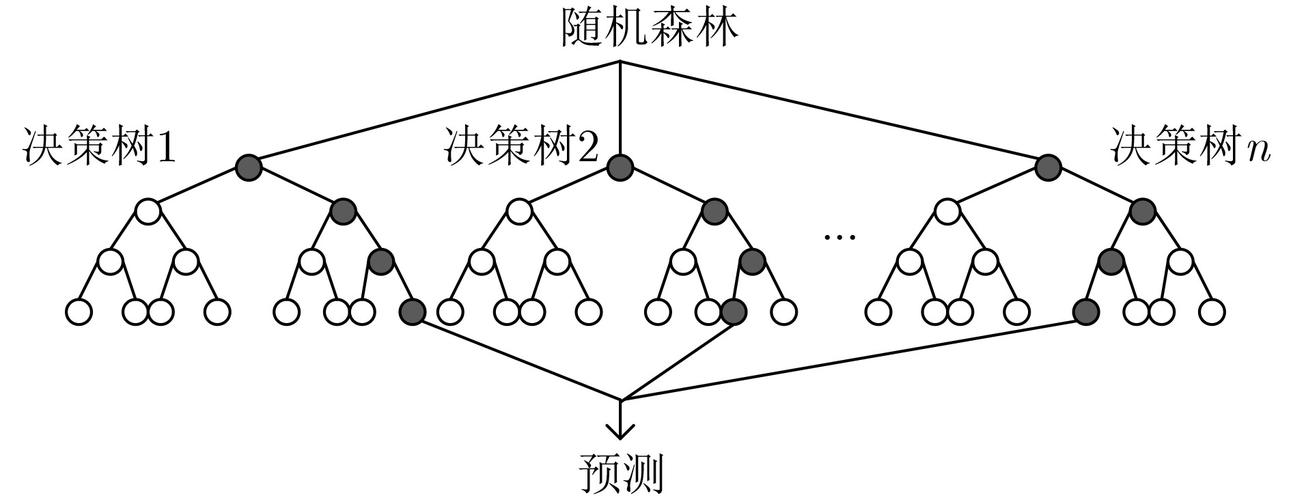

### 2.1.2 随机森林

随机森林是决策树的集成学习方法。它通过构建多棵决策树,并对这些树的预测进行平均或投票,来提高模型的性能和鲁棒性。

### 2.1.3 随机森林与决策树的区别

随机森林与决策树的主要区别在于:

- **树的数量:**随机森林使用多棵决策树,而决策树仅使用一棵树。

- **特征选择:**随机森林在每个节点上随机选择一个特征子集,而决策树考虑所有特征。

- **样本抽样:**随机森林对每个决策树使用训练数据的不同子集,而决策树使用整个训练集。

### 2.1.4 随机森林的优点

随机森林具有以下优点:

- **高准确性:**通过集成多棵决策树,随机森林可以减少偏差和方差,从而提高预测准确性。

- **鲁棒性强:**随机森林对异常值和噪声数据不敏感,因为它使用多个决策树进行预测。

- **可解释性:**与其他机器学习模型相比,随机森林相对容易解释,因为决策树是可视化的。

### 2.1.5 随机森林的局限性

随机森林也有一些局限性:

- **计算成本高:**训练随机森林需要大量计算资源,因为需要构建多棵决策树。

- **可能过拟合:**如果决策树数量过多或特征子集选择不当,随机森林可能会过拟合训练数据。

- **不适用于高维数据:**当特征数量非常大时,随机森林的性能可能会下降,因为它难以选择有意义的特征子集。

# 3.1 数据预处理与特征工程

### 数据预处理

数据预处理是机器学习模型训练前至关重要的一步,其目的是将原始数据转换为模型可用的格式,同时提高模型的性能。随机森林回归模型的数据预处理步骤如下:

**1. 缺失值处理:**

- 缺失值是数据集中常见的现象,需要妥善处理。对于随机森林回归模型,缺失值处理方法包括:

- **删除法:**删除包含缺失值的样本或特征。

- **插补法:**使用统计方法(如均值、中位数、众数)或机器学习方法(如KNN)对缺失值进行估计。

**2. 数据标准化:**

-

0

0