【特征选择对AdaBoost的影响】:理论与实践相结合的深度分析

发布时间: 2024-11-21 00:35:44 阅读量: 5 订阅数: 18

# 1. 特征选择与AdaBoost的基本概念

在机器学习领域中,特征选择与AdaBoost作为两种关键技术,它们在提高模型性能方面起着至关重要的作用。**特征选择**是优化机器学习模型的预处理步骤,其目的是减少数据的维度,同时保留与预测任务相关的信息。这有助于减少计算量、避免过拟合,并可能提高模型的泛化能力。而**AdaBoost(Adaptive Boosting)**,作为集成学习中的一种经典算法,通过调整不同弱学习器的权重,组合多个模型以达到提高整体分类性能的目的。本章将介绍这两种技术的基本概念,并为后续章节的深入探讨打下基础。

# 2. 特征选择理论与AdaBoost原理

## 2.1 特征选择的理论基础

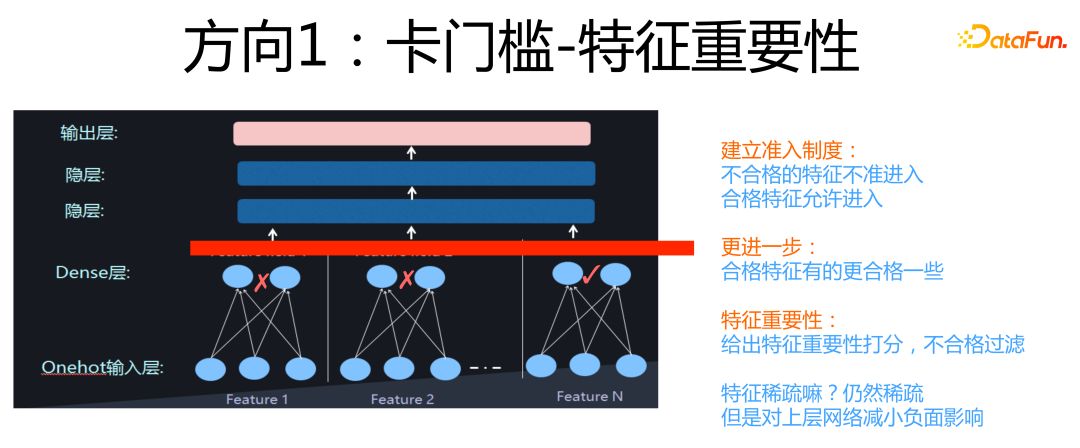

### 2.1.1 特征选择的重要性

在机器学习和数据挖掘领域,特征选择(Feature Selection)是一个关键步骤,用于从原始数据集中挑选出最有信息量的特征(变量),以提高模型的预测性能和解释能力。随着数据量的增长和特征空间的复杂性提升,特征选择的重要性愈发凸显。

首先,从数据维度来看,高维数据往往伴随着数据稀疏性,导致在样本量有限的情况下,模型难以有效地训练和泛化。这种现象也被称为维度的诅咒(Curse of Dimensionality)。通过对特征进行选择,可以去除无关紧要的特征,减少维度,从而降低过拟合的风险。

其次,特征选择能够提高模型的运行效率。在特征数量较多的情况下,模型训练和预测的时间成本会显著增加。通过选择具有代表性的特征子集,可以加快模型的训练速度和预测速度,特别是在需要实时响应的应用中,这一点显得尤为重要。

最后,特征选择有利于提高模型的可解释性。在某些应用场景中,例如医疗诊断或金融风控,模型的决策过程需要具备一定的可解释性。通过特征选择,可以排除冗余特征,留下对预测结果有显著影响的特征,这有助于决策者更好地理解模型的决策依据。

### 2.1.2 特征选择的主要方法

特征选择的方法可以从不同的角度进行分类,常见的分类包括:

- **过滤法(Filter Methods)**:这种方法通过统计分析,如相关系数、卡方检验、互信息等统计测试,对特征的重要性进行评价,并根据预设的阈值选择特征。

- **包裹法(Wrapper Methods)**:包裹法将特征选择看作是一个搜索过程,它利用模型的预测性能来评价特征组合的好坏。例如,递归特征消除(RFE)和基于模型的特征选择方法就属于这一类。

- **嵌入法(Embedded Methods)**:嵌入法结合了过滤法和包裹法的特点,将特征选择过程嵌入到模型训练过程中,例如决策树、随机森林和LASSO回归等。

## 2.2 AdaBoost的工作原理

### 2.2.1 Boosting算法概述

Boosting算法是一类将弱学习器提升为强学习器的集成学习方法。核心思想是通过迭代地训练模型,并逐步修正数据权重,使得错误分类的数据点在后续的迭代中得到更多的关注。最终通过组合多个弱学习器的预测结果来构建一个强学习器。

### 2.2.2 AdaBoost算法详解

自适应提升(Adaptive Boosting,简称AdaBoost)是Boosting算法中最著名和应用最广泛的一种。其工作原理可以概括为以下几个步骤:

1. 初始化数据集中的样本权重。

2. 对于每一个迭代次数`t`:

- 根据当前的样本权重,训练一个弱分类器。

- 计算该弱分类器的错误率。

- 更新样本权重,错误分类的样本权重会增加,正确分类的样本权重会减少。

3. 最后,将所有弱分类器的预测结果通过加权投票的方式组合起来,得到最终的强分类器输出。

在这个过程中,AdaBoost算法自适应地调整每个弱分类器的权重,以反映其在提升过程中所起的作用。因此,对于那些在迭代中被赋予更高权重的弱分类器,它们在最终模型中将有更大的影响力。

## 2.3 特征选择与AdaBoost结合的理论模型

### 2.3.1 理论模型的构建

将特征选择与AdaBoost算法相结合,可以在保证模型性能的同时,减少模型的复杂度和训练时间。理论模型构建的核心在于将特征选择融入AdaBoost的迭代过程中,以实现特征和模型的共同优化。

模型构建的基本步骤如下:

1. 使用特征选择方法对原始特征集进行筛选,得到候选特征子集。

2. 在AdaBoost的每一轮迭代中,利用候选特征子集来训练弱分类器。

3. 根据分类器的表现和特征的重要性,动态调整特征子集。

4. 重复步骤2和3,直至满足停止条件,如达到最大迭代次数或模型性能不再提升。

### 2.3.2 特征选择对模型性能的影响分析

特征选择对模型性能的影响主要表现在以下几个方面:

- **准确性提升**:通过筛选出最有信息量的特征,模型能够更准确地捕捉数据的内在结构,从而提高分类或回归任务的准确性。

- **过拟合风险降低**:特征选择有助于减少模型的复杂性,从而降低过拟合的风险。

- **计算效率优化**:使用更少的特征意味着模型训练和预测的速度可以更快,特别是在处理大规模数据集时,这一点尤为重要。

- **模型可解释性增强**:特征选择往往能够简化模型,使其更加透明,有助于提升模型的可解释性。

综上所述,特征选择与AdaBoost结合的理论模型不仅可以在保持高性能的同时减少模型的复杂度,还可以提高模型的运行效率和可解释性,为实际应用提供了新的思路。

# 3. 特征选择技术在AdaBoost中的应用

## 3.1 特征选择技术的分类与应用

### 3.1.1 过滤法在AdaBoost中的应用

过滤法(Filter methods)是特征选择中的基础方法,其核心思想是根据特征和目标变量之间的统计度量来选择特征,如相关系数、卡方检验或方差分析等。在AdaBoost中,过滤法可以用来预先减少特征的维度,从而减少模型训练的时间复杂度。

过滤法的应用步骤通常包括:

1. 计算各个特征与目标变量之间的相关度。

2. 根据相关度对特征进行排序。

3. 设定一个阈值或者选择前N个特征作为最终的特征子集。

过滤法因其简单快速而被广泛应用于初步特征选择中,尤其适合于高维数据。在AdaBoost算法中,先使用过滤法进行特征选择,可以有效减少后续迭代中的计算量,加速整体的训练过程。

下面是一个使用Python中scikit-learn库的Pearson相关系数过滤法选择特征的代码示例:

```python

import numpy as np

from sklearn.feature_selection import SelectKBest

from sklearn.feature_selection import f_regression

# 假设 X_train 是训练数据的特征矩阵,y_train 是对应的标签向量

X_train = np.array([...]) # 特征矩阵

y_train = np.array([...]) # 标签向量

# 使用Pearson相关系数选择最佳的K个特征

selector = SelectKBest(f_regression, k=10)

X_train_selected = selector.fit_transform(X_train, y_train)

# 查看选择的特征索引

selected_features = np.where(selector.get_support())[0]

print("Selected feature indices:", selected_features)

```

逻辑分析及参数说明:

- `SelectKBest` 是scikit-learn中提供的一个过滤方法,用于选择最佳的K个特征。

- `f_regression` 作为评分函数,用于计算特征和目标之间的相关系数。

- `k` 参数是用户自定义的特征数量,表示选择排名最高的前k个特征。

- `fit_transform` 方法结合了拟合和转换两个步骤,首先拟合数据以计算特征的评分,然后对特征进行转换,输出特征子集。

### 3.1.2 包裹法在AdaBoost中的应用

包

0

0