【精确度提升】:全面评估语言模型在语音识别中的作用

发布时间: 2024-09-07 03:00:49 阅读量: 138 订阅数: 50

# 1. 语言模型与语音识别简介

## 1.1 语言模型的定义和作用

语言模型(Language Model)是自然语言处理(NLP)领域的一个基础概念,其主要任务是估计一个句子的出现概率。在语音识别中,语言模型能够帮助系统更好地理解发音者所表达的语言内容,提供上下文信息,预测下一个可能的单词,从而提高识别的准确性。

## 1.2 语言模型的历史与发展

从最初基于规则和n-gram统计模型,到现在的深度学习模型,语言模型经历了快速的发展。这些演进不仅提升了模型的预测准确度,还扩展了其应用场景。

## 1.3 语音识别技术概述

语音识别(Speech Recognition)是一种将语音信号转化为文本信息的技术。它涉及声学模型、语言模型和解码器的配合。随着深度学习技术的进步,语音识别的准确率得到了显著提升,促进了智能助手、语音翻译等应用的发展。

# 2. 语言模型的理论基础

### 2.1 统计语言模型概述

在对语言模型的深入探讨中,首先必须了解统计语言模型的概念。统计语言模型是利用统计学原理对自然语言进行建模的数学模型,其主要目的是根据已有的词语序列预测下一个最可能出现的词语。统计语言模型在语音识别和机器翻译等自然语言处理任务中发挥着关键作用。

#### 2.1.1 马尔可夫模型和n-gram模型

马尔可夫模型是一种基于随机过程的统计模型,其核心假设是系统的下一个状态只依赖于当前状态,而不依赖于之前的状态。在语言模型中,它常被用来预测下一个词语,即给定一个长度为\(n-1\)的词序列,模型预测第\(n\)个词出现的概率。

n-gram是马尔可夫模型中最简单的形式之一,它假设一个词语的出现仅与它前面的\(n-1\)个词语有关。例如,在一个二元模型(bigram)中,下一个词的概率依赖于当前词。这简化了模型的复杂性,但也带来了数据稀疏问题,尤其是当\(n\)增大时,对大量数据的需求也随之增长。

```python

# 示例:计算一个简单bigram模型的下一个词概率

def calculate_bigram_prob(prev_word, curr_word, bigram_counts):

# 计算给定前一个词的条件下,当前词出现的条件概率

return bigram_counts.get((prev_word, curr_word), 0) / bigram_counts.get((prev_word, "*"), 1)

```

在这个Python代码示例中,我们计算了一个bigram模型的条件概率。`calculate_bigram_prob`函数接收前一个词语`prev_word`、当前词语`curr_word`和包含bigram频率的字典`bigram_counts`作为输入,返回给定前一个词语的条件下当前词语出现的概率。

#### 2.1.2 隐马尔可夫模型(HMM)和上下文无关文法(CFG)

除了n-gram模型之外,隐马尔可夫模型(Hidden Markov Model,HMM)是另一个重要的统计模型,它在语言模型中扮演着重要角色。HMM通过引入隐状态(hidden state),使得模型能够捕捉到词语序列中更深层次的依赖关系。

上下文无关文法(Context-Free Grammar,CFG)则不同,它通过一系列的产生规则(production rules)来定义语法结构。CFG在自然语言处理中主要用于解析和理解句子的结构。

### 2.2 深度学习语言模型

随着深度学习技术的发展,语言模型也取得了显著的进展。深度学习语言模型通过构建复杂的神经网络来捕捉词语序列之间的依赖关系,并能够处理更长的上下文信息。

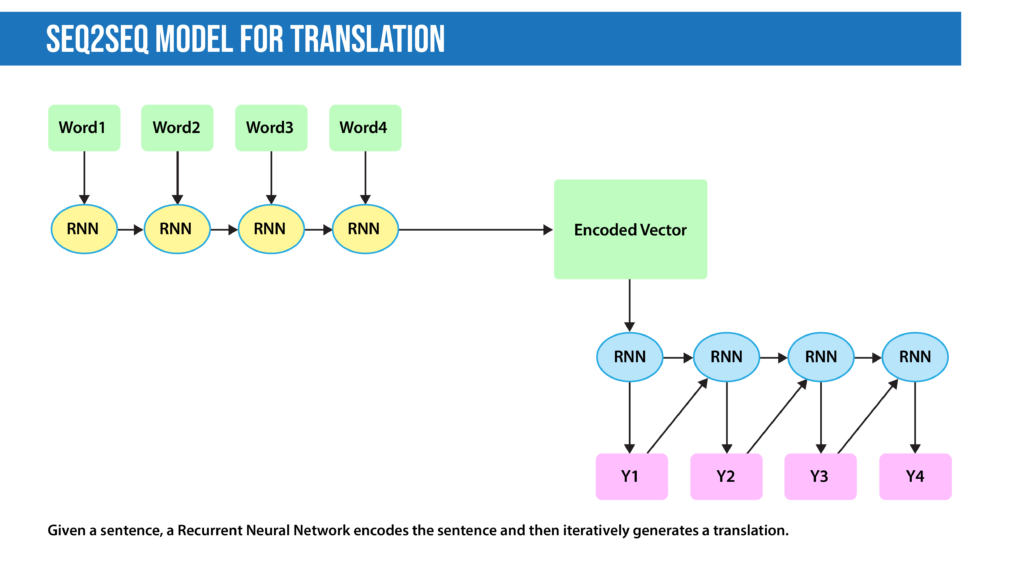

#### 2.2.1 循环神经网络(RNN)和长短期记忆网络(LSTM)

循环神经网络(Recurrent Neural Network,RNN)被设计用于处理序列数据,能够处理不同长度的输入序列。但传统的RNN由于梯度消失或梯度爆炸的问题,难以处理长距离依赖。

长短期记忆网络(Long Short-Term Memory,LSTM)是一种特殊类型的RNN,它通过引入门控机制解决了传统RNN的局限。LSTM能够在长序列中有效地学习和保持信息,被广泛应用于语言模型中。

```python

# LSTM模型的伪代码示例

import tensorflow as tf

lstm_model = tf.keras.Sequential([

tf.keras.layers.Embedding(vocab_size, embedding_dim, input_length=max_length),

tf.keras.layers.LSTM(units, return_sequences=True),

tf.keras.layers.LSTM(units),

tf.keras.layers.Dense(units, activation='softmax')

])

# 编译模型

lstm_***pile(loss='categorical_crossentropy', optimizer='adam', metrics=['accuracy'])

```

在该示例中,我们构建了一个简单的LSTM模型用于处理文本数据。首先,我们使用`Embedding`层将文本数据转换为向量表示,随后通过两个`LSTM`层处理序列信息,最后使用`Dense`层进行分类。

#### 2.2.2 Transformer模型和自注意力机制

Transformer模型是一个里程碑式的进步,它摒弃了传统的RNN结构,引入了自注意力(self-attention)机制,允许每个输入元素在处理过程中直接关注到序列中的其他元素。这种全局关注的能力使***former模型在捕捉长距离依赖方面表现尤为出色。

Transformer模型已经成为许多自然语言处理任务的首选模型,它的架构和性能优化策略不断推动语言模型技术的边界。

### 2.3 语言模型的评估指标

如何评估一个语言模型的性能呢?我们需要定义一些客观的评估指标。在语言模型领域,有多种指标可以用来衡量模型的表现,其中精确度、召回率和F1分数是最常用的指标之一。

#### 2.3.1 精确度、召回率和F1分数

精确度(Precision)是指模型预测为正的样本中实际为正的样本的比例。召回率(Recall)则是指模型正确识别的正样本数量占总正样本的比例。F1分数是精确度和召回率的调和平均值,它综合考虑了精确度和召回率两个指标。

```python

# 计算精确度、召回率和F1分数的Python代码示例

def calculate_precision recall, f1_score(true_positives, false_positives, false_negatives):

precision = true_positives / (true_positives + false_positives)

recall = true_positives / (true_positives + false_negatives)

f1 = 2 * (precision * recall) / (precision + recall)

return precision, recall, f1

```

#### 2.3.2 交叉熵损失和困惑度指标

除了上述评估指标,交叉熵损失(Cross-Entropy Loss)是深度学习中评估模型性能的常用损失函数。交叉熵损失能够衡量模型输出的预测概率分布与真实概率分布之间的差异。

困惑度(Perplexity)是基于交叉熵损失的另一种评价指标,它是衡量语言模型不确定性的度量。困惑度越低,表明模型对数据的拟合越好,预测能力越强。

在本节中,我们深入探讨了语言模型的理论基础,并通过统计模型和深度学习模型两个方面阐述了不同类型的模型以及它们的评估指标。下一章节,我们将分析语言模型在语音识别领域的应用及实例分析。

# 3. 语言模型在语音识别中的应用

在深入探讨语言模型在语音识别中的应用之前,我们需要先了解语音识别系统的基本工作原理。语音识别系统旨在将人类的语音转化为可读的文本,它包含多个关键步骤,如音频信号的预处理、特征提取、解码器的使用以及语言模型的集成等。本章节将详细解读这些步骤,并探讨端到端的语音识别模型,最后通过实例分析来展示如何通过不同的策略提升语言模型的精确度。

## 3.1 语音识别系统的工作原理

语音识别系统的核心在于将声音信号转换成文字,这个过程主要分为两大部分:声学模型处理和语言模型处理。其中,声学模型关注于声音信号的处理,而语言模型则处理序列化的文字。

### 3.1.1 音频信号预处理和特征提取

音频信号预处理是将原始的语音信号转换为一个适合进行特征提取的格式。这通常包括去噪声、增益控制、静音检测等步骤。音频信号经过预处理后,需要进行特征提取来生成声学特征向量。声学特征向量通常包含梅尔频率倒谱系数(MFCC)、线性预测编码系数(LPC)和滤波器组特征(FBANK)等。这些特征向量是后续模型识别的基础。

```python

import librosa

# 从音频文件中提取MFCC特征

def extract_mfcc_features(audio_file, sr=16000, n_mfcc=40):

audio, sample_rate = librosa.load(audio_file, sr=sr)

mfccs = librosa.feature.mfcc(y=audio, sr=sample_rate, n_mfcc=n_mfcc)

return mfccs

```

在上述Python代码块中,使用了`librosa`库来从音频文件中提取MFCC特征。该函数`extract_mfcc_features`接受音频文件路径、采样率和MFCC数量作为参数,输出MFCC特征矩阵。这些特征矩阵随后会被用于训练和识别模型。

### 3.1.2 解码器的作用和语言模型的集成

解码器在语音识别系统中扮演着至关重要的角色,它负责将声学模型的输出转换为可读的文字。在这一过程中,语言模型的集成至关重要,因为它能够提高识别结果的连贯性和可理解性。语言模型通过评估单词序列的合理性,帮助解码器选择最可能的单词序列作为最终的输出。

## 3.2 端到端语音识别模型

传统的语音识别系统往往需要多个独立的模块,例如声学模型、发音词典和语言模型。而端到端模型则旨在将这些部分合并成一个统一的网络,简化识别流程。

### 3.2.1 CTC(Connectionist Temporal Classification)模型

CTC是一种特别适合于序列数据的训练准则,常用于处理语音识别和手写识别等问题。CTC模型通过引入一个特殊的空白标签(blank token),使得网络能够学习输出不定长的时间序列。这种训练方式能够对齐输入和输出,无需事先对齐训练数据。

```python

import tensorflow as tf

def ctc_loss(y_true, y_pred):

```

0

0