数据挖掘中的异常检测:理论与实践案例,让你轻松掌握!

发布时间: 2024-09-01 17:34:49 阅读量: 107 订阅数: 79

# 1. 异常检测的基本概念和重要性

## 1.1 异常检测的定义

异常检测是一种数据分析技术,旨在识别数据集中与预期模式显著不同的异常点。它广泛应用于各种领域,比如网络安全、金融服务和工业监控等,帮助组织在事态严重之前发现潜在的问题。

## 1.2 异常检测的目的和应用场景

异常检测的主要目的在于预测和防范异常事件,从而减少损失和风险。在现实世界的应用场景中,它可以帮助检测信用卡欺诈、网络入侵、制造缺陷、健康监测异常等。有效的异常检测可以显著提高系统的稳定性和安全性。

## 1.3 异常检测的重要性

随着业务的日益复杂和数据量的爆炸式增长,异常检测技术的重要性愈发凸显。它不仅能够帮助组织预防未知的威胁,还可以通过深入的数据分析,挖掘数据背后隐藏的有价值信息,为决策提供支持。在未来,异常检测技术将继续在提升智能性和预测性方面发挥关键作用。

# 2. 异常检测的理论基础

### 2.1 异常检测的基本原理

#### 2.1.1 什么是异常

异常检测中的“异常”一词通常是指那些与大部分观测数据显著不同的数据点。它们可能表示系统中的错误、欺诈行为,或者是由未知因素引起的偏差。在统计学中,异常常常被描述为离群值(outliers),是需要额外关注和分析的数据点。为了识别这些异常,研究者和从业者们已经开发了多种理论和技术,它们构成了异常检测的基础。

#### 2.1.2 异常检测的目的和应用场景

异常检测的目的是从数据集中识别出异常样本,这些异常样本可能表示潜在的威胁、故障、欺诈、或其他不希望出现的行为。异常检测在许多领域都有广泛的应用,包括但不限于:

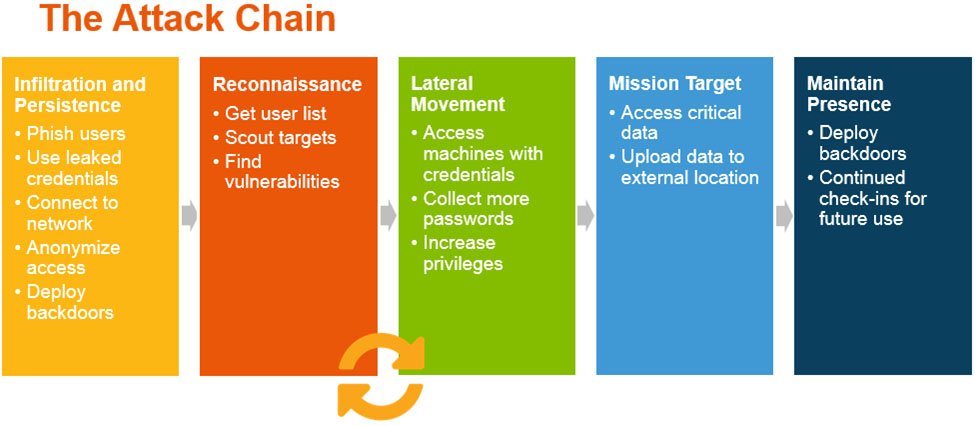

- **网络安全**:检测恶意活动或入侵尝试。

- **信用卡交易**:识别可疑的欺诈性交易。

- **医疗诊断**:发现异常的生理信号,可能指向病理情况。

- **工业生产**:监控设备的运行状态,预测并防止故障。

异常检测的应用场景要求数据必须能够反映出可能存在的异常行为,并且检测算法能够准确地从正常行为中将异常行为区分出来。接下来,我们将详细探讨异常检测的主要方法。

### 2.2 异常检测的主要方法

#### 2.2.1 统计学方法

统计学方法是异常检测中最早使用的一类方法,它们主要基于数据的统计特性进行异常识别。这些方法通常假设数据符合一定的统计分布(如正态分布),然后通过计算数据点与统计模型的偏差来判断其是否为异常。一些常见的统计学方法包括:

- **基于距离的方法**:通过测量数据点与中心或均值的距离来识别异常。

- **基于密度的方法**:根据数据点的局部密度来判断其是否为异常。

- **基于概率的方法**:根据数据点的概率分布来评估其异常程度。

#### 2.2.2 机器学习方法

随着机器学习的发展,利用算法模型进行异常检测的方法受到了越来越多的关注。机器学习方法通常涉及构建一个分类器,通过学习正常数据的特征,来区分异常数据。这种方法可以分为以下几种:

- **无监督学习**:例如使用聚类算法,通过数据点间的相似度来识别异常。

- **有监督学习**:训练一个分类器,给定标记的正常和异常数据,学习如何进行分类。

- **半监督学习**:结合了无监督和有监督的学习方法,使用标记数据来引导异常检测。

#### 2.2.3 深度学习方法

近年来,深度学习方法因其出色的特征学习能力,在异常检测领域也得到了广泛应用。深度学习模型能够自动从大规模数据中学习复杂的表示,从而更有效地捕捉到异常模式。典型的深度学习异常检测方法包括:

- **自编码器**:通过学习输入数据的压缩表示,然后重构,来识别重构误差大的数据点作为异常。

- **生成对抗网络(GANs)**:使用生成器产生数据,判别器区分真实数据和生成数据,异常数据会被判别器误判。

- **长短期记忆网络(LSTMs)**:特别适合处理序列数据,能够捕捉时间上的依赖性,对于时间序列中的异常行为敏感。

### 2.3 异常检测的评估指标

#### 2.3.1 准确率和召回率

在异常检测任务中,准确率(Accuracy)和召回率(Recall)是两个常用的评价指标。准确率定义为正确检测到的异常样本数与总检测样本数的比例,而召回率则是指正确检测到的异常样本数与实际异常样本总数的比例。虽然准确率是衡量模型性能的一个直观指标,但在异常检测中,召回率往往更为重要,因为漏掉一个真正的异常可能代价很大。

#### 2.3.2 ROC曲线和AUC值

受试者工作特征曲线(Receiver Operating Characteristic, ROC)和ROC曲线下的面积(Area Under Curve, AUC)是评估异常检测模型性能的另一种重要方法。ROC曲线通过描绘不同阈值下的真正类率(即召回率)与假正类率(False Positive Rate, FPR)之间的关系,来评价分类器的整体性能。AUC值则是对ROC曲线下的面积进行量化,一个接近1的AUC值表示模型有很好的检测性能。

在下一章节中,我们将具体展开异常检测的实践应用,通过详细的步骤和流程,以及案例分析,进一步深化我们对异常检测理论与实践的理解。

# 3. 异常检测的实践应用

在本章节中,我们将深入探讨如何将异常检测技术应用于真实世界的场景中。我们将遵循从理论到实践的路径,展示实现异常检测项目的具体步骤。接下来,我们会分析几个实际案例,通过案例来说明异常检测技术如何解决实际问题。

## 3.1 实现异常检测的步骤和流程

### 3.1.1 数据预处理

在任何机器学习项目中,数据预处理都占据着至关重要的地位。异常检测项目也不例外,数据的质量直接关系到最终模型的性能。数据预处理的步骤通常包括数据清洗、数据归一化、处理缺失值、异常值检测以及数据转换等。

- **数据清洗**:去除重复数据和错误数据,保证数据的真实性。

- **数据归一化**:将数据缩放到一个标准范围,消除不同量纲的影响。

- **处理缺失值**:采用插值、平均值或中位数等方法填补缺失数据。

- **异常值检测**:识别数据中的异常值,因为这些异常值可能本身就是我们要检测的目标。

```python

import numpy as np

from sklearn.preprocessing import MinMaxScaler

# 假设data是我们的原始数据集

data = np.array([[1, 2], [4, 6], [3, -1], [np.nan, 5]])

# 去除缺失值

data_clean = data[~np.isnan(data).any(axis=1)]

# 数据归一化

scaler = MinMaxScaler()

data_normalized = scaler.fit_transform(data_clean)

```

### 3.1.2 特征提取

特征提取是将原始数据转换为模型可以处理的格式的过程。在异常检测中,合适的特征能够帮助模型更好地识别异常。特征提取的常见方法包括主成分分析(PCA)、自动

0

0