YOLOv8网络结构图在自动驾驶中的应用:探索智能交通解决方案,赋能无人驾驶

发布时间: 2024-07-20 04:22:19 阅读量: 90 订阅数: 68

中小盘周报:大模型赋能自动驾驶,行业迎加速发展良机.pdf

# 1. YOLOv8网络结构图概述**

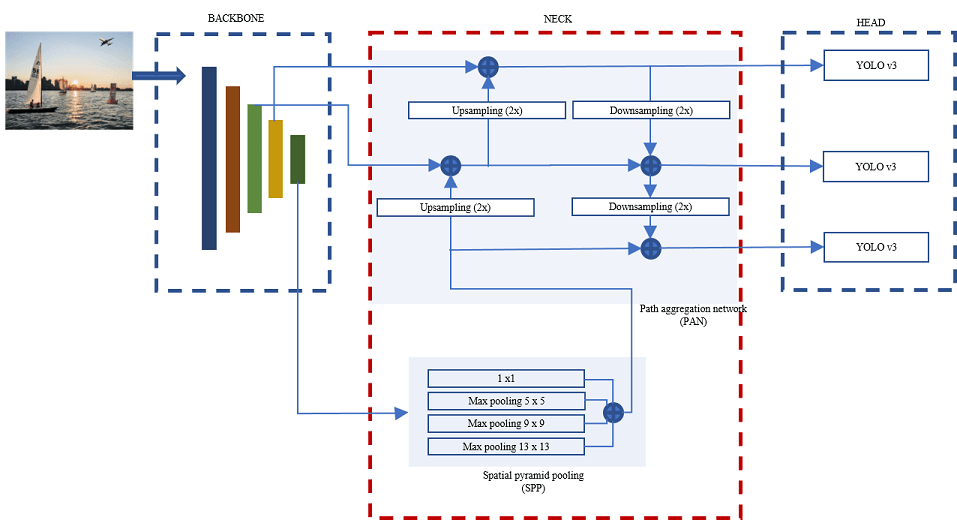

YOLOv8网络结构图是一个复杂且多层级的架构,旨在实现高效且准确的目标检测。它由以下主要组件组成:

- **主干网络:**采用Cross-Stage Partial Connections (CSP)Darknet53作为主干网络,用于提取图像特征。

- **Neck网络:**包含Spatial Attention Module (SAM)和Path Aggregation Network (PAN),用于融合不同尺度的特征图。

- **检测头:**负责预测目标的位置、大小和类别。它使用Anchor-Free机制,直接预测目标的中心点和偏移量。

YOLOv8的网络结构经过精心设计,在保持高精度的情况下实现了极高的推理速度,使其成为自动驾驶、智能交通和无人驾驶等实时目标检测应用的理想选择。

# 2. YOLOv8在自动驾驶中的应用

### 2.1 自动驾驶系统中的目标检测

在自动驾驶系统中,目标检测是一项至关重要的任务,它为车辆提供对周围环境的感知能力。通过检测和识别道路上的行人、车辆和其他障碍物,自动驾驶系统可以做出明智的决策,确保安全行驶。

YOLOv8作为一种高效且准确的目标检测算法,在自动驾驶领域具有广泛的应用。它能够实时处理视频流,快速准确地检测和识别各种目标。其强大的性能使其成为自动驾驶系统中目标检测的理想选择。

### 2.2 YOLOv8在自动驾驶中的优势

YOLOv8在自动驾驶中的优势主要体现在以下几个方面:

- **实时性:**YOLOv8的推理速度极快,能够以每秒数百帧的速度处理视频流,满足自动驾驶系统对实时目标检测的要求。

- **准确性:**YOLOv8的检测精度很高,能够准确识别不同类型的目标,包括行人、车辆、交通标志和道路标志。

- **鲁棒性:**YOLOv8对光照、天气和遮挡等复杂条件具有较强的鲁棒性,确保自动驾驶系统在各种环境下都能稳定运行。

- **可扩展性:**YOLOv8可以根据不同的应用场景进行定制和优化,满足自动驾驶系统对目标检测的不同需求。

### 2.3 YOLOv8在自动驾驶中的应用场景

YOLOv8在自动驾驶中的应用场景十分广泛,主要包括:

- **行人检测:**YOLOv8可以检测和识别道路上的行人,为自动驾驶系统提供行人安全保障。

- **车辆检测:**YOLOv8可以检测和识别道路上的车辆,包括汽车、卡车和摩托车,为自动驾驶系统提供车辆避让和车道保持等功能。

- **障碍物检测:**YOLOv8可以检测和识别道路上的障碍物,包括交通锥、路障和施工区域,为自动驾驶系统提供障碍物规避功能。

- **交通标志识别:**YOLOv8可以检测和识别交通标志,包括限速标志、停车标志和禁止通行标志,为自动驾驶系统提供交通规则遵守功能。

### 2.4 YOLOv8在自动驾驶中的案例分析

**案例:自动驾驶车辆的行人检测**

在自动驾驶车辆中,行人检测至关重要。YOLOv8可以实时检测和识别道路上的行人,并根据行人的位置和运动轨迹预测行人的行为。通过对行人行为的准确预测,自动驾驶车辆可以及时采取减速或避让措施,确保行人安全。

**代码示例:**

```python

import cv2

import numpy as np

# 加载 YOLOv8 模型

net = cv2.dnn.readNet("yolov8.weights", "yolov8.cfg")

# 设置输入图像尺寸

input_width = 640

input_height = 640

# 加载视频流

cap = cv2.VideoCapture("video.mp4")

while True:

# 读取视频帧

ret, frame = cap.read()

if not ret:

break

# 预处理图像

blob = cv2.dnn.blobFromImage(frame, 1 / 255.0, (input_width, input_height), (0, 0, 0), swapRB=True, crop=False)

# 设置输入

net.setInput(blob)

# 前向传播

detections = net.forward()

# 后处理检测结果

for detection in detections:

# 获取目标类别和置信度

class_id = int(detection[5])

confidence = detection[2]

# 过滤低置信度检测

if confidence < 0.5:

continue

# 获取目标边界框

x1, y1, x2, y2 = detection[3:7] * np.array([input_width, input_height, input_width, input_height])

# 绘制边界框和标签

cv2.rectangle(frame, (x1, y1), (x2, y2), (0, 255, 0), 2)

cv2.putText(frame, f"Pedestrian ({confidence:.2f})", (x1, y1 - 10), cv2.FONT_HERSHEY_SIMPLEX, 0.5, (0, 255, 0), 2)

# 显示帧

cv2.imshow("Pedestrian Detection", frame)

# 按下 q 退出

if cv2.waitKey(1) & 0xFF == ord("q"):

break

# 释放视频流

cap.release()

cv2.destroyAllWindows()

```

**逻辑分析:**

该代码示例展示了如何使用 YOLOv8 在自动驾驶车辆中进行行人检测。代码首先加载 YOLOv8 模型,然后从视频流中读取帧并进行预处理。接下来,将预处理后的图像输入到 YOLOv8 模型中进行前向传播。后处理检测结果,过滤低置信度检测并绘制边界框和标签。最后,显示帧并允许用户按下 q 退出。

**参数说明:**

- `input_width`:输入图像的宽度

- `input_height`:输入图像的高度

- `confidence`:目标检测的置信度阈值

- `x1`、`y1`、`x2`、`y2`:目标边界框的左上角和右下角坐标

0

0