【Python聚类局限性分析】:案例剖析与应对策略

发布时间: 2024-08-31 15:35:51 阅读量: 88 订阅数: 53

# 1. 聚类分析概述

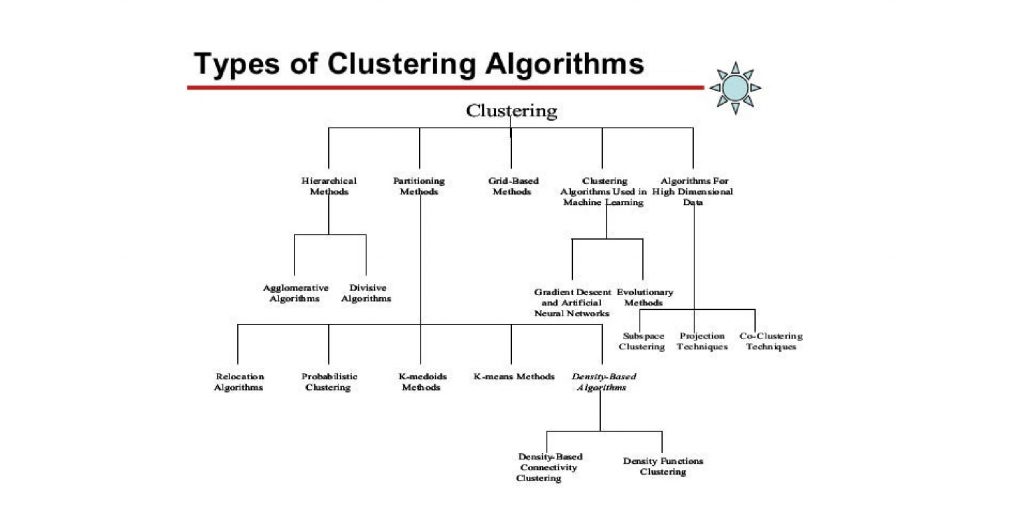

聚类分析是数据挖掘和统计学领域中的一种重要技术,它的核心目标是将数据集中的样本按照相似性划分为若干个类别或簇。聚类可以应用于多种场景,如市场细分、社交网络分析、图像分割等领域。聚类过程中,同类数据的相似性应当尽可能地高,而不同类数据的相似性应当尽可能地低。理解聚类分析的基本概念、方法和应用场景,对于数据分析和机器学习领域的从业者来说是基础且必要的。

聚类分析的方法论不仅限于单一算法,它包含了多种不同的算法,如K-means、层次聚类、DBSCAN、谱聚类等,每种算法都有其特定的应用场景和优劣之处。在实践中,根据数据的特性及分析目的选择最合适的聚类算法至关重要。

# 2. Python聚类算法基础

## 2.1 常见的聚类算法介绍

### 2.1.1 K-means聚类算法原理及其实现

K-means聚类算法是一种广泛使用的迭代算法,它的目标是将n个数据点划分到k个聚类中,使得每个数据点都属于离它最近的中心点所代表的聚类,从而最小化簇内误差的平方和。该算法流程包括以下步骤:

1. 随机初始化k个中心点。

2. 将每个数据点划分到最近的中心点所代表的簇中。

3. 更新每个簇的中心点,计算每个簇内所有点的均值。

4. 重复步骤2和3,直到中心点不再发生变化或达到预定的迭代次数。

K-means算法的关键在于合理选择初始中心点,以避免陷入局部最优解。下面是一个简单的Python代码示例,使用Scikit-learn库实现K-means算法:

```python

from sklearn.cluster import KMeans

import numpy as np

# 示例数据集

X = np.array([[1, 2], [1, 4], [1, 0],

[10, 2], [10, 4], [10, 0]])

# 实例化KMeans对象

kmeans = KMeans(n_clusters=2, random_state=0)

# 拟合数据

kmeans.fit(X)

# 输出聚类中心和每个数据点的簇标签

print("Cluster Centers:\n", kmeans.cluster_centers_)

print("Labels:", kmeans.labels_)

```

参数`n_clusters=2`表示我们想将数据分为两个簇,`random_state=0`用于初始化的随机种子,确保每次运行结果一致。`fit`方法用于拟合数据并找到最优的聚类中心。

### 2.1.2 层次聚类算法概述与代码实现

层次聚类通过建立数据点间的距离矩阵,利用不同的规则将数据点或已形成的簇逐步合并,直到满足停止条件。层次聚类分为两种主要类型:

- 自底向上的聚合(AGNES,Agglomerative Nesting)

- 自顶向下的分裂(DIANA,Divisive Analysis)

以下是一个简单的使用自顶向下的分裂方法进行层次聚类的Python代码示例:

```python

from sklearn.cluster import AgglomerativeClustering

import matplotlib.pyplot as plt

# 示例数据集

X = np.array([[1, 2], [2, 1], [1, 0],

[10, 2], [11, 1], [10, 0]])

# 实例化AgglomerativeClustering对象

agglo = AgglomerativeClustering(n_clusters=2)

# 拟合数据

labels = agglo.fit_predict(X)

# 可视化聚类结果

plt.scatter(X[:, 0], X[:, 1], c=labels)

plt.show()

```

### 2.1.3 密度聚类与谱聚类简介

密度聚类算法,如DBSCAN和OPTICS,依据数据点的密度特性进行聚类,能够识别出任意形状的簇,并且可以处理噪声数据。谱聚类则将数据的结构信息通过拉普拉斯矩阵编码,再应用传统的聚类方法。

接下来是密度聚类和谱聚类的简要介绍和实现代码,将分别在后续的小节中详细讨论。

## 2.2 Python中聚类算法的库与工具

### 2.2.1 Scikit-learn库中的聚类工具

Scikit-learn提供了丰富的聚类算法实现,包括但不限于K-means、层次聚类、DBSCAN、OPTICS、谱聚类等。这些算法都可以通过简单易用的API进行调用,并且具有良好的文档支持。

下面是一个使用Scikit-learn中的`MiniBatchKMeans`算法的示例,该算法是一种改进版的K-means,适合处理大规模数据集:

```python

from sklearn.cluster import MiniBatchKMeans

from sklearn.datasets import make_blobs

# 生成模拟数据集

X, _ = make_blobs(n_samples=1000, centers=3, n_features=2, random_state=0)

# 实例化MiniBatchKMeans对象

minibatch_kmeans = MiniBatchKMeans(n_clusters=3, random_state=0)

# 训练模型

minibatch_kmeans.fit(X)

# 输出聚类结果

print("Cluster Centers:\n", minibatch_kmeans.cluster_centers_)

```

### 2.2.2 其他常用聚类分析库对比

除Scikit-learn外,还有其他一些库提供了聚类算法的实现,例如:

- **Pyclustering**:一个较为全面的库,提供了K-means、层次聚类、DBSCAN等聚类算法的实现。

- **Spearmint**:专注于密度聚类算法,如DBSCAN、HDBSCAN等。

- **hdbscan**:一个基于OPTICS算法的实现,专用于处理具有噪声的数据集。

每个库的侧重点不同,因此在选择使用时要根据具体需求进行判断。例如,Scikit-learn的优势在于其综合性和稳定性;而Pyclustering则提供了更多算法选择,尤其是对于那些希望深入了解算法细节的用户。

## 2.3 聚类算法的选择与评估

### 2.3.1 不同场景下算法的选择策略

选择聚类算法时,需要考虑数据集的特点、预期的簇形状和大小、以及是否需要考虑噪声和异常值。以下是一个简单的场景选择策略表:

| 数据特性 | 推荐算法 |

|---------|---------|

| 簇形状近似为球形 | K-means |

| 簇大小相似 | 层次聚类 |

| 非球形簇、噪声数据 | DBSCAN |

| 大规模数据集 | MiniBatchKMeans |

| 复杂形状的簇 | 谱聚类 |

### 2.3.2 聚类结果的评估指标与方法

聚类算法性能的评估可以通过多种方法进行,常用的内部指标有轮廓系数(Silhouette Coefficient)、戴维斯-布尔丁指数(Davies-Bouldin Index)和Calinski-Harabasz指数等。而外部指标如调整兰德指数(Adjusted Rand Index)和互信息(Mutual Information)则需要真实标签作为参考。

下面展示一个使用Scikit-learn计算轮廓系数的代码示例:

```python

from sklearn.metrics import silhouette_score

# 假设已知聚类结果

labels = [0, 1, 2, 2, 1]

# 计算轮廓系数

score = silhouette_score(X, labels)

print("Silhouette Coefficient: ", score)

```

`X`是原始数据集,`labels`是聚类后

0

0