【Python并行计算】:聚类算法大数据处理加速方案

发布时间: 2024-08-31 15:21:12 阅读量: 259 订阅数: 70

# 1. Python并行计算概述

## 1.1 Python并行计算的必要性

随着信息技术的发展,数据量呈爆炸式增长。传统的串行计算模型已经无法满足大数据的处理需求,尤其是在需要进行大规模数据分析和处理的场景中。Python作为一种高级编程语言,因其简洁的语法和强大的库支持,逐渐成为并行计算领域的热门选择。并行计算允许开发者同时执行多个计算任务,显著提高了计算效率,这在处理大规模数据集时尤为重要。

## 1.2 Python的并行计算特点

Python的并行计算特点包括其对多线程和多进程的支持。Python的全局解释器锁(GIL)限制了传统的多线程执行,但通过多进程模型可以有效规避这一问题。多进程模型允许运行多个Python解释器实例,从而实现真正的并行计算。此外,Python的简洁语法使得代码编写和调试更为容易,从而加速了开发过程。

## 1.3 Python并行计算的应用领域

Python并行计算的应用领域广泛,包括但不限于科学研究、金融分析、机器学习、大数据处理等。通过并行计算,Python可以加速算法的执行,提供实时数据分析和处理的能力。在大数据时代背景下,Python并行计算能够处理以往无法想象的数据规模,为企业和研究机构提供强有力的工具支持。

# 2. 并行计算基础理论

## 2.1 并行计算的概念与发展

### 2.1.1 并行计算定义

并行计算是指同时使用多个计算资源解决计算问题的过程。在并行计算中,任务被划分为可以同时执行的多个部分,每个部分由不同的计算单元处理,这些计算单元可以是处理器、核心或节点。并行计算的关键在于任务的分割、资源的分配和任务的同步。并行计算的主要优势在于缩短了程序的执行时间,特别适用于处理大规模数据集和复杂算法。

### 2.1.2 发展历程与现状

并行计算的发展经历了从单处理器到多处理器,再到分布式集群的转变。早期的并行计算主要用于科学与工程领域,随着技术的进步和数据量的爆炸性增长,它逐渐普及到金融、医疗、零售等多个领域。目前,云计算和网格计算技术的普及使得并行计算资源更加易于获得和使用,推动了并行计算的广泛应用。

## 2.2 大数据处理的基本原理

### 2.2.1 大数据的特征

大数据通常具有四个显著特征,即4V:体量大(Volume)、速度快(Velocity)、种类多 Variety)和价值密度低(Veracity)。体量大指的是数据量巨大,传统数据库难以处理;速度快指的是数据流动迅速,需要实时处理;种类多指的是数据类型繁多,包括结构化、半结构化和非结构化数据;价值密度低意味着在海量数据中,有价值的信息可能只占一小部分。

### 2.2.2 大数据处理流程

大数据处理流程通常包括数据采集、数据存储、数据处理、数据分析和数据展示五个基本环节。数据采集涉及从不同来源收集数据;数据存储需要对采集的数据进行有效管理;数据处理则包括数据清洗、转换等预处理工作;数据分析关注从数据中提取有用信息和知识;数据展示则是将分析结果以用户可以理解的形式呈现出来。

## 2.3 并行计算与大数据的融合

### 2.3.1 融合的必要性

并行计算与大数据的融合是当前技术发展的必然趋势。大数据的四个V特征决定了传统的串行计算方法无法满足处理需求,必须采用并行计算来提高处理速度和效率。通过并行计算,可以将数据分布到多个计算节点上进行处理,显著缩短处理时间,同时能够处理更大规模的数据集。

### 2.3.2 融合的挑战与机遇

并行计算与大数据融合的挑战主要包括硬件资源的协调、软件算法的设计、数据一致性和同步性问题以及系统复杂性的管理。机遇则在于,这种融合可以推动新技术的发展,如实时数据处理和分析、非结构化数据处理技术,以及新型的并行数据库技术等。此外,并行计算的普及也催生了云计算和边缘计算等新型计算模型。

在并行计算与大数据的融合过程中,关键技术如分布式文件系统(如HDFS)、资源调度框架(如YARN)、以及大数据处理平台(如Hadoop和Spark)都扮演了重要角色。并行计算提升了大数据处理的速度和规模,使得从大数据中快速提取价值成为可能。

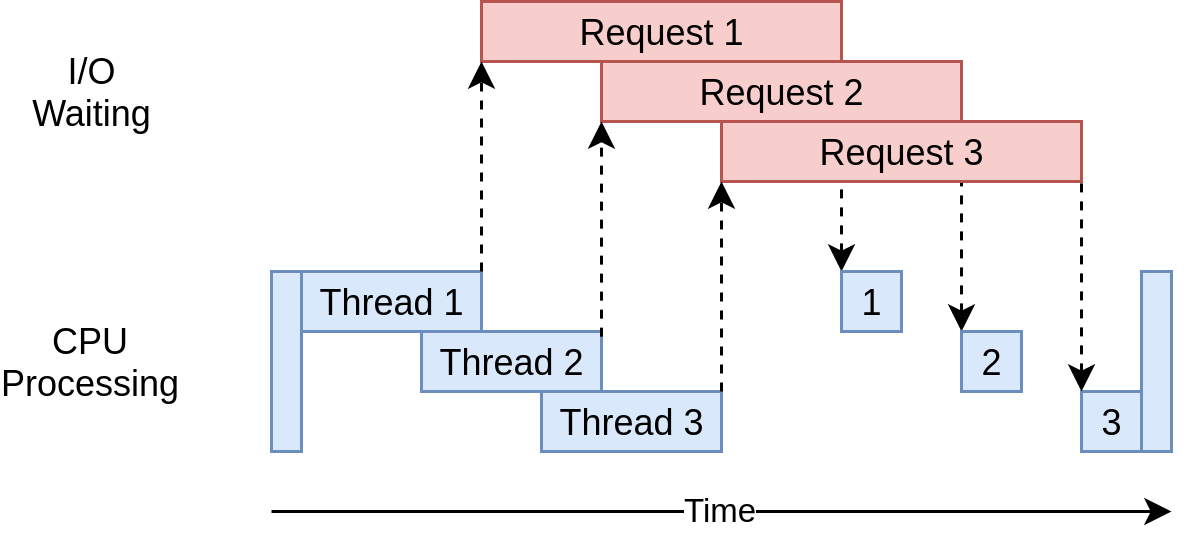

# 3. Python并行编程模型

## 3.1 多进程编程模型

### 3.1.1 Python中的多进程模块

多进程编程模型允许程序同时运行多个进程,每个进程拥有自己的内存空间,可以独立执行任务。在Python中,`multiprocessing`模块是实现多进程的主要工具。它提供了一系列与`threading`模块相似的接口,但利用了操作系统的多核处理能力。

Python的`multiprocessing`模块包含了`Process`, `Queue`, `Pipe`, `Lock`, `Semaphore`, `Event`等类和函数。通过这些组件,开发者可以构建复杂的并行程序。

#### 进程创建与管理

创建一个进程相对简单:

```python

from multiprocessing import Process

def f(name):

print('hello', name)

if __name__ == '__main__':

p = Process(target=f, args=('bob',))

p.start()

p.join()

```

在上述代码中,定义了一个函数`f`,通过`Process`类创建了一个进程对象,并将其目标函数`f`以及传递给目标函数的参数传递进去。调用`start()`方法后,进程启动;`join()`方法则是等待进程结束,确保主程序在进程完成后继续执行。

#### 进程间通信(IPC)

进程间通信(IPC)是多进程编程中的重要方面。`multiprocessing`模块提供了`Queue`和`Pipe`等通信方式。

- Queue: 一个先进先出的数据结构,可以让多个进程共享数据。

- Pipe: 用于两个进程之间的双向通信。

使用`Queue`的示例代码:

```python

from multiprocessing import Process, Queue

def f(q):

q.put([42, None, 'hello'])

if __name__ == '__main__':

q = Queue()

p = Process(target=f, args=(q,))

p.start()

print(q.get()) # 输出: [42, None, 'hello']

p.join()

```

在这个例子中,进程`p`将一个列表写入`Queue`,主进程从`Queue`读取数据。这种方式确保了数据在进程间安全、可靠地传输。

### 3.1.2 进程间通信(IPC)

进程间通信是指多个进程之间交换信息或数据的技术。在多进程编程模型中,IPC机制是必须的,因为每个进程有独立的内存空间,因此需要一些机制来实现进程间的通信。

#### 共享内存与消息传递

在Python中,使用`multiprocessing`模块可以实现两种主要的IPC机制:共享内存和消息传递。

- 共享内存:多个进程可以直接读写内存中的同一块区域。这种方式速度较快,但需要开发者注意同步问题,以避免竞态条件。

- 消息传递:进程间通过发送和接收消息来进行通信。`multiprocessing`模块中的`Queue`和`Pipe`就是消息传递的两种形式。它们自动处理同步问题,使得开发者可以不必担心。

使用共享内存的一个例子是通过`Value`或`Array`来实现:

```python

from multiprocessing import Process, Value, Array

def modify共享变量(n, a):

n.value = 3.1415927 # 更新共享内存中的值

for i in range(len(a)):

a[i] = -a[i] # 更新共享内存中的数组

if __name__

```

0

0