深度学习中的特征工程技术:专家教你如何提取有效特征

发布时间: 2024-09-06 17:35:58 阅读量: 11 订阅数: 48

# 1. 深度学习与特征工程的基础

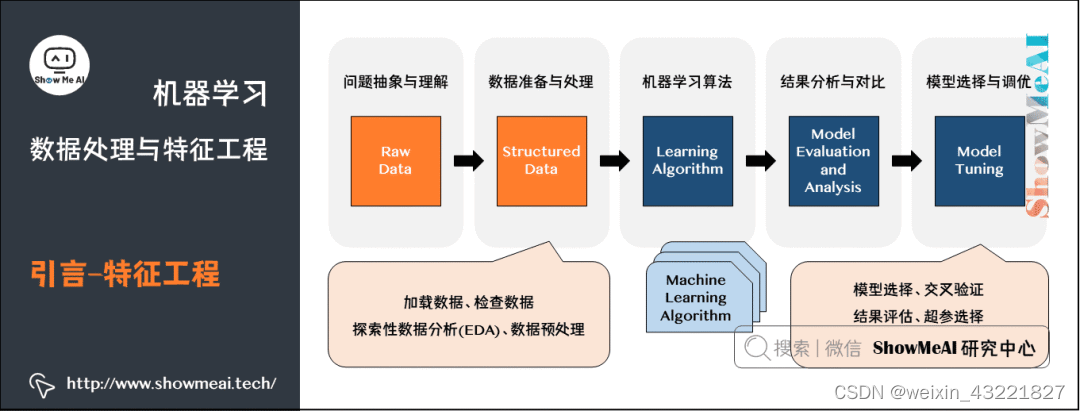

深度学习(Deep Learning)是机器学习的一个分支,它通过构建多层神经网络来模拟人脑处理信息的方式。这一技术的核心是通过大数据学习特征表示,以更深入地理解数据的本质。而特征工程(Feature Engineering)在深度学习中扮演着至关重要的角色,它不仅仅是数据预处理的一部分,更是提升模型性能的关键步骤。特征工程关注于数据的转换,使模型能更有效地从数据中学习。这一章节将介绍深度学习与特征工程的基本概念和两者之间的关系,为读者构建后续章节深入探讨特征选择、提取技术、实践技巧以及高级技术的坚实基础。

# 2. 特征工程的理论基础

## 2.1 特征工程的定义与重要性

### 2.1.1 什么是特征工程

特征工程是数据科学领域的一个核心概念,指的是数据挖掘过程中,通过人为的创造和选择特征来提高模型的性能。特征工程的目标是构建出更有效的特征,以便机器学习模型可以更好地理解数据。特征可以是原始数据中的单个属性,也可以是多个属性的组合,甚至可以是通过某种方式转化而来的抽象表示。

### 2.1.2 特征工程在深度学习中的作用

深度学习模型通常需要大量的数据和复杂网络结构,但是数据的质量和特征的表达方式依然对最终模型的性能有决定性的影响。特征工程通过增加对数据的理解,可以显著改善模型的性能,缩短训练时间,甚至可以解决因数据不足而难以训练复杂模型的问题。在深度学习中,特征工程也涉及到对数据进行预处理,比如归一化、标准化,以及使用合适的激活函数和损失函数来优化特征的表示。

## 2.2 特征选择的方法论

### 2.2.1 过滤法(Filter Methods)

过滤法依据特征与标签之间的统计特性来选择特征。这种方法独立于模型之外,通常基于特征的相关性、冗余性、以及与标签之间的统计测试来进行特征选择。常见的过滤法包括:

- 卡方检验(Chi-squared test)

- 互信息(Mutual Information)

- 方差分析(ANOVA)

过滤法的关键在于计算得分,这个得分反映了特征的重要性,之后根据得分对特征进行排序,选择得分最高的特征纳入模型。代码块展示了使用卡方检验作为过滤方法的Python示例:

```python

import pandas as pd

from sklearn.feature_selection import SelectKBest, chi2

# 假设df是已经加载的数据集,其中包含特征和标签

X = df.drop('label', axis=1) # 特征

y = df['label'] # 标签

# 使用卡方检验

chi2_selector = SelectKBest(chi2, k='all')

X_kbest = chi2_selector.fit_transform(X, y)

# 输出得分和选择的特征

scores = chi2_selector.scores_

selected_features = X.columns[chi2_selector.get_support(indices=True)]

```

### 2.2.2 包裹法(Wrapper Methods)

包裹法利用特定的模型来评估特征集的效果,并通过优化算法来选择最优的特征子集。它尝试所有可能的特征组合,或者使用搜索算法(如递归特征消除)来找到最佳组合。这种方法的特点是计算成本高,但是选择的特征集合往往针对特定模型优化得很好。

示例代码块使用递归特征消除(RFE)来选择特征:

```python

from sklearn.feature_selection import RFE

from sklearn.linear_model import LogisticRegression

# 假设X_train和y_train是已经准备好的训练数据和标签

model = LogisticRegression()

rfe = RFE(estimator=model, n_features_to_select=5) # 选择5个特征

rfe = rfe.fit(X_train, y_train)

# 输出选择的特征

selected_features = pd.Series(rfe.support_, index=X_train.columns)

```

### 2.2.3 嵌入法(Embedded Methods)

嵌入法结合了过滤法和包裹法的特点,通过训练模型并使用模型特定的正则化项来选择特征。例如,L1正则化(Lasso回归)通过其惩罚项可以将不重要的特征系数压缩至零,从而实现特征选择。因此,它比过滤法更依赖于模型,但比包裹法计算效率更高。

示例代码块使用Lasso回归作为嵌入方法进行特征选择:

```python

from sklearn.feature_selection import SelectFromModel

from sklearn.linear_model import LassoCV

# 假设X_train和y_train是已经准备好的训练数据和标签

lasso = LassoCV()

embeded_selector = SelectFromModel(lasso)

X_important = embeded_selector.fit_transform(X_train, y_train)

# 输出选择的特征

selected_features = pd.Series(embeded_selector.get_support(), index=X_train.columns)

```

## 2.3 特征提取的技术和策略

### 2.3.1 主成分分析(PCA)

主成分分析(PCA)是统计学中用来简化数据集的技术。它通过线性变换将数据转换到一个新的坐标系统中,使得数据的方差在新坐标系的第一轴(主成分)上最大,从而减少数据的维度。PCA可以提取出最重要的信息,并且可以减少数据的复杂性。

PCA的基本步骤包括:

1. 标准化数据(如果特征单位不同)

2. 计算协方差矩阵

3. 计算协方差矩阵的特征值和特征向量

4. 选择k个最重要的特征向量

5. 将数据投影到选定的特征向量上

下面的代码块展示了如何使用PCA进行数据降维:

```python

import numpy as np

from sklearn.decomposition import PCA

from sklearn.preprocessing import StandardScaler

# 假设X是一个n行m列的数据集

X = np.random.rand(100, 10) # 示例数据集

scaler = StandardScaler()

X_scaled = scaler.fit_transform(X)

# 应用PCA降维到两个主成分

pca = PCA(n_components=2)

X_pca = pca.fit_transform(X_scaled)

# 输出降维后的数据

print(X_pca)

```

### 2.3.2 线性判别分析(LDA)

线性判别分析(LDA)是一种监督学习的降维技术,其目的是找到数据的最佳投影方向,以便使得不同类别的样本在新的子空间中尽量分开,同类样本尽量聚集。LDA在特征提取中特别有用,因为它不仅减少了数据维度,而且考虑了类别标签信息。

LDA的基本步骤为:

1. 计算类内散度矩阵和类间散度矩阵

2. 计算类间散度矩阵的特征值和特征向量

3. 选择k个最大的特征值对应的特征向量

4. 将数据投影到选定的特征向量上

示例代码块使用LDA进行特征提取:

```python

from sklearn.discriminant_analysis import LinearDiscriminantAnalysis as LDA

# 假设X是一个n行m列的数据集,y是对应的标签集

X = np.random.rand(100, 10) # 示例数据集

y = np.random.randint(0, 2, 100) # 随机生成的二分类标签

# 应用LDA提取2个特征

lda = LDA(n_components=2)

X_lda = lda.fit_transform(X, y)

# 输出提取的特征

print(X_lda)

```

### 2.3.3 t分布随机邻域嵌入(t-SNE)

t分布随机邻域嵌入(t-SNE)是一种非线性降维技术,主要用于高维数据的可视化。t-SNE通过保持原始数据点间的局部邻域结构来将数据点映射到二维或三维空间中。它特别适合于捕捉样本间复杂的关系,并以可视化的方式展示出来。t-SNE通常用于探索性数据分析阶段,帮助研究者理解数据的分布。

t-SNE的步骤如下:

1. 计算样本间的条件概率分布

2. 最小化条件概率分布和t分布间的距离

3. 通过优化算法(如梯度下降)找到最佳的低维表示

下面是一个使用t-SNE进行数据降维的代码示例:

```python

import numpy as np

from sklearn.manifold import TSNE

import matplotlib.pyplot as plt

# 假设X是一个n行m列的数据集

X = np.random.rand(100, 10) # 示例数据集

# 应用t-SNE将数据映射到2维空间

tsne = TSNE(n_components=2, random_state=0)

X_tsne = tsne.fit_transform(X)

# 可视化结果

plt.scatter(X_tsne[:, 0], X_tsne[:, 1])

plt.show()

```

通过上述方法,特征工程可以帮助我们更好地理解数据,提取出有价值的信息,并优化机器学习模型的性能。每种方法都有其适用场景,选择合适的方法对特征进行提取和选择是提升模型表现的关键步骤。在后续章节中,我们将深入探讨特征工程的实践技巧以及如何在深度学习中应用高级

0

0