【实战演练】使用Faker生成测试数据:测试数据生成、数据模拟、Faker库

发布时间: 2024-06-26 02:19:08 阅读量: 127 订阅数: 129

计算机前端-实战.目视频1-05.使用faker生成测试数据.wmv

# 2.1.1 基本数据类型

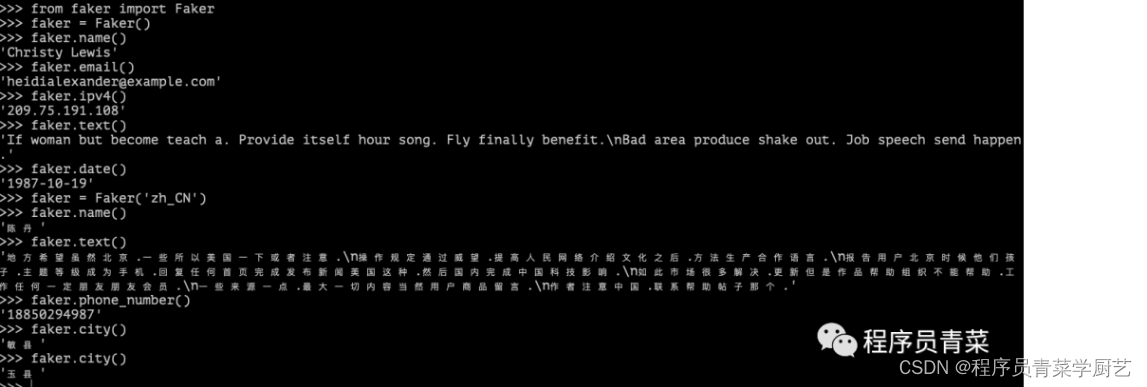

Faker库提供了生成基本数据类型的方法,包括:

- **整数:**`faker.random_int()`

- **浮点数:**`faker.random_float()`

- **布尔值:**`faker.boolean()`

- **字符串:**`faker.text()`、`faker.word()`

- **日期和时间:**`faker.date()`、`faker.time()`

# 2. Faker库的使用技巧

### 2.1 Faker库的数据类型和生成方法

Faker库提供了丰富的随机数据生成方法,涵盖了各种数据类型,包括基本数据类型和复杂数据类型。

#### 2.1.1 基本数据类型

基本数据类型包括整数、浮点数、布尔值、字符串和日期。Faker库提供了以下方法生成这些基本数据类型:

```python

# 生成整数

faker.random_int(min=0, max=100)

# 生成浮点数

faker.random_float(left_digits=2, right_digits=2, positive=True)

# 生成布尔值

faker.boolean()

# 生成字符串

faker.name()

faker.address()

faker.email()

# 生成日期

faker.date()

faker.date_time()

```

**参数说明:**

* `min` 和 `max`:整数生成范围的最小值和最大值。

* `left_digits` 和 `right_digits`:浮点数小数点左右两侧的位数。

* `positive`:是否生成正浮点数。

* `left_digits` 和 `right_digits`:字符串生成长度的最小值和最大值。

**代码逻辑分析:**

* `random_int` 方法生成一个指定范围内的随机整数。

* `random_float` 方法生成一个指定小数位数的随机浮点数。

* `boolean` 方法生成一个随机布尔值。

* `name`、`address` 和 `email` 方法生成随机姓名、地址和电子邮件地址。

* `date` 和 `date_time` 方法生成随机日期和时间。

#### 2.1.2 复杂数据类型

除了基本数据类型,Faker库还提供了生成复杂数据类型的方法,例如列表、字典和对象。

```python

# 生成列表

faker.words(nb=10)

faker.sentences(nb=5)

# 生成字典

faker.profile()

# 生成对象

faker.company()

faker.job()

```

**参数说明:**

* `nb`:列表或句子中元素的数量。

**代码逻辑分析:**

* `words` 方法生成一个指定数量的随机单词列表。

* `sentences` 方法生成一个指定数量的随机句子列表。

* `profile` 方法生成一个包含个人信息的字典。

* `company` 和 `job` 方法生成随机公司和职业信息的对象。

### 2.2 Faker库的定制化配置

Faker库提供了灵活的定制化配置选项,允许用户根据需要调整数据生成行为。

#### 2.2.1 自定义数据生成器

Faker库允许用户创建自定义数据生成器,以

0

0