排序算法深度解析:从选择到归并,提升算法排序效率的5大策略

发布时间: 2024-09-09 22:08:47 阅读量: 48 订阅数: 36

# 1. 排序算法的基石

排序算法是编程领域中最基础且重要的算法之一,无论是在数据处理、数据库管理还是在优化搜索效率等方面,排序算法都扮演着至关重要的角色。理解排序算法的基石,即基础排序算法的原理,是深入学习高级排序算法的先决条件。

## 1.1 算法的基本概念

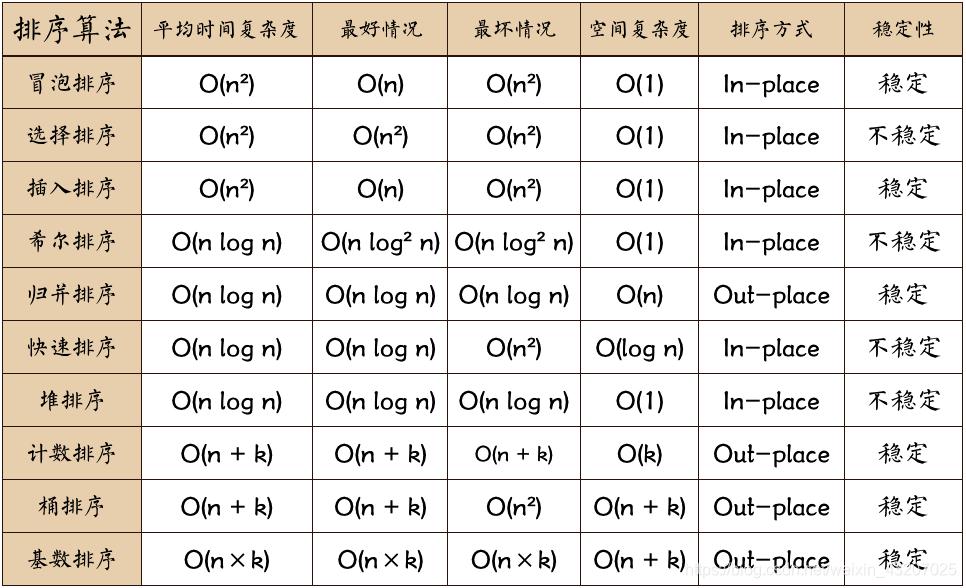

在计算机科学中,排序算法是一系列将元素按特定顺序排列的算法。这些算法通过比较和交换元素的位置来达到排序的目的,常见的排序算法包括冒泡排序、选择排序、插入排序、归并排序、快速排序等。

## 1.2 排序算法的重要性

排序算法的重要性体现在几个方面:

- **效率提升:** 对数据进行排序可以显著提高搜索和查找的效率。

- **稳定性:** 在很多应用场景下,保证数据的稳定排序(即相等元素的相对位置不变)是必要的。

- **内存管理:** 排序也是数据存储和管理的基础,良好的排序算法可以优化内存使用。

## 1.3 排序算法分类

排序算法通常可以分为两类:比较排序和非比较排序。

- **比较排序:** 通过元素间的比较来进行排序,包括插入排序、选择排序、归并排序等。

- **非比较排序:** 如计数排序、基数排序等,这些算法利用元素的实际值来确定元素位置。

在接下来的章节中,我们将更深入地探讨这些排序算法的实现方法、优化策略以及应用场景。了解这些基础知识后,读者将能够更好地评估和选择适合特定问题的排序方法。

# 2. 选择排序及其优化

## 2.1 基本选择排序算法

### 2.1.1 算法原理与步骤

选择排序是一种简单直观的排序算法,它的工作原理如下:首先在未排序序列中找到最小(或最大)元素,存放到排序序列的起始位置,然后,再从剩余未排序元素中继续寻找最小(或最大)元素,然后放到已排序序列的末尾。以此类推,直到所有元素均排序完毕。

选择排序算法的步骤可以描述为:

1. 从待排序的数据元素中选出最小(或最大)的一个元素,存放在序列的起始位置,直到全部待排序的数据元素排完。

2. 重复第一步,直到所有元素排完。

### 2.1.2 时间复杂度分析

选择排序的时间复杂度为 O(n^2),无论是在最好、平均还是最坏情况下,选择排序的时间复杂度都保持不变。因为选择排序的性能与待排序的序列初始状态无关,即使在数据完全有序的情况下,它仍然会进行 n-1 次比较来确定最小元素的位置。

```python

def selection_sort(arr):

for i in range(len(arr)):

min_idx = i

for j in range(i+1, len(arr)):

if arr[min_idx] > arr[j]:

min_idx = j

arr[i], arr[min_idx] = arr[min_idx], arr[i]

# 示例

arr = [64, 25, 12, 22, 11]

selection_sort(arr)

print("Sorted array:", arr)

```

在上述 Python 代码中,`selection_sort` 函数实现了选择排序算法。在每次外层循环中,变量 `min_idx` 被设置为当前索引 `i`,然后内层循环遍历所有剩余元素以找到最小元素。如果找到了更小的元素,`min_idx` 将更新。最后,当前索引 `i` 的元素与找到的最小元素进行交换。

## 2.2 改进的选择排序策略

### 2.2.1 最小(大)值的快速查找

为了减少选择排序的比较次数,我们可以使用一些策略来快速确定最小(或最大)值的位置。一种方法是在每次选择最小值时,保持未排序部分的元素有序,这样可以减少后续循环的比较次数。

### 2.2.2 堆排序的引入和应用

堆排序是一种基于比较的排序算法,它使用了数据结构中的堆来提高排序效率。堆排序的时间复杂度为 O(n log n),在最坏的情况下也是如此。堆是一种特殊的完全二叉树,其中每个父节点的值都大于或等于其子节点的值(最大堆),或者小于等于子节点的值(最小堆)。

堆排序分为两个主要步骤:

1. 构建最大堆:通过一系列操作,从无序的输入数组中构建一个最大堆。

2. 排序过程:依次将堆顶元素(最大值)与堆的最后一个元素交换,并减少堆的大小,再重新调整堆。

```python

def heapify(arr, n, i):

largest = i

l = 2 * i + 1

r = 2 * i + 2

if l < n and arr[i] < arr[l]:

largest = l

if r < n and arr[largest] < arr[r]:

largest = r

if largest != i:

arr[i], arr[largest] = arr[largest], arr[i]

heapify(arr, n, largest)

def heap_sort(arr):

n = len(arr)

for i in range(n//2 - 1, -1, -1):

heapify(arr, n, i)

for i in range(n-1, 0, -1):

arr[i], arr[0] = arr[0], arr[i]

heapify(arr, i, 0)

# 示例

arr = [12, 11, 13, 5, 6, 7]

heap_sort(arr)

print("Sorted array:", arr)

```

在上述代码中,`heapify` 函数负责将一个子树调整为最大堆,而 `heap_sort` 函数首先将整个数组构建为一个最大堆,然后逐步取堆顶元素并重新调整堆,直到整个数组排序完成。通过这种方式,堆排序能够在最坏的情况下以 O(n log n) 的时间复杂度完成排序任务。

堆排序与选择排序相比,效率上有了明显提升,尤其是在处理大量数据时。堆排序通过巧妙地利用堆结构来减少不必要的比较次数,同时保

0

0