如何构建自己的注意力机制模型

发布时间: 2024-05-02 13:12:31 阅读量: 11 订阅数: 14

# 2.1 注意力机制的原理和类型

### 2.1.1 注意力的概念和定义

注意力机制是一种受人类认知过程启发的机器学习技术。它允许模型专注于输入数据的特定部分,从而提高模型的性能。注意力机制的原理是将输入数据中的每个元素赋予一个权重,该权重表示该元素对于输出结果的重要性。通过对输入数据中的元素进行加权求和,模型可以生成一个新的表示,其中重要的元素被放大,而不太重要的元素被抑制。

### 2.1.2 常见的注意力机制类型

有各种各样的注意力机制类型,每种类型都有其独特的优点和缺点。最常见的注意力机制类型包括:

- **加性注意力:**这是最简单的注意力机制类型,它通过将输入数据中的元素相加来计算注意力权重。

- **点积注意力:**这种注意力机制类型通过计算输入数据和查询向量之间的点积来计算注意力权重。

- **缩放点积注意力:**这是点积注意力的变体,它通过将点积除以一个缩放因子来计算注意力权重。

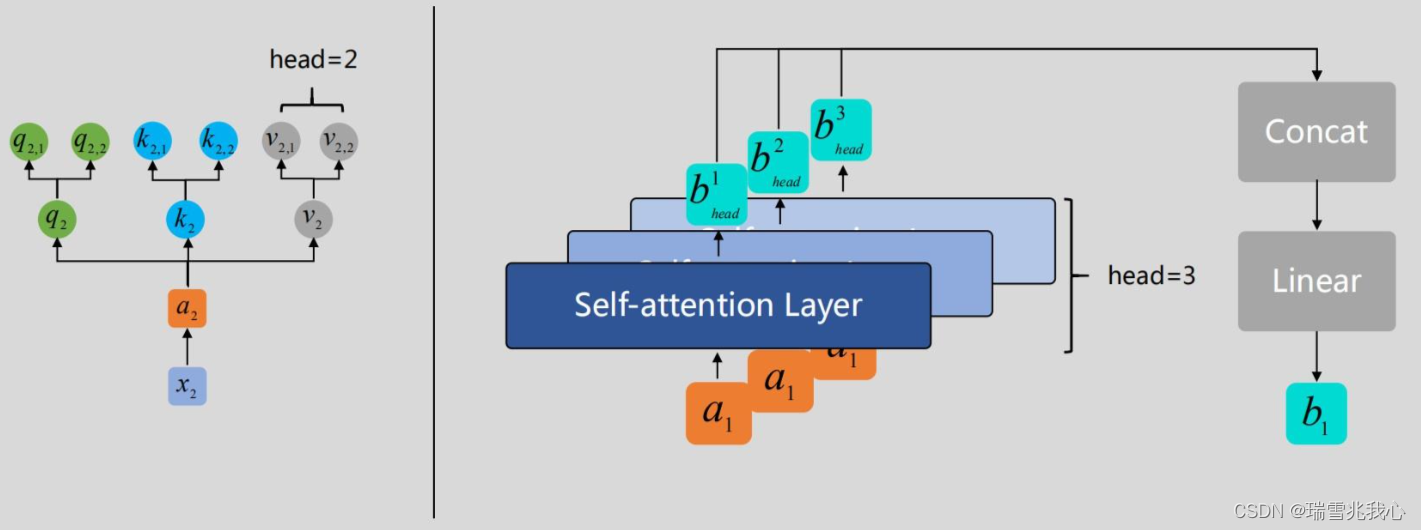

- **多头注意力:**这种注意力机制类型使用多个注意力头来并行计算注意力权重。

# 2. 注意力机制理论基础

### 2.1 注意力机制的原理和类型

#### 2.1.1 注意力的概念和定义

注意力机制是一种神经网络技术,它允许模型专注于输入数据中的相关部分。这种机制模拟了人类注意力系统,它可以有选择地关注特定信息,同时忽略不相关的信息。在深度学习中,注意力机制通过学习一个权重向量来实现,该权重向量表示输入元素的重要性。

#### 2.1.2 常见的注意力机制类型

有几种常见的注意力机制类型,包括:

- **加性注意力:**计算每个输入元素的权重,然后将它们相加以获得注意力权重。

- **点积注意力:**计算输入元素和查询向量之间的点积,以获得注意力权重。

- **缩放点积注意力:**与点积注意力类似,但将点积结果除以一个缩放因子以稳定梯度。

- **多头注意力:**使用多个注意力头并结合它们的输出,以捕获输入的不同方面。

### 2.2 注意力机制的数学模型

#### 2.2.1 注意力权重的计算

注意力权重通过以下公式计算:

```

α = softmax(f(Q, K))

```

其中:

- α 是注意力权重向量

- Q 是查询向量

- K 是键向量

- f 是注意力函数,如加性注意力或点积注意力

#### 2.2.2 注意力机制的训练和优化

注意力机制通常通过反向传播算法进行训练。损失函数衡量模型输出与真实标签之间的差异。通过反向传播,损失函数的梯度被计算出来,并用于更新注意力机制的参数。

优化注意力机制涉及调整以下超参数:

- **注意力头数:**多头注意力中使用的注意力头的数量。

- **注意力大小:**注意力权重向量的维度。

- **学习率:**用于更新注意力机制参数的学习率。

通过调整这些超参数,可以优化注意力机制的性能,以提高模型的准确性和泛化能力。

# 3.1 基于注意力的文本分类

#### 3.1.1 注意力机制在文本分类中的作用

注意力机制在文本分类中发挥着至关重要的作用,它能够帮助模型专注于文本中与分类相关的关键信息,从而提高分类的准确性。具体来说,注意力机制可以:

- **识别重要单词和短语:**注意力机制可以识别文本中对分类决策至关重要的单词和短语,并赋予它们更高的权重。这有助于模型忽略不相关的或冗余的信息,从而专注于最具信息性的内容。

- **捕捉文本结构:**注意力机制还可以捕捉文本的结构,例如句子之间的关系和段落之间的层次结构。通过对文本结构的建模,注意力机制能够更好地理解文本的整体含义,从而提高分类的准确性。

- **提高模型的可解释性:**注意力机制可以提供对模型决策的可解释性,因为它可以显示模型关注文本中哪些部分。这有助于研究人员和从业人员了解模型的推理过程,并识别模型可能存在偏差或错误的地方。

#### 3.1.2 注意力机制的模型结构和训练方法

基于注意力的文本分类模型通常采用编码器-解码器结构。编码器负责将文本表示为一个固定长度的向量,而解码器则使用注意力机制来预测文本的类别。

**编码器:**编码器通常使用卷积神经网络(CNN)或循环神经网络(RNN)来提取文本的特征。CNN可以捕捉局部特征,而RNN可以捕捉序列信息。

**解码器:**解码器使用注意力机制来计算每个单词或短语的注意力权重。这些权重用于加权编码器的输出,从而生成一个表示文本整体含义的上下文向量。然后,上下文向量被输入到一个分类器中,以预测文本的类别。

**训练方法:**基于注意力的文本分类模型通常使用交叉熵损失函数进行训练。该损失函数衡量了预测类别与真实类别的差异。通过最小化损失函数,模型可以学习优化注意力权重,从而提高分类的准确性。

**代码示例:**

```python

import torch

import torch.nn as nn

class AttentionTextClassifier(nn.Module):

def __init__(self, vocab_size, embedding_dim, hidden_dim, num_classes):

super(AttentionTextClassifier, self).__init__()

self.embedding = nn.Embedding(vocab_size, embedding_dim)

self.encoder = nn.LSTM(embedding_dim, hidden_dim, bidirectional=True)

self.attention = nn.Linear(2 * hidden_dim, 1)

self.decoder = nn.Linear(2 * hidden_dim, num_classes)

def forward(self, x):

x = self.embedding(x)

x, _ = self.encoder(x)

x = x.permute(1, 0, 2) # (seq_len, batch_size, 2 * hidden_dim)

attn_weights = self.attention(x).softmax(dim=0)

context_vector = torch.bmm(attn_weights, x).squeeze(0)

logits = self.decoder(context_vector)

return logits

```

**逻辑分析:**

该代码实现了基于注意力的文本分类模型。模型首先将文本嵌入到一个词向量空间中,然后使用LSTM编码器提取文本的特征。注意力层计算每个单词或短语的注意力权重,并将其用于加权编码器的输出。最后,解码器使用分类器预测文本的类别。

# 4. 注意力机制在计算机视觉中的应用

注意力机制在计算机视觉领域得到了广泛的应用,它可以帮助模型专注于图像或视频中与任务相关的重要区域。在这一章中,我们将探讨注意力机制在计算机视觉中的两种主要应用:图像分类和目标检测。

### 4.1 基于注意力的图像分类

#### 4.1.1 注意力机制在图像分类中的作用

在图像分类任务中,注意力机制可以帮助模型识别图像中对分类决策至关重要的区域。通过关注这些区域,模型可以更好地理解图像的内容并做出更准确的预测。

#### 4.1.2 注意力机制的模型结构和训练方法

基于注意力的图像分类模型通常采用以下结构:

- **特征提取层:**该层提取图像的特征,生成特征图。

- **注意力层:**该层计算特征图中每个位置的注意力权重,表示该位置的重要性。

- **加权特征图:**注意力权重与特征图相乘,生成加权特征图,突出显示重要区域。

- **分类层:**加权特征图用于预测图像的类别。

训练基于注意力的图像分类模型时,需要优化以下损失函数:

```

L = L_cls + λ * L_att

```

其中:

- `L_cls`:分类损失

- `L_att`:注意力损失(鼓励模型专注于重要区域)

- `λ`:超参数,平衡分类损失和注意力损失

### 4.2 基于注意力的目标检测

#### 4.2.1 注意力机制在目标检测中的应用

在目标检测任务中,注意力机制可以帮助模型定位和识别图像中的目标。通过关注目标区域,模型可以更准确地预测目标的边界框和类别。

#### 4.2.2 注意力机制的模型结构和训练方法

基于注意力的目标检测模型通常采用以下结构:

- **特征提取层:**该层提取图像的特征,生成特征图。

- **注意力层:**该层计算特征图中每个位置的注意力权重,表示该位置与目标相关性的概率。

- **加权特征图:**注意力权重与特征图相乘,生成加权特征图,突出显示目标区域。

- **目标检测层:**加权特征图用于预测目标的边界框和类别。

训练基于注意力的目标检测模型时,需要优化以下损失函数:

```

L = L_det + λ * L_att

```

其中:

- `L_det`:检测损失(边界框回归和类别预测)

- `L_att`:注意力损失(鼓励模型专注于目标区域)

- `λ`:超参数,平衡检测损失和注意力损失

### 4.3 讨论

注意力机制在计算机视觉中取得了显著的成功,它可以帮助模型专注于图像或视频中与任务相关的重要区域。通过关注这些区域,模型可以更好地理解图像或视频的内容并做出更准确的预测。

然而,注意力机制也面临着一些挑战,例如计算复杂度和可解释性。未来的研究将集中在解决这些挑战,并探索注意力机制在计算机视觉中的更多应用。

# 5. 注意力机制在语音识别中的应用

### 5.1 基于注意力的语音识别

#### 5.1.1 注意力机制在语音识别中的作用

注意力机制在语音识别中发挥着至关重要的作用,它可以帮助模型专注于输入语音序列中与识别任务最相关的部分。通过将注意力集中在特定的语音特征上,模型可以有效地提取语音中的有用信息,从而提高识别准确性。

#### 5.1.2 注意力机制的模型结构和训练方法

基于注意力的语音识别模型通常采用编码器-解码器架构。编码器负责将输入语音序列编码为一个固定长度的向量,而解码器则利用注意力机制对编码后的向量进行解码,生成语音识别结果。

注意力机制在语音识别模型中主要通过以下步骤实现:

1. **计算注意力权重:**模型根据编码后的向量和当前解码器状态计算注意力权重。注意力权重表示每个编码器输出对当前解码器状态的重要性。

2. **加权求和:**模型将注意力权重与编码后的向量相乘,然后求和,得到一个加权的上下文向量。

3. **解码:**解码器利用加权的上下文向量生成语音识别结果。

### 5.2 基于注意力的语音合成

#### 5.2.1 注意力机制在语音合成中的应用

注意力机制在语音合成中也得到了广泛应用。它可以帮助模型专注于文本序列中与合成语音最相关的部分,从而生成自然流畅的语音。

#### 5.2.2 注意力机制的模型结构和训练方法

基于注意力的语音合成模型通常采用序列到序列(Seq2Seq)架构。编码器负责将输入文本序列编码为一个固定长度的向量,而解码器则利用注意力机制对编码后的向量进行解码,生成语音波形。

注意力机制在语音合成模型中主要通过以下步骤实现:

1. **计算注意力权重:**模型根据编码后的向量和当前解码器状态计算注意力权重。注意力权重表示每个编码器输出对当前解码器状态的重要性。

2. **加权求和:**模型将注意力权重与编码后的向量相乘,然后求和,得到一个加权的上下文向量。

3. **解码:**解码器利用加权的上下文向量生成语音波形。

# 6. 注意力机制的未来发展

### 6.1 注意力机制的最新进展

#### 6.1.1 注意力机制的变体和改进

近年来,研究人员对注意力机制进行了大量的改进和变体,以提高其性能和适用性。一些常见的变体包括:

- **自注意力机制:**自注意力机制允许模型在输入序列中不同位置之间建立关系,而无需显式的对齐机制。

- **多头注意力机制:**多头注意力机制并行使用多个注意力头,每个头关注输入的不同子空间。

- **位置编码:**位置编码向注意力机制提供有关输入序列中元素相对位置的信息,这对于处理顺序数据非常重要。

- **可扩展注意力机制:**可扩展注意力机制通过使用近似技术来减少注意力计算的复杂度,使其能够处理大规模输入。

#### 6.1.2 注意力机制在其他领域的应用

注意力机制不仅在自然语言处理、计算机视觉和语音识别等领域取得了成功,而且还被应用于其他领域,例如:

- **推荐系统:**注意力机制可以帮助推荐系统根据用户的历史交互来个性化推荐。

- **时间序列预测:**注意力机制可以捕捉时间序列数据中的长期依赖关系,提高预测准确性。

- **知识图谱:**注意力机制可以帮助知识图谱模型学习实体和关系之间的重要性。

### 6.2 注意力机制的挑战和展望

#### 6.2.1 注意力机制的计算复杂度

注意力机制的计算复杂度是其主要挑战之一。自注意力机制和可扩展注意力机制等变体可以缓解这一问题,但对于大规模输入,计算成本仍然很高。

#### 6.2.2 注意力机制的可解释性

注意力机制的黑盒性质使其难以理解模型的决策过程。开发可解释的注意力机制对于提高模型的透明度和可信度至关重要。

0

0