如何针对不同任务选择合适的注意力机制

发布时间: 2024-05-02 13:31:27 阅读量: 11 订阅数: 13

# 2.1 注意力机制的原理和分类

### 2.1.1 注意力的概念和类型

注意力机制的本质是通过赋予不同输入元素不同的权重,从而突出重要信息并抑制无关信息。注意力机制的类型包括:

- **软注意力:**计算注意力权重并将其应用于输入,生成一个加权和。

- **硬注意力:**选择输入中最相关的元素,并将其权重设置为 1,其余为 0。

- **自注意力:**将输入元素与自身进行比较,生成注意力权重。

### 2.1.2 注意力机制的实现方式

注意力机制通常通过神经网络实现,常见的实现方式包括:

- **点积注意力:**计算输入元素与查询向量的点积,生成注意力权重。

- **缩放点积注意力:**在点积注意力基础上,对权重进行缩放,以增强区分度。

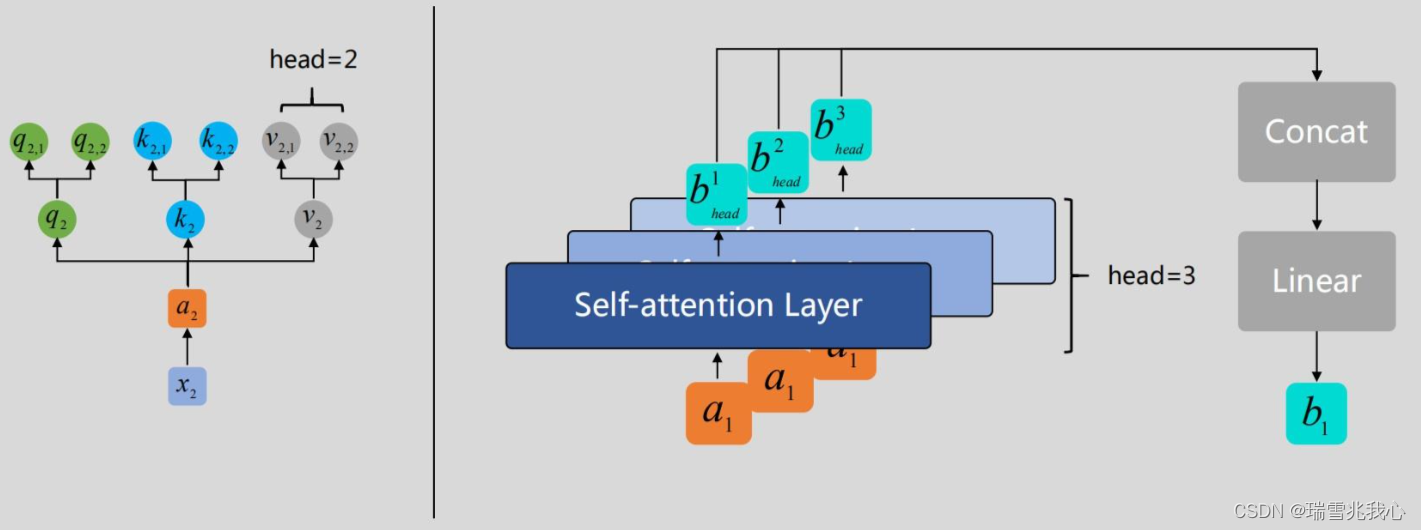

- **多头注意力:**使用多个注意力头并对结果进行拼接,提高注意力机制的鲁棒性。

# 2. 注意力机制的理论基础

### 2.1 注意力机制的原理和分类

#### 2.1.1 注意力的概念和类型

注意力机制是一种神经网络技术,它允许模型专注于输入数据中最重要的部分。它模拟了人类视觉系统中的注意力机制,该机制允许我们专注于场景中特定区域,同时忽略其他不相关的信息。

注意力机制有两种主要类型:

* **软注意力:**使用概率分布来表示输入数据中每个元素的重要性。

* **硬注意力:**选择输入数据中一个或多个元素进行关注。

#### 2.1.2 注意力机制的实现方式

注意力机制可以通过各种方式实现,包括:

* **加权求和:**将输入数据元素与注意力权重相乘,然后求和以获得加权平均。

* **点积:**计算输入数据元素和查询向量的点积,以获得注意力权重。

* **自注意力:**使用输入数据本身作为查询向量,以计算注意力权重。

### 2.2 注意力机制的数学基础

#### 2.2.1 注意力函数的定义和性质

注意力函数是一个数学函数,它将输入数据元素映射到注意力权重。它通常具有以下性质:

* **非负性:**注意力权重始终是非负的。

* **归一化:**注意力权重的总和为 1。

* **可微分:**注意力函数对于输入数据元素是可微分的。

#### 2.2.2 注意力权重的计算方法

注意力权重的计算方法取决于注意力机制的实现方式。对于加权求和,注意力权重是通过将输入数据元素与注意力权重相乘得到的。对于点积,注意力权重是通过计算输入数据元素和查询向量的点积得到的。对于自注意力,注意力权重是通过计算输入数据元素和自身之间的点积得到的。

**代码示例:**

```python

import torch

def scaled_dot_product_attention(query, key, value, mask=None, dropout=None):

"""

计算缩放点积注意力。

参数:

query: 查询向量。

key: 键向量。

value: 值向量。

mask: 可选的掩码,用于屏蔽输入数据中不需要的元素。

dropout: 可选的 dropout 层。

返回:

注意力权重和加权平均值。

"""

# 计算注意力权重

attention_weights = torch.matmul(query, key.transpose(-2, -1))

attention_weights = attention_weights / math.sqrt(query.size(-1))

if mask is not None:

attention_weights = attention_weights.masked_fill(mask == 0, -1e9)

# 归一化注意力权重

attention_weights = F.softmax(attention_weights, dim=-1)

# 应用 dropout

if dropout is not None:

attention_weights = dropout(attention_weights)

# 计算加权平均值

weighted_average = torch.matmul(attention_weights, value)

return attention_weights, weighted_average

```

**逻辑分析:**

此代码块实现了缩放点积注意力机制。它首先计算注意力权重,然后将其归一化并应用 dropout。最后,它使用注意力权重计算加权平均值。

**参数说明:**

* `query`:查询向量,形状为 `[batch_size, num_heads, query_len, d_k]`。

* `key`:键向量,形状为 `[batch_size, num_heads, key_len, d_k]`。

* `value`:值向量,形状为 `[batch_size, num_heads, value_len, d_v]`。

* `mask`:可选的掩码,形状为 `[batch_size, num_heads, query_len, key_len]`。

* `dropout`:可选的 dropout 层。

# 3.1 图像处理中的注意力机制

**3.1.1 目标检测和分割中的注意力机制**

在目标检测和分割任务中,注意力机制通过强调图像中与目标相关的区域,提高了模型的性能。

**目标检测:**

- **YOLOv3:** 使用空间注意力模块(SAM),将特征图中的不同空间位置分配不同的权重,突出目标区域。

- **Faster R-CNN:** 引入区域提议网络(RPN),使用注意力机制预测候选区域的置信度,提高了目标检测的精度。

**图像分割:**

- **U-Net:** 使用跳跃连接和注意力机制,将高层特征图中的语义信息与低层特征图中的空间信息相结合,提高了分割精度。

- **DeepLabV3+:** 采用空洞卷积和注意力机制,扩展感受野并增强特征表示,提高了图像分割的细粒度。

**代码示例:**

```python

import torch

import torch.nn as nn

```

0

0