细粒度注意力机制的设计与实现

发布时间: 2024-05-02 13:29:34 阅读量: 8 订阅数: 13

# 2.1 注意力机制的原理和类型

### 2.1.1 注意力机制的定义和作用

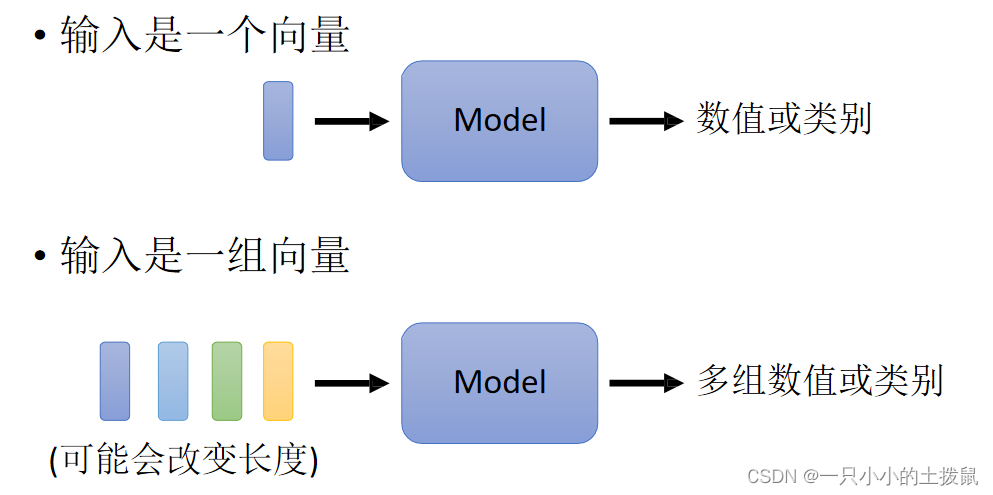

注意力机制是一种神经网络技术,它允许模型专注于输入数据中最重要的部分。它通过分配一个权重给输入的每个元素来实现这一点,该权重表示该元素对输出的重要性。然后,模型使用这些权重来加权输入,从而产生一个更具信息性和相关的输出。

### 2.1.2 常见的注意力机制类型

有几种不同的注意力机制,每种机制都有其独特的优势和劣势。最常见的类型包括:

- **全局注意力:**考虑输入序列中的所有元素,并为每个元素分配一个权重。

- **局部注意力:**只考虑输入序列中局部窗口内的元素,并为每个元素分配一个权重。

- **自注意力:**将输入序列视为查询,并使用查询来计算键和值序列之间的注意力权重。

# 2. 细粒度注意力机制理论基础

### 2.1 注意力机制的原理和类型

#### 2.1.1 注意力机制的定义和作用

注意力机制是一种神经网络技术,它允许模型专注于输入数据中最相关的部分。它模拟了人类视觉系统的行为,人类视觉系统能够有选择地关注场景中的特定区域。在神经网络中,注意力机制通过分配权重来实现,这些权重表示输入特征的重要性。

#### 2.1.2 常见的注意力机制类型

常见的注意力机制类型包括:

- **基于位置的注意力:**这种机制使用输入序列中元素的位置信息来计算权重。

- **基于内容的注意力:**这种机制使用输入元素的特征来计算权重。

- **基于查询的注意力:**这种机制使用外部查询向量来计算权重。

- **自注意力:**这种机制使用输入序列本身来计算权重,无需外部查询。

### 2.2 细粒度注意力机制的优势和特点

#### 2.2.1 细粒度注意力机制的定义和特点

细粒度注意力机制是一种注意力机制,它能够在输入数据中捕捉到细粒度的依赖关系。它通过将输入序列分解成更小的子序列或元素来实现。

#### 2.2.2 细粒度注意力机制的优势和应用场景

细粒度注意力机制具有以下优势:

- **捕捉细粒度依赖关系:**它能够识别输入数据中细微的模式和关联。

- **提升模型性能:**通过关注相关信息,它可以提高模型在各种任务上的性能,例如文本分类、机器翻译和目标检测。

- **可解释性:**它提供了对模型决策的可解释性,因为注意力权重揭示了模型关注的输入部分。

细粒度注意力机制广泛应用于自然语言处理、计算机视觉和语音识别等领域。

# 3. 细粒度注意力机制实现技术

### 3.1 细粒度注意力机制的实现方法

#### 3.1.1 基于卷积神经网络的实现

基于卷积神经网络(CNN)的细粒度注意力机制通过在CNN中加入注意力模块来实现。注意力模块通常由以下步骤组成:

1. **特征提取:**使用卷积层从输入数据中提取特征图。

2. **注意力计算:**使用卷积层或池化层计算特征图中每个元素的注意力权重。

3. **权重归一化:**将注意力权重归一化到[0, 1]的范围内,确保权重之和为1。

4. **加权求和:**将注意力权重与特征图中的元素相乘,然后求和得到加权特征图。

#### 3.1.2 基于循环神经网络的实现

基于循环神经网络(RNN)的细粒度注意力机制通过在RNN中加入注意力机制来实现。注意力机制通常由以下步骤组成:

1. **特征提取:**使用RNN从输入序列中提取特征向量。

2. **注意力计算:**使用一个神经网络层计算特征向量中每个元素的注意力权重。

3. **权重归一化:**将注意力权重归一化到[0, 1]的范围内,确保权重之和为1。

4. **加权求和:**将注意力权重与特征向量中的元素相乘,然后求和得到加权特征向量。

#### 3.1.3 基于自注意力机制的实现

自注意力机制是一种特殊的注意力机制,它不需要外部查询向量,而是直接从输入数据中计算注意力权重。自注意力机制通常由以下步骤组成:

1. **特征投影:**将输入数据投影到一个新的特征空间。

2. **注意力计算:**计算投影后的特征向量之间的相似度,得到注意力权重。

3. **权重归一化:**将注意力权重归一化到[0, 1]的范围内,确保权重之和为1。

4. **加权求和:**将注意力权重与投影后的特征向量相乘,然后求和得到加权特征向量。

### 3.2 细粒度注意力机制的优化策略

#### 3.2.1 注意力权重归一化

注意力权重归一化可以确保注意力权重之和为1,这可以防止模型过度关注某些元素而忽略其他元素。常用的归一化方法有softmax函数和L2归一化。

#### 3.2.2 注意力权重正则化

注意力权重正则化可以防止模型学习到过拟合的注意

0

0