深入理解贪心算法:数据结构视角下的优化策略

发布时间: 2024-09-10 05:58:31 阅读量: 143 订阅数: 48

# 1. 贪心算法基础介绍

## 1.1 算法概述

贪心算法,作为一种解决优化问题的策略,它在每一步选择中都采取在当前状态下最优的选择,希望以此来构造最优解。与动态规划不同的是,贪心算法不回溯,且不需要考虑问题的所有可能情况,它在处理某些类型的问题时,能够以较低的时间复杂度得到较好的解。

## 1.2 算法的适用性

贪心算法并不是对所有问题都适用。它适用于那些具有“贪心选择性质”的问题,即局部最优选择可以决定全局最优解的情况。在实际应用中,需要仔细分析问题是否适合采用贪心策略。

## 1.3 算法步骤简述

一般来说,贪心算法包含以下几个基本步骤:

1. 将问题分解为若干个子问题。

2. 找到适合的贪心策略。

3. 对每一子问题应用贪心策略,选取当前看起来最优的选择。

4. 将局部最优解组合成全局最优解。

理解贪心算法,接下来的章节将探讨其理论基础、应用实例以及优化策略,帮助读者更深入地掌握这一重要的算法思想。

# 2. 贪心算法的理论基础

### 2.1 算法思想和适用场景

在探讨贪心算法时,首先需要深入理解其核心思想,即在每一步选择中都采取在当前状态下最好或最优的选择,从而希望导致结果是全局最好或最优的算法。贪心算法适用于具有“贪心选择性质”的问题。

#### 2.1.1 理解贪心选择性质

贪心选择性质是贪心算法可行性的关键。如果一个问题的最优解可以通过一系列局部最优的选择(即贪心选择)来构建,那么该问题具有贪心选择性质。每一步的贪心选择都是在当前条件下做出的最好选择,并且这种选择依赖于之前的选择但不依赖于之后的选择。

举个简单的例子,假设我们需要解决找零钱问题,我们希望用最少的硬币组合找给顾客指定金额的零钱。如果我们每次都用当前最大的硬币面值去找零,最终将得到一个局部最优解,并且在某些情况下,这将是一个全局最优解。

#### 2.1.2 最优子结构性质的探讨

最优子结构性质是指一个问题的最优解包含其子问题的最优解。在贪心算法的背景下,这意味着我们可以通过局部最优的选择,自然而然地构造出整体问题的最优解。

以经典活动选择问题为例,我们需要选择一系列不会发生时间冲突的活动,使得参与活动的总数最多。通过按照活动结束时间的早迟进行排序,每次选择第一个结束时间最早的活动,贪心地选择下一个活动,并排除所有与已选择活动冲突的活动,这样就能得到最大数量的活动选择,这种选择方法就是基于最优子结构的。

### 2.2 贪心算法的数学原理

为了深入理解贪心算法,我们还需要了解其背后的数学原理,这包括数学模型的建立、问题的抽象以及解的可行性和最优性证明。

#### 2.2.1 数学模型和问题抽象

数学模型是将现实世界的问题转化为数学问题的过程。对于贪心算法而言,数学模型的构建可以将具体的问题抽象成更一般的形式,便于理解和分析。例如,在经典的哈夫曼编码问题中,通过构建一棵最优二叉树来最小化字符编码的加权平均长度,这就是将实际的编码问题转化为数学模型的过程。

#### 2.2.2 解的可行性与最优性证明

一个贪心算法是否有效,关键在于其解的可行性和最优性。即算法得到的结果是否是一个有效解,以及是否是最优解。对于可行性的证明,需要验证算法的每一步都是合法的,对于最优性的证明,则往往需要借助数学归纳法或者反证法来证明。

例如,在活动选择问题中,我们可以通过数学归纳法证明,按照结束时间贪心选择下一个活动的方法能够得到最优解。这是因为每一次贪心选择都不会遗失任何最优解的机会,且每次贪心选择都是基于已有的最优解进行的。

### 2.3 贪心策略的选择与分析

在贪心算法的设计和实现过程中,策略的选择至关重要。不同的问题需要不同的贪心策略,且这些策略都需要细致的分析和比较。

#### 2.3.1 常见贪心策略的比较

常见的贪心策略包括选择最大值、最小值、最近的、最远的等等。每种策略都有其适用的场景和限制。例如,在选择活动时,我们使用最早结束时间的贪心策略;而在找零钱问题中,我们使用最大面值的硬币。

#### 2.3.2 策略选取的理论指导

理论上,对贪心策略的选择有指导原则,比如贪心选择必须是安全的,也就是每次选择后,剩下的子问题必须有解。除此之外,如果一个问题的子结构是重叠的,即子问题之间有重复,那么贪心算法可能不适用。而如果子问题不重叠,贪心算法更有可能适用。

通过分析问题的性质,结合数学模型,我们可以设计出合适的贪心策略。例如在最小生成树问题中,克鲁斯卡尔算法(Kruskal's Algorithm)和普里姆算法(Prim's Algorithm)分别从边和顶点出发,应用不同的贪心策略,最终都得到相同的最优解。

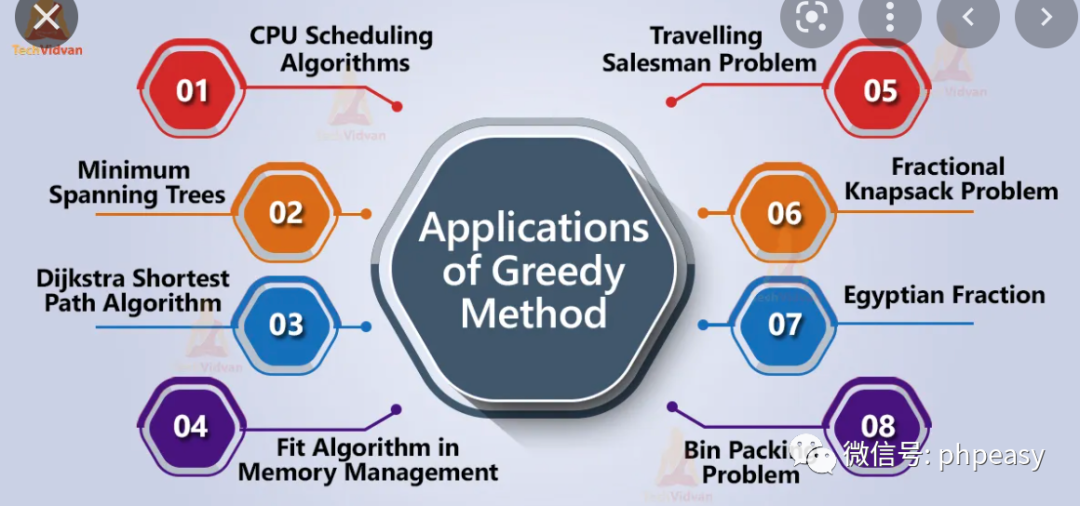

### 2.4 实际应用中的贪心算法

贪心算法在实际问题中有广泛的应用,例如在金融行业中的资产组合优化,或者在计算机网络中的数据传输路由选择等。这类问题通常可以抽象为某种优化问题,用贪心算法求解可以大大简化计算复杂度,同时往往能够得到非常好的近似解。

在应用贪心算法时,一个重要的步骤是定义好问题的“状态”和“转移”。状态指的是问题在某一步骤的具体情况,而转移是指从一个状态到另一个状态的变化。比如在活动选择问题中,“状态”可以是已经选择的活动集合,“转移”则是在加入一个新活动时发生的。

```mermaid

graph LR

A[初始状态] --> B[选择下一个活动]

B --> C[更新状态]

C -->|是否有更多活动| B

C -->|活动全部选择完毕| D[结束]

```

如上图所示,在应用贪心算法解决活动选择问题时,从初始状态开始,通过不断选择下一个活动,并更新当前的状态,直到所有活动选择完毕,整个过程形成了一个有向图,其中节点代表状态,边代表状态转移。

需要注意的是,贪心算法虽然能够快速得到解,但并不总是能得到全局最优解。因此,在使用贪心算法时,需要对问题进行仔细的分析和判断,以确保算法的适用性。

通过以上分析,我们可以看到,贪心算法的理论基础涵盖了算法思想、数学原理以及策略选择等多个方面。理解这些理论基础,对于在实际问题中正确应用贪心算法至关重要。

# 3. 贪心算法的经典问题与实践

## 3.1 排序和背包问题

### 3.1.1 常见排序算法的贪心策略

排序问题是一个基础且广泛应用于各种计算环境中的问题。贪心算法在解决排序问题时,通过每次选择一个局部最优解来达到全局最优解。例如,贪心选择性质在选择排序中表现得淋漓尽致:算法不断选择剩余元素中的最小值,将其放到排序序列的起始位置。

```python

def selection_sort(arr):

n = len(arr)

for i in range(n):

# Assume the min is the first element

min_index = i

for j in range(i+1, n):

# Update the min if the element at j is lower

if arr[j] < arr[min_index]:

min_index = j

# Swap the found minimum element with the first element

arr[i], arr[min_index] = arr[min_index], arr[i]

return arr

```

此代码实现了选择排序,其中包含贪心策略:每一轮都找到未排序部分的最小元素,并将其放到已排序部分的末尾。这是一个典型的贪心策略应用。

### 3.1.2 背包问题的贪心解法

背包问题要求在限定的总重量内,选择物品使得总价值最大。贪心算法在解决背包问题时通常会考虑物品的单位价值(价值/重量),选择单位价值最高的物品。以下是贪心算法解决0-1背包问题的示例代码:

```python

def knapsack_greedy(values, weights, capacity):

items = sorted(zip(values, weights), key=lambda x: x[0]/x[1], reverse=True)

total_value = 0

for value, weight in items:

if capacity - weight >= 0:

total_value += value

capacity -= weight

else:

fraction = capacity / weight

total_value += value * fraction

break

return total_value

values = [60, 100, 120]

weights = [10, 20, 30]

capacity = 50

print(knapsack_greedy(values, weights, capacity))

```

以上代码中,我们首先对物品按照单位价值从大到小排序,然后遍历排序后的列表,尽可能地填充背包,直至无法再加入任何物品为止。

## 3.2 最短路径和最小生成树问题

### 3.2.1 最短路径问题的贪心解决方案

在最短路径问题中,Dijkstra算法是贪心算法的一个典型应用。算法从起点开始,逐步增加最短路径树,选择距离当前点最近的未被访问的点进行松弛操作。下面是Dijkstra算法实现的伪代码:

```

Dijkstra(G, w, s)

for each vertex v in G.V

dist[v] ← ∞

π[v] ← UNDEFINED

D[v] ← FALSE

dist[s] ← 0

Q ← G.V

while Q ≠ EMPTY

u ← EXTRACT-MIN(Q)

D[u] ← TRUE

for each vertex v such that u ∈ G.Adj[u]

if dist[u] + w(u, v) < dist[v]

dist[v] ← dist[u] + w(u, v)

π[v] ← u

return (π, dist)

```

### 3.2.2 最小生成树的贪心构建方法

Kruskal算法和Prim算法都是贪心算法在构建最小生成树问题中的应用。它们分别从边和顶点开始构建,目标是使得新加入的边或顶点所形成的环路的总权值最小。以下是Kruskal算法的实现代码:

```python

class Edge:

def __init__(self, src, dest, weight):

self.src = src

self.dest = dest

self.weight = weight

class Graph:

def __init__(self, vertices):

self.V = vertices

self.edges = []

def add_edge(self, u, v, w):

self.edges.append(Edge(u, v, w))

def find(parent, i):

if parent[i] == i:

return i

return find(parent, parent[i])

def union(parent, rank, x, y):

xroot = find(parent, x)

yroot = find(parent, y)

if rank[xroot] < rank[yroot]:

parent[xroot] = yroot

elif rank[xroot] > rank[yroot]:

parent[yroot] = xroot

else:

parent[yroot] = xroot

rank[xroot] += 1

def kruskal_mst(graph):

result = []

i = 0

e = 0

graph.edges = sorted(graph.edges, key=lambda item: item.weight)

parent = []

rank = []

for node in range(graph.V):

parent.append(node)

rank.append(0)

while e < graph.V - 1:

edge = graph.edges[i]

i += 1

u = find(parent, edge.src)

v = find(parent, edge.dest)

if u != v:

e += 1

result.append(edge)

union(parent, rank, u, v)

return result

```

以上代码实现了Kruskal算法,逐步选择最小权重的边,同时避免形成环,直到生成树中的边数量等于顶点数减一为止。

## 3.3 贪心算法在数据结构中的应用

### 3.3.1 数据结构的选择和优化

贪心算法的选择和优化往往依赖于恰当的数据结构。例如,优先队列(如堆)是实现贪心策略中常用的数据结构,因为它能够快速从元素集合中选出最小(或最大)元素。在某些场合,哈希表或线段树也可以高效支持贪心算法的实现。下面是一个使用最小堆实现的Dijkstra算法代码段:

```python

import heapq

def dijkstra(graph, start):

distances = {vertex: float('infinity') for vertex in graph}

distances[start] = 0

priority_queue = [(0, start)]

while priority_queue:

current_distance, current_vertex = heapq.heappop(priority_queue)

if current_distance > distances[current_vertex]:

continue

for neighbor, weight in graph[current_vertex].items():

distance = current_distance + weight

if distance < distances[neighbor]:

distances[neighbor] = distance

heapq.heappush(priority_queue, (distance, neighbor))

return distances

```

### 3.3.2 实际问题中的数据结构应用实例

考虑实际问题,例如出租车调度系统需要快速响应最近的乘客请求,可以用最小堆来维护每个司机与乘客的距离,快速选出最近的司机。或者在网络路由问题中,每个节点都维护着到达其他所有节点的距离信息,可以使用Dijkstra算法和优先队列来找出最短路径。具体应用取决于问题场景和数据结构的特性。

```python

# 假设有一个出租车司机的列表,每个司机位置和与乘客的距离:

taxi_drivers = {'taxi1': 3, 'taxi2': 7, 'taxi3': 5}

# 最近司机查找函数:

def find_nearest_taxi(taxi_drivers, passenger_location):

min_distance = min(taxi_drivers.values())

nearest_taxi = [taxi for taxi, distance in taxi_drivers.items() if distance == min_distance]

return nearest_taxi, min_distance

# 执行查找:

nearest_taxi, distance = find_nearest_taxi(taxi_drivers, 'passenger1')

print(f"Nearest taxi: {nearest_taxi}, Distance: {distance}")

```

通过本章节的介绍,读者应能够理解贪心算法在经典问题中的应用,并通过实践案例加深理解。这些经典问题和实际数据结构的应用为深入研究贪心算法提供了坚实的基础。

# 4. 贪心算法的优化策略

## 4.1 算法优化的理论依据

### 4.1.1 算法时间复杂度的分析与优化

在设计贪心算法时,考虑时间复杂度是非常重要的环节。贪心算法的目标是找到问题的局部最优解,而不像动态规划那样考虑全局最优。因此,优化算法通常集中在减少不必要的计算和优化决策过程。

以硬币找零问题为例,如果硬币面值是无序的,直接进行遍历排序,会带来较高的时间复杂度。通过先对硬币面值进行排序,可以减少寻找局部最优解时的迭代次数,降低时间复杂度。

假设硬币面值集合为 `{1, 5, 10, 25}`,找零值为 `n`。对于未排序的集合,最坏情况下的时间复杂度为 `O(n)`,因为需要遍历所有硬币。而预先排序后的集合,时间复杂度可降低至 `O(log n)`。

```python

# 对硬币进行排序

coins.sort(reverse=True)

def coin_change(coins, amount):

# 初始化结果数组,表示找零方案

result = []

# 从最大面值开始尝试

for coin in coins:

while amount >= coin:

amount -= coin

result.append(coin)

return result

```

上述代码中,`coins.sort(reverse=True)` 实现了对硬币面值的降序排序,这样在执行贪心策略时可以更快地找到局部最优解。

### 4.1.2 空间复杂度与资源利用

空间复杂度是算法执行过程中占用存储空间的度量。优化贪心算法的空间复杂度通常涉及减少辅助数据结构的使用或优化数据存储方式。在某些情况下,贪心算法可以在不使用额外空间的情况下进行,如简单的活动选择问题。

然而,在一些复杂问题中,可能需要使用数据结构来辅助决策。例如,在最小生成树问题中,使用邻接矩阵或邻接表来表示图是常见的。但为了减少空间复杂度,可以选择邻接表来代替邻接矩阵。

## 4.2 优化策略的实践应用

### 4.2.1 贪心算法与其他算法的结合

贪心算法可以与其他算法如回溯法、动态规划等结合,以解决更加复杂的问题。例如,贪心算法可以用于快速找到问题的一个可能解,然后使用回溯法来验证这个解是否是最优的。

在实际应用中,一个常见的模式是将贪心算法作为启发式方法来引导搜索过程,例如在求解旅行商问题(TSP)时,首先使用贪心策略得到一个路径,然后逐步优化这个路径直到无法改进为止。

### 4.2.2 实际案例的优化过程解析

考虑一个简化版的资源分配问题,目标是在有限资源的情况下完成尽可能多的任务。我们可以先将任务按照单位资源获得的效益进行排序,然后逐一分配资源,直到资源耗尽。

```python

# 任务类

class Task:

def __init__(self, profit, resource):

self.profit = profit

self.resource = resource

# 贪心算法选择任务

def select_tasks(tasks, total_resource):

# 按照单位资源获得的效益进行排序

tasks.sort(key=lambda x: x.profit/x.resource, reverse=True)

total_profit = 0

selected_tasks = []

for task in tasks:

if total_resource >= task.resource:

total_resource -= task.resource

total_profit += task.profit

selected_tasks.append(task)

else:

break

return total_profit, selected_tasks

# 示例任务列表

tasks = [Task(20, 3), Task(10, 1), Task(5, 2)]

# 假设总资源为 10

total_resource = 10

total_profit, selected_tasks = select_tasks(tasks, total_resource)

```

该代码段通过贪心算法选择任务,在保证不超过总资源的前提下,尽可能提高总收益。

## 4.3 避免贪心算法的局部最优陷阱

### 4.3.1 局部最优与全局最优的辨析

贪心算法由于其决策的局部性,有时不能保证得到全局最优解。辨析局部最优与全局最优是避免这一陷阱的关键。局部最优是指在当前选择中无法得到比这更好的结果,而全局最优是指在整个问题中得到的最好结果。

为了辨析局部最优和全局最优,我们可以采取模拟决策过程的方法,即构建一个模拟决策树,评估所有可能的路径。尽管这样做会增加计算复杂度,但它有助于我们更好地理解问题的结构。

### 4.3.2 避免局部最优的策略和技巧

在实际应用贪心算法时,可以通过以下策略和技巧来避免局部最优问题:

- **问题分解**:将大问题分解为若干子问题,然后对每个子问题应用贪心算法。

- **预处理**:在应用贪心算法之前,对输入数据进行预处理以去除冗余。

- **后处理**:贪心算法得到局部最优解后,通过后处理步骤尝试改进这个解。

- **比较不同贪心策略**:对同一个问题应用不同的贪心策略,然后比较结果。

例如,在任务调度问题中,可能需要结合回溯算法来评估贪心选择后是否还存在更优解。此外,有时候需要牺牲局部最优以追求全局最优,这在旅行商问题(TSP)中尤为明显,单纯使用贪心算法很难得到最优解,而需要使用动态规划或回溯法等其他算法来辅助求解。

通过上述策略,我们可以有效地提高贪心算法的解质量,避免陷入局部最优。在编写代码时,应该留意算法设计的细节,确保能够应对各种情况,从而得到更加可靠的解决方案。

# 5. 贪心算法的进阶主题

在之前章节中,我们已经探讨了贪心算法的基础理论、经典问题和优化策略。本章节将把我们的视野扩展到更广阔的领域,研究贪心算法与其他先进算法的融合,分析其在大数据背景下的应用,并展望贪心算法未来的发展方向。

## 5.1 贪心算法与其他先进算法的融合

贪心算法以其简洁高效的特性,在很多问题中给出了优秀的解决方案。然而,在某些复杂问题上,贪心算法可能无法独立解决。此时,与其他先进算法的结合就显得尤为重要。

### 5.1.1 动态规划与贪心算法的交互

动态规划是解决多阶段决策问题的强大工具,它通过存储中间状态来避免重复计算,从而达到高效解决问题的目的。贪心算法和动态规划在某些问题上可以互补,例如在解决多阶段决策问题时,动态规划可以提供一个全局最优的解决方案,而贪心算法则可以提供一个近似最优的解决方案。

**代码示例(伪代码)**:

```python

# 动态规划解决经典问题 - 0-1背包问题

def knapsack_dp(values, weights, capacity):

dp = [[0 for _ in range(capacity + 1)] for _ in range(len(values) + 1)]

for i in range(1, len(values) + 1):

for w in range(1, capacity + 1):

if weights[i-1] <= w:

dp[i][w] = max(dp[i-1][w], values[i-1] + dp[i-1][w-weights[i-1]])

else:

dp[i][w] = dp[i-1][w]

return dp[len(values)][capacity]

# 贪心算法解决经典问题 - 分数背包问题

def knapsack_greedy(values, weights, capacity):

ratio = [(values[i]/weights[i], weights[i]) for i in range(len(values))]

ratio.sort(reverse=True)

total_value = 0

total_weight = 0

for val, w in ratio:

if total_weight + w <= capacity:

total_value += val

total_weight += w

else:

break

return total_value

```

**参数说明**:

- `values`:物品的价值列表。

- `weights`:物品的重量列表。

- `capacity`:背包的容量。

**逻辑分析**:

在上述代码中,我们使用动态规划和贪心算法分别解决了背包问题。动态规划方法计算了所有可能的组合,并存储中间结果以避免重复计算。贪心方法则是按价值/重量比例从高到低选取物品。

### 5.1.2 分支限界法与贪心的选择

分支限界法是一种系统化的搜索方法,用于解决整数规划问题。贪心算法可以作为分支限界法中的一个启发式方法,用于在搜索树的构建过程中快速剪枝。

**表格展示**:

| 算法类型 | 原理 | 优点 | 缺点 |

|-------|-----|----|----|

| 动态规划 | 存储中间结果,优化决策过程 | 可以得到最优解 | 时间和空间复杂度高 |

| 贪心算法 | 选择当前最优解 | 时间复杂度低 | 可能无法得到最优解 |

| 分支限界法 | 系统化搜索,优化搜索树的构建 | 可以得到最优解 | 搜索空间大,效率较低 |

在实际应用中,选择合适的算法或算法组合,需要根据问题的特性和实际需求来定。例如,当问题规模较大且对解的质量要求不是非常高时,可以优先考虑贪心算法。

## 5.2 贪心算法在大数据背景下的应用

随着大数据时代的到来,数据的规模和复杂性不断提升。贪心算法因其低时间复杂度的特点,在大数据问题中也有着广泛的应用。

### 5.2.1 大数据处理中的贪心策略

在处理大数据集时,贪心算法可以快速地给出近似解或解的启发式方法,从而帮助我们应对数据量巨大的问题。

**mermaid流程图示例**:

```mermaid

graph TD

A[开始处理大数据集] --> B{是否需要快速解}

B -- 是 --> C[使用贪心算法]

B -- 否 --> D[选择其他算法]

C --> E[快速得出近似解]

D --> F[得出精确解或更优解]

E --> G[应用于实际业务]

F --> G

```

在上述流程图中,根据是否需要快速解,我们选择了使用贪心算法或其它算法来处理大数据集。快速得到近似解之后,可以将其应用于实际业务。

### 5.2.2 分布式系统中的贪心算法应用

在分布式系统中,由于节点之间的通信成本较高,贪心算法的独立性和高效性就显得尤为重要。贪心算法可以在不需要全局通信的情况下,独立完成局部任务,极大地减少通信开销。

## 5.3 贪心算法的未来发展方向

随着技术的进步和理论的创新,贪心算法也在不断地发展和演进,呈现出许多新的研究方向和应用场景。

### 5.3.1 贪心算法的理论创新

未来对贪心算法的研究可能会集中在提高解的质量和探索算法的适用范围上。例如,研究者们可能会尝试设计出新的贪心策略,使得贪心算法在更多问题上能够得到更好的近似解。

### 5.3.2 新兴应用场景的探索

随着人工智能和机器学习技术的发展,贪心算法在这些领域也有着潜在的应用前景。例如,在机器学习中,贪心算法可以用于特征选择和模型优化等环节。

贪心算法的进阶主题不仅限于本章的探讨,随着技术的发展,更多的融合策略和应用场景将会被不断发现和应用。IT从业者的任务是紧密关注这些前沿动态,并积极探索将其应用于实际问题的解决方法。

# 6. 案例研究与实操演练

## 6.1 经典问题的代码实现和分析

贪心算法作为一种高效的问题解决策略,其最直观的应用即在经典问题上的代码实现与分析。本小节将通过贪心算法的著名案例 - 分数背包问题,来展示贪心算法的实现过程和结果分析。

### 6.1.1 问题描述与算法设计

分数背包问题相较于传统的0-1背包问题,允许物品被分割。其问题描述如下:

- 给定一组物品,每个物品具有自己的价值和重量。

- 分数背包可以装载不超过其容量的物品。

- 目标是使得背包中物品的价值总和最大。

对于此问题,贪心算法的设计思路是,按照物品的单位价值(价值/重量)从高到低的顺序,依次选择物品放入背包,直至背包装满。

### 6.1.2 代码编写与调试技巧

以下是使用Python语言实现的分数背包问题的贪心算法代码:

```python

def fractional_knapsack(value_weight_pairs, capacity):

# 按价值/重量的比率从高到低排序物品

value_weight_pairs.sort(key=lambda x: x[2], reverse=True)

total_value = 0 # 总价值

for value, weight, ratio in value_weight_pairs:

if capacity - weight >= 0:

# 背包还有空间,可装入当前物品的全部重量

capacity -= weight

total_value += value

else:

# 背包空间不足以装入整个物品

fraction = capacity / weight

total_value += value * fraction

break

return total_value

# 示例数据

value_weight_pairs = [(60, 10, 6), (100, 20, 5), (120, 30, 4)]

capacity = 50

print(fractional_knapsack(value_weight_pairs, capacity))

```

**代码执行逻辑说明:**

1. 首先对物品按价值/重量比率降序排序。

2. 遍历排序后的物品,如果背包容量足够,则将整个物品放入背包,并更新背包容量和总价值。

3. 如果背包空间不足以装入整个物品,则计算能装入的部分,并更新总价值,随后退出循环。

**调试技巧:**

- 在编写代码时,确保理解每一行代码的作用,并对关键变量进行打印以观察其变化。

- 在调试时,可以设置断点或逐步执行来检查每一步的执行逻辑。

- 对于复杂数据结构(如列表、字典等),应编写辅助函数来验证其正确性。

## 6.2 实际问题的贪心算法解决方案

贪心算法在实际问题中,如资源分配、任务调度等场景中有着广泛的应用。本小节我们将通过一个实际案例,探讨如何将贪心算法应用于解决实际问题。

### 6.2.1 现实世界问题的建模

假设有一个公司需要安排员工进行加班以完成紧急项目。项目期限有限,需要合理分配每个员工的加班时间以最大化完成的工作量。

我们可以将此问题建模为:每个员工有自己的工作效率(单位时间内完成的工作量),加班时间的限制以及加班的收益系数。我们需要最大化所有员工在期限内完成的工作量。

### 6.2.2 解决方案的详细实现

通过贪心策略,我们可以按照员工的效率与收益系数的乘积从大到小的顺序来分配加班时间。

以下是一个简化的代码示例:

```python

def schedule_overtime(employees, deadline, benefit_factor):

# 按效率*收益系数排序员工

employees.sort(key=lambda e: e['efficiency'] * e['benefit_factor'], reverse=True)

remaining_time = deadline

total_work = 0

for employee in employees:

if remaining_time <= 0:

break

# 计算可以分配的加班时间

overtime_hours = min(employee['max_overtime'], remaining_time)

total_work += employee['efficiency'] * overtime_hours * benefit_factor

remaining_time -= overtime_hours

return total_work

# 示例数据

employees = [

{'efficiency': 2, 'max_overtime': 10, 'benefit_factor': 1},

{'efficiency': 3, 'max_overtime': 8, 'benefit_factor': 1.5},

{'efficiency': 1, 'max_overtime': 5, 'benefit_factor': 2}

]

deadline = 15

benefit_factor = 10

print(schedule_overtime(employees, deadline, benefit_factor))

```

在本例中,我们首先根据效率与收益系数的乘积对员工进行排序。然后在不超过截止日期的前提下,按排序后的顺序为每个员工分配加班时间。

## 6.3 贪心算法的性能评估与优化

贪心算法虽然在某些问题上能够提供有效且高效的解法,但其性能往往受到问题特性的影响。本小节将对贪心算法的性能进行评估,并提出相应的优化策略。

### 6.3.1 性能指标和测试方法

性能评估通常涉及以下几个指标:

- 时间复杂度:算法执行所需时间。

- 空间复杂度:算法占用的空间。

- 近似比:贪心解与最优解之间的比值。

为了测试这些性能指标,可以执行以下步骤:

1. 构造或使用标准测试数据集。

2. 记录算法执行时间、空间消耗以及求解过程。

3. 与已知最优解比较,计算近似比。

### 6.3.2 针对性优化策略的提出与实施

对于贪心算法可能存在的性能瓶颈,针对性的优化策略可能包括:

- **启发式优化:** 引入启发式方法调整贪心选择,以期望获得更好的局部最优解。

- **并行处理:** 在某些可以并行处理的贪心选择中,通过并行计算提高效率。

- **动态调整:** 根据问题的动态特性,适时调整贪心策略,如实时更新价值-重量比率。

优化策略需要根据具体问题特性量身定制,并通过实验验证其有效性和可行性。在本节中,我们仅仅概述了性能评估和优化策略,针对特定问题的优化细节将在后续章节中进一步展开讨论。

0

0