贪心算法原理与数据结构:构建最优解的逻辑

发布时间: 2024-09-10 06:08:49 阅读量: 148 订阅数: 42

# 1. 贪心算法的基本概念和应用

## 1.1 算法简介

贪心算法是计算机科学中解决优化问题的一种方法,它通过在每一步选择中都采取在当前状态下最好或最优的选择,以期望通过局部最优选择来达到全局最优解。由于其在解决问题时的高效性,贪心算法在众多领域内得到了广泛应用,尤其是在资源优化和调度中。

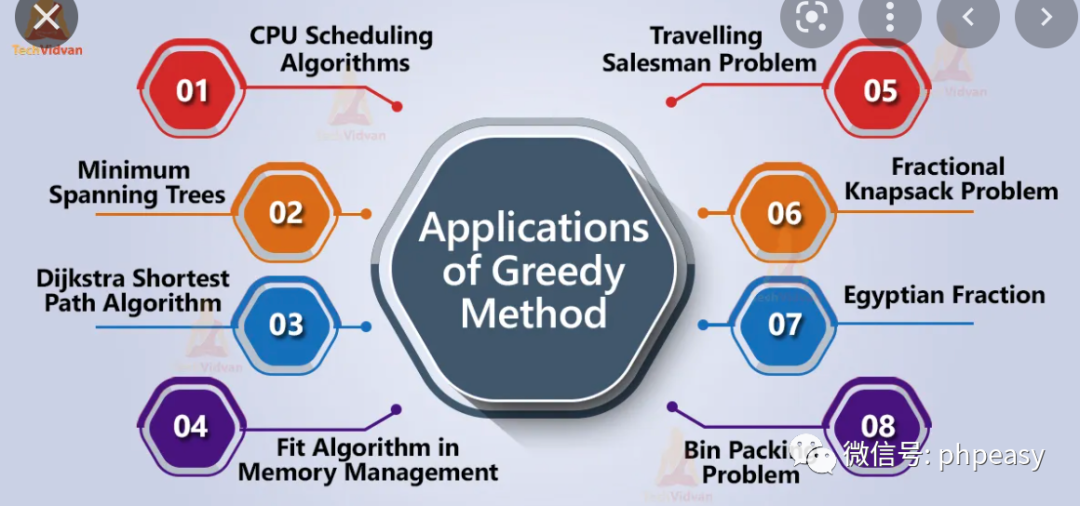

## 1.2 应用领域

贪心算法广泛应用于各种领域,比如网络设计、资源分配、调度问题等。它在处理具有“贪心选择性质”的问题时尤为有效,这类问题可以保证局部最优解能导向全局最优解。在实际应用中,贪心算法的实现相对简单快捷,且易于理解。

## 1.3 实际应用示例

一个典型的贪心算法应用是找零问题,例如使用最少的硬币凑成一定金额的找零。问题的关键在于,每次尽可能使用面值最大的硬币,然后重复此过程,直到凑足总额。这个过程就是贪心策略的一个直观体现。在实际编程中,贪心算法的实现需要结合具体问题来设计选择策略,并通过代码进行实现和验证。

# 2. 贪心算法的理论基础

### 2.1 贪心算法的定义和特性

#### 2.1.1 算法的定义

贪心算法(Greedy Algorithm),是一种在每一步选择中都采取在当前状态下最好或最优(即最有利)的选择,从而希望导致结果是全局最好或最优的算法。

这种算法不一定能得到全局最优解,因为它通常没有回溯功能。贪心算法适用于具有“最优子结构”特性的动态规划问题,即通过局部最优解可以产生全局最优解的问题。

#### 2.1.2 算法的基本特性

贪心算法的基本特性包括:

- **无后效性**:某个状态以后的过程不会影响以前的状态,只与当前状态有关。

- **贪心选择性质**:可以通过局部最优的选择,来产生全局最优解。

- **最优子结构**:问题的最优解包含其子问题的最优解。

贪心算法的策略是不断地寻找局部最优解,也就是说,它会根据局部最优解构建全局最优解。然而,贪心算法不保证能获得最优解,通常得到的是一个近似最优解,但在很多问题中,贪心算法确实是解决这些问题的最优策略。

### 2.2 贪心算法的适用条件和局限性

#### 2.2.1 算法的适用条件

贪心算法适用的情况通常包括:

- 问题具有贪心选择性质。

- 通过局部最优可以确定全局最优。

- 问题可以拆分成子问题,且子问题之间相互独立。

#### 2.2.2 算法的局限性

贪心算法也有其局限性,包括:

- 在某些问题中,贪心算法可能无法获得最优解。

- 算法的适用性依赖于问题本身的特性,不一定具有普适性。

- 对问题的理解需足够深入,才能确定是否可以用贪心算法求解。

### 2.3 贪心算法的数学原理

#### 2.3.1 数学模型

贪心算法的数学模型通常需要定义问题的目标函数和约束条件。目标函数是算法优化的目标,约束条件描述了问题的限制因素。

数学上,可以将贪心算法问题表示为一个优化问题,形式如下:

\begin{align}

& \text{maximize (或 minimize)} \quad f(x) \\

& \text{subject to} \quad g(x) \leq c

\end{align}

其中,`f(x)` 为目标函数,`g(x) ≤ c` 为约束条件集合。

#### 2.3.2 算法的证明方法

贪心算法的证明方法通常包括:

- **反证法**:假设贪心选择不是最优解,导出矛盾。

- **数学归纳法**:通过归纳证明贪心策略对所有子问题都有效。

- **构造性证明**:通过构造一个与贪心策略等价的最优解,从而证明贪心选择的正确性。

贪心算法的正确性证明是其设计过程中的重要环节,只有正确证明了算法的正确性,才能确保算法的可靠性。

贪心算法的理论基础是深入理解该算法的关键,通过定义、特性、适用条件、局限性以及数学原理的学习,可以更好地把握贪心算法的适用场景,以及在应用过程中需要考虑的因素。

# 3. 贪心算法的实践应用

在深入了解了贪心算法的理论基础之后,我们将聚焦于其实践应用。本章节将展示贪心算法在解决经典问题时的精彩表现,并分析其问题建模过程和实现细节。此外,我们还将探讨贪心算法的性能和优化策略,确保能够更好地将其应用于实际问题中。

## 3.1 贪心算法的经典问题分析

贪心算法在解决某些类型的问题时,其简洁有效常常让人眼前一亮。我们将讨论两个经典的贪心算法问题:背包问题和最小生成树问题,通过这两个问题的分析,理解贪心算法如何运作。

### 3.1.1 背包问题

背包问题是最为著名的贪心算法问题之一。它涉及到一个背包和若干物品,每个物品有其重量和价值,目标是在不超过背包承重的前提下,选取物品使得背包中的总价值最大。

在贪心算法的视角下,解决背包问题通常采用以下步骤:

1. **问题建模**:定义物品集合和背包的承重限制。确定每个物品的价值和重量,以及背包的最大承重。

2. **贪心策略**:按照物品的单位价值(价值与重量的比值)降序排列物品。

3. **遍历选择**:遍历物品集合,依次选择单位价值最高的物品放入背包,直至无法再加入更多物品为止。

4. **结果输出**:输出放入背包的物品集合及其价值。

```python

# Python代码示例,解决分数背包问题

def knapsack(values, weights, W):

n = len(values)

# 将物品按照单位价值降序排列

items = sorted(range(n), key=lambda i: values[i] / weights[i], reverse=True)

total_value = 0

k = 0 # 已选择物品的索引

# 遍历排序后的物品

while k < n and W > 0:

if weights[items[k]] <= W:

# 如果物品可以完全装入背包,就把它装进去

W -= weights[items[k]]

total_value += values[items[k]]

else:

# 如果物品不能完全装入背包,只装入能装的部分

fraction = W / weights[items[k]]

total_value += fraction * values[items[k]]

break

k += 1

return total_value

```

在这个示例中,`values` 和 `weights` 是对应物品价值和重量的数组,`W` 是背包的最大承重。代码首先对物品按照单位价值进行排序,然后进行选择过程,尽可能地选择价值最高的物品,直到背包容量不够为止。

### 3.1.2 最小生成树问题

最小生成树是图论中一个非常经典的问题,目标是找出图中连接所有顶点且边的总权重最小的无环连通子图。

贪心算法在此问题的应用是通过选择最小的边来构建生成树,直到所有顶点都被连接。在 Kruskal 算法中,这可以通过以下步骤实现:

1. **排序边**:将所有边按照权重从小到大排序。

2. **构建森林**:初始化一个森林,森林中的每个顶点自身为一个单独的树。

3. **选择最小边**:遍历排序后的边列表,对于每一条边,如果它连接的两个顶点位于同一棵树中,则跳过;否则,将这条边加入生成树中。

4. **输出结果**:当所有的顶点都在同一棵树中时,算法结束,输出生成的最小生成树。

```python

# Python代码示例,使用Kruskal算法解决最小生成树问题

class DisjointSet:

# 实现不相交集数据结构

def __init__(self, vertices):

self.parent = {v: v for v in vertices}

self.rank = {v: 0 for v in vertices}

def find(self, item):

# 查找元素所在的根节点

if self.parent[item] != item:

self.parent[item] = self.find(self.parent[item])

return self.parent[item]

def union(self, root1, root2):

# 合并两个集合

if self.rank[root1] > self.rank[root2]:

self.parent[root2] = root1

else:

self.parent[root1] = root2

if self.rank[root1] == self.rank[root2]:

self.rank[root2] += 1

def kruskal(graph):

# graph 是 (vertices, edges) 形式

vertices, edges = graph

mst = [] # 最小生成树

ds = DisjointSet(vertices)

edges.sort(key=lambda e: e[2])

for edge in edges:

root1 = ds.find(edge[0])

root2 = ds.find(edge[1])

if root1 != root2:

ds.union(root1, root2)

mst.append(edge)

if len(mst) == len(vertices) - 1:

break

return mst

# 示例图的顶点和边

vertices = ['A', 'B', 'C', 'D', 'E']

edges = [('A', 'B', 1), ('A', 'C', 4), ('B', 'C', 3), ('B', 'D', 2), ('C', 'D', 5), ('D', 'E', 6)]

graph = (vertices, edges)

print(kruskal(graph))

```

在这个示例中,我们定义了一个简单的不相交集类来管理顶点集合的合并和查找操作。然后,我们对图中的边进行排序,并通过选择最小的边构建最小生成树。

## 3.2 贪心算法的问题建模和实现

在本小节中,我们将深入探讨贪心算法在实际应用中的问题建模过程以及如何高效地实现这些算法。

### 3.2.1 问题的抽象和建模

问题建模是应用贪心算法前的关键步骤。在构建模型时,需要识别问题的核心要素,并忽略那些对最终解决方案影响不大的细节。以下是建模的一般步骤:

1. **定义问题域**:明确问题涉及的对象和属性。

2. **确定目标函数**:决定用来衡量解决方案好坏的标准。

3. **构建约束条件**:确立影响问题解决方案的限制因素。

4. **形式化问题**:将问题转化为数学表达式或图模型,以便使用算法处理。

建模完成后,我们需要为贪心算法设计合适的策略。对于背包问题,我们采用单位价值最大化的贪心策略;对于最小生成树问题,我们使用边权重最小化的贪心策略。

### 3.2.2 算法的代码实现和调试

实现贪心算法通常遵循以下几个步骤:

1. **输入处理**:将问题的输入数据转换为算法易于处理的格式。

2. **贪心选择**:根据所采用的贪心策略,做出选择并更新数据状态。

3. **构建解决方案**:根据贪心选择生成最终解决方案。

4. **输出验证**:验证解决方案

0

0