深度解读Big O表示法:揭示算法复杂度的数学秘密

发布时间: 2024-09-01 06:29:48 阅读量: 92 订阅数: 64

# 1. Big O表示法的理论基础

在计算机科学和算法分析中,Big O表示法是一种用来描述算法性能与输入规模之间关系的重要工具。理解Big O表示法,是掌握算法优化和复杂度评估的前提。本章将从基础理论出发,逐步深入到Big O表示法背后的数学原理及其在算法分析中的实际应用。

首先,Big O表示法用于描述最坏情况下的算法运行时间,它忽略了常数因子和低阶项,从而提供了一种相对性能评估。这使得我们可以专注于算法在面对大规模数据输入时的行为,而不受具体实现细节的影响。

接下来的章节将更加深入地探讨Big O表示法的数学原理,以及如何应用这一工具来分析和优化算法。通过逐渐积累的知识,我们能够评估算法的性能并作出有效的改进。

# 2. 理解Big O表示法的数学原理

## 2.1 计算复杂度的基本概念

### 2.1.1 算法复杂度的定义

在计算机科学中,算法复杂度是用来评估算法性能和效率的一种方法。它主要通过算法所需时间(时间复杂度)和空间(空间复杂度)来衡量。复杂度分析关注的是算法运行时间或空间需求随着输入数据规模的增加而增长的趋势。

复杂度分析并不要求具体的执行时间,而是提供了一个基于输入数据规模(通常记作n)的增长率函数。这种以增长率来估计的方法允许我们忽略机器、编程语言或输入数据的具体细节,而集中于算法本质的性能表现。

### 2.1.2 时间复杂度与空间复杂度

时间复杂度是用来衡量算法执行时间随着输入数据规模增长的速率。它的表达方式是用Big O表示法、Theta(Θ)表示法或Omega(Ω)表示法,这些表示法可以表达出算法执行时间的上界、确切界和下界。

空间复杂度则关注算法执行时所需要的存储空间。这包括所有变量、辅助数据结构以及递归调用的栈空间等。

## 2.2 Big O表示法的推导过程

### 2.2.1 渐进符号的意义

Big O表示法中的渐进符号主要有O( )、Ω( )、Θ( )和o( )。其中,Big O表示法O( )用于描述算法上界的增长率,是实际应用中最常用的。

假设f(n)和g(n)是两个函数,如果存在正常数c和n₀,使得对于所有n≥n₀,有0 ≤ f(n) ≤ c*g(n),则说函数f(n)在n趋向于无穷大时,与g(n)具有相同的增长率,并可表示为f(n) = O(g(n))。

### 2.2.2 Big O, Big Ω, 和 Big Θ的对比

- **Big O(O-notation)**:定义了函数的上界。

- **Big Ω(Ω-notation)**:定义了函数的下界。

- **Big Θ(Θ-notation)**:同时定义了函数的上界和下界,表示了函数的确切增长率。

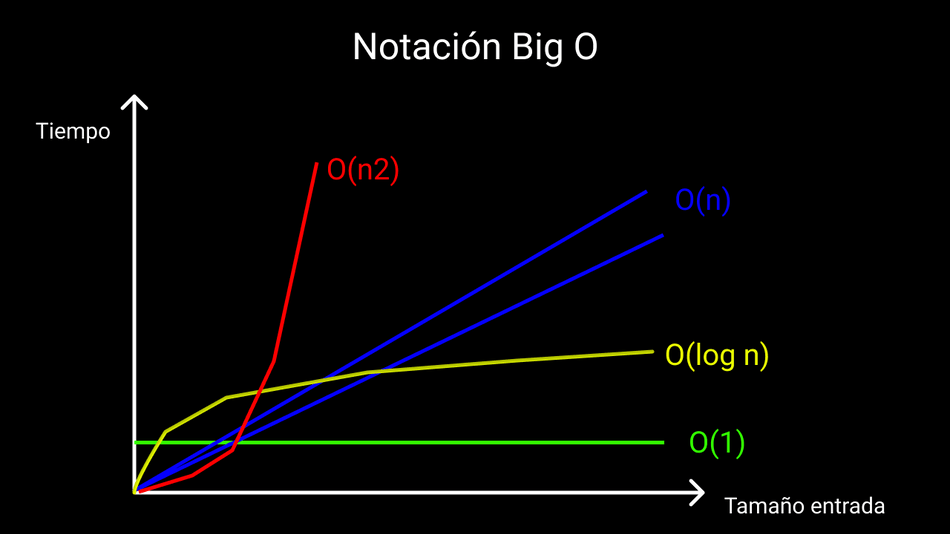

### 2.2.3 常见的复杂度类别

- **O(1)**:常数时间,算法的执行时间不随输入规模变化而变化。

- **O(log n)**:对数时间,通常出现在每次迭代中数据规模减半的情况下。

- **O(n)**:线性时间,算法的执行时间与输入数据规模成线性关系。

- **O(n log n)**:线性对数时间,常见的如快速排序和归并排序。

- **O(n²)**:二次时间,常出现在双层循环嵌套中。

- **O(2ⁿ)**:指数时间,通常算法复杂度过高,不可用于大规模数据处理。

## 2.3 影响Big O表示法的因素

### 2.3.1 数据结构的选择

不同的数据结构在进行基本操作时的时间复杂度是不同的。例如,数组和链表在插入和删除操作时的时间复杂度就有明显差异。数据结构的选择将直接影响算法的时间和空间复杂度。

### 2.3.2 算法中的控制流

算法中的循环和递归调用是影响复杂度的重要因素。内嵌循环将导致更高的时间复杂度,例如双层循环将导致O(n²)的时间复杂度。

### 2.3.3 输入数据的特性

输入数据的特性也会影响算法复杂度,例如有序输入数据可能会降低搜索算法的时间复杂度。

接下来的章节将深入探讨Big O表示法在算法分析中的实践应用。

# 3. Big O表示法在算法分析中的实践

## 3.1 常见算法的复杂度分析

### 3.1.1 排序算法的时间复杂度

当我们谈论排序算法时,我们通常关注的是算法的效率和复杂度。在算法的性能分析中,时间复杂度是衡量算法执行时间如何随着输入数据规模的增长而变化的重要指标。时间复杂度通常用大O表示法表示,它可以帮助我们了解算法在最坏情况、平均情况和最佳情况下的表现。

下面是一些常见排序算法及其时间复杂度的表格:

| 排序算法 | 最坏情况时间复杂度 | 平均情况时间复杂度 | 最佳情况时间复杂度 | 空间复杂度 | 稳定性 |

| -------------- | ------------------ | ------------------ | ------------------ | ---------- | ------ |

| 冒泡排序 | O(n^2) | O(n^2) | O(n) | O(1) | 稳定 |

| 选择排序 | O(n^2) | O(n^2) | O(n^2) | O(1) | 不稳定 |

| 插入排序 | O(n^2) | O(n^2) | O(n) | O(1) | 稳定 |

| 希尔排序 | O(nlogn) | 依赖于间隔序列 | O(n) | O(1) | 不稳定 |

| 快速排序 | O(n^2) | O(nlogn) | O(nlogn) | O(logn) | 不稳定 |

| 归并排序 | O(nlogn) | O(nlogn) | O(nlogn) | O(n) | 稳定 |

| 堆排序 | O(nlogn) | O(nlogn) | O(nlogn) | O(1) | 不稳定 |

| 计数排序 | O(n+k) | O(n+k) | O(n+k) | O(k) | 稳定 |

| 桶排序 | O(n+k) | O(n+k) | O(n^2) | O(n+k) | 稳定 |

| 基数排序 | O(nk) | O(nk) | O(nk) | O(n+k) | 稳定 |

快速排序的平均情况时间复杂度为O(nlogn),在许多实际情况中表现很好,但其最坏情况时间复杂度为O(n^2),这意味着在某些特定输入下,快速排序可能变得效率低下。为了改进快速排序的最坏情况表现,可以采用随机化版本的快速排序,或者使用不同的枢轴选择策略。

### 3.1.2 搜索算法的空间复杂度

搜索算法是另一个展示算法复杂度分析重要性的典型例子。考虑二分搜索算法,它在已排序数组中查找特定元素时具有非常高的效率。二分搜索每次将搜索范围减半,因此其时间复杂度为O(logn)。然而,我们还需要考虑其空间复杂度,即算法执行过程中所占用的额外空间量。

二分搜索通常是用递归实现的,其空间复杂度为O(logn),因为递归调用堆栈的深度为logn。在某些情况下,如果用迭代的方式实现,可以将空间复杂度降低到O(1),但这需要更复杂的状态维护和控制逻辑。

```python

def binary_search(arr, target):

left, right = 0, len(arr) - 1

while left <= right:

mid = (left + right) // 2

if arr[mid] == target:

return mid

elif arr[mid] < target:

left = mid + 1

else:

right = mid - 1

return -1

```

从上面的代码中我们可以看到,二分搜索算法在每次迭代中都会更新`left`和`right`两个变量,这些变量存储了在当前迭代中待搜索的数组子序列的范围。由于这种更新是基于常数级的操作,所以可以认为二分搜索算法的空间复杂度为O(1),除了算法中用于输入数组的原始空间。

## 3.2 多个复杂度因素的综合考量

### 3.2.1 最坏情况、平均情况和最佳情况

在分析算法的性能时,考虑算法在不同输入情况下的表现是非常重要的。最坏情况时间复杂度、平均情况时间复杂度和最佳情况时间复杂度是三种衡量算法性能的关键指标。

- **最坏情况时间复杂度(Worst-case Time Complexity)**:在所有可能的输入值中,使算法执行时间最长的那一个输入值下,算法所表现出的运行时间。对于某些算法,最坏情况下的时间复杂度可能会非常糟糕,甚至无法接受,因此了解并优化最坏情况的性能是非常重要的。

- **平均情况时间复杂度(Average-case Time Complexity)**:在所有可能的输入值中,算法执行时间的平均表现。这是在实际应用中最常见的情况,因为大多数时候,我们接触到的数据并不是极端或者最坏的情况。

- **最佳情况时间复杂度(Best-case Time Complexity)**:在所有可能的输入值中,使算法执行时间最短的那一个输入值下,算法所表现出的运行时间。在某些情况下,最佳情况可能和最坏情况相差很大。

在实际应用中,通常最关心平均情况时间复杂度,因为它反映了算法在通常情况下的运行效率。然而,在安全性和可靠性要求极高的系统中,最坏情况时间复杂度同样重要,因为它能够提供一个算法性能的保证。

### 3.2.2 并行算法的复杂度分析

随着多核处理器的普及,设计并行算法成为了提高程序性能的一个重要方法。并行算法的复杂度分析涉及多个方面,包括时间复杂度、空间复杂度以及如何有效地利用多核处理器的能力。

并行算法的关键是能够将问题分解成若干可以同时解决的子问题。理想情况下,如果一个算法可以完美地并行化,那么其执行时间将大大减少。在理论上,如果一个算法可以被分为n个可以并行执行的子任务,那么它的加速比最大可以达到n倍。

然而,在实际应用中,由于并行任务之间的协调、同步、通信以及资源竞争等因素,实际加速比通常小于理想值。因此,分析并行算法时,我们需要考虑以下复杂度因素:

- **理论加速比(Theoretical Speedup)**:理想情况下,算法加速比与并行处理器数量之间的关系。根据阿姆达尔定律(Amdahl's Law),加速比S与加速部分的比例α和处理器数量n之间的关系可以表示为:`S = 1 / ((1 - α) + α / n)`。

- **实际加速比(Actual Speedup)**:考虑到并行处理中的各种开销,实际加速比会小于理论加速比。

- **并行开销(Parallel Overhead)**:启动并行任务、任务间通信和同步等所需的时间和资源。

- **负载平衡(Load Balancing)**:如何平衡不同处理器的工作负载,以避免某些处理器空闲而其他处理器过载。

```mermaid

graph TD

A[开始] --> B[划分任务]

B --> C[分配任务]

C --> D[执行并行任务]

D --> E[同步结果]

E --> F[结束]

```

上图所示的流程图展示了一个基本的并行算法执行过程,这个过程中包括任务的划分、分配、执行和结果同步等关键步骤。

在并行算法设计中,我们通常希望最小化并行开销,并尽可能平衡负载,以达到尽可能高的加速比。然而,并不是所有的算法都适合并行化。例如,某些算法可能会因为数据依赖而导致难以并行化,或者并行化所带来的开销会抵消并行化带来的性能提升。

## 3.3 算法优化策略与复杂度减少

### 3.3.1 分治法和递归算法的优化

分治法是一种在计算机科学中常用的算法设计范式,它将一个问题分解为多个较小的子问题,递归地解决这些子问题,然后再合并这些子问题的解以得到原问题的解。

递归算法通常会涉及函数的自我调用。在每次递归调用中,问题的规模都会减少,直到达到一个基本案例(base case),此时递归调用结束。虽然递归算法的代码简洁易懂,但有时也会导致不必要的重复计算和较高的空间复杂度。例如,在经典的递归实现的斐波那契数列算法中,大量的计算结果会被重复计算,导致效率极低。

为了优化递归算法,我们可以采取一些策略:

- **记忆化(Memoization)**:存储已经计算过的子问题的结果,当相同的子问题再次出现时,直接返回存储的结果,避免重复计算。

- **尾递归优化(Tail Call Optimization)**:当递归调用是函数体中的最后一个动作时,一些语言或编译器能够进行优化,使得递归函数调用不会增加新的栈帧,从而减少空间复杂度。

```python

def fib_memo(n, memo=None):

if memo is None:

memo = {}

if n in memo:

return memo[n]

if n <= 2:

return 1

memo[n] = fib_memo(n-1, memo) + fib_memo(n-2, memo)

return memo[n]

```

上面的代码展示了如何使用记忆化来优化斐波那契数列的计算。在这个例子中,我们创建了一个字典`memo`来存储已经计算过的斐波那契数,这样可以显著提高算法的效率。

### 3.3.2 动态规划与缓存机制

动态规划是一种将复杂问题分解为更小的子问题并存储这些子问题的解的算法策略。这种方法特别适合于有重叠子问题和最优子结构的问题。动态规划通常可以用来优化具有递归性质的问题,通过避免重复计算相同的子问题,可以大大减少计算时间。

动态规划的核心是使用缓存机制(也称为“记忆化”技术)来存储已经解决的子问题的解。这种方法可以确保每个子问题只被解决一次。动态规划算法的时间复杂度往往比简单的递归算法要低很多,因为它们避免了不必要的重复计算。

```python

def knapsack(values, weights, capacity):

n = len(values)

dp = [[0 for x in range(capacity + 1)] for x in range(n + 1)]

for i in range(1, n + 1):

for w in range(1, capacity + 1):

if weights[i-1] <= w:

dp[i][w] = max(values[i-1] + dp[i-1][w-weights[i-1]], dp[i-1][w])

else:

dp[i][w] = dp[i-1][w]

return dp[n][capacity]

```

在这个动态规划解决背包问题的例子中,`dp`数组用来存储子问题的解,避免了重复计算。每次计算新子问题时,我们首先检查是否需要使用当前物品,然后根据子问题的解计算当前问题的解。使用缓存机制后,背包问题的时间复杂度从指数级降低到了多项式级。

在动态规划的优化策略中,选择合适的数据结构来存储子问题的解是很关键的。在一些动态规划问题中,使用栈、队列等数据结构可以进一步优化算法的空间复杂度。此外,在一些高级的动态规划实现中,还会采用矩阵乘法、FFT(快速傅里叶变换)等更高级的技术来提升算法效率。

# 4. Big O表示法的高级应用

## 4.1 算法的并行化与分布式处理

在当今的IT行业中,算法并行化和分布式处理是实现高性能计算的两个主要途径。随着硬件能力的提升,尤其是在云计算和大规模数据处理场景中,这些方法显得尤为重要。

### 4.1.1 并行算法的复杂度分析

并行算法的设计目标是在多个处理单元上同时执行计算,以此来减少完成任务所需的总时间。复杂度分析时,我们不仅考虑单个处理器上的计算时间,还要考虑如何有效分配任务以减少通信开销和同步延迟。

考虑一个典型的并行计算场景:我们有`n`个数据项需要处理,并且每个数据项处理的时间复杂度为`O(f(n))`。如果我们能够使用`p`个处理器并行工作,则理想情况下,总的时间复杂度可以降低至`O(f(n)/p)`。然而,实际中由于数据分割和同步的开销,时间复杂度通常会比理想情况略高,可能是`O(f(n)/p + s)`,其中`s`表示通信和同步的开销。

### 4.1.2 分布式系统中的时间空间权衡

在分布式系统中,数据通常被划分成多个部分,分布在不同的节点上进行处理。这种情况下,时间复杂度的降低可能伴随着额外的空间复杂度开销。例如,当使用MapReduce模型时,映射阶段可能需要存储中间数据,因此整个算法的空间复杂度将受到中间数据大小的影响。

此外,对于那些需要大量数据交换的算法,网络通信延迟会成为性能瓶颈,因此在设计时需要仔细考虑如何平衡各个节点之间的负载和通信量。在复杂度分析中,我们不仅考虑局部计算的时间复杂度,还需要考虑数据传输的复杂度,通常使用通信复杂度模型来分析。

## 4.2 算法在大数据场景下的应用

随着大数据技术的不断发展,如何在海量数据中快速有效地提取有用信息变得至关重要。Big O表示法在大数据场景下的应用,让我们能够对这些复杂的数据处理算法进行性能评估和优化。

### 4.2.1 大数据算法的时间复杂度挑战

大数据算法通常需要处理超出常规内存容量的数据集,这就要求算法能够在有限的内存中高效运行。典型的大数据算法比如外部排序、大规模图处理和分布式机器学习,它们面临的主要挑战是如何在保证算法正确性的前提下,减少I/O操作和提高计算效率。

以外部排序为例,处理的复杂度主要在于如何将大规模数据集分割到磁盘上,保证数据可以有效地被读取和写入。外部排序的时间复杂度通常为`O(n log(n))`,其中`n`是需要排序的数据项总数,这与内部排序的时间复杂度相同。但是,由于I/O操作的加入,整个排序过程的时间复杂度会受到磁盘访问速度和数据块大小的强烈影响。

### 4.2.2 数据挖掘与机器学习算法的复杂度分析

数据挖掘与机器学习算法处理的数据量非常庞大,同时计算过程也相对复杂。这些算法往往需要多层数据抽象,并对输入数据做大量迭代运算。在时间复杂度上,可能会面临超线性增长,例如一些基于迭代的优化算法,它们的复杂度常常是`O(kn)`,其中`k`是迭代次数,`n`是数据大小。

在评估这些算法时,不仅要考虑时间复杂度,还需要考虑模型训练的准确性和算法的泛化能力。因此,对于数据挖掘和机器学习算法,复杂度分析往往与算法的性能评估相辅相成。

## 4.3 Big O表示法在实际问题中的案例研究

通过具体案例分析,我们可以更好地理解Big O表示法在实际问题解决中的应用。下面选取两个具有代表性的案例来展示其在实际操作中的应用。

### 4.3.1 互联网服务的性能优化案例

对于一个提供实时搜索服务的互联网公司,算法性能直接关系到用户满意度和系统吞吐量。例如,搜索引擎的关键词检索需要在毫秒级返回结果,其背后的算法复杂度至关重要。

在优化过程中,我们可以使用Big O表示法对多个阶段的算法进行分析,如文本索引、查询解析和结果排序。优化的目标通常是将时间复杂度从`O(n^2)`降低到`O(n log(n))`。实现方法可能包括对数据结构的选择、索引策略的调整以及并发查询处理机制的引入。

### 4.3.2 图论算法在社交网络分析中的应用

社交网络分析是图论算法应用的一个热点领域。如社交网络的好友推荐算法中,对用户之间关系的建模和预测至关重要,这直接影响着推荐的准确度和效果。

在大规模社交网络中,简单使用`O(n^2)`的算法来计算用户之间的相似度或关系强度,将导致巨大的计算开销。通过使用如哈希函数、跳跃表等数据结构和算法优化技术,可以使时间复杂度降至`O(n log(n))`甚至更低。而在实际应用中,为了达到更好的效果和可扩展性,可能需要进一步采用近似算法或启发式方法。

在以上分析的基础上,我们能够看到Big O表示法在实际问题中的实际应用,以及如何通过这种表示法来优化算法和提升性能。

至此,我们已经完成了对Big O表示法高级应用的探讨,下一章节将对Big O表示法的局限性进行深入分析。

# 5. 未来展望:Big O表示法的局限与发展方向

随着科技的不断进步,Big O表示法在算法分析中依然占据着举足轻重的地位。然而,任何理论都不是一成不变的,Big O表示法同样面临着一些局限性,同时,新的理论和技术的发展也为其带来了新的发展方向。

## 5.1 当前Big O表示法的局限性分析

### 5.1.1 理论模型与实际操作的差异

Big O表示法提供了一个理论上的时间复杂度上限,但实际操作中的性能会受到多种因素的影响。例如,处理器速度、内存访问模式、缓存行为等,都可能造成实际性能与理论预期的差异。此外,Big O表示法忽略了常数因子和低阶项的影响,这在某些场合下可能会导致误判算法的实际效率。

为了更准确地评估算法性能,我们可以采用实验法来补充理论分析。通过实际的测试来获取算法在特定环境下的具体表现,结合Big O表示法,可以得到更加全面的算法性能评估。

### 5.1.2 非确定性多项式(NP)问题的处理

Big O表示法在描述P类问题(多项式时间可解的问题)时表现良好,但当面对NP问题时,例如图的着色、旅行商问题等,其局限性便暴露无遗。对于NP问题,我们无法有效估计找到最优解所需的时间复杂度。对于这些问题,科学家们正在寻找其他理论模型来更好地理解和解决它们,如非确定性多项式完全(NPC)类问题的近似算法。

## 5.2 探索新的算法复杂度理论

### 5.2.1 量子计算与量子算法复杂度

随着量子计算的发展,传统的算法复杂度理论也面临着挑战。量子算法,如著名的Shor算法和Grover算法,已经展示了在特定问题上相比经典算法的巨大优势。量子复杂度理论开始逐渐发展,如BQP(Bounded-error Quantum Polynomial time)类别,用以描述量子计算机能够高效解决的问题集合。

量子计算对于Big O表示法的影响还处在研究初期阶段,但未来可能会成为主流计算模型。届时,我们需要开发新的复杂度理论框架来适应量子计算的特点。

### 5.2.2 数据结构的创新与新复杂度类别的出现

数据结构的创新一直是算法效率提升的关键。例如,跳表、B树、红黑树等数据结构的发明,都是为了解决特定问题并提高算法性能。在未来,随着更多新类型的数据结构的出现,也可能会伴随新的复杂度类别。这些新的复杂度类别将更准确地描述这些数据结构驱动下的算法性能。

## 5.3 Big O表示法的教育与普及

### 5.3.1 算法教育中Big O表示法的教学方法

在算法教育中,Big O表示法的教授需要更加注重其实际应用。传统上,教学往往侧重于公式的推导和应用,但对于学生来说,理解Big O表示法在实际算法设计中的应用则更为关键。因此,教学方法需要更加注重案例分析和实战演练,使学生能够将理论知识与实际问题解决相结合。

### 5.3.2 在非计算机科学领域中的应用普及

Big O表示法并非仅限于计算机科学领域。随着数据科学、机器学习、甚至社会科学等领域对算法的依赖日益增加,Big O表示法也开始被这些领域的专家所关注。为了推动Big O表示法的普及,我们需要将其概念和方法以更易于理解的方式传达给非计算机专业的研究人员和从业者。例如,通过比喻、案例研究和可视化工具,使复杂度理论更加直观易懂。

未来,Big O表示法与新兴的技术和理论的结合,将会不断推动算法效率的提升和复杂度分析方法的发展。我们将继续见证这一重要概念如何适应新的挑战,并在新的领域发挥作用。

0

0