对抗训练在入侵检测中的护盾:增强网络安全防御

发布时间: 2024-08-20 01:08:32 阅读量: 13 订阅数: 11

# 1. 入侵检测概述**

入侵检测是网络安全中至关重要的技术,旨在识别和阻止恶意活动。入侵检测系统(IDS)通过监视网络流量或系统日志来检测异常行为,从而识别潜在的攻击。IDS 通常基于规则、签名或机器学习模型,可以检测各种类型的攻击,包括网络扫描、恶意软件和网络钓鱼。

入侵检测面临的主要挑战之一是攻击者不断开发新的技术来逃避检测。对抗训练是一种有前途的技术,可以增强 IDS 的鲁棒性,使其能够检测和阻止这些新的攻击。

# 2. 对抗训练的基本原理

### 2.1 对抗样本的生成方法

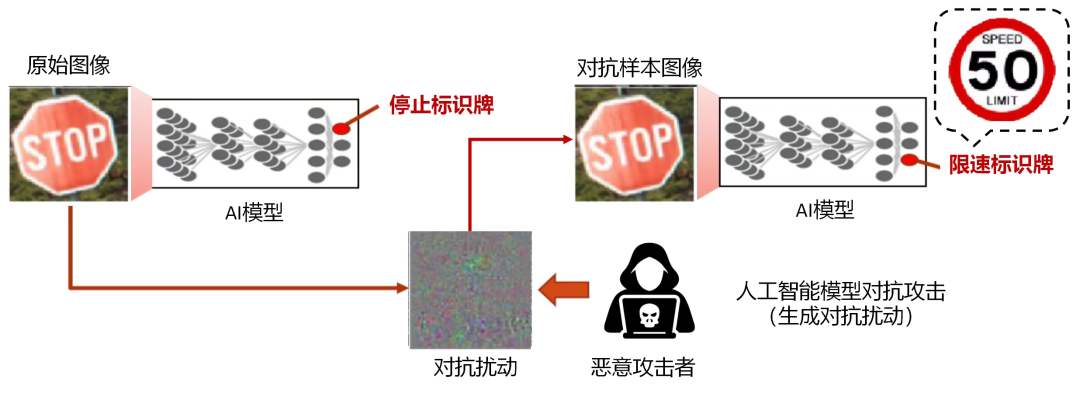

对抗样本是精心设计的输入,旨在欺骗机器学习模型,使其做出错误的预测。在入侵检测中,对抗样本可以被攻击者用来绕过检测系统,从而发起成功的攻击。

生成对抗样本的方法有多种,其中最常见的方法是:

**快速梯度符号法 (FGSM)**:FGSM 通过计算模型梯度并沿梯度方向添加一个扰动来生成对抗样本。扰动的幅度由攻击者控制,它决定了对抗样本与原始样本之间的相似程度。

```python

import numpy as np

import tensorflow as tf

def fgsm_attack(model, x, y, epsilon=0.01):

"""

FGSM 攻击

参数:

model: 目标模型

x: 原始样本

y: 真实标签

epsilon: 扰动幅度

返回:

对抗样本

"""

# 计算模型梯度

with tf.GradientTape() as tape:

loss = tf.keras.losses.categorical_crossentropy(y, model(x))

grad = tape.gradient(loss, x)

# 添加扰动

x_adv = x + epsilon * np.sign(grad)

# 裁剪对抗样本

x_adv = tf.clip_by_value(x_adv, 0, 1)

return x_adv

```

**迭代快速梯度符号法 (IFGSM)**:IFGSM 是 FGSM 的一种变体,它通过多次迭代应用 FGSM 来生成对抗样本。每次迭代都会减小扰动的幅度,从而使对抗样本与原始样本更加相似。

**投射梯度下降法 (PGD)**:PGD 是一种更复杂的对抗样本生成方法,它使用梯度下降算法来寻找对抗样本。PGD 可以生成更强大的对抗样本,但它也更耗时。

### 2.2 对抗训练的算法和策略

对抗训练是一种通过在训练过程中引入对抗样本来增强机器学习模型鲁棒性的技术。对抗训练的算法和策略包括:

**对抗训练算法**:对抗训练算法通过使用对抗样本来更新模型权重,从而使模型能够抵抗对抗样本的攻击。常见的对抗训练算法包括:

* **对抗性损失函数**:对抗性损失函数将对抗样本的损失添加到模型的原始损失函数中。这鼓励模型在对抗样本上表现良好。

* **对抗性正则化**:对抗性正则化将对抗样本的梯度添加到模型的正则化项中。这惩罚模型对对抗样本的敏感性。

**对抗训练策略**:对抗训练策略决定了如何生成对抗样本以及如何更新模型权重。常见的对抗训练策略包括:

* **单步对抗训练**:单步对抗训练只使用一个对抗样本来更新模型权重。

* **多步对抗训练**:多步对抗训练使用多个对抗样本来更新模型权重。

* **随机对抗训练**:随机对抗训练使用随机生成的对抗样本来更新模型权重。

# 3. 对抗训练在入侵检测中的应用**

对抗训练在入侵检测领域具有广阔的应用前景,它可以显著增强入侵检测模型的鲁棒性,有效应对对抗样本的攻击。本章将深入探讨对抗训练在入侵检测中的应用,包括入侵检测模型的对抗性评估和对抗训练增强入侵检测模型的鲁棒性。

### 3.1 入侵检测模型的对抗性评估

对抗性评估是衡量入侵检测模型对抗样本攻击鲁棒性的关键步骤。通过构造对抗样本,可以评估模型在面对恶意攻击时的性能表现。对抗样本的构造方法多种多样,常用的方法包括:

- **快速梯度符号法 (FGSM)**:通过计算损失函数的梯度,并沿着梯度方向添加扰动,生成对抗样本。

- **迭代快速梯度符号法 (IFGSM)**:FGSM 的改进版本,通过迭代执行 FGSM 多次,生成更强的对抗样本。

- *

0

0