变分自编码器(VAE)在自然语言处理中的突破:文本生成与语言建模,解锁语言的无限潜力

发布时间: 2024-08-20 16:18:35 阅读量: 32 订阅数: 22

# 1. 变分自编码器(VAE)概述

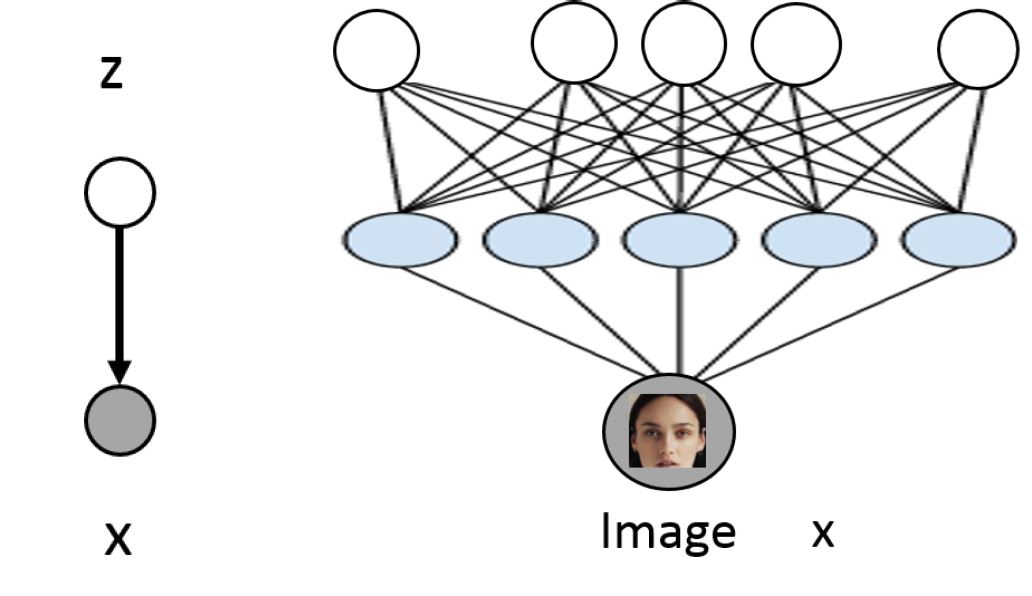

变分自编码器(VAE)是一种生成式模型,它通过学习数据的潜在表示来生成新的数据。与传统的自编码器不同,VAE 使用变分推断来近似数据的后验分布,从而能够生成具有更大多样性和真实性的数据。

VAE 的主要思想是将输入数据编码为一个潜在变量的分布,然后从该分布中采样来生成新的数据。潜在变量通常是一个低维向量,它捕获了输入数据的关键特征。VAE 的编码器网络将输入数据映射到潜在变量分布的参数,而解码器网络则将潜在变量映射到重建的输入数据。

# 2. VAE在文本生成中的应用

### 2.1 VAE文本生成模型的架构

#### 2.1.1 编码器和解码器网络

VAE文本生成模型通常采用编码器-解码器结构。编码器网络负责将输入文本序列编码为一个低维度的潜变量表示,而解码器网络则负责从潜变量中重建文本序列。

编码器网络通常是一个递归神经网络(RNN),例如LSTM或GRU。RNN可以处理序列数据,并能够学习文本序列中的长期依赖关系。编码器网络的输出是一个固定长度的向量,表示文本序列的潜在语义表示。

解码器网络也是一个RNN,负责从潜变量中生成文本序列。解码器网络逐个字符地生成文本,并使用编码器网络输出的潜在语义表示作为初始状态。

#### 2.1.2 潜变量的采样和重构

VAE模型的关键特性是潜变量的采样和重构。在训练过程中,编码器网络输出的潜在语义表示被视为一个概率分布,从中采样一个潜在变量。然后,解码器网络使用采样的潜在变量重建文本序列。

潜变量的采样过程引入了一定的随机性,这有助于生成多样化的文本序列。同时,重构过程确保了生成的文本序列与输入文本序列在语义上相似。

### 2.2 VAE文本生成模型的训练

#### 2.2.1 损失函数和优化算法

VAE文本生成模型的训练目标是最大化重构概率和最小化潜在变量分布与标准正态分布之间的KL散度。重构概率衡量了生成文本序列与输入文本序列的相似性,而KL散度衡量了潜在变量分布与标准正态分布之间的差异。

常用的损失函数为:

```python

loss = -reconstruction_probability + beta * KL_divergence

```

其中,`reconstruction_probability`为重构概率,`KL_divergence`为KL散度,`beta`为权重超参数。

训练过程中,使用优化算法(例如Adam)最小化损失函数。优化算法更新模型参数,以最大化重构概率并最小化KL散度。

#### 2.2.2 模型评估和调参

VAE文本生成模型的评估指标包括:

* **BLEU得分:**衡量生成文本序列与参考文本序列之间的相似性。

* **困惑度:**衡量生成文本序列的语言流畅性和语法正确性。

* **多样性:**衡量生成文本序列的多样性和新颖性。

模型调参涉及调整超参数,例如潜在变量的维度、RNN层的数量和优化算法的学习率。调参的目标是找到一组超参数,使模型在评估指标上达到最佳性能。

# 3.1 VAE语言模型的架构

#### 3.1.1 序列到序列模型

VAE语言模型通常采用序列到序列(Seq2Seq)模型的架构。Seq2Seq模型由两个主要组件组成:编码器和解码器。

编码器是一个神经网络,它将输入序列(例如,一段文本)编码为一个固定长度的向量。该向量称为潜变量,它捕获了输入序列的语义信息和抽象表示。

解码器也是一个神经网络,它将潜变量解码为输出序列(例如,生成新的文本)。解码器使用自回归机制,即每个时间步的输出都依赖于之前的时间步的输出。

#### 3.1.2 VAE语言模型的特殊性

与传统的

0

0