深度学习与卷积神经网络:如何选择合适的激活函数

发布时间: 2024-09-05 11:09:30 阅读量: 81 订阅数: 36

# 1. 深度学习基础与卷积神经网络概述

## 1.1 深度学习的兴起与重要性

深度学习作为人工智能领域的一个分支,近十年来取得了飞速的发展,尤其在图像识别、自然语言处理、语音识别等方面展现了卓越的性能。卷积神经网络(CNN)作为深度学习的一种重要网络结构,因其强大的特征提取能力在各类视觉任务中被广泛使用。

## 1.2 卷积神经网络的工作原理

卷积神经网络由卷积层、激活函数、池化层、全连接层等多个组成部分构成。其核心思想是利用卷积运算替代全连接运算,保持数据的空间层次结构。通过不断叠加的卷积层和池化层,网络能够自动学习到数据的特征表示,最终通过全连接层进行分类或其他任务的预测。

## 1.3 卷积神经网络在实践中的应用

在实际应用中,CNN已经成功应用于各种复杂的问题,包括医学图像分析、自动驾驶汽车、视频监控、增强现实等。不仅如此,随着深度学习框架的普及和计算能力的提升,卷积神经网络的应用范围仍在不断扩展。

```mermaid

graph TD

A[输入层] -->|原始数据| B[卷积层]

B -->|提取特征| C[激活函数]

C -->|非线性变换| D[池化层]

D -->|降维处理| E[下一层卷积层]

E -->|更深层次特征| F[全连接层]

F -->|最终决策| G[输出层]

```

通过以上内容,我们对深度学习和卷积神经网络有了初步的认识。在后续章节中,我们将深入探讨激活函数的理论和应用,进一步揭示深度学习模型的内在工作原理。

# 2. 激活函数的基本理论

### 2.1 激活函数的定义与作用

#### 2.1.1 激活函数在神经网络中的角色

在神经网络中,激活函数(Activation Function)扮演着至关重要的角色。它是一个数学函数,作用于神经元的输出,决定着该神经元是否被激活。换句话说,激活函数为神经网络引入了非线性因素,这是为什么多层神经网络可以逼近任意函数的重要原因。如果没有激活函数,无论网络有多少层,最终都只相当于一个线性模型,这样的模型表达能力有限,无法解决复杂的实际问题。

激活函数还可以帮助网络捕捉数据中的复杂模式,防止数据在训练过程中变得过于简单化,从而提升模型的预测能力。此外,激活函数也有助于缓解梯度消失或梯度爆炸的问题,保持网络在不同层次的训练过程中的健康更新。

#### 2.1.2 常见的激活函数类型

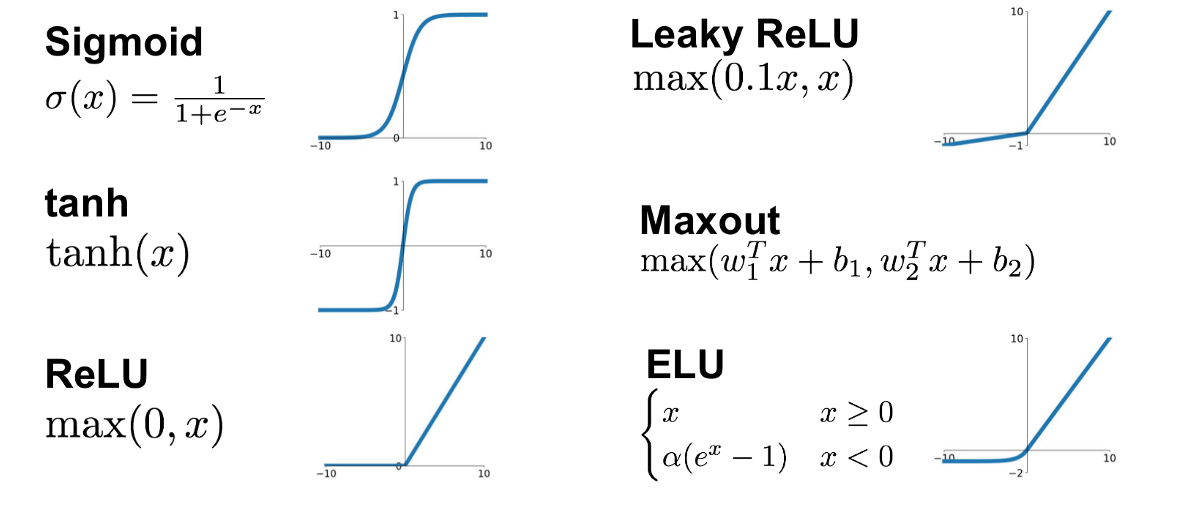

激活函数有许多种类,常见的包括:

- **Sigmoid函数**:Sigmoid函数可以将任意实数值压缩到(0,1)之间,类似于概率分布。尽管如此,Sigmoid激活函数在深层网络中的梯度消失问题非常显著,因此在深度学习中的使用已大大减少。

- **Tanh函数**:双曲正切函数(Tanh)与Sigmoid类似,但是将输出范围压缩到了(-1,1)。Tanh函数克服了Sigmoid的非零中心化问题,但是同样存在梯度消失的问题。

- **ReLU(Rectified Linear Unit)函数**:ReLU函数是最常用的激活函数之一,它将所有负值设为零,仅保留正值。ReLU的简单性和高效的计算速度使其在深度网络中非常受欢迎,但它也会遇到神经元“死亡”的问题。

- **Leaky ReLU和Parametric ReLU**:这两种变种旨在解决ReLU的“死亡”问题,通过允许小的负梯度来保持一些信息流。

- **Swish函数**:一种由Google提出的自门控激活函数,性能往往优于ReLU,并且没有ReLU的“死亡”问题。

### 2.2 激活函数的数学特性

#### 2.2.1 可导性与梯度消失/爆炸问题

在训练深层神经网络时,梯度的传播非常重要。激活函数的可导性保证了反向传播算法可以有效工作。如果激活函数不可导或者导数在某些点为零,那么梯度在传播过程中可能会消失,导致深层网络无法学习到有效特征。

Sigmoid和Tanh函数在两端的导数值接近于零,容易导致梯度消失的问题。相比之下,ReLU及其变种在正区间内有恒定的导数值(例如ReLU为1),这有助于缓解梯度消失的问题,但是也有可能造成梯度爆炸。

#### 2.2.2 非线性变换能力的对比

非线性变换是激活函数的核心功能之一,不同的激活函数有不同的非线性变换能力。Sigmoid和Tanh函数虽然非线性,但是由于其输出值范围限制,导致多层组合后的网络性能并不理想。相比之下,ReLU及其变种由于输出没有上限,可以支持更复杂的非线性变换。

#### 2.2.3 激活函数的参数化与正则化

参数化激活函数,如Parametric ReLU或Swish,通过引入参数使激活函数更加灵活,可以根据数据调整自身形状,从而增强网络的表达能力。同时,参数化的形式也为正则化提供了可能,通过限制参数的大小来减少过拟合。

### 2.3 激活函数的选择标准

#### 2.3.1 理论依据与实验依据的权衡

在选择激活函数时,我们首先应当考虑理论依据,比如是否容易计算、是否存在梯度消失/爆炸问题等。此外,实验依据同样重要,实际模型的性能往往需要通过实验来验证。通常情况下,我们会在理论基础之上进行实验选择,以找到最合适的激活函数。

#### 2.3.2 激活函数的适用场景分析

不同激活函数各有其适用的场景。例如,在图像处理领域,ReLU和其变种由于计算效率高、非线性能力强,被广泛应用。而Swish函数在一些研究中显示出了更好的性能,特别是在大规模数据集上。了解激活函数的特性,可以帮助我们根据具体问题选择最合适的激活函数。

#### 2.3.3 激活函数对模型性能的影响

激活函数直接影响模型的训练效率和最终的性能。如果激活函数选择不当,可能导致模型无法收敛或者泛化能力差。因此,在选择激活函数时,需要根据模型的具体情况,如数据特性、模型复杂度等因素综合考虑,以达到最优的模型性能。

在后续章节中,我们将会具体介绍和比较一些常用的激活函数,并通过实际案例分析它们在不同场合下的应用效果,以及如何在实际项目中进行优化选择。

# 3. 实践中激活函数的选择与应用

在深度学习模型的设计和应用中,激活函数的选择直接关系到模型的训练效率、性能以及泛化能力。本章节将深入探讨常用激活函数的实际应用场景,并分析其优缺点,最后提供一些激活函数优化与调优的技巧。

## 3.1 常用激活函数的实操对比

在神经网络中,不同的激活函数会影响模型的学习能力和性能。以下是三种最常用的激活函数的实操对比。

### 3.1.1 Sigmoid、Tanh与ReLU家族的比较

**Sigmoid 函数**曾经是深度学习中最常用的激活函数之一。它的数学形式简单,输出范围在 (0, 1) 之间,适合用于表示概率,因为它能将任意实数值压缩到 (0, 1) 的区间内。然而,Sigmoid 函数的缺点也十分明显,主要表现在其饱和性和梯度消失问题。

- 饱和性:当输入值远离原点时,导数接近于零,导致学习速度极慢。

- 梯度消失:由于在两端饱和导致梯度接近于零,反向传播时参数更新微乎其微,从而引起梯度消失问题。

**Tanh 函数**类似于 Sigmoid,但其输出范围是 (-1, 1)。Tanh 函数的中心对称点为零,这意味着它更倾向于输出零附近的值,这在某些情况下是可取的。然而,Tanh 同样会遇到和 Sigmoid 类似的问题,特别是在处理大输入值时。

```python

import numpy as np

import matplotlib.pyplot as plt

def sigmoid(x):

return 1 / (1 + np.exp(-x))

def tanh(x):

return np.tanh(x)

x = np.linspace(-10, 10, 100)

y1 = sigmoid(x)

y2 = tanh(x)

plt.plot(x, y1, label='Sigmoid')

plt.plot(x, y2, label='Tanh')

plt.title('Sigmoid vs Tanh')

plt.legend()

plt.show()

```

**ReLU 函数**,即线性整流函数,解决了 Sigmoid 和 Tanh 的梯度消失问题。当输入为正时,导数恒为 1,因此在正区间内具有非常快的学习速度。然而,ReLU 函数在输入

0

0