【回归分析算法优化】:MATLAB模型效率提升的7大秘技

发布时间: 2024-08-30 19:19:35 阅读量: 44 订阅数: 33

# 1. 回归分析算法概述

回归分析是统计学中研究变量之间关系的重要工具,尤其在预测、评估和建立因果模型方面有着广泛的应用。通过构建数学模型,它旨在描述一个或多个自变量与因变量之间的关系。本章将为读者提供对回归分析算法的全面概览,包括其基本概念、主要类型以及在实际应用中的重要性。

## 1.1 回归分析的定义和应用

回归分析是通过自变量预测因变量的过程,它通过收集数据、估计关系式、进行假设检验以及模型的验证来完成。它在经济学、金融、医学、工程等多个领域都有广泛的应用。

## 1.2 回归分析的主要类型

回归分析包括多种类型,如简单线性回归、多元线性回归、非线性回归等。每种类型的回归分析方法有其适用的场合和数据特性。例如,简单线性回归适用于两个变量之间存在线性关系的情况,而多元线性回归则可以同时处理多个自变量。

## 1.3 回归分析在数据科学中的作用

在数据科学领域,回归分析不仅用于建模和预测,还用于验证理论假设、控制变量影响以及进行敏感性分析。通过合适的回归模型,可以揭示数据背后的复杂关系和模式。

本章介绍了回归分析的基础知识,为后续章节中构建和优化MATLAB回归模型打下基础。在后续章节中,我们将探讨如何使用MATLAB实现这些模型,并深入讨论模型优化的策略和高级应用。

# 2. MATLAB回归模型的构建

## 2.1 基本线性回归模型的建立

### 2.1.1 理解线性回归的数学基础

线性回归是统计学中非常基础且应用广泛的方法,它用于建立一个或多个自变量(解释变量)和因变量(响应变量)之间的线性关系模型。最简单的线性回归是一元线性回归,其数学表达形式为:

Y = β0 + β1X + ε

其中,Y表示因变量,X表示自变量,β0和β1分别表示回归直线的截距和斜率,ε表示误差项。

### 2.1.2 使用MATLAB建立线性回归模型

MATLAB提供了简单易用的函数来构建线性回归模型。以下是通过MATLAB代码实现线性回归的一个基本示例。

```matlab

% 假设我们有两组数据X和Y,X为自变量,Y为因变量

X = [1, 2, 3, 4, 5]; % 示例数据,实际应用中应由真实数据填充

Y = [2, 4, 5, 4, 5]; % 示例数据,实际应用中应由真实数据填充

% 使用polyfit函数拟合线性模型

p = polyfit(X, Y, 1); % '1'表示拟合一阶多项式(线性模型)

% 使用polyval函数根据拟合得到的模型参数计算拟合曲线

Y_fit = polyval(p, X);

% 绘制原始数据和拟合模型

plot(X, Y, 'o', X, Y_fit, '-');

legend('原始数据', '线性拟合模型');

title('线性回归模型建立示例');

```

在上述代码中,`polyfit` 函数用于寻找最佳拟合线性模型的参数,`polyval` 函数用于根据这些参数计算拟合曲线。最后,使用 `plot` 函数将原始数据点和拟合得到的线性模型绘制在图表上。

## 2.2 非线性回归模型的构建

### 2.2.1 非线性模型的理论基础

非线性回归模型通常指的是模型的参数和自变量以非线性形式出现。例如,常见的非线性模型有对数模型、多项式模型和指数模型等。数学上,非线性模型的一般形式可以表示为:

Y = f(X, β) + ε

这里,函数 f 可以是任何非线性函数,β 是模型参数。

### 2.2.2 MATLAB中的非线性模型实现

在MATLAB中,可以使用 `fitnlm` 函数来构建非线性回归模型。以下是构建非线性回归模型的代码示例:

```matlab

% 假设我们有自变量X和因变量Y

X = [1, 2, 3, 4, 5]; % 示例数据

Y = [1.2, 1.8, 3.1, 4.2, 5.9]; % 示例数据

% 使用fitnlm函数拟合非线性模型

nlm = fitnlm(X, Y, 'y ~ a*exp(b*x)');

% 使用预测函数对模型进行预测

X_new = linspace(0, 5, 100); % 生成新的预测数据点

Y_pred = predict(nlm, X_new);

% 绘制原始数据和预测模型

plot(X, Y, 'o', X_new, Y_pred, '-');

legend('原始数据', '非线性预测模型');

title('非线性回归模型建立示例');

```

在这段代码中,`fitnlm` 函数拟合了一个指数函数形式的非线性模型,其中 'y ~ a*exp(b*x)' 表示因变量Y与自变量X之间存在指数关系。`predict` 函数用于计算新数据点上的预测值。

## 2.3 多元回归分析的实现

### 2.3.1 多元回归模型的构建步骤

多元回归分析是指一个因变量与两个或两个以上的自变量之间关系的统计分析。构建多元回归模型的步骤通常包括:

1. 数据准备:收集并整理包含多个自变量和一个因变量的数据集。

2. 模型设定:根据数据的特性和分析目的,设定多元回归模型的具体形式。

3. 参数估计:使用统计方法(如最小二乘法)来估计模型参数。

4. 模型诊断:评估模型的拟合效果,并检查残差分布、异常值和多重共线性等问题。

### 2.3.2 特征选择与模型优化

在多元回归模型中,特征选择是关键步骤之一,旨在识别出最有助于预测因变量的自变量。模型优化则关注于调整模型结构和参数,以提高预测性能。

在MATLAB中,可以使用`stepwiselm`函数进行特征选择和模型优化。该函数采用逐步回归算法自动选择最优的特征集。以下是一个使用`stepwiselm`函数的示例代码:

```matlab

% 假设我们有数据集data,其中包括多个自变量和一个因变量

data = load('regressionData'); % 假设该数据集已经包含了自变量和因变量

% 使用stepwiselm函数进行特征选择和模型优化

lm = stepwiselm(data, 'ResponseVar', 'y', 'PredictorVars', {'x1', 'x2', 'x3'}, 'Upper', 'interactions', 'PEnter', 0.05, 'PRemove', 0.1);

% 输出优化后的模型参数

disp(lm.Coefficients.Estimate);

% 绘制实际值与预测值的对比图

predictY = predict(lm, data);

actualY = data.y;

plot(actualY, predictY, 'o');

xlabel('实际值');

ylabel('预测值');

title('实际值与预测值对比');

grid on;

```

在上述代码中,`stepwiselm`函数对数据集`regressionData`中的变量进行特征选择,并构建优化后的多元回归模型。`'ResponseVar'`参数指定了因变量,`'PredictorVars'`参数列出了所有潜在的自变量。`'Upper'`参数定义了模型中可能包含的最高阶数,`'PEnter'`和`'PRemove'`参数定义了引入和剔除变量的显著性水平。最后,使用`predict`函数对模型进行预测,并将实际值与预测值绘制成图表进行对比分析。

# 3. 模型优化策略

## 3.1 数据预处理的技巧

数据预处理是机器学习和统计分析中至关重要的一步,它确保了输入到模型中的数据质量,直接影响到模型的性能和准确性。以下是几种常见的数据预处理技巧:

### 3.1.1 数据清洗方法

数据清洗的目的是识别并修正数据集中的错误和不一致性,以提高数据质量。常用的数据清洗方法包括:

- **缺失值处理**:缺失值可能是由于多种原因造成的,如设备故障、数据录入错误等。处理缺失值的方法包括删除含有缺失值的记录、填充缺失值(使用均值、中位数、众数或者基于模型的预测值)。

- **异常值处理**:异常值可能是数据录入错误或者实际的异常事件。通过统计测试(如箱线图、Z-score)识别异常值,然后决定是否删除或修正它们。

- **噪声数据处理**:噪声是数据中的随机误差或变异,可通过滤波器、平滑技术或数据转换来减少噪声的影响。

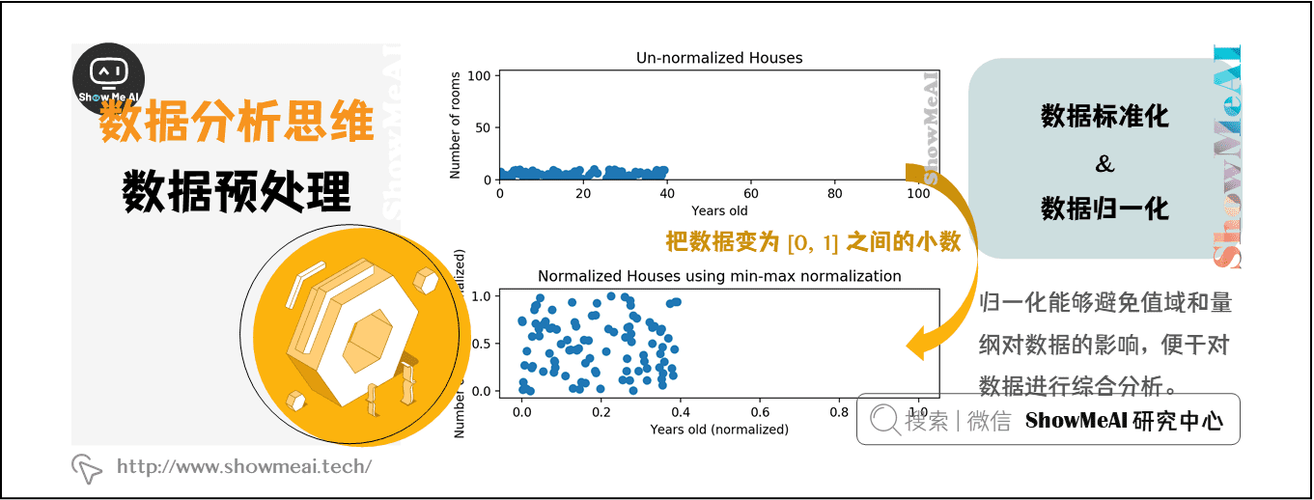

### 3.1.2 数据标准化和归一化

数据标准化和归一化是数据预处理中的两种常用技术,用于消除不

0

0