Python云计算:使用AWS和Azure构建云端应用,让你的程序翱翔天际

发布时间: 2024-06-19 17:52:02 阅读量: 62 订阅数: 33

云计算应用开发

# 1. Python云计算概述

云计算是一种按需提供的计算资源模型,它允许用户在不拥有或管理底层基础设施的情况下访问和使用计算资源。Python作为一种流行的编程语言,为云计算开发提供了丰富的库和工具。

云计算平台提供各种服务,包括弹性计算、存储、数据库、分析和机器学习。这些服务可以帮助企业和开发人员快速构建、部署和管理应用程序。Python云计算库使开发人员能够轻松地与这些服务交互,从而简化云计算应用程序的开发。

# 2. AWS云计算平台

### 2.1 AWS云服务简介

AWS(Amazon Web Services)是亚马逊公司提供的云计算平台,提供广泛的云服务,包括计算、存储、数据库、网络和分析等。

#### 2.1.1 弹性计算云(EC2)

EC2(Elastic Compute Cloud)是AWS提供的虚拟服务器服务,允许用户在云中创建和管理虚拟机(VM)。EC2提供各种类型的虚拟机实例,具有不同的CPU、内存和存储配置。

#### 2.1.2 简单存储服务(S3)

S3(Simple Storage Service)是AWS提供的对象存储服务,用于存储和检索任何类型的数据。S3提供高可用性和可扩展性,并支持各种存储类,以满足不同的数据访问和成本要求。

#### 2.1.3 关系型数据库服务(RDS)

RDS(Relational Database Service)是AWS提供的托管数据库服务,支持多种数据库引擎,包括MySQL、PostgreSQL和Oracle。RDS提供自动化的数据库管理,包括备份、恢复和扩展。

### 2.2 AWS云计算实践

#### 2.2.1 创建和管理EC2实例

**创建EC2实例**

```

import boto3

# 创建EC2客户端

ec2 = boto3.client('ec2')

# 指定实例参数

instance_type = 't2.micro'

image_id = 'ami-00000000'

key_name = 'my-key-pair'

security_group_ids = ['sg-00000000']

# 创建EC2实例

response = ec2.run_instances(

ImageId=image_id,

InstanceType=instance_type,

KeyName=key_name,

SecurityGroupIds=security_group_ids,

MinCount=1,

MaxCount=1

)

# 获取实例ID

instance_id = response['Instances'][0]['InstanceId']

```

**管理EC2实例**

```

import boto3

# 创建EC2客户端

ec2 = boto3.client('ec2')

# 启动实例

ec2.start_instances(InstanceIds=['instance-id'])

# 停止实例

ec2.stop_instances(InstanceIds=['instance-id'])

# 终止实例

ec2.terminate_instances(InstanceIds=['instance-id'])

```

#### 2.2.2 使用S3存储和管理数据

**存储数据到S3**

```

import boto3

# 创建S3客户端

s3 = boto3.client('s3')

# 指定桶名称和文件路径

bucket_name = 'my-bucket'

file_path = 'my-file.txt'

# 上传文件到S3

s3.upload_file(file_path, bucket_name, file_path)

```

**管理S3数据**

```

import boto3

# 创建S3客户端

s3 = boto3.client('s3')

# 列出桶中的对象

response = s3.list_objects(Bucket='my-bucket')

for obj in response['Contents']:

print(obj['Key'])

# 删除对象

s3.delete_object(Bucket='my-bucket', Key='my-file.txt')

```

#### 2.2.3 使用RDS创建和管理数据库

**创建RDS数据库**

```

import boto3

# 创建RDS客户端

rds = boto3.client('rds')

# 指定数据库参数

db_name = 'my-database'

db_instance_class = 'db.t2.micro'

engine = 'mysql'

# 创建RDS数据库实例

response = rds.create_db_instance(

DBName=db_name,

DBInstanceClass=db_instance_class,

Engine=engine,

MasterUsername='my-username',

MasterUserPassword='my-password'

)

# 获取数据库实例ID

db_instance_id = response['DBInstance']['DBInstanceIdentifier']

```

**管理RDS数据库**

```

import boto3

# 创建RDS客户端

rds = boto3.client('rds')

# 启动数据库实例

rds.start_db_instance(DBInstanceIdentifier='db-instance-id')

# 停止数据库实例

rds.stop_db_instance(DBInstanceIdentifier='db-instance-id')

# 删除数据库实例

rds.delete_db_instance(DBInstanceIdentifier='db-instance-id')

```

# 3.1 Azure云服务简介

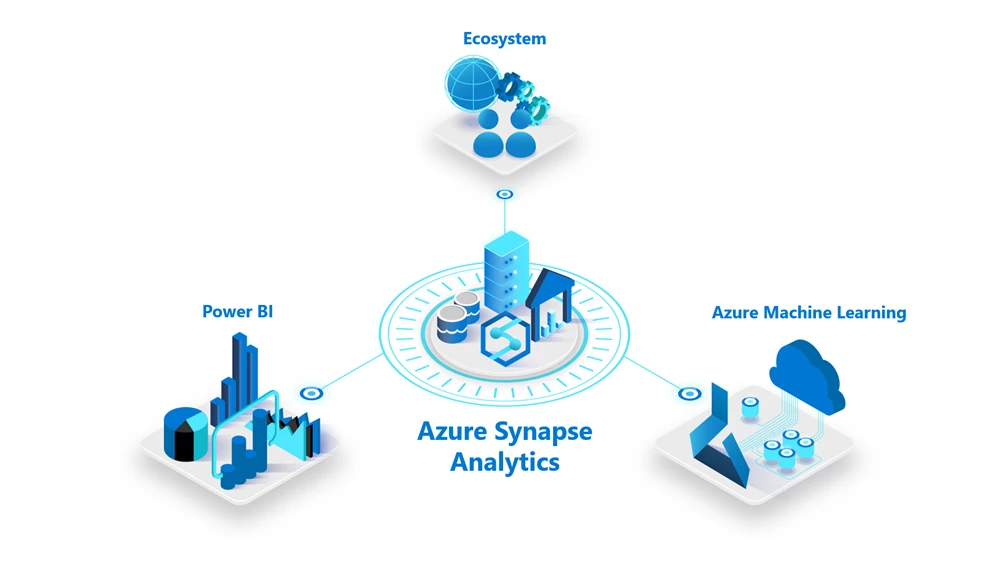

Azure云平台提供了一系列全面的云服务,涵盖计算、存储、数据库、分析、人工智能和机器学习等各个方面。这些服务旨在帮助企业和开发人员构建、部署和管理应用程序和解决方案。

#### 3.1.1 虚拟机(VM)

Azure虚拟机(VM)是云中运行的虚拟计算机,提供与物理服务器相同的可扩展性和灵活性。Azure VM支持各种操作系统,包括Windows、Linux和BSD。用户可以根据需要创建和管理虚拟机,并根据应用程序的需求调整其计算资源。

#### 3.1.2 存储服务(Blob、文件、表)

Azure存储服务提供了一系列数据存储选项,包括Blob、文件和表。

- **Blob存储**:Blob存储是用于存储大量非结构化数据的对象存储服务。它适用于存储图像、视频、音频文件和文档等内容。

- **文件存储**:文件存储提供了一个文件系统,允许用户在云中存储和管理文件。它适用于存储结构化数据,例如应用程序数据和用户文件。

- **表存储**:表存储是一个NoSQL数据库服务,用于存储结构化数据。它适用于存储键值对数据,例如用户配置文件和应用程序设置。

#### 3.1.3 数据库服务(SQL数据库、Cosmos DB)

Azure提供了一系列数据库服务,包括SQL数据库和Cosmos DB。

- **SQL数据库**:SQL数据库是一个完全托管的PaaS(平台即服务)关系型数据库服务。它支持SQL Server数据库引擎,并提供高可用性、可扩展性和安全功能。

- **Cosmos DB**:Cosmos DB是一个全球分布式、多模型数据库服务。它支持NoSQL和SQL数据模型,并提供低延迟、高吞吐量和全球一致性。

# 4. Python云计算开发

### 4.1 Python云计算库

#### 4.1.1 boto3(AWS)

boto3是AWS提供的官方Python SDK,它提供了对AWS服务的全面访问。它提供了对所有AWS服务的低级和高级API的访问,包括EC2、S3、RDS和Lambda。

**参数说明:**

* `region_name`: AWS区域,例如“us-east-1”

* `aws_access_key_id`: AWS访问密钥ID

* `aws_secret_access_key`: AWS秘密访问密钥

**代码块:**

```python

import boto3

# 创建一个EC2客户端

ec2_client = boto3.client('ec2', region_name='us-east-1', aws_access_key_id='YOUR_ACCESS_KEY_ID', aws_secret_access_key='YOUR_SECRET_ACCESS_KEY')

# 获取所有EC2实例

instances = ec2_client.describe_instances()

# 打印实例信息

for reservation in instances['Reservations']:

for instance in reservation['Instances']:

print(f"Instance ID: {instance['InstanceId']}")

print(f"Instance Type: {instance['InstanceType']}")

print(f"Instance State: {instance['State']['Name']}")

```

**逻辑分析:**

1. 导入boto3库。

2. 创建一个EC2客户端对象,并指定AWS区域、访问密钥ID和秘密访问密钥。

3. 使用`describe_instances()`方法获取所有EC2实例。

4. 遍历实例信息,并打印实例ID、实例类型和实例状态。

#### 4.1.2 azure-storage-blob(Azure)

azure-storage-blob是Azure提供的官方Python SDK,它提供了对Azure存储服务的访问。它提供了对Blob存储、文件存储和表存储的低级和高级API的访问。

**参数说明:**

* `account_name`: Azure存储帐户名称

* `account_key`: Azure存储帐户密钥

**代码块:**

```python

from azure.storage.blob import BlobServiceClient

# 创建一个BlobServiceClient对象

blob_service_client = BlobServiceClient(account_name='YOUR_ACCOUNT_NAME', account_key='YOUR_ACCOUNT_KEY')

# 获取所有Blob容器

containers = blob_service_client.list_containers()

# 打印容器信息

for container in containers:

print(f"Container Name: {container.name}")

print(f"Container Public Access: {container.public_access}")

```

**逻辑分析:**

1. 导入azure-storage-blob库。

2. 创建一个BlobServiceClient对象,并指定Azure存储帐户名称和帐户密钥。

3. 使用`list_containers()`方法获取所有Blob容器。

4. 遍历容器信息,并打印容器名称和容器公共访问级别。

### 4.2 Python云计算实践

#### 4.2.1 使用boto3管理AWS资源

boto3可以用来管理AWS资源,例如EC2实例、S3存储桶和RDS数据库。它提供了对AWS服务的低级和高级API的访问,使您可以自动化任务和构建复杂的应用程序。

**代码块:**

```python

import boto3

# 创建一个EC2客户端

ec2_client = boto3.client('ec2', region_name='us-east-1')

# 创建一个EC2实例

instance = ec2_client.run_instances(

ImageId='ami-id',

InstanceType='t2.micro',

MinCount=1,

MaxCount=1,

KeyName='my-key-pair'

)

# 打印实例信息

print(f"Instance ID: {instance['Instances'][0]['InstanceId']}")

print(f"Instance Type: {instance['Instances'][0]['InstanceType']}")

print(f"Instance State: {instance['Instances'][0]['State']['Name']}")

```

**逻辑分析:**

1. 导入boto3库。

2. 创建一个EC2客户端对象,并指定AWS区域。

3. 使用`run_instances()`方法创建一个EC2实例,并指定AMI ID、实例类型、最小和最大实例数以及密钥对。

4. 打印实例信息,包括实例ID、实例类型和实例状态。

#### 4.2.2 使用azure-storage-blob管理Azure存储

azure-storage-blob可以用来管理Azure存储资源,例如Blob容器、Blob和文件。它提供了对Azure存储服务的低级和高级API的访问,使您可以自动化任务和构建复杂的应用程序。

**代码块:**

```python

from azure.storage.blob import BlobServiceClient

# 创建一个BlobServiceClient对象

blob_service_client = BlobServiceClient(account_name='YOUR_ACCOUNT_NAME', account_key='YOUR_ACCOUNT_KEY')

# 创建一个Blob容器

container_client = blob_service_client.create_container('my-container')

# 上传一个Blob

blob_client = container_client.upload_blob('my-blob', 'Hello, world!')

# 下载一个Blob

with open('my-blob-downloaded', 'wb') as f:

blob_client.download_blob().download_to_stream(f)

```

**逻辑分析:**

1. 导入azure-storage-blob库。

2. 创建一个BlobServiceClient对象,并指定Azure存储帐户名称和帐户密钥。

3. 创建一个Blob容器。

4. 上传一个Blob到容器中。

5. 下载一个Blob到本地文件中。

# 5. Python云计算应用案例

### 5.1 云端数据分析

云计算平台提供了强大的数据分析能力,使企业能够处理和分析海量数据,从而获得有价值的见解。Python在云端数据分析中扮演着至关重要的角色,提供了丰富的库和工具,简化了数据处理和分析任务。

#### 5.1.1 使用AWS Athena进行大数据分析

AWS Athena是一个交互式查询服务,允许用户直接查询存储在S3中的数据。它支持标准SQL语法,使数据分析人员能够轻松地从各种数据源提取见解。

```python

import boto3

# 创建Athena客户端

client = boto3.client('athena')

# 查询数据

query = """

SELECT * FROM my_table

WHERE year = 2023

response = client.start_query_execution(

QueryString=query,

QueryExecutionContext={

'Database': 'my_database'

}

)

# 获取查询结果

query_execution_id = response['QueryExecutionId']

results = client.get_query_results(QueryExecutionId=query_execution_id)

# 打印结果

for row in results['ResultSet']['Rows']:

print(row['Data'])

```

**逻辑分析:**

* 使用boto3库创建AWS Athena客户端。

* 使用start_query_execution方法执行SQL查询。

* 使用get_query_results方法获取查询结果。

* 遍历结果集并打印每行数据。

#### 5.1.2 使用Azure HDInsight进行大数据分析

Azure HDInsight是一个托管式大数据服务,支持Apache Hadoop、Spark和Hive等框架。它提供了对Hadoop生态系统工具和技术的无缝访问,使企业能够高效地处理和分析大数据。

```python

from azure.storage.blob import BlobServiceClient

from azure.storage.filedatalake import DataLakeServiceClient

# 创建Blob存储客户端

blob_client = BlobServiceClient.from_connection_string(AZURE_STORAGE_CONNECTION_STRING)

# 创建Data Lake存储客户端

datalake_client = DataLakeServiceClient.from_connection_string(AZURE_STORAGE_CONNECTION_STRING)

# 创建HDInsight集群

cluster_name = 'my-cluster'

cluster_create_response = datalake_client.create_cluster(

cluster_name,

location='eastus',

cluster_size=3,

node_type='Standard_D12_v2'

)

# 提交Hive查询

hive_query = """

SELECT * FROM my_table

WHERE year = 2023

cluster_client = datalake_client.get_cluster(cluster_name)

query_submit_response = cluster_client.submit_hive_job(

hive_query

)

# 获取查询结果

query_results = cluster_client.get_hive_job_output(query_submit_response.job_id)

# 打印结果

for row in query_results:

print(row)

```

**逻辑分析:**

* 使用azure-storage-blob库创建Blob存储客户端。

* 使用azure-storage-filedatalake库创建Data Lake存储客户端。

* 使用create_cluster方法创建HDInsight集群。

* 使用submit_hive_job方法提交Hive查询。

* 使用get_hive_job_output方法获取查询结果。

* 遍历结果集并打印每行数据。

# 6.2 云计算成本优化

### 6.2.1 AWS成本优化策略

**1. 选择合适的实例类型**

根据工作负载选择最具成本效益的实例类型。AWS提供了各种实例类型,针对不同的需求和预算进行了优化。

**2. 使用预留实例**

预留实例(RI)提供预先支付的实例容量,可以节省高达 75% 的费用。RI适用于长期稳定的工作负载。

**3. 使用按需实例**

按需实例按小时计费,适合临时或不可预测的工作负载。

**4. 使用抢占式实例**

抢占式实例比按需实例便宜得多,但可能会被AWS收回。适合非关键任务或容错工作负载。

**5. 使用Spot Fleet**

Spot Fleet是一种自动扩展服务,可以根据可用性和成本动态启动和终止实例。

### 6.2.2 Azure成本优化策略

**1. 选择合适的VM大小**

与AWS类似,Azure提供各种VM大小,针对不同的需求和预算进行了优化。

**2. 使用预留VM实例**

预留VM实例与AWS的RI类似,提供预先支付的VM容量,可以节省高达 72% 的费用。

**3. 使用低优先级VM**

低优先级VM比常规VM便宜,但性能较低。适合非关键任务或后台处理。

**4. 使用自动缩放**

自动缩放可以根据工作负载自动调整VM数量,从而优化成本。

**5. 使用Azure Advisor**

Azure Advisor是一个免费工具,可以提供成本优化建议,例如识别未使用的资源或建议使用更具成本效益的实例类型。

0

0