Python深度学习入门:使用TensorFlow和Keras构建神经网络,让机器像人一样思考

发布时间: 2024-06-19 17:59:33 阅读量: 72 订阅数: 33

Python深度学习入门:TensorFlow与Keras

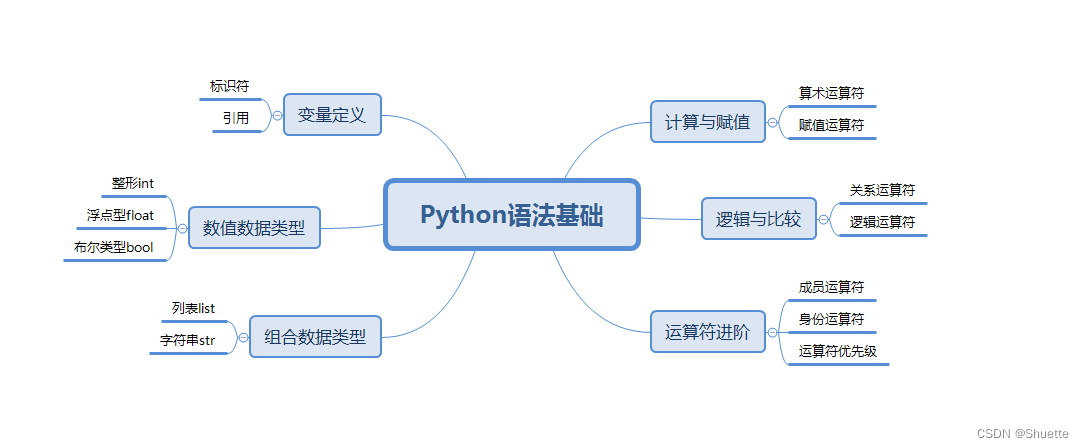

# 1. Python深度学习基础**

Python是深度学习中最流行的编程语言之一,因为它具有丰富的库和社区支持。本章将介绍Python深度学习的基础知识,包括:

- Python深度学习库的概述,如TensorFlow、Keras和PyTorch

- Python数据处理和可视化工具,如NumPy、Pandas和Matplotlib

- Python深度学习环境的设置和配置

# 2. TensorFlow与Keras深度学习框架

### 2.1 TensorFlow简介与安装

#### 2.1.1 TensorFlow的架构与组件

TensorFlow是一个开源的深度学习框架,由谷歌开发。它提供了一组用于构建和训练机器学习模型的工具。TensorFlow的架构基于数据流图,其中节点表示操作,而边表示数据流。

TensorFlow的主要组件包括:

- **Tensor:**表示多维数组,是TensorFlow中的基本数据结构。

- **Operation:**表示执行特定操作的节点,例如加法或卷积。

- **Session:**用于执行TensorFlow图并计算结果。

- **Variable:**表示可训练的参数,在训练过程中更新。

#### 2.1.2 TensorFlow的安装与配置

在不同平台上安装TensorFlow的方法有所不同。对于Python环境,可以通过pip安装:

```python

pip install tensorflow

```

安装完成后,可以通过以下代码导入TensorFlow:

```python

import tensorflow as tf

```

### 2.2 Keras简介与安装

#### 2.2.1 Keras的优势与特点

Keras是一个高级神经网络API,构建在TensorFlow之上。它提供了一组更高级别的抽象,简化了深度学习模型的构建和训练过程。Keras的主要优点包括:

- **用户友好:**Keras的API简单易用,降低了深度学习模型开发的入门门槛。

- **模块化:**Keras提供了一系列预先构建的层和模型,允许用户轻松地组装和定制自己的模型。

- **可扩展:**Keras与TensorFlow紧密集成,允许用户在需要时访问底层TensorFlow功能。

#### 2.2.2 Keras的安装与使用

Keras可以通过pip安装:

```python

pip install keras

```

安装完成后,可以通过以下代码导入Keras:

```python

import keras

```

Keras提供了以下主要模块:

- **layers:**用于构建神经网络层的模块。

- **models:**用于构建和训练神经网络模型的模块。

- **optimizers:**用于优化模型参数的模块。

- **losses:**用于计算模型损失的模块。

### 代码示例:TensorFlow与Keras模型构建

以下代码示例演示了如何使用TensorFlow和Keras构建一个简单的线性回归模型:

```python

# TensorFlow

import tensorflow as tf

# 创建一个TensorFlow会话

session = tf.Session()

# 定义输入和输出变量

input_x = tf.placeholder(tf.float32, shape=[None, 1])

output_y = tf.placeholder(tf.float32, shape=[None, 1])

# 定义模型参数

weight = tf.Variable(tf.random_normal([1, 1]))

bias = tf.Variable(tf.random_normal([1]))

# 定义模型

output = tf.add(tf.matmul(input_x, weight), bias)

# 定义损失函数

loss = tf.reduce_mean(tf.square(output - output_y))

# 定义优化器

optimizer = tf.train.GradientDescentOptimizer(learning_rate=0.01)

# 训练模型

for i in range(1000):

# 准备训练数据

x_train = np.random.rand(100, 1)

y_train = np.random.rand(100, 1)

# 运行训练操作

session.run(optimizer.minimize(loss), feed_dict={input_x: x_train, output_y: y_train})

# Keras

import keras

# 创建一个Keras模型

model = keras.Sequential()

# 添加一个Dense层

model.add(keras.layers.Dense(1, input_shape=(1,)))

# 定义损失函数和优化器

model.compile(loss='mean_squared_error', optimizer='adam')

# 训练模型

model.fit(x_train, y_train, epochs=1000)

```

# 3.2 神经网络的构建

#### 3.2.1 神经网络层与激活函数

神经网络是由多个神经元层叠而成,每个神经元层负责处理输入数据并输出一个结果。神经元层可以分为输入层、隐含层和输出层。

**输入层**接收原始输入数据,不进行任何处理。

**隐含层**位于输入层和输出层之间,负责提取输入数据的特征和模式。隐含层可以有多个,每个隐含层包含多个神经元。

**输出层**输出神经网络的最终结果,通常是一个分类或回归值。

**激活函数**是神经元中用于将输入信号转换为输出信号的函数。激活函数是非线性的,这意味着它们可以引入非线性关系,从而使神经网络能够学习复杂的数据模式。常用的激活函数包括:

* **Sigmoid函数:**将输入信号映射到0到1之间的值,常用于二分类任务。

* **Tanh函数:**将输入信号映射到-1到1之间的值,常用于回归任务。

* **ReLU函数:**将输入信号映射到非负值,常用于深度神经网络中。

#### 3.2.2 神经网络模型的搭建

神经网络模型的搭建包括定义网络结构、初始化权重和偏置、前向传播和反向传播。

**定义网络结构**是指定神经网络的层数、每层的神经元数量和激活函数。

**初始化权重和偏置**是为神经网络中的每个权重和偏置分配初始值。权重和偏置是神经网络学习过程中调整的参数。

**前向传播**是将输入数据通过神经网络,逐层计算每个神经元的输出。

**反向传播**是计算神经网络输出与预期输出之间的误差,并使用误差反向传播到网络中,更新权重和偏置。

神经网络模型的搭建通常使用深度学习框架,如TensorFlow或Keras,这些框架提供了方便的API来定义和训练神经网络模型。

# 4. TensorFlow与Keras构建神经网络

### 4.1 TensorFlow构建神经网络

#### 4.1.1 TensorFlow神经网络模型的创建

在TensorFlow中,神经网络模型的创建主要通过以下步骤:

1. **定义模型架构:**使用`tf.keras.Sequential`类或`tf.keras.Model`子类定义模型的层结构。

2. **编译模型:**使用`model.compile`方法指定损失函数、优化器和度量指标。

3. **训练模型:**使用`model.fit`方法训练模型,指定训练数据、标签、批次大小和训练轮数。

**代码块:**

```python

import tensorflow as tf

# 定义模型架构

model = tf.keras.Sequential([

tf.keras.layers.Dense(units=10, activation='relu', input_shape=(784,)),

tf.keras.layers.Dense(units=10, activation='softmax')

])

# 编译模型

model.compile(optimizer='adam', loss='sparse_categorical_crossentropy', metrics=['accuracy'])

# 训练模型

model.fit(x_train, y_train, epochs=10, batch_size=32)

```

**逻辑分析:**

* `tf.keras.Sequential([...]):` 创建一个顺序神经网络模型,其中括号内指定了模型的层结构。

* `model.compile(optimizer='adam', loss='sparse_categorical_crossentropy', metrics=['accuracy']):` 编译模型,指定优化器为Adam,损失函数为稀疏分类交叉熵,度量指标为准确率。

* `model.fit(x_train, y_train, epochs=10, batch_size=32):` 训练模型,使用训练数据`x_train`和标签`y_train`,训练轮数为10,批次大小为32。

#### 4.1.2 TensorFlow神经网络模型的训练与评估

训练好的TensorFlow神经网络模型可以通过以下方法进行评估:

1. **评估模型:**使用`model.evaluate`方法评估模型在验证集或测试集上的性能。

2. **预测结果:**使用`model.predict`方法对新数据进行预测。

**代码块:**

```python

# 评估模型

loss, accuracy = model.evaluate(x_test, y_test)

print("Loss:", loss, "Accuracy:", accuracy)

# 预测结果

predictions = model.predict(x_new)

```

**逻辑分析:**

* `model.evaluate(x_test, y_test):` 评估模型在测试集`x_test`和`y_test`上的性能,返回损失值和准确率。

* `model.predict(x_new):` 对新数据`x_new`进行预测,返回预测结果。

### 4.2 Keras构建神经网络

#### 4.2.1 Keras神经网络模型的创建

在Keras中,神经网络模型的创建与TensorFlow类似,但提供了更高级别的API:

1. **创建模型:**使用`keras.models.Sequential`或`keras.models.Model`创建模型。

2. **添加层:**使用`model.add`方法向模型添加层。

3. **编译模型:**使用`model.compile`方法指定损失函数、优化器和度量指标。

**代码块:**

```python

import keras

# 创建模型

model = keras.Sequential()

# 添加层

model.add(keras.layers.Dense(units=10, activation='relu', input_shape=(784,)))

model.add(keras.layers.Dense(units=10, activation='softmax'))

# 编译模型

model.compile(optimizer='adam', loss='sparse_categorical_crossentropy', metrics=['accuracy'])

```

**逻辑分析:**

* `keras.Sequential():` 创建一个顺序神经网络模型。

* `model.add(keras.layers.Dense(units=10, activation='relu', input_shape=(784,))):` 向模型添加一个具有10个神经元、ReLU激活函数和输入形状为(784,)的密集层。

* `model.add(keras.layers.Dense(units=10, activation='softmax')):` 向模型添加一个具有10个神经元和softmax激活函数的密集层。

* `model.compile(optimizer='adam', loss='sparse_categorical_crossentropy', metrics=['accuracy']):` 编译模型,指定优化器为Adam,损失函数为稀疏分类交叉熵,度量指标为准确率。

#### 4.2.2 Keras神经网络模型的训练与评估

训练好的Keras神经网络模型可以通过以下方法进行评估:

1. **评估模型:**使用`model.evaluate`方法评估模型在验证集或测试集上的性能。

2. **预测结果:**使用`model.predict`方法对新数据进行预测。

**代码块:**

```python

# 评估模型

loss, accuracy = model.evaluate(x_test, y_test)

print("Loss:", loss, "Accuracy:", accuracy)

# 预测结果

predictions = model.predict(x_new)

```

**逻辑分析:**

* `model.evaluate(x_test, y_test):` 评估模型在测试集`x_test`和`y_test`上的性能,返回损失值和准确率。

* `model.predict(x_new):` 对新数据`x_new`进行预测,返回预测结果。

# 5. 神经网络的训练与优化

### 5.1 神经网络的训练过程

#### 5.1.1 损失函数与优化算法

神经网络的训练过程本质上是一个优化问题,目标是找到一组权重和偏差,使模型在给定数据集上的损失函数最小化。损失函数衡量模型预测与真实标签之间的差异,常见的损失函数包括均方误差(MSE)和交叉熵。

优化算法的作用是迭代更新模型的权重和偏差,以最小化损失函数。常用的优化算法包括梯度下降、动量法和Adam算法。这些算法通过计算损失函数的梯度,并沿梯度负方向更新权重和偏差,逐步逼近最优解。

#### 5.1.2 神经网络的训练过程与超参数调整

神经网络的训练过程涉及多个超参数,包括学习率、批大小和正则化参数。这些超参数对模型的训练和泛化性能有显著影响。

* **学习率:**控制权重和偏差更新的步长。较高的学习率可能导致不稳定或发散的训练,而较低的学习率可能导致收敛缓慢。

* **批大小:**指定每次更新权重和偏差时使用的样本数量。较大的批大小可以提高训练效率,但可能导致模型过拟合。

* **正则化参数:**用于防止模型过拟合。常见的正则化技术包括L1正则化和L2正则化,它们通过向损失函数添加惩罚项来抑制权重的过大值。

### 5.2 神经网络的优化方法

#### 5.2.1 正则化技术

正则化技术通过惩罚模型的复杂性来防止过拟合。常见的正则化技术包括:

* **L1正则化(Lasso回归):**向损失函数添加权重绝对值的惩罚项,从而抑制权重的过大值。

* **L2正则化(岭回归):**向损失函数添加权重平方和的惩罚项,从而抑制权重的过大值。

* **Dropout:**在训练过程中随机丢弃一部分神经元,迫使模型学习更鲁棒的特征。

#### 5.2.2 迁移学习与微调

迁移学习是一种利用预训练模型来提高新任务模型性能的技术。预训练模型通常在大型数据集上训练,已经学习了通用特征。通过迁移学习,我们可以将预训练模型的权重作为新任务模型的初始化权重,并微调这些权重以适应新任务。

微调是一种迁移学习技术,它只更新预训练模型的部分权重,而保持其他权重不变。这有助于在新任务上快速获得较好的性能,同时避免过拟合。

# 6.1 图像分类与识别

### 6.1.1 图像分类任务与数据集

图像分类是计算机视觉领域的一项基本任务,其目标是将图像分配到预定义的类别中。常见的图像分类任务包括:

- **物体检测:**识别图像中是否存在特定对象。

- **场景识别:**确定图像中描绘的场景类型。

- **人脸识别:**识别图像中的人脸并确定其身份。

用于图像分类的常见数据集包括:

- **ImageNet:**包含超过 1400 万张图像,涵盖 22000 多个类别。

- **CIFAR-10:**包含 60000 张 32x32 像素的彩色图像,分为 10 个类别。

- **MNIST:**包含 70000 张 28x28 像素的手写数字图像,分为 10 个类别。

### 6.1.2 图像分类神经网络的构建与训练

用于图像分类的神经网络通常采用卷积神经网络 (CNN) 架构。CNN 具有以下特点:

- **卷积层:**提取图像中的局部特征。

- **池化层:**减少特征图的大小并提高鲁棒性。

- **全连接层:**将提取的特征映射到类别概率。

构建图像分类神经网络的步骤如下:

1. **加载和预处理图像:**将图像加载到内存中并对其进行缩放、裁剪和归一化等预处理。

2. **创建神经网络模型:**定义神经网络的架构,包括层类型、激活函数和优化器。

3. **训练神经网络:**使用训练数据集训练神经网络,调整模型参数以最小化损失函数。

4. **评估神经网络:**使用验证数据集评估神经网络的性能,并根据需要调整超参数。

5. **部署神经网络:**将训练好的神经网络部署到生产环境中,用于图像分类任务。

以下代码示例展示了如何使用 TensorFlow 构建和训练一个简单的图像分类神经网络:

```python

import tensorflow as tf

# 加载和预处理图像

(x_train, y_train), (x_test, y_test) = tf.keras.datasets.mnist.load_data()

x_train, x_test = x_train / 255.0, x_test / 255.0

# 创建神经网络模型

model = tf.keras.models.Sequential([

tf.keras.layers.Flatten(input_shape=(28, 28)),

tf.keras.layers.Dense(128, activation='relu'),

tf.keras.layers.Dropout(0.2),

tf.keras.layers.Dense(10, activation='softmax')

])

# 编译神经网络

model.compile(optimizer='adam',

loss='sparse_categorical_crossentropy',

metrics=['accuracy'])

# 训练神经网络

model.fit(x_train, y_train, epochs=10)

# 评估神经网络

model.evaluate(x_test, y_test)

```

0

0