【HDFS读写故障诊断】:专家级别的系统管理员必备技能

发布时间: 2024-10-25 19:50:56 阅读量: 1 订阅数: 4

# 1. HDFS基础与架构解析

在本章,我们将揭开Hadoop分布式文件系统(HDFS)的神秘面纱。HDFS是大数据存储的基石,它将大数据存储问题简化为一系列可管理的块(block)存储。这些块由专用的存储节点维护,可以分布在普通的商用硬件上。

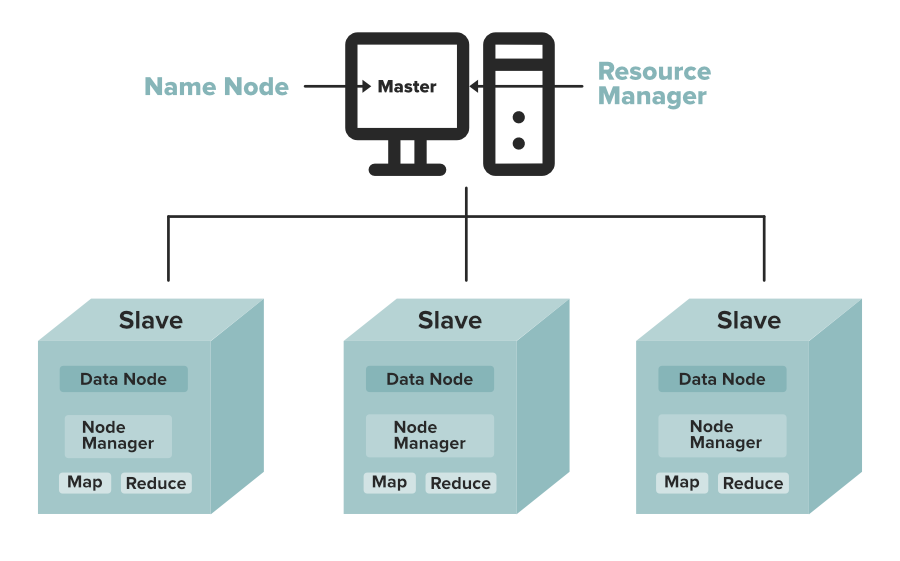

HDFS的架构由三个核心组件构成:NameNode,DataNode和Secondary NameNode。NameNode是整个文件系统的"大脑",负责管理文件系统的命名空间,维护文件系统树以及整个HDFS的元数据。DataNode则在集群中实际存储数据,每个DataNode负责管理其所在节点的数据块。Secondary NameNode帮助NameNode合并编辑日志,并减少内存消耗,虽然它并不替代主NameNode,但有助于系统的稳定运行。

数据存储原理是HDFS的一个重要概念,它将大型文件划分为一系列块,这些块默认大小为64MB到256MB(具体取决于Hadoop的版本和配置)。块的概念不仅优化了数据读取速度,还提高了系统的容错能力。数据被存储在多个DataNode上,而NameNode则管理这些数据块与节点的映射关系。这种设计使得即使在硬件故障的情况下,数据的可靠性也能得到保障。

```markdown

## HDFS简介:分布式存储的基石

HDFS以其高容错性、适合大数据存储和高吞吐量的特点,在大数据领域扮演着核心角色。通过分布式存储,HDFS能够存储PB级别的数据,满足了大规模数据处理的需求。

## HDFS架构组件:NameNode、DataNode与Secondary NameNode

- NameNode:主控节点,管理文件系统的命名空间和客户端对文件的访问。

- DataNode:存储节点,负责存储实际数据,处理数据的读写请求。

- Secondary NameNode:辅助节点,负责定期合并编辑日志和文件系统的状态快照,辅助NameNode减轻内存压力。

## HDFS数据存储原理:块(Block)的概念与管理

块(Block)是HDFS存储的基本单位,将大文件分解为多个块,分散存储在多个DataNode中,这样即使部分节点失败,数据也不会丢失,因为数据是多副本存储的。

```

# 2. HDFS读写流程深入理解

## HDFS写入流程:客户端操作、NameNode决策与DataNode存储

### HDFS写入过程概述

在Hadoop分布式文件系统(HDFS)中,写入过程是从客户端开始的。当客户端需要存储数据时,首先会与NameNode进行通信,请求创建一个新的文件。在获取到NameNode的许可后,客户端开始将数据分成一系列的块(block),并开始向不同的DataNode发送这些数据块。

### 客户端操作细节

客户端在写入数据时,需要执行以下步骤:

1. **获取NameNode许可**:客户端向NameNode发送写入请求,NameNode根据当前的文件系统状态,决定是否接受请求并指定哪些DataNode用于存储数据。

2. **数据分块**:数据被分成一系列的块,每个块的默认大小为128MB(在Hadoop 2.x及以后版本中,默认大小为256MB)。

3. **写入数据**:客户端并行地将数据块发送到指定的DataNode。这个过程涉及到数据的复制,以确保系统的容错性和数据可靠性。

4. **发送确认**:数据块被写入到DataNode后,DataNode会向客户端发送写入成功的确认信息。只有当客户端收到所有数据块成功写入的确认后,才会通知NameNode写入完成。

### NameNode决策机制

NameNode在接收到写入请求后,会进行以下决策:

1. **确定数据块的存储位置**:NameNode根据当前集群的使用情况,以及数据副本策略(默认为3个副本)来确定数据块的存储位置。

2. **管理元数据**:一旦数据块开始被写入,NameNode需要更新文件系统的元数据,包括文件的块映射信息、权限和属性等。

3. **维持数据副本的一致性**:NameNode需要确保各个副本之间保持同步,如果某个副本因为故障而丢失,NameNode会调度副本的重新创建。

### DataNode存储过程

DataNode作为HDFS的数据存储节点,其写入过程包括:

1. **接收数据块**:DataNode从客户端接收数据块。

2. **本地写入**:在确保磁盘空间足够的情况下,DataNode将数据块写入到本地的文件系统中。

3. **发送写入确认**:数据块写入完成后,DataNode向客户端发送写入成功确认。

4. **副本同步**:DataNode之间通过心跳机制和块报告来同步数据块副本,确保副本之间的数据一致性。

```mermaid

sequenceDiagram

participant C as Client

participant NN as NameNode

participant DN1 as DataNode1

participant DN2 as DataNode2

participant DN3 as DataNode3

C ->>+ NN: 请求创建文件/写入数据

Note over NN: 决定数据块存储位置

NN ->>+ DN1: 指示存储数据块1

NN ->>+ DN2: 指示存储数据块2

NN ->>+ DN3: 指示存储数据块3

DN1 ->>+ C: 写入成功确认1

DN2 ->>+ C: 写入成功确认2

DN3 ->>+ C: 写入成功确认3

C ->>+ NN: 通知写入完成

NN ->>+ DN1: 检查副本同步

NN ->>+ DN2: 检查副本同步

NN ->>+ DN3: 检查副本同步

```

### 代码块示例与分析

以下是一个简化的HDFS客户端写入操作的伪代码:

```java

// 伪代码,不代表真实的HDFS客户端API

public void writeData(String filePath, String data) throws IOException {

// 1. 获取NameNode许可

List<DataNode> dataNodes = nameNode.allocateDataNodes(filePath);

// 2. 数据分块与并行写入

List<Block> blocks = splitDataIntoBlocks(data);

for (int i = 0; i < blocks.size(); i++) {

DataNode node = dataNodes.get(i);

// 发送数据块到DataNode

node.writeBlock(blocks.get(i));

}

// 3. 确认数据写入成功

for (DataNode node : dataNodes) {

if (!node.confirmBlockWritten(blocks.get(node.getBlockIndex()))) {

// 发生错误,进行异常处理...

}

}

// 4. 通知NameNode写入完成

nameNode.notifyWriteComplete(filePath);

}

```

### 参数说明与逻辑分析

- `filePath`:待写入数据的文件路径。

- `data`:要写入的数据。

- `allocateDataNodes(filePath)`:此方法模拟NameNode分配DataNode的过程,实际实现会更复杂,涉及到副本策略和DataNode的可用性。

- `splitDataIntoBlocks(data)`:将数据按照HDFS的块大小分割为多个块。

- `dataNodes.get(i).writeBlock(blocks.get(i))`:并行向DataNode发送数据块。

- `confirmBlockWritten(blocks.get(node.getBlockIndex()))`:DataNode确认数据块是否写入成功。

- `nameNode.notifyWriteComplete(filePath)`:客户端向NameNode报告写入完成,更新文件状态。

## HDFS读取流程:客户端请求、NameNode定位与DataNode读取

### HDFS读取过程概述

HDFS的读取流程涉及多个组件协同工作,以确保数据的快速、可靠检索。这一过程始于客户端发起的读取请求,随后NameNode进行文件定位和元数据解析,最后由DataNode向客户端提供数据。

### 客户端请求细节

客户端在发起读取请求时,会执行以下步骤:

1. **访问NameNode获取元数据**:客户端向NameNode发送读取请求,询问文件的位置信息(即数据块的位置)。

2. **解析元数据**:客户端根据从NameNode获取到的元数据,解析出所需数据块所在的DataNode列表。

### NameNode定位细节

NameNode在接收到读取请求后,会执行以下操作:

1. **元数据检索**:NameNode从本地磁盘读取文件系统元数据,获取文件的块映射信息。

2. **数据块位置返回**:NameNode根据文件的块映射信息,返回包含数据块副本的DataNode列表给客户端。

### DataNode读取细节

DataNode在读取过程中扮演着数据提供者的角色,具体流程如下:

1. **接收读取请求**:DataNode接收到来自客户端的读取请求。

2. **数据块传输**:DataNode向客户端传输指定的数据块。

3. **数据传输优化**:DataNode可能会对数据进行压缩或切分以优化传输效率。

### 代码块示例与分析

以下是一个简化的HDFS客户端读取操作的伪代码:

```java

// 伪代码,不代表真实的HDFS客户端API

public String readData(String filePath) throws IOException {

// 1. 客户端访问NameNode获取元数据

List<Block> blocks = nameNode.getBlocksForFile(filePath);

// 2. 解析元数据,获取包含数据块副本的DataNode列表

List<DataNode> dataNodes = getReplicaDataNodes(blocks);

// 3. 向DataNode发送读取请求并接收数据

for (DataNode dataNode : dataNodes) {

String blockData = dataNode.readBlock(blocks.get(dataNode

```

0

0