【MapReduce秘籍】:从入门到精通,彻底掌握大数据处理流程

发布时间: 2024-10-30 13:17:55 阅读量: 4 订阅数: 7

# 1. MapReduce基础知识介绍

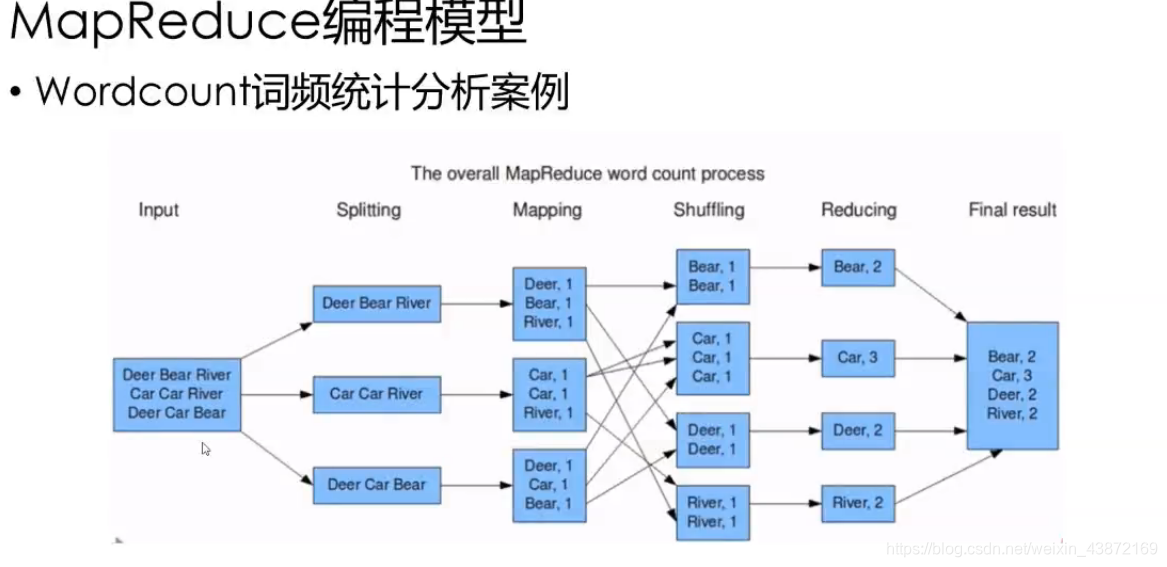

MapReduce是分布式计算的一种编程模型,广泛应用于大规模数据集的并行运算。它将计算过程分为两个阶段:Map阶段和Reduce阶段。Map阶段负责数据的处理和映射,而Reduce阶段则对中间结果进行汇总和归约。

MapReduce的设计初衷是为了简化分布式计算,使其能够在不牺牲可扩展性的前提下,处理PB级别的数据。它通过隐藏底层的分布式细节,使得开发者能够专注于业务逻辑的实现,而不用过分关注数据的分布和错误恢复。

MapReduce的核心概念包括Key-Value对、分区器(partitioner)和Combiner。Key-Value对是MapReduce处理数据的基本单位;分区器确保相同的Key被分配到同一个Reducer;Combiner则在Map端对中间结果进行局部合并,减少了数据传输量,提高了效率。在下一章节中,我们将深入探讨这些概念以及MapReduce的工作原理。

# 2. MapReduce理论框架深入解析

### 2.1 MapReduce的工作原理

#### 2.1.1 Map阶段的内部机制

Map阶段是MapReduce处理流程的起始部分,在这个阶段,输入的数据被切分成一系列的“小块”,每个小块都由一个Map任务并行处理。Map任务主要负责执行用户定义的Mapper函数,将输入的数据集转换为一系列的中间键值对(Key-Value pairs)。

每个Mapper函数处理的数据块是独立的,它读取输入数据并执行一系列操作,最终输出键值对。这些键值对通常并不是直接输出到磁盘,而是存放在内存中,并以环形缓冲区的形式管理,当缓冲区达到一定的容量时,会触发一个溢写(Spill)操作,将内存中的数据写入磁盘。

下面是一个简单的Mapper类示例,它读取文本行作为输入,并以单词作为key,固定值1作为value输出:

```java

public static class MyMapper extends Mapper<LongWritable, Text, Text, IntWritable> {

private final static IntWritable one = new IntWritable(1);

private Text word = new Text();

public void map(LongWritable key, Text value, Context context) throws IOException, InterruptedException {

String[] words = value.toString().split("\\s+");

for(String str : words) {

word.set(str);

context.write(word, one);

}

}

}

```

在上述代码中,`Mapper` 类的泛型参数分别代表输入键值对的类型和输出键值对的类型。`LongWritable` 和 `Text` 分别代表输入的偏移量和文本行,而 `Text` 和 `IntWritable` 则代表输出的键(单词)和值(计数为1)。Mapper将输入文本分割成单词,然后为每个单词输出键值对。

#### 2.1.2 Reduce阶段的数据处理

在Map阶段完成后,MapReduce框架将根据Key的值对中间输出的键值对进行排序和分组。这些处理过的数据然后被送入Reduce阶段,Reduce阶段的主要任务是执行用户定义的Reducer函数。

Reducer函数接收到的是一个按照Key排序后的键值对集合,它执行合并操作来处理这些值,通常是为了将具有相同Key的值合并成一个结果。这个过程通常涉及到对值的累加、平均等聚合操作。

下面是一个简单的Reducer类示例,它统计每个单词出现的总次数:

```java

public static class MyReducer extends Reducer<Text, IntWritable, Text, IntWritable> {

private IntWritable result = new IntWritable();

public void reduce(Text key, Iterable<IntWritable> values, Context context) throws IOException, InterruptedException {

int sum = 0;

for(IntWritable val : values) {

sum += val.get();

}

result.set(sum);

context.write(key, result);

}

}

```

在上述代码中,`Reducer` 类的泛型参数同样表示了输入输出的键值对类型。reduce方法接收一个Key和与之关联的值的迭代器,然后将所有值累加起来,最后输出累加结果。

### 2.2 MapReduce的关键概念

#### 2.2.1 Key-Value对的理解

在MapReduce中,数据被处理的最小单位是Key-Value对。每个键值对代表了一条记录,其中Key是每条记录的标识符,而Value则是记录的其他内容。在Map阶段,每个Mapper处理输入的数据,将其转换为中间键值对。这些中间键值对被传递到Reduce阶段,Reducer接收相同Key的所有值,然后进行聚合处理。

理解Key-Value对的结构对于编写高效的MapReduce程序至关重要。合理地设计Key-Value对可以简化数据的处理流程,同时还可以提高数据处理的性能。例如,如果要统计网站日志中每个页面的访问次数,可以将页面URL作为Key,访问次数作为Value,这样在Reduce阶段就可以直接对Value进行累加。

#### 2.2.2 分区器(partitioner)的作用

分区器是MapReduce框架中的一个组件,它控制着中间输出的键值对如何分配到各个Reducer。默认的分区器是HashPartitioner,它通过一个哈希函数来决定数据将发送到哪个Reducer。分区器确保具有相同Key的记录发送到同一个Reducer进行处理。

合理配置分区器可以避免数据倾斜问题,提高MapReduce作业的处理效率。例如,在处理具有大量重复Key的大型数据集时,如果没有适当的分区器配置,可能会导致数据在Reducer间分布不均,进而影响整体作业的执行时间。通过自定义分区器,可以根据特定的业务逻辑将数据均匀分布到各个Reducer,这样可以显著减少MapReduce作业的完成时间。

#### 2.2.3 Combiner的使用与优化

Combiner组件在MapReduce框架中用于局部聚合操作,它在Mapper输出到Reducer之前对数据进行预处理。使用Combiner可以显著减少传输到Reducer的数据量,减少网络I/O开销,并且能够加快MapReduce作业的执行速度。

Combiner的使用并不是必须的,但当整个MapReduce作业满足交换律和结合律的条件下,Combiner可以带来性能上的提升。例如,在计数器模式的MapReduce作业中,可以使用Combiner来实现部分计数,这样可以减少Reducer处理的数据量。

在实际的MapReduce作业中,选择合适的Combiner实现是提高性能的关键。开发者需要根据具体的应用场景来决定是否使用Combiner,以及如何实现Combiner来最大化其效果。

### 2.3 MapReduce作业的优化策略

#### 2.3.1 数据倾斜问题的识别与解决

数据倾斜是MapReduce作业中常见的问题,它发生在某些Reducer处理的数据量远大于其他Reducer时。数据倾斜会导致整体作业执行不均衡,从而影响作业的总体执行时间。

识别数据倾斜问题通常需要监控和分析MapReduce作业的执行日志。当发现某个Reducer处理的数据量异常大时,需要进一步分析这些数据的Key分布情况。解决数据倾斜的策略包括但不限于:

- 使用Combiner进行局部聚合。

- 对Key进行预处理,比如使用哈希值来平衡数据。

- 在Map阶段对输入数据进行划分,分散热点Key。

#### 2.3.2 任务调度和性能监控

有效的任务调度和性能监控是保证MapReduce作业高效运行的关键。在Hadoop集群中,任务调度主要由YARN(Yet Another Resource Negotiator)来完成。YARN负责资源管理和任务调度,它根据集群资源状况动态分配任务执行所需的CPU、内存等资源。

性能监控通常需要借助一些工具来完成,比如Ganglia、Nagios等。通过实时监控系统,管理员可以查看集群的整体运行情况和作业的执行情况。例如,监控CPU、内存、磁盘I/O和网络I/O的使用情况,可以及时发现瓶颈和异常。

此外,作业的性能监控和调优还需要根据具体的业务需求来进行。比如,可以通过调整MapReduce作业配置参数来优化任务调度策略。性能调优是一个持续的过程,需要结合实际运行情况进行。

通过深入理解MapReduce的工作原理和关键概念,并且采取有效的优化策略,可以显著提高MapReduce作业的效率和性能。在下一章中,我们将探讨MapReduce编程实践,包括开发环境的搭建、编写和调试MapReduce程序。

# 3.1 开发环境搭建与MapReduce程序的编写

### 搭建Hadoop开发环境

在开始编写MapReduce程序之前,我们首先需要一个运行Hadoop的开发环境。Hadoop可以运行在单机模式、伪分布式模式或完全分布式模式。对于开发和测试而言,伪分布式模式是一个折中的选择,它提供了一个相对接近生产环境的配置,同时操作简单,配置容易。下面简要介绍如何搭建Hadoop的伪分布式环境。

1. **下载与安装**

下载Hadoop的稳定版本,并解压到本地目录中。比如在Linux环境下,可以使用以下命令:

```sh

wget ***

***

***

```

2. **配置环境变量**

在用户的家目录下的`.bashrc`文件中添加Hadoop的环境变量,如`HADOOP_HOME`以及更新`PATH`变量:

```sh

export HADOOP_HOME=/path/to/hadoop-3.3.1

export PATH=$PATH:$HADOOP_HOME/bin:$HADOOP_HOME/sbin

```

3. **配置Hadoop**

主要需要修改`hadoop-env.sh`、`core-site.xml`、`hdfs-site.xml`、`mapred-site.xml`和`yarn-site.xml`几个配置文件,启用Namenode和Datanode的Web界面、设置HDFS和YARN的配置。

4. **格式化HDFS文件系统**

在第一次启动Hadoop之前,需要格式化文件系统:

```sh

hdfs namenode -format

```

5. **启动Hadoop集群**

使用`start-dfs.sh`和`start-yarn.sh`脚本启动Hadoop集群:

```sh

start-dfs.sh

start-yarn.sh

```

通过以上步骤,一个简单的Hadoop伪分布式环境就搭建完成了,此时可以通过访问`***`来查看HDFS的Web界面,以及通过`***`来查看YARN的资源管理界面。

### 编写第一个MapReduce程序

一旦环境搭建完成,我们就可以开始编写MapReduce程序了。以Hadoop自带的`wordcount`程序为例,我们将逐步介绍如何编写MapReduce程序的Map和Reduce任务。

#### Map任务

Map任务的职责是读取输入的数据集,并将之转化为一系列的中间键值对。

```java

public static class TokenizerMapper

extends Mapper<Object, Text, Text, IntWritable> {

private final static IntWritable one = new IntWritable(1);

private Text word = new Text();

public void map(Object key, Text value, Context context

) throws IOException, InterruptedException {

StringTokenizer itr = new StringTokenizer(value.toString());

while (itr.hasMoreTokens()) {

word.set(itr.nextToken());

context.write(word, one);

}

}

}

```

上述代码段中,`TokenizerMapper`类继承了`Mapper`类,我们覆写了`map`方法来处理输入文件中的每一行数据。我们使用`StringTokenizer`来分割文本行,并将得到的每一个单词映射为一个键值对,其中键是单词,值是数字1。

#### Reduce任务

Reduce任务则是对Map任务输出的中间键值对进行汇总,并得出最终结果。

```java

public static class IntSumReducer

extends Reducer<Text, IntWritable, Text, IntWritable> {

private IntWritable result = new IntWritable();

public void reduce(Text key, Iterable<IntWritable> values,

Context context

) throws IOException, InterruptedException {

int sum = 0;

for (IntWritable val : values) {

sum += val.get();

}

result.set(sum);

context.write(key, result);

}

}

```

`IntSumReducer`类继承了`Reducer`类,重写的`reduce`方法迭代每个键对应的值,将所有值累加得到最终的计数,并通过`context.write`输出。

### 构建与运行MapReduce程序

编写完毕Map和Reduce的实现后,我们需要构建MapReduce作业,并运行它。以下是利用Maven构建和运行MapReduce作业的流程。

1. **构建Maven项目**

创建`pom.xml`文件,引入Hadoop依赖:

```xml

<dependencies>

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-common</artifactId>

<version>3.3.1</version>

</dependency>

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-mapreduce-client-core</artifactId>

<version>3.3.1</version>

</dependency>

</dependencies>

```

2. **编写主类**

创建一个主类,它将配置作业并启动MapReduce作业。

```java

public class WordCount {

public static void main(String[] args) throws Exception {

Configuration conf = new Configuration();

Job job = Job.getInstance(conf, "word count");

job.setJarByClass(WordCount.class);

job.setMapperClass(TokenizerMapper.class);

job.setCombinerClass(IntSumReducer.class);

job.setReducerClass(IntSumReducer.class);

job.setOutputKeyClass(Text.class);

job.setOutputValueClass(IntWritable.class);

FileInputFormat.addInputPath(job, new Path(args[0]));

FileOutputFormat.setOutputPath(job, new Path(args[1]));

System.exit(job.waitForCompletion(true) ? 0 : 1);

}

}

```

3. **运行MapReduce作业**

通过Maven和Hadoop命令行运行MapReduce作业:

```sh

hadoop com.sun.tools.javac.Main WordCount.java

jar cf wc.jar WordCount*.class

hadoop jar wc.jar WordCount /input /output

```

4. **查看结果**

访问`***`查看输出结果。

以上步骤展示了一个MapReduce程序从开发到执行的完整流程。实践是学习MapReduce最好的方式,建议通过修改`wordcount`示例程序,尝试不同的输入数据,以及对程序进行优化和调试,来加深对MapReduce编程模型的理解。

# 4. ```

# 第四章:MapReduce在大数据处理中的应用

MapReduce已经成为处理大数据的核心技术之一,它能够处理PB级别的数据量。在本章中,我们将深入探讨MapReduce在多种场景下的应用,并讨论如何优化这些应用以提高效率和性能。

## 4.1 处理大规模日志数据

### 4.1.1 日志分析的MapReduce模型

在大规模分布式系统中,日志数据的处理至关重要。MapReduce通过分割数据、并行处理、合并结果的方式,可以有效地处理和分析大规模的日志数据。一个典型的日志分析MapReduce模型可以分为三个阶段:数据预处理、Map任务处理和Reduce任务处理。

数据预处理阶段负责从存储系统(如HDFS)读取原始日志文件,并将其分割成独立的日志记录。Map任务读取这些记录,并执行过滤和映射操作,生成中间Key-Value对。Reduce任务则对这些中间数据进行汇总,并生成最终的分析结果。

```java

// 示例Java代码 - Mapper类

public class LogMapper extends Mapper<LongWritable, Text, Text, IntWritable> {

private final static IntWritable one = new IntWritable(1);

private Text word = new Text();

public void map(LongWritable key, Text value, Context context) throws IOException, InterruptedException {

// 假设value为一行日志

String logLine = value.toString();

// 这里只是简单地将整行日志作为一个key

word.set(logLine);

context.write(word, one);

}

}

```

### 4.1.2 数据清洗与转换的实现

MapReduce的数据清洗和转换阶段通常在Map阶段完成。这一阶段的关键是定义好清洗规则,过滤掉不符合要求的数据,并将数据转换成适合分析的格式。例如,可以通过MapReduce将日志中的日期时间字符串转换成时间戳,以便进行时间相关的分析。

```java

// 示例Java代码 - Map任务中数据清洗和转换

public void map(LongWritable key, Text value, Context context) throws IOException, InterruptedException {

String logLine = value.toString();

// 假设日志格式为:[时间戳] - [日志级别] - [消息]

String[] logParts = logLine.split(" - ");

if (logParts.length == 3) {

// 清洗规则:仅保留符合特定日志级别的日志

String logLevel = logParts[1];

if (logLevel.equals("ERROR")) {

// 转换为键值对(日志级别, 计数)

context.write(new Text(logLevel), one);

}

}

}

```

## 4.2 复杂数据集的MapReduce解决方案

### 4.2.1 多阶段作业的串联

在处理复杂的数据集时,一个MapReduce作业往往不足以完成任务,需要通过多个MapReduce作业的串联来实现。第一阶段MapReduce作业生成的输出作为下一阶段MapReduce作业的输入。数据在各个阶段间流动,直到最后一个阶段生成最终结果。

### 4.2.2 复杂数据关系的处理

复杂数据关系的处理要求MapReduce作业能够处理数据间的关联关系。比如,社交网络的“好友”关系,MapReduce需要能够在Map阶段进行局部聚合,在Reduce阶段进行全局聚合,从而得到全局的统计信息,如“度中心性”等指标。

## 4.3 MapReduce与外部数据源的集成

### 4.3.1 数据源连接器的使用

MapReduce可以与各种外部数据源进行集成,比如关系型数据库、NoSQL数据库等。在Hadoop生态系统中,Hive提供了类似于SQL的查询语言,可以用来处理存储在HDFS上的数据。HBase的MapReduce连接器允许MapReduce作业直接处理存储在HBase表中的数据。

### 4.3.2 外部存储系统的MapReduce作业优化

针对外部存储系统的特性,MapReduce作业可以进行特定优化。例如,使用HBase时,可以通过设置合理的Region大小和压缩比例来提升MapReduce作业的读写效率。此外,使用数据分区技术可以减少Map任务间的依赖,提高并行度和作业的总体性能。

接下来的章节将继续深入探讨MapReduce的高级编程技巧和集群性能调优,以及实际业务场景中的最佳实践案例。

```

# 5. MapReduce进阶技巧与最佳实践

随着大数据处理需求的日益增长,MapReduce已不仅仅是一个简单的编程模型,而是进阶为一种需要深入掌握和灵活运用的技术。本章将探讨一些高级的编程技巧、性能优化方法以及实际应用的最佳实践案例。

## 5.1 高级MapReduce编程技巧

### 5.1.1 自定义数据序列化与反序列化

为了提高性能,MapReduce允许开发者自定义数据的序列化与反序列化方式。使用标准的Java序列化机制,虽然简便,但性能并不总是最优。通过实现`Writable`接口和`WritableComparable`接口,可以自定义数据类型,从而更有效地进行网络传输和存储。

#### 示例代码片段

```java

public class CustomWritable implements WritableComparable<CustomWritable> {

private Text name;

private IntWritable age;

public CustomWritable() {

name = new Text();

age = new IntWritable();

}

@Override

public void write(DataOutput out) throws IOException {

name.write(out);

age.write(out);

}

@Override

public void readFields(DataInput in) throws IOException {

name.readFields(in);

age.readFields(in);

}

// Implement comparison method for sorting

@Override

public int compareTo(CustomWritable o) {

***pareTo(o.name);

}

}

```

### 5.1.2 实现高效的Mapper和Reducer

高效的Mapper和Reducer是保证MapReduce作业性能的关键。优化Mapper意味着更快的处理数据,而优化Reducer则意味着更高效的归约操作。合理使用`combiner`,以及减少不必要的数据序列化和反序列化操作,都是提升性能的常见手段。

#### 优化建议

- 避免在Mapper和Reducer中创建过多对象,减少垃圾回收的压力。

- 合理利用`MapContext`和`ReduceContext`的`write`方法,减少中间数据的存储。

- 使用`combiner`来减少数据在网络中传输的量,尤其适用于那些满足交换律和结合律的操作,如求和和计数。

## 5.2 MapReduce集群的性能调优

### 5.2.1 资源管理与调度优化

Hadoop YARN作为资源管理框架,负责集群资源的分配和任务调度。理解YARN的工作原理和调度策略对于进行集群性能调优至关重要。通过调整资源分配参数、设置合适的队列和容量调度器,可以有效提升资源利用率。

#### 配置参数示例

```xml

<property>

<name>yarn.resourcemanager.scheduler.class</name>

<value>org.apache.hadoop.yarn.server.resourcemanager.scheduler.capacity.CapacityScheduler</value>

</property>

```

### 5.2.2 JVM性能调优及垃圾回收策略

MapReduce作业通常运行在JVM中,因此,合适的JVM参数设置和垃圾回收策略也是提升性能的关键。调整JVM堆大小(-Xmx和-Xms参数)和选择适合的垃圾回收器(如G1、CMS)对于减少内存溢出和提升响应速度是非常有帮助的。

#### JVM参数设置建议

- `-Xmx`和`-Xms`分别设置JVM最大和初始堆内存大小。

- `-XX:+UseG1GC`启用G1垃圾回收器。

- `-XX:MaxGCPauseMillis`设置目标停顿时间,控制垃圾回收频率。

## 5.3 MapReduce最佳实践案例分析

### 5.3.1 实际业务场景中MapReduce的应用

在实际业务场景中,MapReduce可以解决多种复杂问题。例如,在处理大规模数据集时,可以将数据集分块,然后用Map函数并行处理每个数据块,最后用Reduce函数汇总结果。对于需要多次迭代的任务,如网页排名计算,MapReduce的批处理能力能够显著提升效率。

### 5.3.2 成功案例的总结与经验分享

成功部署MapReduce解决方案的关键在于理解数据的处理流程和业务需求。一个常见的成功案例是社交网络的好友推荐系统。通过MapReduce分析用户行为数据和社交关系,可以有效地计算用户间的亲密度,从而为用户推荐可能感兴趣的朋友。

#### 经验分享

- 关注数据预处理和数据清洗的重要性,以减少后续处理的复杂度。

- 针对不同类型的作业选择合适的MapReduce参数和优化技术。

- 对于需要频繁迭代的复杂算法,可以考虑将MapReduce与其他技术(如Spark)结合使用。

以上便是MapReduce进阶技巧与最佳实践的详尽内容,但记住,优化是一个持续的过程。在实施优化策略之前,务必对现有的作业性能和资源利用进行分析,以确保优化措施能够带来实际效益。

0

0