时间序列异常值处理:案例分析与实操技巧

发布时间: 2024-09-02 22:10:05 阅读量: 90 订阅数: 31

# 1. 时间序列异常值概述

在现代IT领域,尤其是在时间序列数据分析中,异常值检测是一个至关重要的环节。时间序列数据通常指按时间顺序排列的一系列数据点,广泛应用于金融、气象、工业自动化等多个领域。异常值可以视为数据中的“噪声”,它们可能源自测量错误、数据录入错误或其他未预期的事件。

异常值的存在可能会对数据分析的结果产生显著影响,导致预测模型的准确性下降,或对业务决策造成误导。因此,有效地检测和处理时间序列中的异常值,已成为提升数据分析质量的一个关键步骤。

本章将简要介绍时间序列异常值的基本概念,为读者构建一个初步的理解框架,为后续章节深入探讨异常值检测与处理技巧打下基础。我们将从异常值的定义入手,讨论其类型,并进一步说明为什么需要对时间序列数据中的异常值进行深入研究。

# 2. 异常值检测理论基础

## 2.1 时间序列异常值的定义与类型

### 2.1.1 异常值的定义

异常值是指在数据集中与其它观测值显著不同的观测值,它们可能表示错误、噪音或罕见事件的结果。在时间序列分析中,异常值通常是指那些不符合正常波动范围的数据点,可能破坏模型的稳定性和预测的准确性。异常值的存在对数据分析和模型预测都有显著影响,因此准确地检测和处理它们对于时间序列分析至关重要。

### 2.1.2 异常值的常见类型

在时间序列数据中,异常值可以分为多种类型:

- 点异常:孤立的单点或少数几个连续点显著偏离序列的正常值范围。

- 上下文异常:序列的某一点在其上下文环境中表现出异常行为,如在特定时间段内的行为与其它时间段有较大差异。

- 集合异常:一组数据点作为一个集合与整个序列的其他部分相比表现出异常。

## 2.2 异常值检测的统计方法

### 2.2.1 基于均值和标准差的方法

该方法假设时间序列数据近似正态分布,异常值是那些与均值距离超过3个标准差的数据点。具体步骤如下:

- 计算数据集的均值(mean)和标准差(std)。

- 标准化每个数据点,使其与均值的距离以标准差为单位表示。

- 通过设定一个阈值(如3个标准差)来识别异常值。

```python

import numpy as np

# 假设 data 是我们的数据集

data = np.array([...])

mean_val = np.mean(data)

std_val = np.std(data)

# 计算Z分数

z_scores = (data - mean_val) / std_val

threshold = 3

# 标记异常值

outliers = np.where(np.abs(z_scores) > threshold)

```

在上述Python代码中,通过计算数据点的Z分数并与其设定阈值进行比较,识别出异常值。

### 2.2.2 基于移动窗口的方法

移动窗口方法考虑了时间序列数据的时序特征,通过滑动窗口计算局部的统计参数来检测异常值。一个常见的例子是移动均值和标准差:

- 定义一个窗口大小(例如:窗口大小为k)。

- 在整个时间序列上滑动窗口,计算窗口内数据的均值和标准差。

- 在每个窗口内,使用类似基于均值和标准差方法来识别异常值。

### 2.2.3 基于季节性分解的方法

对于具有明显季节性规律的时间序列数据,可以使用季节性分解方法来检测异常值。该方法涉及以下步骤:

- 分解时间序列数据为季节性(seasonal)、趋势(trend)和残差(residual)部分。

- 分析残差部分以识别异常值。

```python

from statsmodels.tsa.seasonal import seasonal_decompose

# 假设ts_data是我们的时间序列数据

result = seasonal_decompose(ts_data, model='additive', period=seasonal_period)

# 可视化分解结果

result.plot()

```

在上述Python代码中,使用了statsmodels库的seasonal_decompose函数分解时间序列,并通过可视化残差部分识别异常值。

## 2.3 异常值检测的机器学习方法

### 2.3.1 基于聚类分析的方法

聚类分析是无监督学习中的一种技术,它可以用来识别异常值。在异常值检测中,可以通过将数据点聚类并分析离群点来识别异常值:

- 使用K-means或DBSCAN等聚类算法对数据点进行聚类。

- 根据聚类结果,找出那些距离其它数据点较远的数据点。

### 2.3.2 基于孤立森林的方法

孤立森林(Isolation Forest)是一种基于树的算法,特别适用于高维数据的异常检测。基本思想是孤立样本,异常值通常远离大多数点,因此更容易被孤立出来:

- 构建多个随机树,每次分裂随机选择一个特征并随机选择一个分裂值。

- 在每一棵树上,从根节点到叶子节点的路径越短,则该数据点越可能是异常值。

### 2.3.3 基于异常分数的方法

异常分数方法通过学习正常数据的分布来给数据点打分,分数越高表示异常的可能性越大:

- 使用支持向量机(SVM)、主成分分析(PCA)等模型训练正常数据。

- 在正常数据上训练得到的模型用来给新数据打分。

```python

from sklearn.svm import OneClassSVM

# 假设 X_train 是我们的正常数据集

model = OneClassSVM(nu=0.01)

model.fit(X_train)

# 使用模型打分

scores = model.score_samples(X_test)

```

在上述Python代码中,使用了scikit-learn库中的OneClassSVM来训练一个异常检测模型,并用该模型对测试集中的数据点进行打分,分数越低表示越可能是正常数据点。

在接下来的章节中,我们将进一步介绍异常值处理的实战技巧,包括数据预处理、检测操作、处理方法和数据修正等。

# 3. 异常值处理实战技巧

## 3.1 异常值处理前的数据预处理

### 3.1.1 数据清洗与异常值初步识别

在时间序列分析中,数据清洗是至关重要的步骤,它直接影响到异常值检测的准确性和后续的数据分析质量。数据清洗主要涉及处理缺失值、重复记录和不一致性等。在这一步骤中,我们应当特别注意初步识别出的潜在异常值,因为它们可能会干扰数据清洗的逻辑判断。

异常值的初步识别可以通过多种方式进行,比如箱线图法则(Interquartile Range, IQR)、标准差方法或使用散点图等可视化手段。箱线图法则是一种直观且常用的方法,通过计算数据集的第一四分位数(Q1)和第三四分位数(Q3),并设定上下限(如 Q1-1.5*IQR 和 Q3+1.5*IQR),超过这个范围的数据点被视为异常值。

数据清洗的具体操作通常使用诸如Python的pandas库来执行。以下是一个简单的Python代码示例:

```python

import pandas as pd

# 加载数据集

data = pd.read_csv('timeseries_data.csv')

# 检查缺失值

missing_values = data.isnull().sum()

# 清除重复记录

data = data.drop_duplicates()

# 使用箱线图法则识别异常值

Q1 = data.quantile(0.25)

Q3 = data.quantile(0.75)

IQR = Q3 - Q1

lower_bound = Q1 - 1.5 * IQR

upper_bound = Q3 + 1.5 * IQR

outliers = data[(data < lower_bound) | (data > upper_bound)]

print(outliers)

```

### 3.1.2 数据标准化和正态化

数据标准化和正态化是数据预处理的另一重要步骤,尤其是在进行异常值检测之前。标准化通过减去均值并除以标准差来转换数据,使得数据具有单位方差。正态化则指的是使数据服从正态分布,这通常是通过转换数据来实现的。

例如,对数转换是一种常见的正态化方法,它能够减小数据的偏斜度,并有助于稳定方差。以下是数据标准化和对数转换的代码示例:

```python

from sklearn.preprocessing import StandardScaler

# 假设data是已经清洗完成的DataFrame

scaler = StandardScaler()

data_scaled = scaler.fit_transform(data)

# 对数转换

data_log = np.log(data + 1) # 防止数据中出现零或负数

# 将转换后的数据放回DataFrame

data['scaled'] = data_scaled

data['log_scaled'] = data_log

```

## 3.2 异常值检测的实践操作

### 3.2.1 利用统计方法进行异常检测

统计方法是检测时间序列中异常值的常用手段,尤其是基于均值和标准差的方法。这种方法假设数据服从正态分布,超过均值加上或减去n倍标准差的数据点可以被视作异常值。

这里,我们可以使用pandas的rolling方法来创建移动窗口,以计算局部的均值和标准差,并检测异常值。以下是使用移动窗口方法的代码示例:

```python

# 计算移动窗口的均值和标准差

window_size = 5

data['rolling_mean'] = data['scaled'].rolling(window=window_size).mean()

data['rolling_std'] = data['scaled'].rolling(window=window_size).std()

# 设置异常值的判断标准,这里以3倍标准差为例

data['outlier'] = np.where((data['scaled'] < (data['rolling_mean'] - 3 * data['rolling_std']))

| (data['scaled'] > (data['rolling_mean'] + 3 * data['rolling_std'])), 1, 0)

print(data[data['outlier'] == 1])

```

### 3.2.2 利用机器学习方法进行异常检测

机器学习方法在异常值检测方面表现出了巨大的潜力。孤立森林是一种无监督的机器学习算法,它通过随机选择特征和随机选择切分值来“孤立”观察值。异常点因为与众不同的特征值,通常能够更快地被孤立出来。

以下是使用Python中的`sklearn`库实现孤立森林算法的一个代码示例:

```python

from sklearn.ensemble import IsolationForest

# 假设data_log是已经对数转换的数据集

iso_forest = IsolationForest(n_estimators=100, contamination='auto', behaviour='new')

data['anomaly_score'] = iso_forest.fit_predict(data[['log_scaled']])

data['anomaly'] = data['anomaly_score'].apply(lambda x: 1 if x == -1 else 0)

print(data[data['anomaly'] == 1])

```

在这个例子中,`contamination` 参数指定了数据中异常值的预期比例,而 `behaviour` 参数设置了孤立森林算法中异常点和正常点的定义方式。

## 3.3 异常值处理与数据修正

### 3.3.1 异常值的剔除与插值修正

异常值的处理方法之一是直接从数据集中剔除这些异常值。然而,直接删除数据点可能会导致信息损失,特别是当数据集中的数据点数量有限时。此时,使用插值方法来修正异常值可能是一个更好的选择。插值法可以保留数据的总体趋势,同时修正异常值。

线性插值是最简单的插值方法之一,假设两个临近的数据点之间的变化是线性的。以下是使用线性插值修正数据的代码示例:

```python

import numpy as np

import matplotlib.pyplot as plt

# 线性插值修正

data['interpolated'] = data['scaled'].interpolate(method='linear')

# 绘制修正前后的数据图

plt.plot(data['scaled'], label='Original Data')

plt.plot(data['interpolated'], label='Interpolated Data')

plt.legend()

plt.show()

```

### 3.3.2 异常值的保留与上下文分析

有时候,异常值并不意味着错误,而是提供了有关数据集的重要信息。例如,在金融时间序列数据中,某些突变可能预示着市场条件的变化或外部事件的影响。因此,在某些情况下,保留异常值并进行上下文分析是有价值的。

上下文分析意味着需要结合时间序列的背景知识来判断异常值的意义。这通常涉及专家知识或领域知识,可能包括与历史事件的时间对比,检查数据收集和处理过程中的任何可能变化等。

以下是上下文分析的一个例子。假设我们已经识别出一个时间点的异常值,我们需要检查该时间点是否有特殊事件发生。

```mermaid

flowchart TD

A[识别异常值] --> B[检查相关时间点]

B --> C{是否有外部事件?}

C -- 是 --> D[考虑事件影响]

C -- 否 --> E[进一步分析异常原因]

D --> F[异常值可能是有意义的]

E --> G[进行深入异常值处理]

```

在上面的流程图中,我们描绘了一个异常值上下文分析的过程。首先,我们识别出异常值,然后检查与之相关的特定时间点,确定是否存在与该异常值相关的外部事件。如果存在,这可能表明异常值具有实际意义。如果没有外部事件,我们就需要进一步深入分析异常值产生的原因。

异常值的上下文分析是数据科学中的一个重要环节,它要求分析师具备领域知识,并能够从不同角度来审视数据。通过对异常值背后可能的原因进行推理分析,我们能够更好地理解数据的含义,从而做出更加精确的业务决策。

# 4. 时间序列异常值案例分析

## 4.1 案例选择与数据集描述

### 4.1.1 案例来源与目标问题

在进行时间序列分析时,选择一个合适的案例至关重要。该案例应涵盖典型的时间序列数据特征,包括季节性、趋势和随机波动等,并且要具有一定的业务或实际应用背景。例如,选择零售业销售数据、网络流量数据、股票市场价格数据等,这些数据通常包含丰富的动态变化特征和异常值。案例的目标问题应该明确,如识别出数据中的异常值,并分析其可能的成因,或在异常值存在的情况下对模型预测的影响进行评估。

### 4.1.2 数据集的结构和特点

数据集的结构和特点需要详细描述,以便读者更好地理解数据的背景和所要解决的问题。这包括数据的时间范围、数据的频率(如每日、每月、每小时等)、变量类型(连续、离散等)、数据的质量(是否存在缺失值、异常值等)以及可能影响分析的外部因素(如节假日、促销活动等)。通过表格、图表或其他可视化方式展示数据集的结构是很有帮助的。例如,可以使用下面的表格形式来描述数据集特征:

```markdown

| 时间范围 | 变量类型 | 数据频率 | 数据质量描述 | 外部因素 |

|----------------|--------|--------|------------|--------|

| 2018年1月至2021年12月 | 连续 | 每日 | 缺失值:无;异常值:存在 | 节假日、促销活动 |

```

## 4.2 异常值检测与处理

### 4.2.1 应用统计方法案例分析

使用统计方法进行异常检测时,可以采用2σ原则(即超过均值两个标准差的点视为异常)、Z-score方法等。首先,需要计算时间序列数据的均值和标准差。然后,确定阈值以识别异常值。下面是一个基于Python的代码示例:

```python

import numpy as np

import matplotlib.pyplot as plt

# 假设data为时间序列数据

data = np.array([100, 102, 101, 103, 90, 102, 104, 106, 103, 89])

# 计算均值和标准差

mean = np.mean(data)

std_dev = np.std(data)

# 设定阈值(例如2个标准差)

threshold = 2 * std_dev

# 识别异常值

anomalies = [i for i, value in enumerate(data) if abs(value - mean) > threshold]

print("异常值的索引:", anomalies)

```

分析上述代码逻辑,我们首先导入了`numpy`和`matplotlib.pyplot`库,然后定义了时间序列数据`data`。接着,我们计算了数据的均值`mean`和标准差`std_dev`,并且设定了一个阈值`threshold`。最后,通过列表推导式,我们找到了所有超过均值两个标准差的点,并将其作为异常值。

### 4.2.2 应用机器学习方法案例分析

机器学习方法在异常检测中提供了更多的灵活性和准确性,例如使用孤立森林(Isolation Forest)算法。该算法适用于高维数据,通过构建多棵孤立树,随机选择特征和随机选取特征的分裂值进行分割,孤立单个数据点,最终将数据点的路径长度作为异常分数。异常点往往具有较短的路径长度。下面是一个使用`sklearn`库中的`IsolationForest`类进行异常检测的Python代码示例:

```python

from sklearn.ensemble import IsolationForest

import numpy as np

# 假设data为已经标准化后的时间序列数据

data = np.array([[100], [102], [101], [103], [90], [102], [104], [106], [103], [89]])

# 使用IsolationForest模型进行异常检测

iso_forest = IsolationForest(contamination=0.05) # 0.05表示预期的异常比例

outliers = iso_forest.fit_predict(data)

# 将异常值标为-1,正常值标为1

print("异常值的索引:", np.where(outliers == -1))

```

在这段代码中,我们首先导入了`IsolationForest`类,并假设已经对数据进行了标准化处理。然后我们创建了一个`IsolationForest`模型,并设置`contamination=0.05`,表示在数据集中预期有5%的异常值。通过`fit_predict`方法,我们对数据进行了拟合和预测,结果中的-1代表异常值,1代表正常值。

## 4.3 案例结果解读与应用

### 4.3.1 异常值处理后的数据质量评估

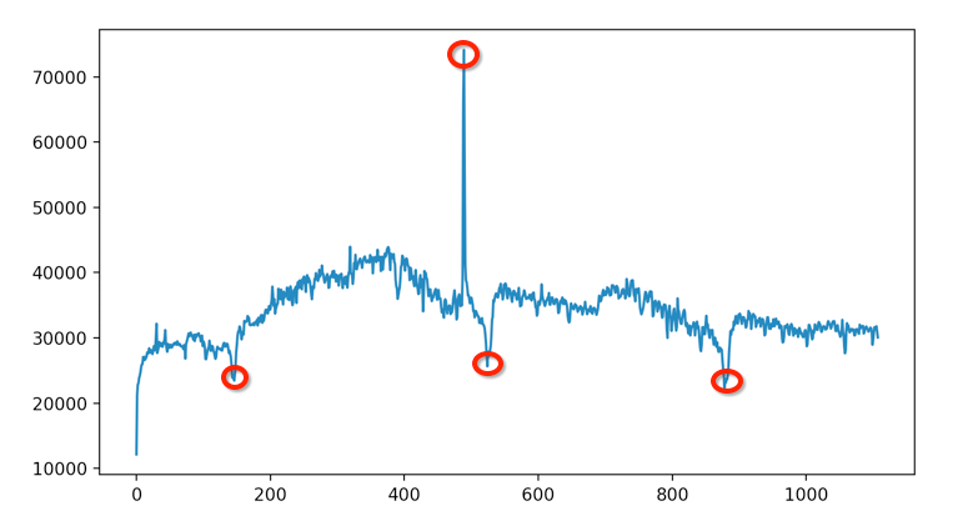

异常值的检测和处理是一个不断迭代的过程,重要的是评估处理后的数据质量。可以使用统计指标如均方误差(MSE)、均方根误差(RMSE)、平均绝对误差(MAE)等来评估模型预测的准确性,以及检测异常值处理对预测准确性的影响。数据清洗前后可以绘制时间序列图,直观比较数据的平滑程度和趋势的一致性。

### 4.3.2 时间序列数据在实际应用中的优化效果

评估异常值处理对实际应用的影响是至关重要的。例如,在金融领域,异常值的处理可能会影响风险评估和投资决策的准确性。在电子商务领域,可能会影响库存管理和销售预测的效率。通过实际应用案例,可以展示异常值处理后的优化效果,比如提高预测准确性、减少运营成本等。

具体应用案例可能涉及不同的业务场景,比如:

- **零售业销售预测**:通过异常值处理减少异常波动,使得趋势预测更加准确。

- **网络流量监控**:准确识别异常的流量峰值,对网络安全进行预警。

- **供应链管理**:基于异常值检测,及时发现并修正可能导致供应链中断的问题。

通过以上四个章节的介绍,我们可以看到从理论到实践的整个流程,以及如何通过各种方法和技术来应对和解决时间序列分析中的异常值问题。接下来的章节,我们将进一步探讨在多维时间序列和大数据环境下的异常值处理高级应用。

# 5. 时间序列异常值处理的高级应用

## 5.1 多维时间序列异常值处理

多维时间序列,或称为向量时间序列,是时间序列分析中的一个高级主题,它涉及同时考虑两个或更多相关时间序列的变化。相比于单变量时间序列,多维时间序列的异常值检测和处理更加复杂,因为需要同时考虑多个变量之间的关系。

### 5.1.1 多维时间序列的特点

多维时间序列的特点之一是变量间的相互作用。例如,在金融市场的股票交易中,不同的股票价格序列之间可能存在相关性。处理这种类型数据时,我们不仅要观察单个序列的变化,还需要分析序列间的交叉影响。此外,维度的增加通常伴随着计算复杂度的提升,因此在处理多维时间序列时,需要更加高效的算法和数据结构。

### 5.1.2 多维异常值的检测与处理方法

多维时间序列的异常值检测方法可以基于统计或机器学习技术。在统计方法中,例如可以使用主成分分析(PCA)来降维,然后在低维空间使用已知的单变量方法检测异常。机器学习方法如孤立森林也可以扩展到多维情况,但需要注意的是模型的性能可能会因维度诅咒而下降。

```python

from sklearn.decomposition import PCA

from sklearn.ensemble import IsolationForest

# 示例:使用PCA降维后应用孤立森林检测异常值

pca = PCA(n_components=2)

X_pca = pca.fit_transform(multivariate_time_series)

clf = IsolationForest(n_estimators=100)

outliers = clf.fit_predict(X_pca)

# 将原始数据中的异常值标记出来

multivariate_time_series['Outlier'] = 'Normal'

multivariate_time_series.loc[outliers == -1, 'Outlier'] = 'Outlier'

```

在上述代码中,我们首先使用PCA将多维时间序列降维到二维,然后使用孤立森林检测异常值,并将其标记在原始数据集中。

## 5.2 面向未来的异常值预测

在时间序列分析中,异常值的预测同样重要。准确预测异常事件的发生,可以帮助企业及时采取措施,防止可能的损失。

### 5.2.1 预测模型的建立

建立预测模型通常需要一个稳定且正常的时间序列数据集。异常值会影响预测模型的准确性,因此在建立模型之前,通常需要对数据进行预处理和异常值处理。对于异常值的预测,可以使用自回归移动平均(ARMA)模型、长短期记忆网络(LSTM)等预测模型。

```python

from statsmodels.tsa.arima_model import ARMA

from keras.models import Sequential

from keras.layers import LSTM, Dense

# 示例:建立ARMA模型进行异常值预测

arma_model = ARMA(time_series, order=(1,1))

arma_result = arma_model.fit(disp=False)

# 示例:建立LSTM模型进行异常值预测

model = Sequential()

model.add(LSTM(50, input_shape=(time_series.shape[1], 1)))

model.add(Dense(1))

***pile(loss='mean_squared_error', optimizer='adam')

# LSTM模型的训练和预测步骤在此省略。

```

### 5.2.2 异常值预测的应用实例

在具体应用中,异常值的预测可以结合历史数据和实时数据流进行。例如,在网络流量监控中,可以使用LSTM模型预测未来的流量变化,并设置阈值检测异常流量。需要注意的是,预测模型需要定期用最新数据进行更新,以保证其预测准确性。

## 5.3 异常值处理在大数据环境下的挑战与机遇

随着数据量的激增,异常值处理技术面临着新的挑战和机遇。在大数据环境下,数据集的规模、速度和多样性要求新的技术解决方案。

### 5.3.1 大数据对异常值处理的影响

大数据的“三V”特性:体量大(Volume)、速度快(Velocity)、种类多(Variety),给异常值检测带来了许多挑战。传统的方法可能无法有效处理如此大规模和高维度的数据,因而需要发展更为高效和可扩展的算法。例如,使用分布式计算框架(如Apache Spark)来处理大规模数据集。

```python

from pyspark.sql import SparkSession

from pyspark.ml.feature import StandardScaler

# 初始化Spark会话

spark = SparkSession.builder.appName("AnomalyDetection").getOrCreate()

# 使用Spark处理大规模时间序列数据

time_series_df = spark.createDataFrame(multivariate_time_series)

scaler = StandardScaler(inputCol="features", outputCol="scaledFeatures")

scalerModel = scaler.fit(time_series_df)

scaled_df = scalerModel.transform(time_series_df)

```

### 5.3.2 面向大数据的异常值处理技术发展趋势

面向大数据的异常值处理技术的发展趋势包括:分布式异常检测算法、实时异常检测系统以及利用深度学习进行复杂模式的检测。深度学习如自编码器(Autoencoders)和生成对抗网络(GANs)在处理非线性和高维数据时显示了潜在的优势。同时,随着技术的进步,我们也可以预见更加自动化的异常值处理流程。

本章内容到这里,我们已经了解了时间序列异常值处理的高级应用,包括多维时间序列的异常值处理,异常值预测模型的建立以及大数据环境下异常值处理的挑战与机遇。在实际应用中,这些高级技术可以帮助我们更加准确地检测和预测异常事件,提升数据处理的质量。

0

0