大数据分析的挑战:人工智能算法的7大对策

发布时间: 2024-09-02 01:29:21 阅读量: 181 订阅数: 67

# 1. 大数据分析的挑战概述

随着数字化转型的加速,大数据已经成为IT和相关行业的核心资产。企业和机构开始认识到,高效管理、分析和利用大数据对于保持竞争力至关重要。然而,大数据分析面临诸多挑战,从数据的海量性到异构性,再到实时性要求,每一个维度都对现有的技术和方法提出挑战。

在本章中,我们将概述大数据分析所面临的普遍挑战,这些挑战包括但不限于:

- 数据治理与隐私保护:如何在不侵犯用户隐私的前提下有效管理数据资源。

- 数据质量与准确性:确保数据分析结果的可靠性,避免因数据错误导致的决策失误。

- 技术与人才缺口:如何培养专业人才,使用合适的技术工具解决大数据问题。

我们将探讨这些挑战的具体内容及其对业务流程的影响,以及企业可能采取的应对策略。通过深入分析,我们将为读者提供对大数据分析挑战的全面理解,为后续章节中探讨的解决方案打下基础。

# 2. 人工智能算法的基本理论

## 2.1 大数据分析的基本概念

### 2.1.1 数据量与数据类型

在当今信息化社会,数据的体量(Volume)、多样性和速度(Velocity)已达到了前所未有的规模,大数据已成为描述这些特征数据集合的术语。数据体量的巨大要求我们在存储、处理和分析上使用新的技术和算法。数据类型则从结构化数据(如数据库中的表格数据)扩展到了非结构化数据(如文本、图片、视频)。这些不同类型的数据需要不同的处理方式,例如,机器学习算法通常需要大量的标签数据来进行训练,而深度学习则可以从非结构化数据中自动提取特征。

### 2.1.2 大数据生态系统与框架

为了处理这些庞大的数据量,大数据生态系统应运而生,它由各种技术框架和工具组成,其中包括数据存储解决方案如Hadoop和NoSQL数据库,数据处理框架如Apache Spark和Flink,以及数据分析和机器学习库如Pandas、Scikit-learn和TensorFlow。这些框架和工具被设计来在分布式环境中有效地工作,能够同时处理TB、PB级别的数据。

```mermaid

graph LR

A[数据源] --> B[数据收集]

B --> C[数据存储]

C --> D[数据处理]

D --> E[数据建模]

E --> F[数据分析]

F --> G[数据可视化]

```

在该流程中,数据收集到存储是第一步,而使用大数据框架进行分布式数据处理,之后对数据进行建模和分析,最后将分析结果可视化,使得非专业人士也能够理解。

## 2.2 人工智能算法基础

### 2.2.1 算法的分类与选择

人工智能算法可以分为传统的机器学习算法和深度学习算法。选择哪一种算法取决于数据的特征、问题的复杂度和可用的计算资源。传统机器学习算法,如决策树、支持向量机(SVM)、随机森林等,在数据量相对较小且结构化时表现优异。而深度学习算法,如卷积神经网络(CNN)和循环神经网络(RNN),在处理非结构化数据,如图像识别、自然语言处理等领域,显示出了其优越性。

### 2.2.2 机器学习与深度学习简介

机器学习是人工智能的一个分支,其核心是让计算机系统从数据中学习并作出决策或预测。算法通过在数据上进行训练,发现数据中的模式,并将其泛化到新数据上。深度学习是机器学习的一个子集,它使用了类似人脑的神经网络结构来处理复杂的数据,特别是图像、声音和文本。

## 2.3 算法性能评估

### 2.3.1 准确度与效率的度量

在评估算法性能时,准确度(Accuracy)是最常见的度量标准,它表示模型预测正确的比例。然而,准确度并不总是完美的指标,特别是在数据分布不均时,可能需要考虑精确率(Precision)、召回率(Recall)和F1分数等其他指标。效率则通常通过模型训练和预测所需要的时间来评估。在大数据环境中,算法效率对于实时分析至关重要。

### 2.3.2 过拟合与欠拟合的处理

过拟合(Overfitting)发生在模型在训练数据上学习得太好,以至于它捕捉到了数据中的噪声,而未能泛化到未见数据上。相反,欠拟合(Underfitting)意味着模型过于简单,无法捕捉数据的基本特征。为了处理这些问题,可以采取交叉验证、正则化、增加数据量和数据增强等措施。此外,模型选择时应考虑模型复杂度与数据量之间的平衡。

```python

from sklearn.model_selection import train_test_split

from sklearn.metrics import accuracy_score, precision_score, recall_score, f1_score

from sklearn.ensemble import RandomForestClassifier

from sklearn.linear_model import LogisticRegression

# 假设 X 是特征数据,y 是标签数据

# 分割数据集

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.3, random_state=42)

# 使用随机森林分类器作为示例

random_forest = RandomForestClassifier(n_estimators=100)

random_forest.fit(X_train, y_train)

# 预测和评估

y_pred = random_forest.predict(X_test)

print('Accuracy:', accuracy_score(y_test, y_pred))

print('Precision:', precision_score(y_test, y_pred))

print('Recall:', recall_score(y_test, y_pred))

print('F1 Score:', f1_score(y_test, y_pred))

# 考虑正则化参数的逻辑回归

logistic_regression = LogisticRegression(C=1.0)

logistic_regression.fit(X_train, y_train)

```

以上代码展示了如何在Python中使用`sklearn`库来分割数据集,训练随机森林和逻辑回归模型,并计算准确度、精确率、召回率和F1分数。代码逻辑分析后,我们可以调整模型参数(例如`n_estimators`和`C`),并运行不同的评估指标来测试模型在处理过拟合和欠拟合问题时的表现。

在下一章节,我们将继续深入探讨大数据分析中的技术挑战及对策。

# 3. 大数据分析中的技术挑战及对策

## 3.1 数据集成与预处理

在大数据分析的前期准备阶段,数据集成与预处理是不可忽视的关键步骤。高质量的数据是确保分析准确性与后续模型有效性的基础。

### 3.1.1 数据清洗与标准化

数据清洗的目的是去除数据集中的噪声和不一致性,确保数据的质量和准确性。常见的数据清洗步骤包括:

- **缺失值处理**:根据数据特性采用填充、删除、预测等方法。

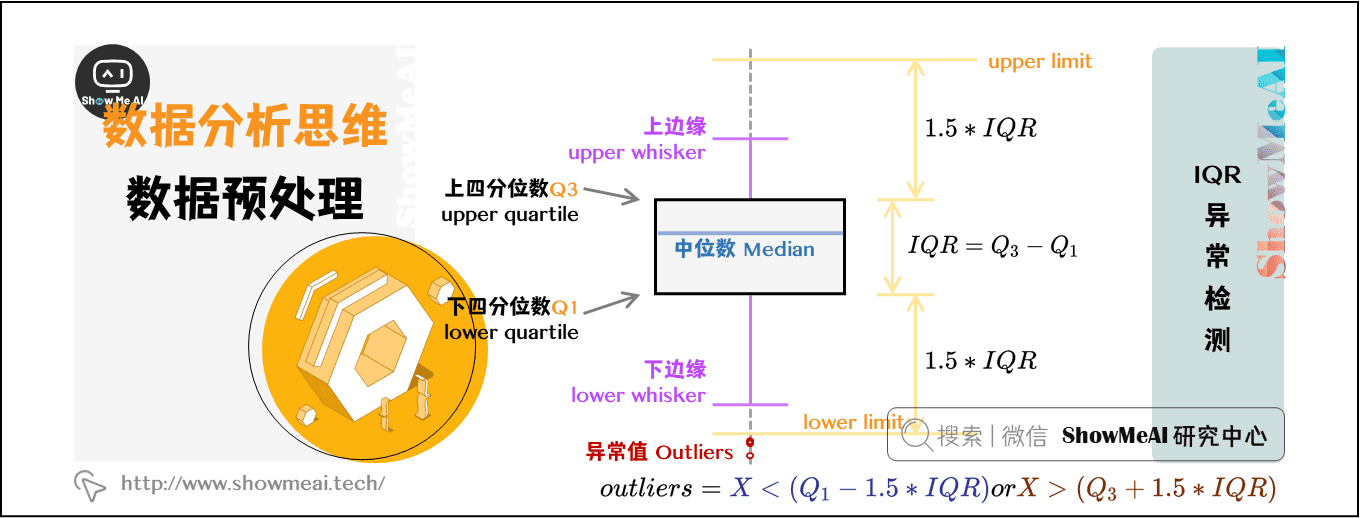

- **异常值检测与处理**:使用统计方法(如箱线图)、聚类等技术识别并处理异常值。

- **数据归一化与标准化**:使得不同量级和量纲的数据可以进行公平比较和计算。

代码示例:使用Pytho

0

0