信息论解题详解:信源熵与编码答案

本资源是一份针对大学生《信息论与编码》课程的详细解答,主要涵盖第二章信源及信源熵的相关习题。这部分内容涉及到了信息熵、信源熵的计算以及概率统计在信源分析中的应用。

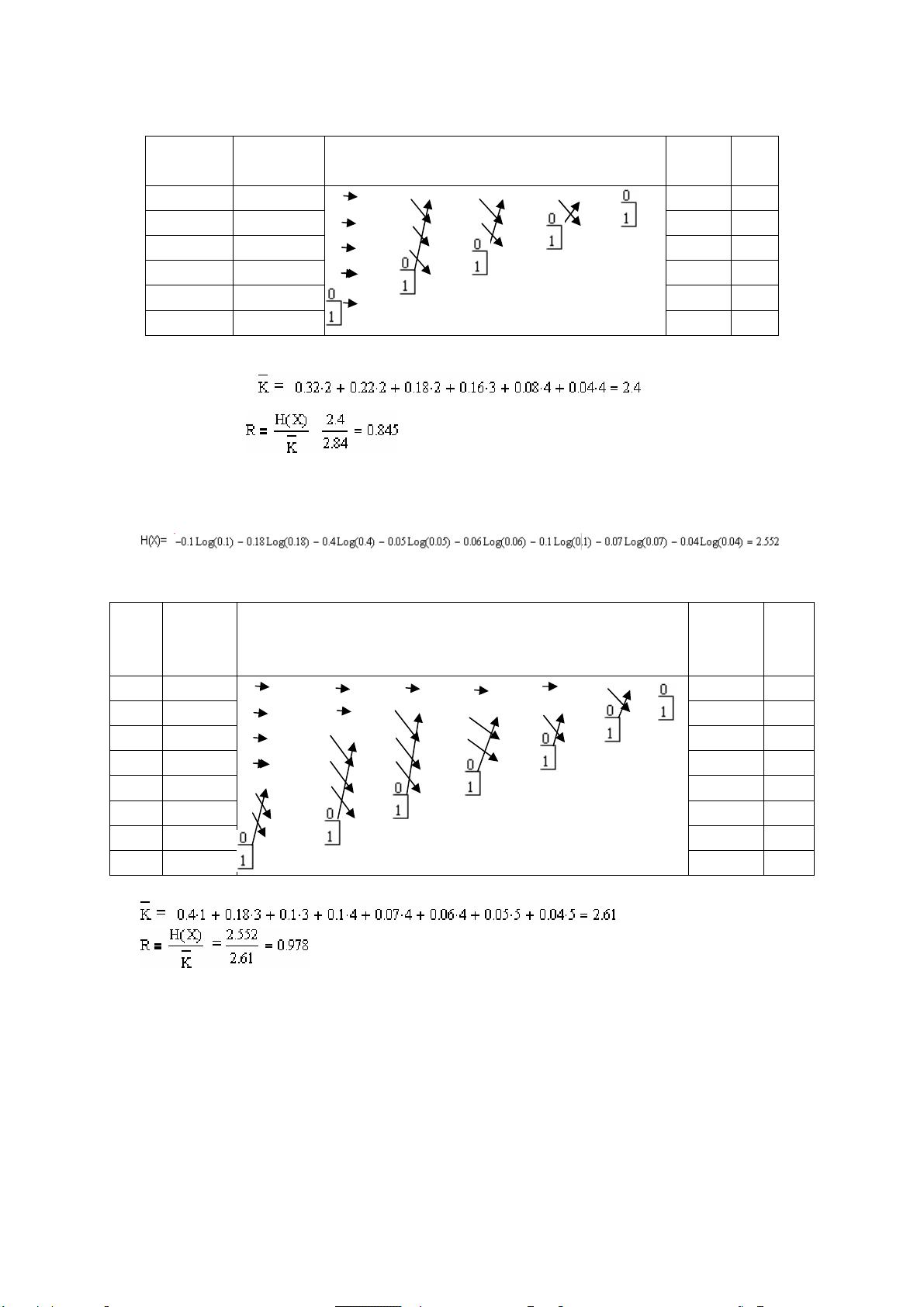

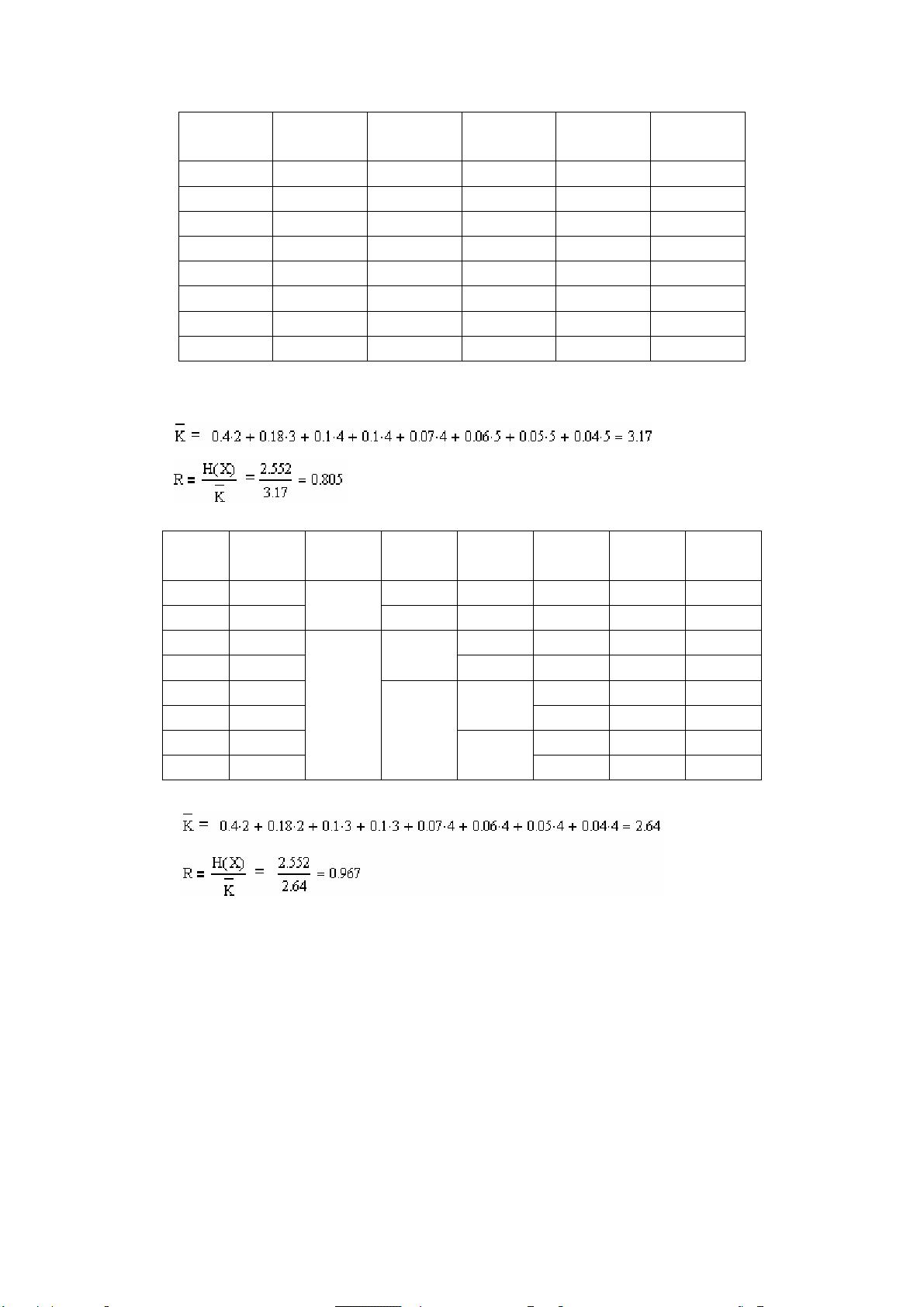

在第二章的习题中,首先讨论了不同信源熵的计算,如二进制对数、四进制对数和八进制对数的组合,例如2-5(1,2)(2,1)对应的Log36共有两种情况,计算结果是2.585。2-6列举了六种不同的Log36表达式,每个表达式的值都是2-60,说明了信息的复杂性。

接着,涉及到信源的符号熵,例如I(●)和I(-)的计算,以及整体信源的熵H的计算,其中利用了对数运算和概率来衡量不确定性。例如,(2)H=1.415,表明信息源的平均不确定度。

概率分布和条件熵也占了重要部分,如黑白符号出现的概率和它们之间的依赖关系,以及颜色和数字的信息熵。例如,(2)P(黑/黑)、(3)P(白/白)等都是通过计算得到的。

此外,还讨论了联合熵和条件熵的计算,比如(1)H(XY)的分解和(3)H(X/Y)的求解,这些都是衡量多个随机变量之间相互关系的重要指标。

对于平稳状态的概率和条件熵,如W1和W2代表的不同概率,以及它们在H(Y/黑)和H(Y/白)中的应用,给出了具体的计算步骤和结果,显示了信源在达到稳定状态时的熵值。

这份解答详尽地解析了《信息论与编码》课程中的关键概念和习题,对于理解和掌握信源理论及其在实际问题中的应用具有重要参考价值。通过解答这些题目,学生可以深化对信息熵、概率分布和信源编码的理解,并能灵活运用到实际的通信和数据处理场景中。

点击了解资源详情

点击了解资源详情

点击了解资源详情

2021-10-08 上传

2022-04-06 上传

2009-06-08 上传

点击了解资源详情

点击了解资源详情

点击了解资源详情

kkk13424603140

- 粉丝: 0

- 资源: 1