CNN背后的世界:揭秘特征提取与内部工作机制的可视化技术

发布时间: 2024-11-20 16:12:01 阅读量: 30 订阅数: 21

图像识别中的特征提取:核心技术与实践应用

# 1. 深度学习与卷积神经网络(CNN)

随着深度学习的兴起,卷积神经网络(CNN)已经成为图像识别和处理领域的核心技术之一。本章将作为整个文章的引入部分,对深度学习和CNN进行概述,为读者提供一个理解和探索CNN内部工作机制的基础。

## 1.1 深度学习概述

深度学习是一种利用多层神经网络进行学习的方法,它能够通过数据训练自动提取和学习数据中的特征。深度学习模型特别擅长处理非结构化数据,如图像、视频、声音和文本等。这些模型通过模拟人脑的工作方式,可以进行复杂的模式识别和决策。

## 1.2 卷积神经网络(CNN)的兴起

CNN是一种深度学习模型,特别设计用来处理具有网格状拓扑结构的数据。它的一个关键特性是其卷积层,这些层可以高效地从输入数据中提取空间特征。CNN在图像识别、分类、分割以及自然语言处理等领域取得了巨大的成功。

## 1.3 CNN的重要性与应用

CNN的出现极大地推动了人工智能的发展。它的应用范围广泛,从医疗诊断到自动驾驶,再到安全监控等。CNN通过其优秀的特征提取能力,不仅增强了模型的准确性,而且减少了对人工特征工程的依赖。

在接下来的章节中,我们将深入探讨CNN的理论基础、结构组成以及如何通过可视化技术来优化和解释CNN模型。这将帮助我们更深入地理解CNN如何工作,并为实际应用提供指导。

# 2. CNN的理论基础与结构组成

### 2.1 CNN的核心组件

CNN由多个层次组成,其中每个层次执行着特定的数据处理任务。理解这些核心组件是深入掌握CNN的关键。

#### 2.1.1 卷积层的工作原理

卷积层是CNN中最关键的部分之一,负责提取输入数据的局部特征。卷积操作通过一个可学习的卷积核在输入数据上滑动,并通过点乘操作提取特征,形成输出的特征图(feature map)。

在数学上,卷积核 \(K\) 和输入数据 \(X\) 的卷积操作可以表示为:

\[ Y[i,j] = \sum_m \sum_n K[m,n] X[i+m, j+n] \]

其中,\(Y\) 是卷积层的输出,\(i, j\) 是输出特征图的坐标,\(m, n\) 是卷积核的相对位置。

在实际应用中,卷积层通常会使用多个卷积核,每个核提取不同的特征。通过这种方式,卷积层可以学习到多样化的特征表达。

```python

import torch

import torch.nn as nn

# 定义一个简单的卷积层

class ConvLayer(nn.Module):

def __init__(self):

super(ConvLayer, self).__init__()

self.conv = nn.Conv2d(in_channels=1, out_channels=32, kernel_size=3, padding=1)

def forward(self, x):

return torch.relu(self.conv(x))

# 实例化并进行一次前向传播

conv_layer = ConvLayer()

input_tensor = torch.randn(1, 1, 28, 28) # 假设输入为1个28x28的灰度图像

output = conv_layer(input_tensor)

```

在上面的代码块中,我们定义了一个包含单个卷积核的卷积层。这个卷积核将从输入中提取特征,并通过ReLU激活函数来引入非线性。

#### 2.1.2 激活函数的角色

激活函数是CNN中另一个重要的组件,它为模型引入非线性。没有激活函数,无论多少层的神经网络,最终的输出都是输入数据的线性组合,这极大地限制了模型的表达能力。

最常见的激活函数包括ReLU、Sigmoid和Tanh。ReLU函数通过将所有负值设为0来实现非线性,而保留正值不变。这一性质使得ReLU可以加速网络的收敛,并且减少梯度消失的问题。

### 2.2 CNN的层次结构

CNN的层次结构设计是其强大能力的关键。下面详细介绍CNN中的两个重要层次。

#### 2.2.1 深度可分离卷积与Inception模块

深度可分离卷积是一种减少计算量和模型参数的有效方法。它将传统的卷积分解为深度卷积和逐点卷积。深度卷积先在输入通道上应用卷积核,逐点卷积则在深度方向上应用单点卷积核。

Inception模块是一个结构复杂的层次,它同时在多个尺度上提取特征。Inception模块通过1x1卷积层来减少输入通道数,减少计算量,然后使用不同尺寸的卷积核提取特征。

```python

class InceptionModule(nn.Module):

def __init__(self):

super(InceptionModule, self).__init__()

self.branch1 = nn.Sequential(

nn.Conv2d(64, 96, kernel_size=1),

nn.ReLU(inplace=True)

)

self.branch2 = nn.Sequential(

nn.Conv2d(64, 64, kernel_size=1),

nn.Conv2d(64, 96, kernel_size=3, padding=1),

nn.ReLU(inplace=True)

)

self.branch3 = nn.Sequential(

nn.Conv2d(64, 64, kernel_size=1),

nn.Conv2d(64, 96, kernel_size=5, padding=2),

nn.ReLU(inplace=True)

)

self.branch4 = nn.Sequential(

nn.MaxPool2d(kernel_size=3, stride=1, padding=1),

nn.Conv2d(64, 96, kernel_size=1),

nn.ReLU(inplace=True)

)

self.conv = nn.Conv2d(384, 320, kernel_size=1)

self.relu = nn.ReLU(inplace=True)

def forward(self, x):

branch1 = self.branch1(x)

branch2 = self.branch2(x)

branch3 = self.branch3(x)

branch4 = self.branch4(x)

branches = [branch1, branch2, branch3, branch4]

return self.relu(self.conv(torch.cat(branches, 1)))

inception_module = InceptionModule()

output = inception_module(output)

```

#### 2.2.2 池化层和全连接层的作用

池化层在CNN中用于降低特征图的空间尺寸,增加模型的不变性。最大池化和平均池化是最常用的两种池化操作。它们分别提取区域内的最大值和平均值,但都以减少数据尺寸为代价。

全连接层通常位于CNN的末端,用于将卷积层提取的高级特征映射到最终的输出。在分类任务中,全连接层的输出通常会被送入Softmax函数,得到每个类别的概率分布。

### 2.3 CNN的训练过程

CNN的训练过程涉及前向传播和反向传播两个阶段,每个阶段对于理解CNN的运作至关重要。

#### 2.3.1 前向传播与损失函数

在前向传播中,输入数据通过网络中的每个层次,逐层进行计算,直到生成最终的输出。损失函数则用于衡量模型的预测与真实标签之间的差异。

交叉熵损失函数是分类问题中常用的损失函数之一。对于多分类问题,交叉熵损失函数可以定义为:

\[ L = -\sum_{c=1}^{M} y_c \log(p_c) \]

其中,\(y_c\) 是第\(c\)个类别的真实标签,\(p_c\) 是模型预测的概率。

#### 2.3.2 反向传播与参数更新策略

反向传播是一个通过链式法则计算损失函数关于网络参数梯度的过程。这个过程从输出层开始,逐层反向进行,直到到达输入层。得到梯度后,参数将根据梯度下降或其变体进行更新。

```python

# 假设我们有一个损失函数loss,它是模型参数的函数

parameters = [conv_layer.conv.weight, conv_layer.conv.bias] # 假设模型参数

optimizer = torch.optim.SGD(parameters, lr=0.01) # 使用随机梯度下降优化器

# 反向传播和优化器的步骤

optimizer.zero_grad() # 清除之前的梯度

loss.backward() # 反向传播计算梯度

optimizer.step() # 更新参数

```

在上述代码块中,我们首先创建了一个优化器对象,它使用随机梯度下降算法,并将学习率设为0.01。然后执行反向传播,并调用`optimizer.step()`来更新模型参数。这一过程是训练CNN时的核心步骤之一。

到此,我们已经对CNN的理论基础与结构组成有了全面的了解。下一章我们将探讨特征提取的可视化方法,进一步揭示CNN内部工作机制。

# 3. 特征提取的可视化方法

## 3.1 可视化技术的基本概念

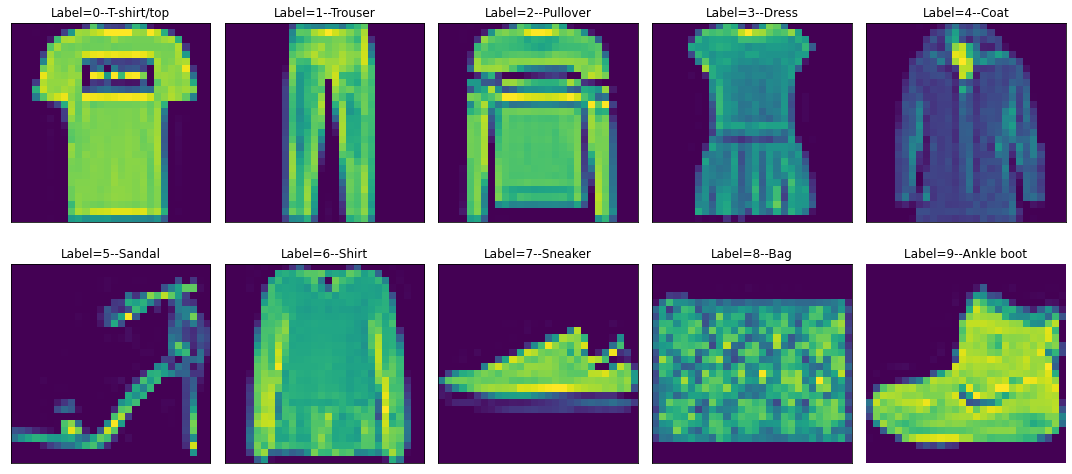

### 3.1.1 热图(Heatmaps)技术

热图技术是深度学习领域中用于可视化卷积神经网络(CNN)内部特征提取过程的一种有效手段。在CNN中,热图通常表示输入数据在经过特定卷积层处理后,每个像素点对于最终输出结果的贡献程度。通过将输入图像中每个像素点的权重映射为颜色的亮度,热图可以直观地显示出模型的“注意力”分布。

为了生成热图,通常需要遵循以下步骤:

1. **选择卷积层:**选择一个或多个具有代表性的卷积层来生成热图。

2. **特征映射激活:**获取选中卷积层的特征映射激活值。

3. **权重转换:**将激活值转换为可解释的权重。

4. **上采样与归一化:**为了将特征映射与原始输入图像尺

0

0