BP神经网络预测网格搜索:超参数优化,提升模型性能

发布时间: 2024-07-21 16:03:18 阅读量: 33 订阅数: 42

# 1. BP神经网络简介**

**1.1 BP神经网络概述**

BP神经网络(反向传播神经网络)是一种多层前馈神经网络,它由输入层、隐含层和输出层组成。BP神经网络通过误差反向传播算法进行训练,能够学习复杂非线性的数据模式。

**1.2 BP神经网络的结构**

BP神经网络的结构通常为多层结构,每一层包含多个神经元。神经元之间通过权重和偏置相连。输入层接收输入数据,隐含层提取数据的特征,输出层输出预测结果。

# 2. BP神经网络超参数优化

### 2.1 学习率优化

学习率是BP神经网络训练过程中一个关键的超参数,它控制着权重更新的步长。学习率过大可能导致模型不稳定,甚至发散;学习率过小可能导致模型收敛缓慢,甚至陷入局部最优。

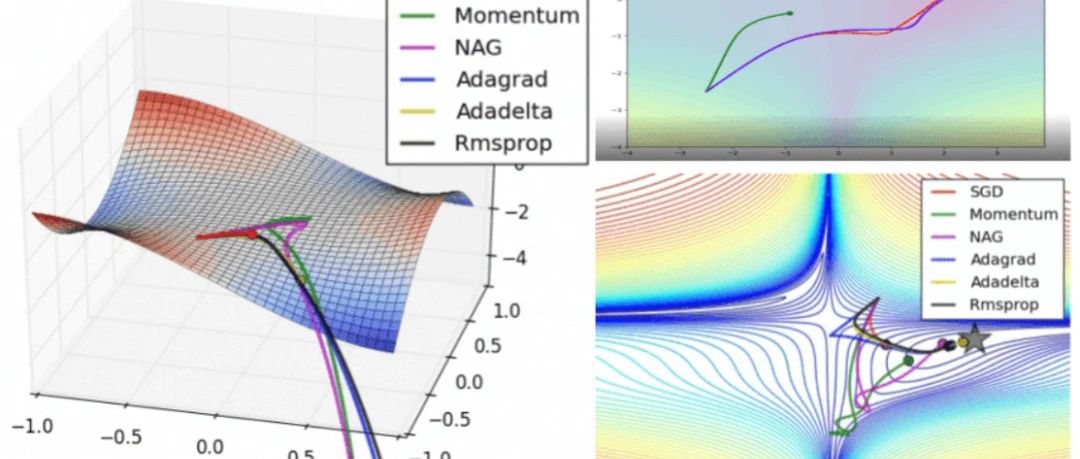

#### 2.1.1 常用优化算法

常用的学习率优化算法包括:

- **固定学习率:**使用一个固定的学习率 throughout 训练过程。

- **衰减学习率:**随着训练的进行,逐渐减小学习率。

- **自适应学习率:**根据训练过程中的梯度信息,动态调整学习率。

#### 2.1.2 优化策略

学习率优化策略包括:

- **手动调整:**根据经验或试错法,手动调整学习率。

- **网格搜索:**在预定义的学习率范围内,使用网格搜索找到最优值。

- **自适应优化算法:**使用自适应优化算法,如Adam或RMSprop,自动调整学习率。

**代码块:**

```python

import tensorflow as tf

# 定义学习率

learning_rate = 0.001

# 构建优化器

optimizer = tf.keras.optimizers.Adam(learning_rate=learning_rate)

```

**逻辑分析:**

这段代码使用Adam优化器,将学习率设置为0.001。Adam是一种自适应优化算法,它会根据梯度信息自动调整学习率。

### 2.2 隐含层节点数优化

隐含层节点数是BP神经网络中隐含层中神经元的数量。隐含层节点数过少可能导致模型欠拟合,而过大可能导致模型过拟合。

#### 2.2.1 确定隐含层节点数的方法

确定隐含层节点数的方法包括:

- **经验法则:**使用隐含层节点数为输入层和输出层节点数之和的2/3。

- **网格搜索:**在预定义的隐含层节点数范围内,使用网格搜索找到最优值。

- **交叉验证:**使用交叉验证来评估不同隐含层节点数对模型性能的影响。

#### 2.2.2 隐含层节点数对模型性能的影响

隐含层节点数对模型性能的影响如下:

- **欠拟合:**隐含层节点数过少会导致模型无法拟合训练数据,表现为训练误差高,测试误差也高。

- **过拟合:**隐含层节点数过大会导致模型过度拟合训练数据,表现为训练误差低,测试误差高。

- **最优:**存在一个最优的隐含层节点数,可以使模型在训练集和测试集上都获得较好的性能。

**代码块:**

```python

# 定义隐含层节点数

hidden_units = [16, 32, 64]

# 构建模型

model = tf.keras.Sequential([

tf.keras.layers.Dense(units=hidden_units[0], activation='relu'),

tf.keras.layers.Dense(units=hidden_units[1], activation='relu'),

tf.keras.layers.Dense(units=hidden_units[2], activation='relu'),

tf.keras.layers.Dense(units=1, activation='sigmoid')

])

```

**逻辑分析:**

这段代码构建了一个三层BP神经网络,隐含层节点数分别为16、32和64。激活函数使用ReLU,输出层使用sigmoid函数。

### 2.3 激活函数优化

激活函数是BP神经网络中神经元输出的非线性函数。不同的激活函数具有不同的特性,对模型性能有不同的影响。

#### 2.3.1 常见激活函数

常见的激活函数包括:

- **ReLU:*

0

0