人工智能中的随机数生成:训练机器学习模型

发布时间: 2024-07-03 09:24:33 阅读量: 132 订阅数: 41

# 1. 人工智能中的随机数生成概述

随机数生成在人工智能中扮演着至关重要的角色,它为算法提供了不可预测性和多样性,从而提高了模型的鲁棒性和泛化能力。随机数生成算法可分为两类:伪随机数生成器和真随机数生成器。

伪随机数生成器使用确定性算法生成看似随机的序列,而真随机数生成器则从物理过程或环境噪声中提取真正的随机性。在人工智能中,伪随机数生成器通常用于模型初始化、数据增强和超参数优化等任务,而真随机数生成器则用于安全关键型应用,如密码学和数字签名。

# 2. 随机数生成算法

### 2.1 伪随机数生成器

伪随机数生成器(PRNG)是一种算法,它生成一个数字序列,该序列看起来是随机的,但实际上是由一个确定的种子值生成的。PRNG 广泛用于各种应用中,包括模拟、游戏和密码学。

#### 2.1.1 线性同余法

线性同余法 (LCG) 是最简单的 PRNG 之一。它使用以下公式生成随机数:

```python

x_n = (a * x_{n-1} + c) % m

```

其中:

* `x_n` 是第 `n` 个随机数

* `x_{n-1}` 是前一个随机数

* `a` 是乘法器

* `c` 是增量

* `m` 是模数

LCG 的主要优点是其速度和简单性。然而,它也容易预测,因为给定种子值,就可以确定整个随机数序列。

#### 2.1.2 乘法同余法

乘法同余法 (MCG) 是另一种常用的 PRNG。它使用以下公式生成随机数:

```python

x_n = (a * x_{n-1}) % m

```

其中:

* `x_n` 是第 `n` 个随机数

* `x_{n-1}` 是前一个随机数

* `a` 是乘法器

* `m` 是模数

MCG 比 LCG 更难预测,但它也更慢。

### 2.2 真随机数生成器

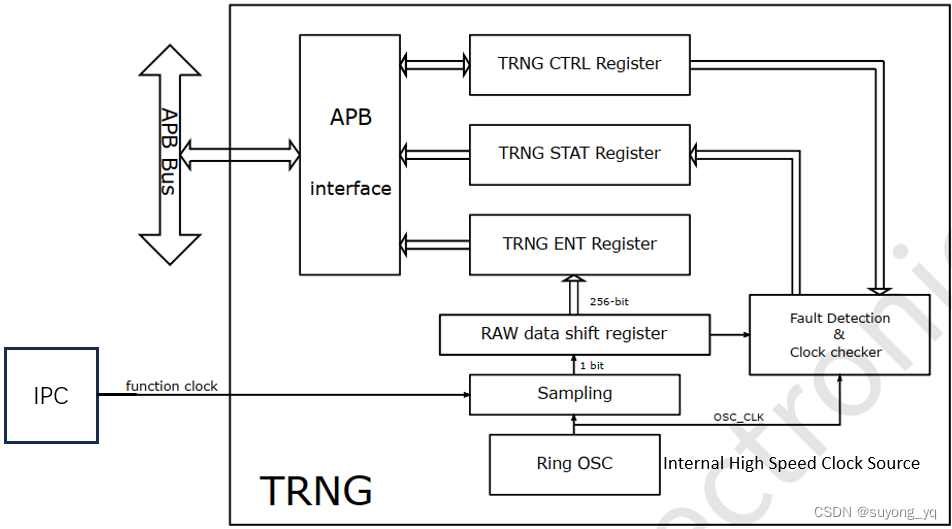

真随机数生成器 (TRNG) 是一种算法,它生成一个数字序列,该序列是真正随机的,不受任何确定性因素的影响。TRNG 用于需要高度安全性的应用中,例如密码学和博彩。

#### 2.2.1 物理随机数生成器

物理随机数生成器 (PRNG) 使用物理现象来生成随机数。例如,一些 PRNG 使用大气噪声或放射性衰变作为随机性来源。PRNG 通常比 PRNG 更安全,但它们也更昂贵且更难实现。

#### 2.2.2 伪随机数生成器增强

伪随机数生成器增强 (PRNG+) 是 PRNG 和 TRNG 的混合体。PRNG+ 使用 PRNG 生成随机数序列,然后使用 TRNG 对序列进行增强,以使其更加随机。PRNG+ 比 PRNG 更安全,但它们也更慢且更昂贵。

# 3. 随机数生成在机器学习中的应用

### 3.1 模型初始化

模型初始化是机器学习中的关键步骤,它决定了模型的初始状态,对模型的收敛速度和最终性能有显著影响。随机数生成在模型初始化中扮演着至关重要的角色,它为模型的权重和偏置提供了随机的初始值,打破了对称性,促进了模型的训练。

#### 3.1.1 权重和偏置的初始化

权重和偏置是神经网络中的可学习参数,它们控制着网络的输出。随机初始化这些参数有助于防止网络陷入局部最优,并促进网络对训练数据的泛化。

常用的随机初始化方法包括:

- **均匀分布初始化:**将权重和偏置初始化为均匀分布中的随机值。这种方法简单易用,但可能会导致梯度消失或爆炸问题。

- **正态分布初始化:**将权重和偏置初始化为正态分布中的随机值。这种方法可以产生更平滑的梯度,但需要调整标准差以避免梯度消失或爆炸。

- **Xavier 初始化:**一种专门针对深度神经网络的初始化方法。它根据网络层的输入和输出维度计算权重的方差,以确保梯度在网络中均匀传播。

```python

import numpy as np

# 均匀分布初始化

weights = np.random.uniform(-1, 1, (input_dim, output_

```

0

0