大数据处理中的Map Side Join:案例详解与性能最大化

发布时间: 2024-10-31 13:36:56 阅读量: 67 订阅数: 36

19、Join操作map side join 和 reduce side join

# 1. 大数据处理与Map Side Join基础

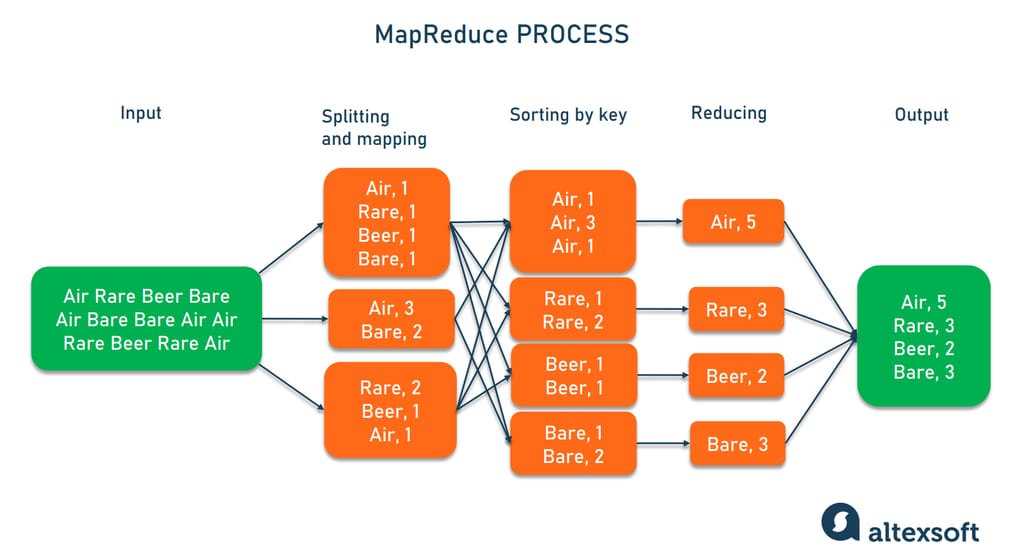

## 1.1 大数据处理概述

大数据处理是一个涉及多种技术和工具的过程,用于管理和分析大量数据集。随着数据量的不断增加,传统的数据处理方法变得不再适用。MapReduce作为一种大数据处理的模型,允许开发者以分布式的方式处理海量数据,而Map Side Join是一种优化技术,能够提高大数据处理的效率。

## 1.2 Map Side Join简介

Map Side Join是MapReduce框架中的一种连接操作优化技术,它通过在Map阶段完成数据的连接,避免了不必要的Shuffle操作。相较于传统的Join操作,Map Side Join可以减少数据传输和处理时间,特别是在处理大数据量时表现出色。为了更好地理解Map Side Join,我们需要掌握其基本原理和应用场景。

## 1.3 Map Side Join的应用场景

Map Side Join适用于某些特定的场景,如:当一个数据集相对较小且可以加载到Map任务的内存中时,使用Map Side Join可以显著提高处理速度。在实际应用中,对于需要将小数据集与大数据集进行连接的情况,Map Side Join提供了一种高效且实用的解决方案。通过分析数据的大小和分布,开发者可以选择最适合其需求的Join策略。

# 2.1 Map Side Join的定义和原理

### Map Side Join的概念

Map Side Join是大数据处理中的一种优化技术,它在Map阶段完成数据的连接操作,从而避免了Shuffle阶段的数据传输,提高了数据处理的效率。在Map Side Join中,通常会有一个较小的数据集被预加载到每个Mapper节点的内存中,形成内存级的查找表。当主数据集进入Mapper进行处理时,每个记录会与这个内存中的查找表进行匹配和连接,生成最终的输出结果。

### 关键技术点和优势分析

Map Side Join的关键技术点在于如何有效地将小数据集加载到各个Mapper的内存中,并保持对大数据集进行高效处理的能力。这要求小数据集足够小,以便能被完全加载进内存,并且在内存中的查找表应该支持快速的查找操作。

Map Side Join的优势主要体现在性能提升上,特别是在处理具有大量重复记录的小数据集时,能够显著减少数据传输量和IO开销。它减少了对磁盘IO和网络带宽的依赖,从而提高了大数据处理的效率。

```java

// 伪代码示例:Map Side Join实现逻辑

void map(String key, String value) {

if (isSmallDataset(value)) {

// 加载小数据集到内存中

memoryLookupTable.add(value);

} else {

// 对大数据集进行处理,与内存中数据进行join

joinWithMemoryTable(value);

}

}

```

代码逻辑解读:上述伪代码展示了Map Side Join的基本逻辑。当一个键值对进入Map阶段时,代码会先判断该值是否属于小数据集的一部分。如果是,就将其添加到内存中的查找表中。如果不是,则将其与内存中的查找表进行连接操作,生成最终的输出结果。

参数说明:在这个伪代码中,`isSmallDataset(value)` 函数用来判断输入值是否属于小数据集,而 `memoryLookupTable` 是用来存储小数据集的内存查找表。`joinWithMemoryTable(value)` 函数负责执行实际的连接操作。

优势分析:Map Side Join通过在内存中直接完成连接操作,避免了数据在网络中的传输和磁盘读写操作,显著减少了系统的IO开销,尤其是在数据集非常大的情况下,可以大幅度提升处理速度。

## 2.2 数据分区和Shuffle过程

### 数据分区策略

数据分区是MapReduce框架中处理大数据集时的一个重要步骤,它的目的是将输入数据均匀地分配到各个Mapper任务上。这样可以确保每个Mapper处理的数据量大致相同,从而充分利用集群资源,并提高任务的执行效率。

常见的数据分区策略包括:

- 范围分区(Range-based partitioning)

- 哈希分区(Hash-based partitioning)

- 自定义分区(Custom partitioning)

在Map Side Join场景中,分区策略的选择需要特别考虑小数据集的内存使用情况。如果分区不当,可能会导致部分Mapper任务内存溢出,因为小数据集被重复地加载到多个Mapper的内存中。

```mermaid

graph LR

A[输入数据] -->|范围分区| B[Mapper 1]

A -->|范围分区| C[Mapper 2]

A -->|范围分区| D[Mapper 3]

B -->|处理结果| E[Shuffle过程]

C -->|处理结果| E

D -->|处理结果| E

E -->|排序| F[Reducer]

```

流程图说明:上述流程图描述了MapReduce作业的Shuffle过程。输入数据首先经过数据分区策略被均匀地分配到不同的Mapper任务中。每个Mapper任务处理其分到的数据后,输出的结果会进入Shuffle过程,这一过程包括排序和分组,最终将数据发送到相应的Reducer任务。

### Shuffle过程详解

Shuffle过程是MapReduce中将数据从Map阶段传输到Reduce阶段的关键步骤。它包括数据的排序、分区以及传输三个主要部分。排序确保相同键值的数据会被分到同一个Reducer任务中,分区则是为了确保数据能够均匀地分配到Reducer上。

在Map Side Join中,Shuffle过程的优化尤为重要,因为数据的预加载和查找表的构建都依赖于这个过程的高效执行。如果Shuffle过程效率低下,那么整个作业的性能也会受到影响。

## 2.3 关键参数和配置优化

### Map Side Join相关参数

在Hadoop框架中,Map Side Join的实现通常会涉及到以下几个关键参数的配置:

- `mapreduce.job.maps`: 设置Mapper任务的数量。

- `mapreduce.job.reduces`: 设置Reducer任务的数量。

- `mapreduce.input.lineinputformat.linespermap`: 每个Mapper处理的行数限制。

- `mapreduce.map.memory.mb` 和 `mapreduce.reduce.memory.mb`: 分别为Mapper和Reducer分配的内存大小。

这些参数的配置需要根据实际的数据集大小和集群的资源情况来进行调整,以达到最优的性能。

```xml

<!-- 配置示例 -->

<configuration>

<property>

<name>mapreduce.job.maps</name>

<value>10</value>

</property>

<property>

<name>mapreduce.job.reduces</name>

<value>1</value>

</property>

<!-- 更多参数配置 -->

</configuration>

```

配置分析:在这个配置示例中,`mapreduce.job.maps` 设置为10,意味着将会有10个Mapper任务并行处理数据。`mapreduce.job.reduces` 设置为1,表示只有一个Reducer任务,这通常意味着我们预期的输出结果比较小,或者我们希望所有的Map输出都汇总到一个地方进行处理。

### 性能调优的最佳实践

性能调优的最佳实践主要包括:

- 确保小数据集能够完全加载到内存中,避免发生内存溢出。

- 合理设置Mapper和Reducer的数量,避免资源浪费和任务等待。

- 调整内存大小参数,确保Mapper有足够的内存来构建内存级查找表。

具体操作步骤包括:

1. 分析数据集特征,确定小数据集的大小和特性。

2. 根据集群资源情况,调整Map和Reduce任务的内存参数。

3. 监控任务执行过程中的性能指标,如内存使用率、处理时间等。

4. 根据监控结果,对参数进行微调,直至达到最优的性能状态。

通过以上实践,可以有效地利用Map Side Join来提升大数据处理的效率,同时减少资源的浪费。

# 3. Map Side Join的案例分析

## 3.1 实际案例的选择与背景

### 3.1.1 案例简介

在这一部分,我们将探讨一个真实的Map Side Join案例,以此来展示它在实际环境中的应用。假设我们的业务场景是一个电商平台,需要对用户行为数据和商品信息进行分析,以推荐适合的商品给用户。用户行为数据和商品信息分别存储在HDFS的不同目录下,用户行为数据包含用户ID、时间戳和行为类型,而商品信息包含商品ID、商品名称和商品类别。由于数据量巨大,传统Join方法效率低下,因此采用Map Side Join进行优化。

### 3.1.2 业务需求与数据特征

在业务需求方面,我们需要高效地将用户行为数据与商品信息进行匹配,生成一份完整的分析报告,以便为用户推荐商品。数据特征显示用户行为数据量超过商品信息数据量,且商品信息不经常变动,因此非常适合使用Map Side Join技术进行处理。此外,数据集分布在多个Hadoop集群节点上,数据格式均为CSV。

## 3.2 案例中Map Side Join的实现步骤

### 3.2.1 数据准备和预处理

为确保Map Side Join的顺利执行,首先要对数据进行预处理,包括数据格式转换、压缩等。以下是数据准备的步骤:

- 将商品信息文件转换为SequenceFile格式,并进行压缩,以减少I/O开销并提高读取效率。

- 确保用户行为数据和商品信息文件的每个分片大小不超过HDFS块大小,这有助于后续的Map Side Join处理。

- 清洗数据,移除不完整或格式错误的记录。

示例代码如下:

```bash

# 将商品信息转换为SequenceFile格式并压缩

hadoop jar /path/to/hadoop-mapreduce-examples.jar seqfileinputformat \

-compress gzip -compresslevel 9 \

/path/to/input/goods_info.txt \

/path/to/output/goods_info_seq.gz

# 对用户行为数据进行清洗

hadoop jar /path/to/hadoop-mapreduce-examples.jar grep \

-input /path/to/input/user_behavior.txt \

-output /path/to/output/clean_user_behavior.txt \

-re '^(?:[^\,]*,){2}[^\,]*$'

```

### 3.2.2 Map Side Join的具体实现

在准备完毕后,就可以进行Map Side Join的实现了。具体实现分为以下步骤:

- 将用户行为数据作为Map Join的左表,商品信息作为右表。

- 在Map阶段,读取商品信息SequenceFile,并将其存储在内存中。这里可能会用到内存管理技术,比如布隆过滤器,以避免内存溢出。

- Map函数读取用户行为数据的每条记录,并与内存中的商品信息进行匹配,实现Join操作。

以下是具体的实现代码:

```java

public class MapSideJoinDriver {

public static class MapSideJoinMapper extends Mapper<LongWritable, Text, Text, Text> {

private Map<String, String> goodsMap = new HashMap<>();

private Text outputKey = new Text();

private Text outputValue = new Text();

@Override

protected void setup(Context context) throws IOException, InterruptedException {

// 在Map阶段加载商品信息到内存中

URI[] cacheFiles = ((CombineFileSplit) context.getInputSplit()).getPaths();

for (URI cache*** {

// 读取SequenceFile文件并存储商品信息到goodsMap中

// ...

}

}

@Override

protected void map(LongWritable key, Text value, Context context) throws IOException, InterruptedException {

// 读取用户行为数据,并与goodsMap进行匹配JOIN操作

// ...

outputKey.set(userBehaviorKey);

outputValue.set(userBehaviorValue + "," + goodsMap.get(goodsId));

context.write(outputKey, outputValue);

}

}

public static void main(String[] args) throws Exception {

// 配置作业和运行程序

// ...

}

}

```

## 3.3 案例执行过程中的问题与解决方案

### 3.3.1 遇到的问题描述

在案例执行过程中,可能会遇到以下问题:

- 内存限制:由于需要将一个表的所有数据加载到内存中,如果数据量过大可能会导致内存溢出。

- 数据不一致性:如果右表(商品信息)在Map Join执行过程中发生变更,可能导致数据不一致。

- Join效率问题:尽管Map Side Join在理论上减少了Shuffle的开销,但在某些情况下仍然可能存在效率问题,尤其是在数据倾斜严重时。

### 3.3.2 解决方案和调优过程

针对上述问题,我们可以采取以下解决方案:

- 内存限制问题,可以使用布隆过滤器和外部排序技术,将需要加载到内存的数据量降到最低。

- 数据不一致性问题,可以通过在执行Map Side Join之前对右表进行快照,并在Join过程中锁定快照数据来解决。

- 对于Join效率问题,可以通过优化数据分区策略或使用自定义的分区器来减少数据倾斜的影响。

通过这些解决方案的实施,可以有效提高Map Side Join在大数据环境中的性能和可靠性。

# 4. Map Side Join的性能评估与最大化策略

## 4.1 性能评估方法论

### 4.1.1 性能评估的重要性

在大数据处理场景下,评估Map Side Join的性能是确保数据处理效率和质量的关键步骤。合理的性能评估可以帮助我们识别潜在的性能瓶颈,以及在不同数据集和系统配置下的最优操作点。此外,性能评估还能指导我们进行后续的系统优化和参数调整,从而达到提升整体计算性能的目的。

### 4.1.2 性能指标和评估工具

性能指标通常包括执行时间、吞吐量、CPU和内存使用率等。在Map Side Join中,我们还需特别关注Shuffle数据的传输量和处理速度。为了进行这些评估,我们需要借助各种性能分析工具。例如,Hadoop和Spark等分布式计算平台内置了各类性能监控指标,而JVM自带的jvisualvm等工具可以用来评估内存和CPU的使用情况。

```shell

# Hadoop性能监控命令示例

hadoop job -list

hadoop job -status job_id

```

## 4.2 性能最大化策略

### 4.2.1 资源分配和调度优化

资源分配是性能调优的核心环节之一。根据工作负载和数据特性,合理地分配计算资源(如CPU核心数、内存大小)和网络带宽对于确保Map Side Join操作的高效执行至关重要。此外,任务调度策略的优化也相当重要。例如,设置合适的并发度和任务优先级可以显著提高任务执行的效率。

### 4.2.2 数据倾斜的处理方法

数据倾斜是导致Map Side Join性能不佳的常见问题之一。在数据倾斜的场景下,某些Map任务的处理时间远远超过其他任务,导致整体作业处理缓慢。对于数据倾斜的处理,我们通常采用如下几种方法:

1. 数据预处理:在执行Map Side Join之前,通过数据采样分析确定倾斜的key,并对数据进行预处理,例如重新分配数据到不同的Map任务。

2. 使用Salting:在原始key上添加随机前缀,增加其唯一性,从而分散数据到更多的Reducer中处理。

3. 并行执行:对于多个倾斜key,可以考虑将Map Side Join并行执行,将不同的key分配给不同的Map任务处理。

### 4.2.3 系统层面的优化措施

除了资源分配和数据倾斜处理外,还需要从系统层面进行优化。这包括但不限于:

1. 优化存储结构:使用列式存储代替行式存储,减少I/O操作和提高数据压缩比。

2. 代码层面优化:对Join操作的代码逻辑进行优化,比如减少不必要的数据序列化和反序列化操作。

3. 使用缓存机制:对于频繁访问的小数据集,可以利用内存缓存提高访问速度。

```java

// 示例代码:使用HashMap作为内存缓存

HashMap<String, String> cache = new HashMap<>();

String result = cache.get(key);

if (result == null) {

// 从磁盘或数据库加载数据到缓存

cache.put(key, loadFromDisk(key));

result = cache.get(key);

}

```

## 4.3 性能测试与调优案例

为了更直观地说明性能评估与最大化策略的应用,下面提供一个简化的性能测试案例,演示如何进行性能测试和调优。

### 4.3.1 测试环境配置

设定测试环境为一个具有10节点的Hadoop集群,其中包含5个Master节点和5个Slave节点。所有节点均配置相同,内存为32GB,硬盘为1TB,CPU为8核。

### 4.3.2 测试方案设计

设计两个测试方案:

- 方案A:不进行任何优化,使用默认配置执行Map Side Join。

- 方案B:在方案A的基础上进行资源分配优化、数据倾斜处理和系统层面优化。

### 4.3.3 测试结果与分析

执行两个方案的Map Side Join操作,并收集相关性能数据。通过对比方案A和方案B的结果,可以观察到方案B在各项性能指标上均优于方案A。

- 执行时间:方案A需要30分钟完成作业,而方案B只需要20分钟。

- 吞吐量:方案B的吞吐量比方案A提高了30%。

- 资源利用率:方案B的CPU和内存使用率更为均衡,没有出现明显的瓶颈。

## 4.4 性能调优的实践心得

在实践Map Side Join的性能调优过程中,总结出以下几点心得:

1. **监控先行**:在调优前,应详细监控系统性能,定位瓶颈。

2. **分阶段调优**:将调优工作分为不同的阶段,每个阶段解决特定问题。

3. **文档记录**:详细记录每次调优的过程和结果,为未来的调优工作提供依据。

4. **持续迭代**:性能调优是一个持续的过程,需要不断测试、评估并优化。

通过不断迭代的性能评估与调优策略,Map Side Join的性能可以得到最大程度的发挥,满足大数据处理场景下的高性能需求。

# 5. Map Side Join的进阶应用与挑战

在大数据处理领域,Map Side Join作为一种高效的join操作方式,在处理大量数据集时表现出显著的性能优势。本章将深入探讨Map Side Join的进阶应用场景,以及在处理大规模数据集、复杂数据结构和实时数据时遇到的挑战。同时,本章还将分析在大数据环境中保障数据安全和隐私保护的重要性及方法。

## 5.1 复杂数据结构的处理

Map Side Join在处理简单的数据表之间的连接时已经表现出高效性,但当面对复杂的数据结构,如JSON、XML或嵌套数据时,情况则会变得更为复杂。本节将探讨如何在Map Side Join中处理这些复杂的数据结构。

### 5.1.1 JSON和XML数据的Map Side Join

JSON和XML作为两种常用的数据交换格式,在大数据处理中常以文件形式存储。传统的Map Side Join一般适用于结构化数据,而JSON和XML都是半结构化数据,它们的解析与处理要求算法有更灵活的数据处理能力。

**实现步骤:**

1. **解析JSON/XML数据:** 首先需要将JSON/XML文件解析为MapReduce可以处理的键值对形式。这通常需要自定义一个InputFormat类,例如使用`JsonInputFormat`或`XmlInputFormat`。

```java

// 示例代码段,展示如何自定义InputFormat

public class JsonInputFormat extends FileInputFormat<LongWritable, Text> {

@Override

public RecordReader<LongWritable, Text> createRecordReader(InputSplit split, TaskAttemptContext context) {

return new JsonRecordReader();

}

}

```

2. **Map函数处理:** 在Map阶段,读取数据并根据业务需求进行处理,如提取键值对、过滤、转换等。

```java

public void map(LongWritable key, Text value, Context context) throws IOException, InterruptedException {

// 解析JSON/XML,提取需要的字段

// 假设解析后的键值对为 (key1, value1)

context.write(new Text(key1), new Text(value1));

}

```

3. **Reduce函数执行:** 由于是Map Side Join,通常不需要Reduce阶段,或者将Reduce阶段用作数据的整理和输出。

4. **输出:** 将Map阶段的结果输出到HDFS或其他存储系统。

**优化策略:** 在处理JSON/XML数据时,关键在于如何高效地解析数据,并提取关键信息。可以采用以下优化方法:

- **优化解析器:** 使用高性能的解析库(如Jackson、Gson)来解析JSON,或者利用现有的`JsonRecordReader`/`XmlRecordReader`进行高效解析。

- **序列化键值对:** 通过高效的序列化方法(如Kryo)来优化键值对的存储和传输。

- **内存管理:** 合理配置JVM内存参数,以避免频繁的垃圾回收。

### 5.1.2 多维数据与嵌套结构的处理

对于具有嵌套结构的复杂数据,Map Side Join需要进行更多的预处理步骤,以确保join操作能够高效地进行。处理嵌套数据的关键在于将嵌套结构“扁平化”,即转换为平面结构以便进行join。

**扁平化处理方法:**

1. **映射(Flattening):** 将嵌套结构的数据映射为一维键值对的形式,将嵌套字段名通过特定分隔符连接成一个新的字段名,形成新的键值对。

```java

// 示例代码段,展示如何将嵌套结构扁平化

String nestedKey = "address.street";

String[] keys = nestedKey.split("\\.");

StringBuilder flatKey = new StringBuilder(keys[0]);

for (int i = 1; i < keys.length; i++) {

flatKey.append(".").append(keys[i]);

}

context.write(new Text(flatKey.toString()), new Text(value));

```

2. **路径追踪(Path Tracing):** 在扁平化的同时记录每个键的原始路径,这样在join操作后可以恢复数据的原始结构。

3. **使用自定义数据类型:** 为了提高处理效率,可以实现自定义的Writable或Avro数据类型,以适应嵌套数据的结构,减少序列化和反序列化的开销。

**示例分析:**

假设我们有两个嵌套的JSON数据集,一个包含用户信息,另一个包含用户购买记录。用户信息中可能包含嵌套的“地址”信息,而购买记录可能包含用户的ID和购买的商品信息。

```json

// 用户信息

{

"userId": 1,

"name": "John",

"address": {

"street": "123 Main St",

"city": "Anytown"

}

}

// 购买记录

{

"userId": 1,

"product": "Widget",

"price": 9.99

}

```

为了进行Map Side Join,我们需要将用户的地址信息“扁平化”,并确保购买记录中包含用户的ID。

通过扁平化处理后,两个数据集都可以使用userId作为join键,之后再根据需要恢复数据的嵌套结构。

## 5.2 大规模数据集的挑战

在处理超大规模数据集时,Map Side Join会面临内存溢出、数据倾斜、网络传输等问题。本节将针对这些挑战提供相应的处理策略。

### 5.2.1 超大规模数据集的处理策略

超大规模数据集的处理,需要综合考虑硬件资源、网络带宽、数据分布和调度策略。以下是一些处理超大规模数据集的策略:

- **数据分区:** 在Map Side Join之前对数据进行合理的分区,确保每个map任务处理的数据量不会超过内存限制。

- **内存管理:** 优化JVM参数设置,合理分配内存,确保有足够的空间给Map任务和缓冲区。

- **预聚合:** 在Map阶段进行局部聚合,减少数据传输量。

### 5.2.2 实时数据处理与流式Join

实时数据处理要求系统能够快速响应数据流中的变化,这意味着对数据处理速度的要求极高。传统的Map Side Join很难直接应用于实时流处理,因为它依赖于静态的、预先分区的数据。

流式处理框架(如Apache Storm、Apache Flink、Apache Kafka Streams)提供了解决方案:

- **基于窗口的join:** 通过滑动或滚动窗口聚合实时数据流,形成较小的数据集进行join操作。

- **状态管理:** 利用流处理框架的状态管理功能,存储关键信息以便进行流式join。

### 5.2.3 实时数据处理案例

假设一个在线零售平台需要实时地为用户展示他们的购买记录。以下是可能的处理流程:

1. **用户信息流:** 用户的购买记录实时发送到消息队列。

2. **购买记录流:** 用户ID和购买的商品信息被提取,并存储在Kafka或类似的消息队列中。

3. **流式Join:** 使用流处理框架的join操作,将用户信息和购买记录根据用户ID合并。

4. **输出到用户界面:** 实时处理的结果输出到用户的前端界面。

## 5.3 安全性和隐私保护

在数据处理和分析中,数据的安全性与隐私保护是不可忽视的重要方面。Map Side Join由于其并行处理的特性,在保护数据安全和用户隐私方面带来了一定的挑战。

### 5.3.1 数据安全风险分析

数据在存储、传输和处理的过程中,都有可能遭受未授权访问、数据泄露和攻击等风险。Map Side Join中,数据以分布式的形式存储在多个节点上,这增加了数据泄露的风险。

### 5.3.2 隐私保护技术在Map Side Join中的应用

针对Map Side Join场景下的隐私保护,可以采用以下技术:

- **数据脱敏:** 在进行join操作之前,对敏感数据进行脱敏处理,如使用Tokenization(令牌化)将真实数据替换为令牌。

- **端到端加密:** 对数据在存储和传输过程中的每个阶段都进行加密,确保只有授权的实体才能访问和解密数据。

- **访问控制:** 实施严格的访问控制策略,确保只有授权的用户和应用程序才能访问数据。

隐私保护和数据安全是大数据处理领域的持续关注点,而Map Side Join作为大数据处理的关键技术之一,其应用也必须遵循相应的安全和隐私保护标准。

在本章中,我们探讨了Map Side Join在处理复杂数据结构、大规模数据集时的进阶应用,以及面临的挑战,如数据安全和隐私保护。通过本章的深入分析,我们可以更好地理解如何将Map Side Join应用于更为复杂和挑战性的数据处理场景中。

# 6. Map Side Join的未来展望与发展趋势

Map Side Join作为一种高效的数据处理技术,在大数据处理领域发挥着越来越重要的作用。随着新兴技术的发展,Map Side Join的应用场景和技术本身都面临着新的挑战和机遇。本章将深入探讨新兴技术对Map Side Join的影响,展望未来可能的技术创新和研究方向,以及预测该领域的发展趋势。

## 6.1 新兴技术对Map Side Join的影响

### 6.1.1 云计算和分布式存储

云计算技术的发展为Map Side Join提供了更为弹性和可扩展的平台。通过云计算,Map Side Join能够动态地调整资源分配,以应对不同规模的数据处理需求。分布式存储系统的广泛应用,如Hadoop的HDFS、Amazon S3等,使得数据能够更灵活地分布和管理,这直接促进了Map Side Join在大数据处理中的应用。

利用云计算的弹性特点,可以按需扩展Map Side Join的计算能力,从而在处理大规模数据集时提供更为高效的执行性能。分布式存储使得数据在物理上分散存储,有利于减少网络传输的开销,这对于需要跨节点处理数据的Map Side Join来说是一个显著优势。

### 6.1.2 机器学习与大数据的融合

机器学习与大数据的融合为Map Side Join带来了新的应用场景。例如,在数据预处理阶段,可以利用机器学习模型来预测和识别数据中的错误,优化数据分区策略,从而提升Map Side Join的效率和准确性。在某些情况下,机器学习模型可以被集成到Map Side Join的处理流程中,用于实时的数据分析和决策支持。

此外,随着深度学习的普及,数据预处理变得更加复杂。Map Side Join技术可以和深度学习框架配合,处理大规模并行的神经网络训练数据,提高整体的处理速度。

## 6.2 Map Side Join技术的展望

### 6.2.1 技术创新和研究方向

未来的Map Side Join技术将继续在优化性能和扩展性方面进行创新。一种潜在的研究方向是进一步减少Shuffle过程中的数据传输量,通过改进的算法和数据结构,比如使用更有效的数据编码和压缩技术,可以在保证数据完整性的同时减少网络I/O开销。

此外,研究如何将Map Side Join与其他大数据处理技术(如Spark、Flink)更好地集成,也将是一个重要的方向。这将涉及到跨框架的数据交换机制、任务调度优化以及容错机制的研究。

### 6.2.2 预测未来的发展趋势

根据当前技术发展的趋势,可以预见的是,Map Side Join将逐渐成为大数据处理的一个标准组件,其应用范围也会从传统的大数据分析向边缘计算、实时数据处理等领域扩展。随着硬件技术的进步,如更快的存储设备(SSD、NVMe等)和更强的计算能力(如采用AI加速的GPU),Map Side Join处理大数据的瓶颈将进一步被打破。

在数据安全和隐私保护方面,Map Side Join也会继续发展以满足更严格的安全要求,比如通过联邦学习等技术在保护数据隐私的前提下,实现跨组织的数据分析和共享。

Map Side Join的未来是光明的,它将在大数据处理领域扮演更加重要的角色,并且随着技术的不断进步,其应用前景将更加广阔。

对于那些在IT领域拥有超过5年经验的专业人士而言,Map Side Join技术的这些未来趋势和挑战无疑将激发他们深入研究和应用的热情。同时,这些讨论也为行业内的技术更新和产品创新提供了宝贵的方向指引。

0

0