【MapReduce中间数据的容错机制】:确保数据安全存储与恢复策略解析

发布时间: 2024-11-01 01:44:39 阅读量: 33 订阅数: 29

java+sql server项目之科帮网计算机配件报价系统源代码.zip

# 1. MapReduce中间数据容错机制概述

MapReduce作为一种分布式计算模型,广泛应用于大数据处理中,其核心是能够处理海量数据并提供高度容错的计算能力。在MapReduce作业执行过程中,中间数据的容错机制是保证整体计算稳定性和可靠性的关键。一旦中间数据因各种原因出现丢失或损坏,通过有效的容错机制可以重新计算丢失的数据,确保整个作业最终能够成功完成。本章将从宏观的角度对MapReduce中间数据的容错机制进行概述,为读者提供一个整体的认识框架,为后续章节的深入分析打下基础。

# 2. MapReduce中间数据的理论基础

MapReduce模型作为大数据处理的核心框架,被广泛应用于处理海量数据。了解其理论基础对于深入掌握MapReduce机制至关重要。本章节从MapReduce模型的工作原理出发,探讨中间数据的角色和重要性,以及容错机制的理论模型。

## 2.1 MapReduce模型的工作原理

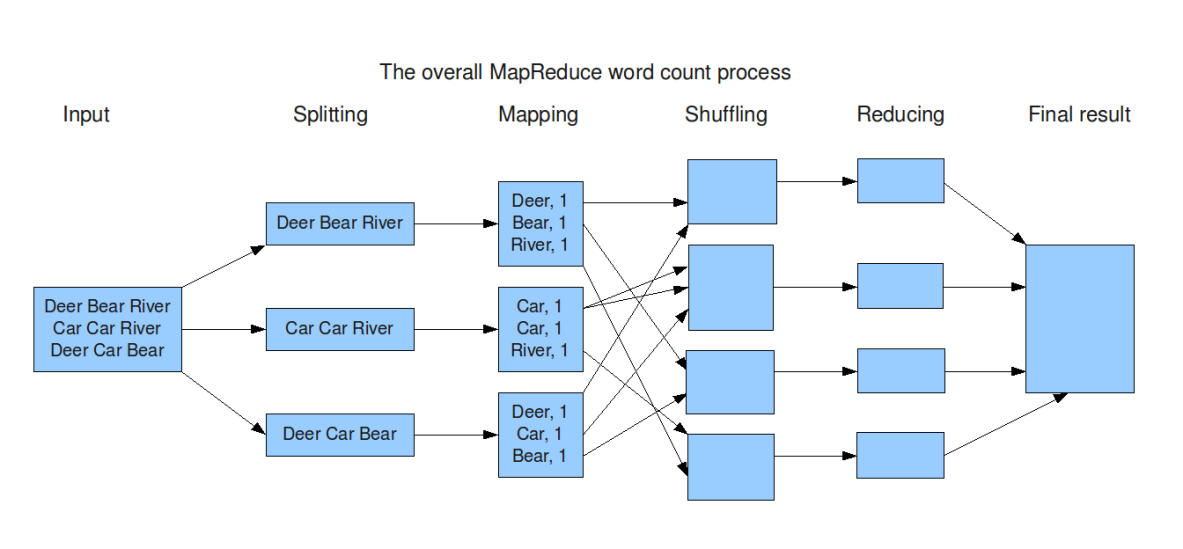

### 2.1.1 Map阶段与Reduce阶段的数据流动

MapReduce框架的工作流程分为两个阶段:Map阶段和Reduce阶段。在Map阶段,输入数据经过处理后被转换成键值对(key-value pairs)。这些键值对随后通过Shuffle过程被分发到不同的Reduce任务中。

```python

# Python示例代码

def map_function(line):

key, value = process(line)

return key, value

map_output = map_function(input_data)

```

在上述伪代码中,`map_function` 函数处理输入数据`input_data`,转换成键值对,并返回给MapReduce框架。然后通过Shuffle过程,这些数据被送到Reduce阶段进行汇总和处理。

### 2.1.2 中间数据的角色和重要性

MapReduce中间数据指的是在Map阶段处理后生成的中间键值对数据,它在Shuffle过程中起着承上启下的作用。中间数据的存储对于整个处理流程的稳定性和效率都至关重要。

```python

# Python示例代码

def shuffle(map_output):

# Shuffle过程中的数据传输和组织

return sorted(map_output, key=lambda x: x[0])

```

在Shuffle过程中,中间数据根据其键值进行排序,并分发给对应的Reduce任务。由于数据量可能非常巨大,因此合理地管理这部分数据是确保MapReduce任务高效运行的关键。

## 2.2 容错机制的理论模型

### 2.2.1 数据副本策略

为了防止数据丢失,MapReduce框架采用数据副本策略。在Hadoop中,数据副本策略通常保证数据在不同的DataNode上存储,从而提高数据的可靠性。

```json

// Hadoop数据副本配置示例

{

"dfs.replication": 3

}

```

上述配置表示每个数据块默认复制3份。副本策略不仅影响数据的可靠性,还会影响整体的存储和网络开销。

### 2.2.2 容错与数据一致性模型

MapReduce容错机制必须确保即使在节点故障的情况下,整个处理过程依然能够正确地执行。为此,MapReduce框架采用了一种基于数据一致性的容错模型。这个模型假定任务失败是常态,而非异常。通过重新执行失败的任务,并且保证输入数据不会发生变化,确保了数据的一致性。

```mermaid

graph LR

A[开始任务执行] --> B{任务是否成功}

B -- 是 --> C[任务完成]

B -- 否 --> D[任务失败]

D --> E[重新调度任务]

E --> A

```

在上述流程图中,MapReduce通过不断检查任务执行结果来确保任务成功。如果任务失败,系统会自动重新调度执行,直到成功为止。这种设计允许MapReduce处理在有节点故障的情况下依然能够持续运作。

通过上述分析,我们对MapReduce中间数据的理论基础有了全面的了解,接下来的章节将深入探讨中间数据的存储与备份技术。

# 3. 中间数据的存储与备份技术

在大数据处理框架中,中间数据的存储与备份是保证数据处理可靠性与高可用性的重要环节。本章将深入探讨分布式文件系统对中间数据的管理方式,以及快照与恢复机制在中间数据管理中的应用。

## 3.1 分布式文件系统(DFS)对数据的管理

### 3.1.1 HDFS的数据块与备份机制

Hadoop Distributed File System(HDFS)是MapReduce默认的分布式文件系统,它采用数据块(block)的形式将文件拆分成小块来存储,以提高系统的容错能力和处理速度。

HDFS的数据块大小通常为128MB或256MB,这种设计使得它能够更好地利用磁盘空间,并且能够在节点故障时快速重新复制丢失的数据块。每个数据块都会被系统自动复制三份(这是默认设置,可以根据实际需要调整),分布在不同的数据节点(DataNode)上。

#### 数据备份原理

数据备份机制的核心在于数据冗余,HDFS会根据预设的策略自动完成数据块的复制,确保数据的高可用性。当数据被写入HDFS时,它被分为一系列的数据块,并且每个数据块都会被复制到多个节点上。这样的设计可以确保即便在一些节点发生故障时,数据块仍然可以从其他节点上获取,从而保证了数据的完整性。

### 3.1.2 DFS的读写操作及其容错策略

#### DFS读写流程

HDFS的读写操作遵循以下流程:

- **写操作:**

1. 客户端向NameNode发起写操作请求。

2. NameNode为文件分配块,并返回数据块所在DataNode的信息给客户端。

3. 客户端直接与DataNode通信,将数据写入分配的数据块。

- **读操作:**

1. 客户端向NameNode发起读操作请求。

2. NameNode返回数据块所在DataNode的信息。

3. 客户端从最近的DataNode读取数据块。

#### 容错策略

HDFS的容错策略围绕数据块的自动备份机制展开,其核心是以下几点:

1. **数据块复制:** 数据块的多个副本来保证数据在节点故障时不会丢失。

2. **心跳检测与异常处理:** DataNode定时向NameNode发送心跳信息,表明自己的健康状态。如果NameNode在指定时间内没有收到心跳信息,则认为该DataNode故障,并触发数据块的重新复制。

3. **自我修复机制:** 通过DataNode之间的定期副本检查和副本同步,系统能够在无需人工干预的情况下自我修复。

## 3.2 中间数据的快照与恢复机制

### 3.2.1 快照技术的基本原理

快照技术是一种能够保存文件系统状态的方法。在HDFS中,快照能够记录下文件系统在某一特定时间点的状态。当文件系统发生数据损坏或逻辑错误时,可以使用快照将文件系统恢复到快照创建时的状态。

### 3.2.2 快照在数据恢复中的应用实例

假设我们在一个

0

0