【MapReduce中间数据与作业调度】:内存与磁盘协调提高作业效率指南

发布时间: 2024-11-01 01:41:14 阅读量: 29 订阅数: 21

# 1. MapReduce中间数据处理概述

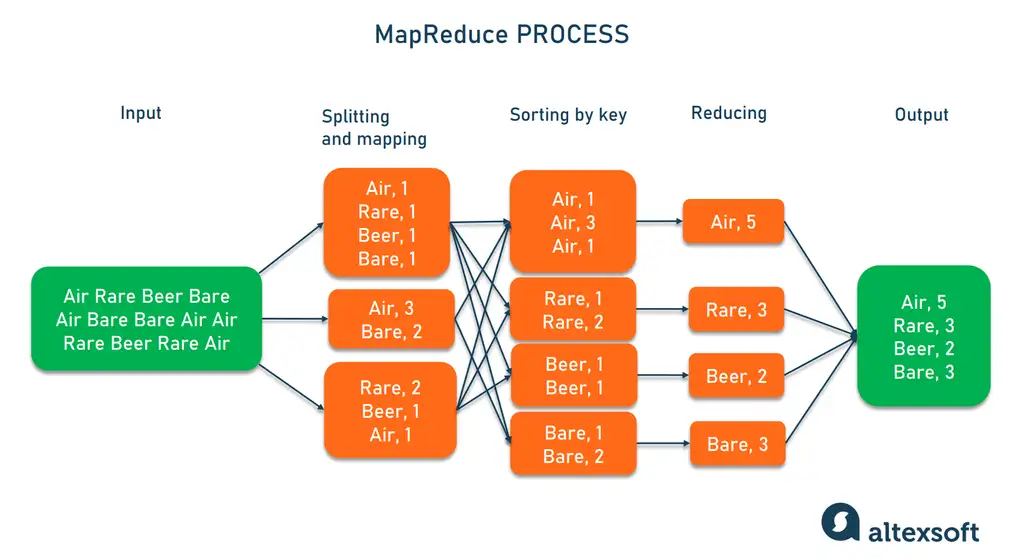

MapReduce作为一种分布式数据处理框架,其核心在于通过分工合作的方式,将大数据处理任务分解为多个独立的子任务,最终再将结果汇总。MapReduce中间数据处理是这一过程的关键环节,它涉及了数据在Map阶段和Reduce阶段之间的传输和处理。理解中间数据处理的工作机制,对于优化程序性能、提高处理效率具有重要意义。

Map阶段负责接收输入数据,执行用户自定义的Map函数处理数据,产生中间键值对;而Reduce阶段则对这些键值对进行合并处理,生成最终结果。中间数据的处理效率直接影响整个MapReduce作业的执行时间。在处理过程中,内存的使用和磁盘I/O操作是两个主要的性能瓶颈。

例如,在Map阶段产生的中间数据需要经过排序,以便在Reduce阶段进行合并。这些数据首先会被写入内存,但内存资源有限,一旦达到上限,就会触发溢写操作,将数据写入磁盘。因此,合理的内存分配和磁盘I/O优化策略对于保证MapReduce程序高效运行至关重要。接下来的章节将深入探讨内存与磁盘的协调理论,以及如何优化中间数据处理,提升MapReduce的整体性能。

# 2. 内存与磁盘协调的基础理论

### 2.1 MapReduce内存管理机制

MapReduce框架在处理大规模数据集时,内存管理是性能优化的关键之一。内存资源的高效管理不仅能够提高数据处理速度,还能减少对磁盘I/O的依赖,进一步提升整体处理效率。

#### 2.1.1 内存分配与容量模型

在MapReduce中,内存分配通常涉及到JVM堆内存的配置以及框架内部的内存使用策略。内存分配的核心是确保内存资源的合理划分和利用,既不造成内存资源浪费,也不至于因内存不足而导致任务失败。

为实现这一点,通常需要根据集群的硬件配置、作业的特征以及数据的大小来动态调整内存分配。具体来说,可以设置以下几个关键参数:

- `mapreduce.map.java.opts`:用于配置Map任务的JVM堆内存大小。

- `mapreduce.reduce.java.opts`:用于配置Reduce任务的JVM堆内存大小。

为了适应不同大小的数据集,可以使用动态内存分配技术,根据实际内存使用情况来调整JVM堆内存大小。这样做的好处在于,能够防止因内存分配不当导致的频繁垃圾回收(GC)或者内存溢出(OOM)问题。

```java

// 示例代码片段展示如何在Java中动态调整内存大小

// 此段代码仅作为示意,并非MapReduce框架实际代码

int heapSize = calculateHeapSize(); // 计算需要的堆大小

System.gc(); // 建议执行垃圾回收

Runtime runtime = Runtime.getRuntime();

runtime.totalMemory(); // 获取当前内存使用情况

runtime.freeMemory(); // 获取当前可用内存

runtime.maxMemory(); // 获取JVM最大堆内存设置

```

参数说明:

- `calculateHeapSize()`:根据数据量大小和预估内存需求来计算合适的堆内存大小。

- `System.gc()`:建议JVM执行垃圾回收,尽可能回收不再使用的内存。

- `Runtime.getRuntime()`:获取Runtime实例,用于查询和修改内存使用情况。

- `totalMemory()`:返回JVM试图使用的总内存。

- `freeMemory()`:返回JVM中的空闲内存。

- `maxMemory()`:返回JVM的最大可用内存。

逻辑分析:

上述代码块是动态内存分配的简化逻辑,其背后的核心思想是根据作业运行状态和内存使用情况来调整内存分配,从而实现资源的高效利用。

#### 2.1.2 数据溢写与压缩策略

内存管理的另一个重要方面是处理溢写问题,即当内存中无法容纳更多数据时,必须将部分数据写入磁盘。有效的数据溢写策略不仅可以减少数据交换次数,还能通过数据压缩来降低I/O成本。

对于数据溢写策略的实现,主要通过以下几个方面进行优化:

- `io.sort.factor`:定义Map阶段内存中可以容纳的最大的文件数。

- `io.sort.mb`:定义Map阶段排序缓存区的大小。

- `***pression.codecs`:支持的压缩编解码器列表。

```java

// 示例代码展示如何在MapReduce中设置溢写参数

job.getConfiguration().setInt("io.sort.factor", 10);

job.getConfiguration().setInt("io.sort.mb", 200);

```

参数说明:

- `io.sort.factor`:控制Map阶段可以同时存在的文件数量。如果当前存在文件数量超过这个值,那么系统会将其中一部分写入磁盘。

- `io.sort.mb`:限制Map阶段排序缓存区的大小。当数据达到这个缓存区的容量时,就会开始进行数据溢写。

逻辑分析:

通过上述两个参数的设置,可以灵活地调整内存与磁盘的使用比例,平衡内存处理速度与磁盘I/O的开销。

### 2.2 MapReduce磁盘I/O优化

在MapReduce处理流程中,磁盘I/O操作是不可避免的。合理优化磁盘I/O不仅可以减少磁盘读写次数,提升数据吞吐量,还可以改善系统的整体响应速度。

#### 2.2.1 磁盘缓存与写入策略

磁盘缓存机制是提高磁盘I/O性能的重要手段之一。通过将频繁读写的数据暂存于内存中,可以有效减少直接对磁盘的操作次数,提升系统的处理能力。

MapReduce中常见的磁盘缓存优化策略包括:

- `mapred.job.reuse.jvm.num.tasks`:允许在同一个JVM上复用任务来减少启动新任务的开销。

- `mapred.cache.files`:预先将文件缓存到TaskTracker的文件系统中。

```java

// 示例代码展示如何在MapReduce作业中设置缓存文件

job.addCacheFile(new URI("hdfs://path/to/cache/file"));

```

参数说明:

- `mapred.job.reuse.jvm.num.tasks`:配置能够复用的JVM任务数量,从而减少JVM重启的开销。

- `mapred.cache.files`:指定需要缓存的文件路径,这些文件将在所有任务中共享。

逻辑分析:

通过磁盘缓存和任务复用机制,可以提高作业的执行效率。具体而言,缓存文件减少了磁盘I/O操作的次数,而任务复用则通过避免多次加载和初始化相同的JVM环境来减少系统开销。

#### 2.2.2 磁盘故障与容错机制

在大规模数据处理的环境下,磁盘故障是常见的问题。为了确保数据处理的鲁棒性,MapReduce框架提供了多种容错机制来应对磁盘故障。

主要的容错策略包括:

- `fs.checkpoint.dir`:设置检查点目录,用于存储作业执行过程中的中间数据和状态。

- `fs.checkpoint.edits.dir`:设置检查点编辑目录,用于存储编辑日志。

```java

// 示例代码展示如何配置MapReduce作业的检查点

Configuration conf = job.getConfiguration();

FileSystem fs = FileSystem.get(conf);

Path checkpointPath = new Path("hdfs://path/to/checkpoint");

FileSystem checkpointFs = checkpointPath.getFileSystem(conf);

```

参数说明:

- `fs.checkpoint.dir`:指定检查点数据的存储位置。

- `fs.checkpoint.edits.dir`:指定编辑日志的存储位置。

逻辑分析:

设置检查点可以保证在节点故障时,系统能够从最近的检查点恢复作业,避免作业的重新执行,从而大大提高了系统的容错能力。

### 2.3 内存与磁盘的协调机制

协调内存与磁盘之间的关系对于提升MapReduce作业的效率至关重要。需要在内存使用和磁盘I/O之间找到平衡点,这样才能优化整体的处理性能。

#### 2.3.1 内存与磁盘的交互流程

内存与磁盘的交互主要发生在数据处理的过程中。Map阶段处理完的数据通常会写入磁盘中,而Reduce阶段则需要从磁盘中读取这些数据。因此,合理管理内存和磁盘之间的数据交换流程是关键。