【MapReduce中间数据操作实践】:编程中内存与磁盘数据存储控制实战

发布时间: 2024-11-01 01:24:26 阅读量: 22 订阅数: 29

java+sql server项目之科帮网计算机配件报价系统源代码.zip

# 1. MapReduce中间数据操作基础

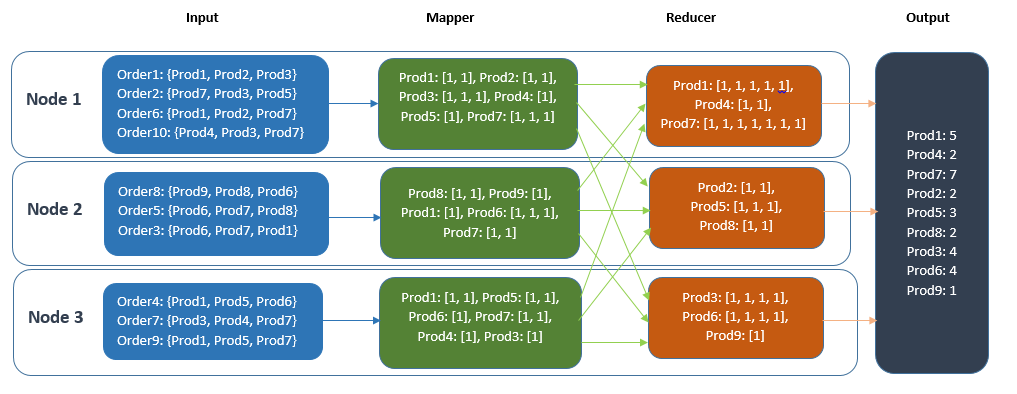

在分布式计算的环境中,MapReduce作为一种编程模型,广泛应用于处理大规模数据集。其核心在于将复杂、庞大的任务分解为许多小任务,通过Map(映射)和Reduce(归约)两个步骤来处理数据。Map阶段对输入数据进行处理,生成中间键值对;Reduce阶段则对中间数据进行汇总和处理,输出最终结果。本章将探讨MapReduce在处理中间数据时的基础操作,包括数据的读取、排序、合并等,为接下来章节中更深入的内存与磁盘数据存储管理打下基础。

让我们从MapReduce模型的中间数据处理开始,逐步剖析它在数据处理流程中扮演的角色和实施的策略。

# 2. 内存中数据存储的技术原理与实践

## 2.1 内存存储技术概述

### 2.1.1 内存的基本概念和特性

内存,亦称为随机存取存储器(RAM),是计算机硬件的一个重要组成部分,提供计算机运行时所需的临时数据存储空间。它允许存储的数据被高速读写,但一旦电源关闭,存储在内存中的数据便会丢失。内存的特性对于理解MapReduce中间数据操作至关重要。

内存具备以下几个关键特性:

- 高速访问:与磁盘存储相比,内存具有极快的数据读写速度,能够显著提升数据处理效率。

- 易失性:存储在内存中的数据会在断电后丢失,这意味着对于需要持久化存储的数据,必须依赖磁盘或其他非易失性存储介质。

- 受限空间:相较于磁盘存储,内存的存储容量有限,因此在MapReduce中,合理管理和优化内存使用是提升性能的关键因素。

### 2.1.2 内存存储在MapReduce中的角色

在MapReduce框架中,内存主要用于存储中间数据,这些数据是在Map和Reduce操作过程中产生的临时数据。合理利用内存可以显著减少对磁盘I/O的操作,从而提升作业的执行效率。具体而言,内存的角色包括但不限于:

- 缓冲区:Map操作产生的中间键值对会暂存于内存缓冲区中,直到该缓冲区满或Map任务结束。

- 排序和合并:内存也用于在Map任务完成前对键值对进行排序,以及在Map和Reduce任务之间进行数据的合并。

- 快速检索:内存可以用于构建数据结构(如哈希表、平衡树等)以实现快速的数据检索和更新操作。

## 2.2 内存数据结构的选择和应用

### 2.2.1 数据结构对性能的影响

不同的数据结构对内存的使用效率和操作性能有不同的影响。选择合适的数据结构对于优化MapReduce的中间数据存储至关重要。

数据结构的选择应当考虑如下几个关键点:

- 空间效率:不同数据结构在内存中的占用空间不同,例如,链表相比数组,在存储大量连续数据时可能会消耗更多内存。

- 时间效率:数据的访问、插入和删除操作的时间复杂度会影响整体的处理速度。例如,哈希表提供了平均常数时间的查找效率。

- 实现复杂度:复杂的高级数据结构可能在实现上更为困难,需要更高的维护成本。

### 2.2.2 常用数据结构的实现和比较

在MapReduce中,几种常用的数据结构包括数组、链表、树结构(如红黑树)、哈希表等。这些数据结构在不同场景下各有优劣。

例如:

- **数组**:最适合用于访问连续的数据块,但在MapReduce中,由于数据往往需要根据键进行分组,因此数组可能不是最优选择。

- **链表**:提供了良好的动态数据管理能力,但随机访问性能较差,遍历速度慢。

- **哈希表**:实现了常数时间复杂度的查找、插入和删除操作,非常适合键值对的快速查找。

- **平衡树(如红黑树)**:支持动态数据集上的有序数据操作,如有序遍历、范围查询等。

在实际应用中,根据中间数据的特性和处理需求,选择合适的内存数据结构至关重要。以下是使用哈希表实现的一个简单的内存数据存储例子:

```python

# Python示例代码展示如何使用Python字典来模拟哈希表的功能

data = {} # 初始化一个空字典,用于模拟哈希表

# 插入键值对

data['key1'] = 'value1'

data['key2'] = 'value2'

# 检索键对应的值

print(data['key1']) # 输出: value1

```

## 2.3 内存数据管理策略

### 2.3.1 内存溢出的处理机制

内存溢出指的是内存中存储的数据超出了其容量限制。MapReduce框架通常使用“溢出到磁盘”的策略来处理内存溢出。内存溢出处理机制对于确保作业不会因为内存不足而失败至关重要。

内存溢出的处理流程包括:

- **缓冲策略**:Map和Reduce任务将中间数据写入内存中的缓冲区,当缓冲区满时,数据被写入磁盘。

- **合并排序**:在内存和磁盘上的数据需要进行合并和排序,以确保数据的有序性,便于后续的处理。

- **内存数据管理**:利用多种算法(如LRU算法)淘汰不再使用的数据,保证活跃数据的缓存。

### 2.3.2 内存数据的压缩和优化技术

数据压缩和优化技术在内存管理中同样重要,它们能够有效减少内存使用,提升数据处理速度。在MapReduce中,有以下几种常见的技术:

- **数据压缩算法**:如gzip、bzip2等,可以显著减少存储空间,但需要额外的CPU资源进行压缩和解压缩操作。

- **内存池技术**:内存池是一种预先分配和管理内存的技术,可以提高内存分配和回收的效率。

以下展示了如何在Python中使用gzip进行内存数据压缩和解压缩的示例:

```python

import gzip

import io

# 原始字符串数据

original_data = "This is some data that we will compress"

buffer = io.BytesIO()

with gzip.GzipFile(fileobj=buffer, mode='w') as f:

f.write(original_data.encode('utf-8'))

compressed_data = buffer.getvalue()

# 压缩后的数据

print("Compressed data:", compr

```

0

0