【MapReduce中间数据存储技巧】:打造高效数据存储策略指南

发布时间: 2024-11-01 00:49:36 阅读量: 19 订阅数: 22

# 1. MapReduce中间数据存储基础

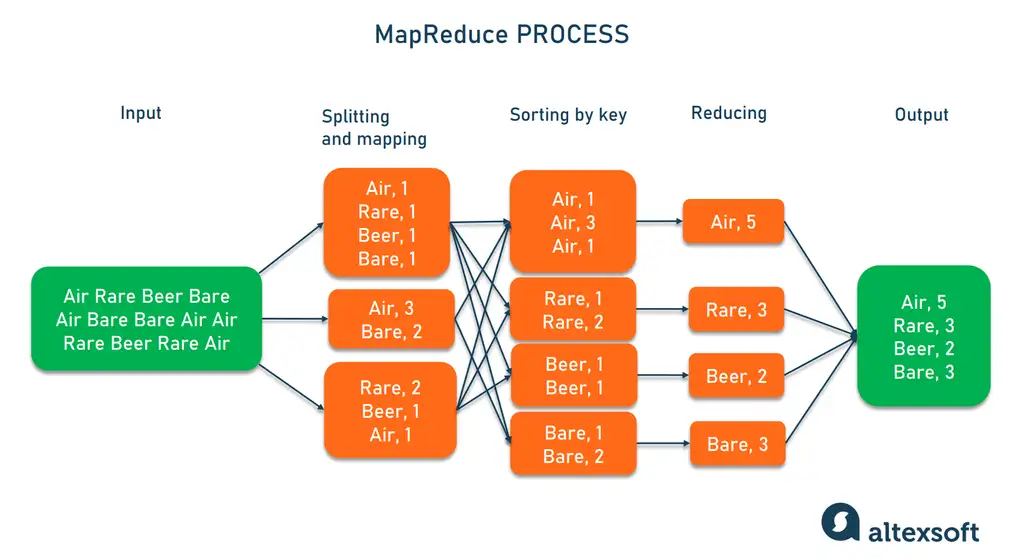

在大数据处理框架MapReduce中,中间数据存储是确保任务高效执行的关键环节。中间数据的生成和存储过程对作业性能有着决定性的影响,因而理解和优化这一过程对于数据工程师而言至关重要。在本章中,我们将介绍MapReduce中间数据存储的基础知识,以及它们如何被用来优化数据处理流程。我们会探讨中间数据的概念,解释其在MapReduce任务中的作用,并简要介绍中间数据存储相关的理论基础。

MapReduce框架通过将任务分解为Map和Reduce两个阶段来处理大规模数据集。在Map阶段,原始数据被读取并处理生成中间数据;在Reduce阶段,中间数据通过排序、分组等操作被处理生成最终结果。因此,中间数据的存储不仅关系到单个阶段的效率,也会影响到整个作业的性能。

从存储介质的角度来看,选择硬盘(HDD)还是固态硬盘(SSD),甚至内存存储,取决于数据的大小、访问模式和成本效益。硬盘存储成本较低,适合大容量数据的存储,但访问速度较慢;而SSD和内存则提供更快的数据访问速度,但成本相对较高。合理选择存储介质对于平衡性能和成本具有重要意义。

# 2. 高效存储策略的理论基础

### 2.1 MapReduce中间数据的概念和作用

在分布式计算框架中,如Hadoop的MapReduce模型,中间数据指的是在Map阶段和Reduce阶段之间产生的临时数据。中间数据在处理流程中扮演着至关重要的角色,它不仅是连接两个处理阶段的桥梁,而且对整个作业的性能有着直接的影响。

#### 2.1.1 中间数据的定义与特性

中间数据通常具有以下特性:

- **临时性**:中间数据不是最终结果的一部分,它的存在仅限于Map和Reduce阶段之间的处理过程。

- **规模大**:在处理大规模数据集时,中间数据可能会非常庞大,需要合理的存储策略来管理。

- **分布式存储**:中间数据需要被存储在多个节点上,以支持并行计算和数据的快速恢复。

#### 2.1.2 中间数据对性能的影响

中间数据处理不当会直接影响作业的执行效率。过多的中间数据可能会导致磁盘I/O成为瓶颈,而合理的中间数据存储策略可以缓解这一问题,提高整体处理速度。

### 2.2 存储介质的选择与特性

选择合适的存储介质对于优化中间数据存储至关重要。不同的存储介质(如硬盘、SSD、内存等)具有不同的性能特征和成本效益。

#### 2.2.1 硬盘存储与SSD存储的对比分析

- **硬盘存储**:硬盘具有高容量和低成本的特点,但其随机读写速度较慢,适合顺序读写的大数据集。

- **SSD存储**:固态硬盘的随机读写速度比硬盘快得多,适合频繁访问的小数据块。然而,SSD的成本相对较高,且存在写入次数限制。

#### 2.2.2 内存存储的作用和限制

内存存储可以提供极快的访问速度,但在存储成本和容量方面存在限制。内存通常用于存储热点数据或作为缓存层来加快数据访问速度。

### 2.3 数据编码与压缩技术

在存储中间数据时,采用合适的数据编码和压缩技术可以有效减少所需的存储空间,降低I/O负载。

#### 2.3.1 常用的数据编码方法

- **序列化格式**:如Apache Avro和Protocol Buffers,它们可以减少数据的大小,并提供跨语言的数据交换格式。

- **列式存储**:与行存储相比,列式存储更加适合大数据分析,因为它可以有效地压缩和查询数据的子集。

#### 2.3.2 数据压缩技术的原理和选择

数据压缩技术可以分为无损压缩和有损压缩两大类:

- **无损压缩**:如ZIP、GZIP和Snappy,它们可以完全还原原始数据,适用于需要精确数据的场景。

- **有损压缩**:如JPEG和MP3,它们在压缩时会丢失一些信息,适用于对数据精度要求不是非常高的场合。

选择合适的压缩算法需要根据数据的特性、压缩速度和压缩比等多方面因素综合考量。下面是一个简单的示例代码块,展示如何使用Snappy进行数据压缩和解压缩。

```python

import snappy

# 压缩数据

original_data = b'This is the original data.'

compressed_data = ***press(original_data)

# 解压缩数据

uncompressed_data = snappy.uncompress(compressed_data)

print(f"Original size: {len(original_data)} bytes")

print(f"Compressed size: {len(compressed_data)} bytes")

```

在上述Python代码中,我们使用了`snappy`库来对一段数据进行压缩和解压缩操作。通过对比压缩前后数据的长度,可以直观地看到压缩效果。根据实际应用场景的不同,选择合适的压缩算法可以大幅提升中间数据存储的效率。

接下来,我们将深入探讨中间数据存储策略实践,如何通过数据分区、排序优化、缓存机制以及性能调优来进一步提升存储效率和系统性能。

# 3. 中间数据存储策略实践

在前面的章节中,我们讨论了MapReduce中间数据存储的基础知识和高效存储策略的理论基础。在本章节中,我们将深入探讨中间数据存储策略实践,这包括数据分区和排序的优化、缓存机制的应用,以及数据读写性能的调优。

## 3.1 数据分区和排序的优化

### 3.1.1 数据分区的策略和方法

数据分区是MapReduce处理大数据的一个关键步骤,它将数据集分成独立的块,这些块可以被并行处理。正确

0

0