MapReduce与Hadoop生态:通过YARN进行资源管理优化的全方位攻略

发布时间: 2024-10-30 17:21:35 阅读量: 60 订阅数: 40

23、hadoop集群中yarn运行mapreduce的内存、CPU分配调度计算与优化

# 1. MapReduce的基本概念和架构

MapReduce是一种编程模型,用于处理大量数据(大数据),它的核心思想是将计算任务分配到许多处理节点上,以实现并行计算。MapReduce架构主要由两部分组成:Map阶段和Reduce阶段。Map阶段负责数据的分布式处理,将数据分解为多个小块,然后并行处理。Reduce阶段则将处理结果汇总,以生成最终的输出结果。

MapReduce的基本概念和架构是大数据处理的基础,理解这些对于掌握Hadoop生态系统至关重要。MapReduce的设计思想源于Google的MapReduce论文,其核心优势在于高容错性和可扩展性,使得MapReduce可以在廉价的硬件设备上运行,并能够处理PB级别的数据。

在后续章节中,我们会详细介绍YARN,它是Hadoop 2.x版本的新架构,提供了资源管理和作业调度的新平台,进一步优化了MapReduce及其他计算框架的性能。

# 2. Hadoop YARN的核心原理

## 2.1 YARN的资源管理概述

### 2.1.1 YARN的架构组件解析

YARN (Yet Another Resource Negotiator) 是Hadoop 2.0引入的一个重要组件,旨在优化资源管理以及作业调度。YARN的基本架构可以被看作是将资源管理与任务调度分离的模型,它由以下几个核心组件构成:

- **ResourceManager (RM)**:管理整个系统的资源,负责资源的分配和调度。它包含两个主要的组件:调度器(Scheduler)和应用程序管理器(ApplicationMaster)。调度器负责根据应用程序的需求,将资源以容器(Container)的形式分配给它们。应用程序管理器负责启动、监控和终止应用程序的主进程。

- **NodeManager (NM)**:负责管理各个节点上的资源,包括内存、CPU和磁盘等。它接受ResourceManager的命令来启动或停止容器,并监控容器内的资源使用情况。

- **ApplicationMaster (AM)**:每个应用程序启动时,ResourceManager都会为其分配一个ApplicationMaster实例。这个实例负责与ResourceManager协商资源,并监控应用程序在各个节点上运行的任务。当任务失败时,ApplicationMaster负责重新启动任务。

- **Container**:容器是YARN资源抽象的基本单位,它封装了某个节点上特定数量的资源(如CPU和内存)以及执行环境。YARN中的任务实际上是在Container中运行的,AM通过ResourceManager申请资源创建Container。

```mermaid

graph LR

A[Client] -->|提交应用| B[ApplicationMaster]

B -->|请求资源| C[ResourceManager]

C -->|授权| D[NodeManager]

D -->|启动Container| E[任务执行]

```

### 2.1.2 YARN的资源调度机制

YARN的资源调度机制主要涉及如何高效地分配和管理集群中的资源。当一个应用程序提交给YARN后,ResourceManager首先会为它创建一个ApplicationMaster,然后由ApplicationMaster根据应用程序的需求向ResourceManager请求资源。

ResourceManager中的调度器决定如何给等待的ApplicationMaster分配资源。它会根据配置的调度策略(如先进先出、容量调度、公平调度等)来决定资源分配,以确保集群资源的合理使用和负载均衡。

一旦资源被分配,NodeManager会在相应的机器上启动Container,并且ApplicationMaster会在Container内运行任务。NodeManager监控Container内的资源使用情况,并定期向ResourceManager报告状态。

```mermaid

flowchart LR

subgraph 申请资源

A[Client提交应用] --> B[ResourceManager]

end

subgraph 资源分配与管理

B --> C[调度器决定资源分配]

C -->|资源授权| D[NodeManager启动Container]

D --> E[任务执行]

end

subgraph 状态监控

D --> F[NodeManager监控Container]

F -->|状态报告| B

end

```

资源调度机制是YARN高效处理大规模数据的关键,它使得YARN能够同时处理多种类型的工作负载,提升了整个Hadoop生态系统的灵活性和资源利用率。

# 3. MapReduce性能优化实践

MapReduce在处理大规模数据集方面有着天然的优势,但在实际应用中,性能往往会受到各种因素的影响。因此,性能优化是确保MapReduce作业高效运行的关键。本章节将深入探讨如何通过数据本地化优化、作业调优以及利用Hadoop生态系统中的其他工具来实现MapReduce的性能优化。

## 3.1 数据本地化优化

### 3.1.1 数据本地化的原理和重要性

在MapReduce模型中,数据本地化是指任务在处理存储在本地节点上的数据时,可以达到最优的处理速度。这是因为在本地处理数据可以避免网络传输开销,大大减少任务执行的时间。

数据本地化优化的原理在于尽可能地将计算任务调度到包含输入数据的物理位置。Hadoop通过“推测执行”和“任务调度”等方式尝试提高数据本地化率,但仍然有很多优化空间。

### 3.1.2 实现数据本地化的策略

为了实现数据本地化优化,可以从以下几个方面入手:

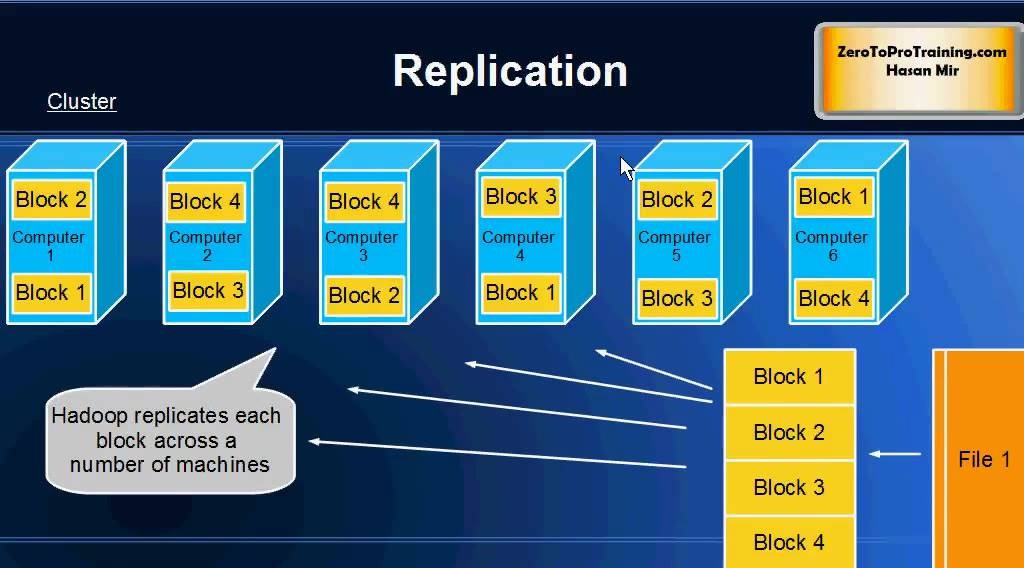

1. **数据预处理:** 在HDFS中合理布局数据块,使得计算任务尽可能地被调度到数据所在的节点。例如,使用Hadoop的HDFS的高级特性,如Rack Awareness,来控制数据块的存储位置。

2. **存储策略:** 对于重复计算或具有特定访问模式的数据,可以通过修改HDFS的`dfs.replication`配置来增加数据块的副本数量,这样有助于提高数据本地化率。

3. **任务调度策略:** 优化YARN的任务调度器,使其在调度任务时,能够优先考虑数据本地化。例如,YARN提供了CapacityScheduler和FairScheduler两种调度器,它们都可以通过配置来达到提高本地化的目的。

## 3.2 MapReduce作业调优

### 3.2.1 作业配置参数的调优

MapReduce作业性能的调优通常会涉及大量的配置参数。以下是一些关键参数的调优方法:

1. **mapreduce.job.reduces:** 此参数指定了MapReduce作业中Reducer的数量。适当的Reducer数量可以平衡Map和Reduce阶段的工作负载,从而优化性能。

2. **mapreduce.input.fileinputformat.split.minsize:** 此参数控制输入切片的最小大小。合理的切片大小可以减少任务启动的开销,并提高数据处理的吞吐量。

3. **mapreduce.map.memory百分比和mapreduce.reduce.memory百分比:** 这两个参数分别控制Map和Reduce任务的内存使用,优化内存分配可减少数据溢写到磁盘的次数,提升处理速度。

### 3.2.2 作业代码层面的优化

代码层面的优化往往需要开发者具备深入的业务知识和编程能力。以下是一些通用的优化建议:

1. **序列化:** 使用更高效的序列化框架,如Kryo,来减少数据在网络和磁盘上的存储与传输量。

2. **Map端聚合:** 尽可能在Map端完成数据的聚合操作,以减少需要传输到Reduce端的数据量。

3. **自定义分区器:** 根据数据的特性设计合理的分区器,使数据分布更加均匀,避免负载不均衡。

## 3.3 使用Hadoop生态系统工具进行优化

### 3.3.1 利用Hive和Pig简化MapReduce编程

Hive和Pig是构建在Hadoop之上的数据仓库工具,它们能够简化MapReduce程序的编写,并提供优化机制:

1. **Hive:** 利用Hive的表格式和分区特性来提高数据的组织效率,对数据进行预处理,减少MapReduce作业的执行时间。

2. **Pig:** 使用Pig的内置函数和脚本优化器,对数据流进行优化,减少不必要的数据转换和过滤操作。

##

0

0