MapReduce数据倾斜问题:深入分析与解决方案

发布时间: 2024-10-30 17:59:35 阅读量: 29 订阅数: 29

# 1. MapReduce基础与数据倾斜现象

MapReduce是一种编程模型,用于处理和生成大数据集。其核心思想是将计算分为两个阶段:Map阶段和Reduce阶段。Map阶段处理原始数据并生成中间键值对,而Reduce阶段则对这些键值对进行合并处理,从而得出最终结果。

数据倾斜是指在MapReduce处理过程中,部分Map或Reduce任务的工作负载远大于其他任务,导致处理速度降低和资源浪费的现象。这种情况通常发生在处理具有高度不均匀分布的键值数据时,导致数据在Map阶段或Reduce阶段的某些分区中高度集中。

为了深入理解数据倾斜的根源和影响,下一章将探讨数据倾斜的原因及其对计算性能的影响。这将为后续章节中识别和解决数据倾斜问题打下理论基础。

# 2. 数据倾斜的原因与影响

### 2.1 数据倾斜现象的理论解释

#### 2.1.1 MapReduce的工作原理

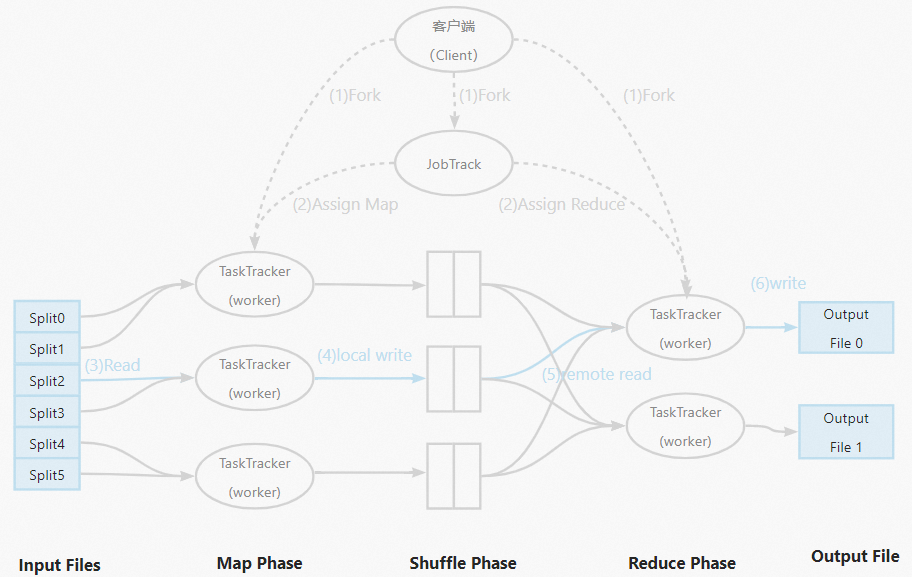

MapReduce是一种分布式数据处理模型,广泛应用于大规模数据集的并行运算。该模型工作流程主要分为Map阶段和Reduce阶段。在Map阶段,框架会将输入数据切分成独立的块,然后并行执行Map任务,每个任务处理一块数据。之后,MapReduce框架对所有的输出数据进行排序,相同键(key)的数据会分组到一起,这个过程叫做shuffle。在Reduce阶段,所有的键值对被发送到同一个Reduce任务中,然后对每个键值对执行Reduce函数,最后输出到文件系统中。

以下是MapReduce模型的一个简单工作流程图:

```mermaid

flowchart LR

A[输入数据] -->|切分| B[Map任务]

B --> C[排序/分组]

C -->|键值对| D[Reduce任务]

D --> E[输出结果]

```

#### 2.1.2 数据倾斜的定义和表现

数据倾斜是指在MapReduce作业中,部分Map或Reduce任务处理的数据量远大于其他任务,导致作业的执行时间由这些“热点”任务决定。数据倾斜通常表现在Map或Reduce阶段,一个或几个任务需要处理的数据量大大超过了平均值,造成负载不均衡,影响作业的整体执行效率。

### 2.2 数据倾斜对计算性能的影响

#### 2.2.1 资源分配不均的问题

当发生数据倾斜时,资源分配不均的问题尤为突出。部分任务由于处理数据量过大,消耗的CPU、内存等资源远多于其他任务,导致这些资源成为瓶颈。而其他任务可能因为数据量少而空闲或处于低负载状态,整个集群的资源使用效率降低。

#### 2.2.2 计算效率和扩展性的影响

数据倾斜对计算效率的影响非常显著。由于一个或几个任务的处理时间延长,整个作业的完成时间也随之增加,导致实际计算效率远低于理论峰值。同时,数据倾斜会限制作业的扩展性,因为增加更多资源对热点任务帮助不大,反而可能加剧资源分配不均的问题。

在极端情况下,数据倾斜甚至会导致集群资源耗尽,作业无法完成。因此,解决数据倾斜问题对于提升MapReduce作业性能至关重要。

以上内容介绍了数据倾斜现象的理论背景,包括MapReduce的工作原理和数据倾斜的具体定义,以及数据倾斜对计算性能的不良影响。在接下来的章节中,我们将深入了解如何识别和诊断数据倾斜问题,并探讨有效的解决策略。

# 3. 识别和诊断数据倾斜问题

在分布式计算中,数据倾斜是一个常见的问题,指的是在MapReduce作业中,部分Reducer处理的数据量远大于其他Reducer。这种情况会导致处理时间的极度不均衡,从而造成整个作业的执行效率降低。为了能够有效地解决数据倾斜问题,第一步是学会如何识别和诊断数据倾斜。

## 3.1 识别数据倾斜的策略

### 3.1.1 通过日志分析定位问题

在MapReduce作业执行的过程中,会产生大量的日志信息。这些日志记录了作业的执行状态、处理的数据量等关键信息。通过分析日志文件,可以初步判断是否存在数据倾斜。

#### 识别方法:

- **作业执行时间分析**:检查各个Map和Reduce任务的执行时间,若大部分任务在很短的时间内完成,而个别任务运行时间远超过平均值,那么可能存在数据倾斜。

- **数据量统计**:分析每个Map任务输出的中间数据量,若某几个Map任务输出的数据量远大于其他任务,这同样可以作为一个数据倾斜的信号。

#### 示例代码块:

```shell

# 假设作业日志文件名为job.log

cat job.log | grep "Finish task" | awk '{print $NF}' > task_times.txt

# 对task_times.txt文件进行排序,查看执行时间分布

sort task_times.txt | uniq -c | sort -nr

```

#### 逻辑分析:

上述代码块利用grep命令提取了日志文件中所有标记为"Finish task"的日志行,并使用awk命令将任务完成时间提取出来保存到task_times.txt文件中。随后,对这些时间数据进行排序,并使用uniq命令结合-c参数统计每个执行时间的出现次数,并使用sort命令进行降序排序。

### 3.1.2 使用监控工具检测数据分布

除了日志分析外,使用现有的监控工具对数据分布进行实时监控是一种更加快捷有效的方法。例如,Hadoop自带的Web UI界面可以提供Map和Reduce任务的执行情况和进度。

#### 监控步骤:

- **访问Web UI**:登录Hadoop集群管理页面,进入特定作业的监控页面。

- **查看执行进度**:监控各个任务的执行情况,特别是完成时间和处理的数据量。

- **生成数据分布图**:利用图表工具生成各Reducer处理数据量的可视化图表。

#### 示例监控图表:

```mermaid

pie

title Task Completion Distribution

"Completed" : 85

"Running" : 10

"Pending" : 5

```

#### 逻辑分析:

上述Mermaid图表用于展示作业中各个任务的状态分布。在这个例子中,我们可以看到绝大多数任务已经完成,少数还在运行中,极少数还处于等待状态。监控图表能够快速地让运维人员识别出哪些任务需要额外关注,是否出现了数据倾斜的征兆。

## 3.2 数据倾斜问题的诊断方法

### 3.2.1 使用MapReduce框架内置工具

MapReduce框架提供了一些内置工具可以帮助诊断数据倾斜问题,例如`mapred job -counter`命令可以用来获取作业级别的计数器值,进而分析数据倾斜情况。

#### 使用步骤:

- **获取计数器信息**:通过执行`mapred job -counter <jobid>`命令,获取特定作业的计数器统计信息。

- **分析计数器**:检查Map和Reduce任务的输出记录数计数器,判断数据是否均匀分布。

#### 示例代码块:

```shell

mapred job -counter <jobid> | grep 'MAP_output_records'

mapred job -counter <jobid> | grep 'REDUCE_input_records'

```

#### 逻辑分析:

上述命令分别获取了Map任务的输出记录数和Reduce任务的输入记录数。分析这些计数器的值可以帮助我们理解数据在Map和Reduce阶段的分布情况。

### 3.2.2 结合外部分析工具进行诊断

除了MapReduce自带的工具之外,还有一些外部工具如Hive、Spark等,它们提供了更高级的数据分析能

0

0