Python算法调试技巧:如何有效地识别和优化低效算法

发布时间: 2024-08-31 13:43:33 阅读量: 140 订阅数: 71

# 1. Python算法调试的基础知识

## 算法与调试的必要性

算法是编程的核心,它决定了程序的效率和性能。掌握算法调试的基础知识对于任何希望提升代码质量的开发者来说都是必不可少的。调试算法不仅可以帮助我们发现并修正错误,还能优化代码的性能,使其运行更加高效。

## 算法调试的工具和方法

Python提供了丰富的工具来进行算法调试。最基本的工具是`print()`语句,它可以帮助我们查看程序执行过程中的变量状态。而对于更复杂的算法问题,我们可能需要使用断言(`assert`)来验证假设条件,或者使用专门的调试工具如`pdb`。`pdb`是Python的内置调试器,它允许我们逐步执行代码,并在运行时检查变量值,设置断点以及监控变量变化。

## 算法调试的最佳实践

调试算法时,我们应该遵循一系列的最佳实践。首先,明确测试用例并创建一个测试框架可以帮助我们系统地检查代码。其次,利用版本控制系统如Git进行代码版本的追踪,这样在调试过程中可以随时回退到稳定的版本。最后,编写可读性高的代码以及使用适当的文档注释,这不仅有助于调试,还能提升代码的维护性。以上这些方法和工具的组合使用,将为Python算法调试提供强大的支持。

# 2. 识别低效算法的理论与实践

### 2.1 算法效率的理论基础

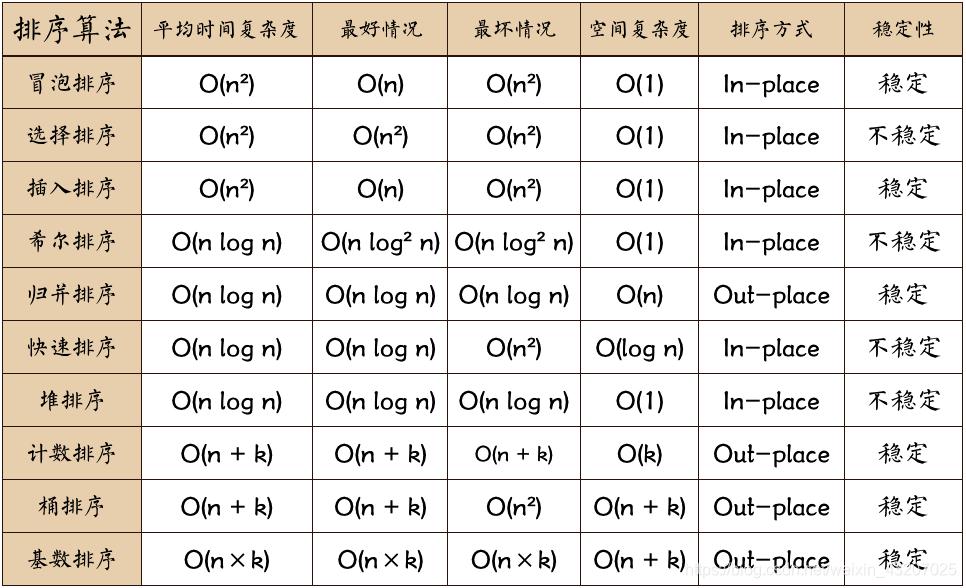

#### 2.1.1 时间复杂度和空间复杂度的分析

在算法分析中,时间复杂度和空间复杂度是衡量算法效率的两个关键指标。时间复杂度关注算法执行所需的时间量,而空间复杂度关注算法执行过程中占用的存储空间。

- 时间复杂度通常使用大O表示法来描述,它给出了算法运行时间随输入大小增长的变化趋势。常见的有O(1)(常数时间)、O(log n)(对数时间)、O(n)(线性时间)、O(n log n)(线性对数时间)、O(n^2)(平方时间)等。

- 空间复杂度衡量的是算法在运行过程中临时占用存储空间的大小。与时间复杂度类似,空间复杂度也使用大O表示法,例如O(1)(常数空间)、O(n)(线性空间)等。

理解并分析算法的复杂度对于优化算法性能至关重要。例如,排序算法的选择就极大地依赖于数据规模和输入数据的特点。对于小规模数据集,插入排序可能是有效的;而大规模数据集可能更适合归并排序或快速排序。

#### 2.1.2 理解大O表示法

大O表示法是数学上的渐近表示法,用于描述函数的上界。在算法分析中,它用来表示算法时间或空间需求随输入规模增长的上界。大O不是精确的测量,而是一种趋势。

例如,对于一个简单的for循环,如果它遍历一个长度为n的列表并执行一个常数时间的操作,那么这个循环的时间复杂度是O(n)。如果有一个嵌套的循环,那么时间复杂度将是O(n^2)。理解大O的关键在于抓住算法中最“昂贵”的操作,并分析它随输入规模增长如何增长。

### 2.2 算法效率的实践分析

#### 2.2.1 使用Python的内置工具进行性能分析

Python提供了一些内置工具来帮助开发者分析代码的性能。最常用的工具之一是`timeit`模块,它可以用来测量小段代码的执行时间。例如:

```python

import timeit

def test_func():

return [i for i in range(1000)]

time = timeit.timeit('test_func()', globals=globals(), number=1000)

print(f"执行1000次test_func的时间是: {time}秒")

```

该代码段会运行`test_func`函数1000次,并输出这段时间。`number`参数指定了执行的次数。这有助于我们了解函数在大量重复执行时的表现。

#### 2.2.2 常见算法低效案例分析

识别和分析低效算法的一个实际案例是分析字符串拼接操作。在Python中,使用`+=`操作符拼接字符串在循环中是低效的,因为它每次都会创建新的字符串对象。更好的方法是使用`join()`方法或列表推导式。下面是一个示例对比:

```python

# 不高效的方法

s = ""

for i in range(1000):

s += str(i)

# 高效的方法

s_efficient = ''.join(str(i) for i in range(1000))

```

在这个例子中,`+=`操作在每次迭代时都会创建一个新的字符串对象,这在性能上是昂贵的。使用`join()`方法或列表推导式可以有效减少内存的使用和提高执行速度。

### 2.3 算法优化的基本原则

#### 2.3.1 重构代码逻辑

重构代码逻辑是优化算法性能的重要手段。这涉及到重新设计算法的逻辑流程,移除不必要的计算,减少循环的迭代次数,或采用更高效的算法。例如,在图的遍历中,深度优先搜索(DFS)和广度优先搜索(BFS)的选择就依赖于具体问题的需求和图的特性。

#### 2.3.2 算法选择的权衡

在算法优化中,常常需要在不同的算法之间做出选择,如排序算法的选择。快速排序算法在平均情况下具有很好的时间复杂度O(n log n),但在最坏情况下可能退化到O(n^2)。如果数据已经是部分排序状态,那么插入排序可能会更加高效。算法的选择往往需要根据实际情况来权衡时间复杂度和空间复杂度。

```markdown

| 算法 | 最好情况 | 平均情况 | 最坏情况 | 额外空间 |

|------------|----------|----------|----------|----------|

| 快速排序 | O(n log n)| O(n log n)| O(n^2) | O(log n) |

| 插入排序 | O(n) | O(n^2) | O(n^2) | O(1) |

```

根据上表,我们可以看出,虽然快速排序在平均情况下更优,但其最坏情况和空间复杂度较高,而插入排序在小规模数据集或部分排序数据中表现更好。

优化算法是一个持续的过程,需要深入理解问题的场景,不断测试和评估不同的解决方案,最终找到最合适的优化策略。

# 3. Python中常见的算法优化技术

在本章节中,我们将深入探讨Python中常见的算法优化技术。这些技术涵盖了数据结构的选择、循环与递归的优化以及内存使用和管理的策略。通过对这些技术的学习和应用,开发者可以显著提高代码的执行效率和程序的整体性能。

## 3.1 数据结构优化

### 3.1.1 选择合适的数据结构

在Python编程中,数据结构的选择至关重要。不同的数据结构可能会对算法的性能产生显著影响。为了进行有效的数据结构优化,开发者需要了解不同数据结构的特性及其在不同场景下的表现。

以列表(list)和字典(dict)为例,虽然它们都是可变的数据结构,但它们在时间复杂度上有显著的不同:

- 列表(list):通过索引访问是 O(1) 的复杂度,但是在列表的中间插入和删除操作则是 O(n) 的复杂度。

- 字典(dict):通过键访问的平均复杂度是 O(1),适合频繁的查找、插入和删除操作。

下面的表格总结了这两种数据结构在不同操作下的时间复杂度:

| 操作类型 | 列表(list) | 字典(dict) |

|----------|--------------|--------------|

| 访问 | O(1) | O(1) |

| 追加 | O(1) | 不适用 |

| 插入 | O(n) | 不适用 |

| 删除 | O(n) | O(1) |

| 查找 | O(n)

0

0