【CNN背后的数学】:深入理解卷积操作的原理与应用

发布时间: 2024-09-03 12:07:45 阅读量: 110 订阅数: 70

详细解析CNN中卷积(Convolution)的背后逻辑

# 1. 卷积神经网络的基础概念

卷积神经网络(Convolutional Neural Networks, CNNs)是深度学习中的一种特殊网络架构,因其在图像和视频识别、自然语言处理等领域取得了显著的成果而受到广泛关注。CNN的基础概念可以追溯到1960年代的视觉生理学研究,其后被引入到机器学习中,并通过深度学习技术得到革新性的发展。

## 1.1 CNN的定义和起源

CNN是一种受生物学启发的神经网络,它模仿了动物视觉皮层的结构和功能。这种网络能够通过层叠的滤波器自动和有效地从图像中提取特征,这在图像处理任务中尤其有用。

## 1.2 CNN的基本组件

CNN主要由卷积层、激活函数、池化层、全连接层以及输出层等组件构成。其中卷积层是核心,负责捕获输入数据(如图像)的特征,并通过一系列的卷积核(滤波器)对图像进行处理。

## 1.3 应用领域和重要性

在深度学习领域,CNN已经被广泛应用于各种视觉识别任务中。例如,在医学图像分析、自动驾驶车辆、视频监控以及自然语言处理(通过1D卷积)等领域。由于其出色的特征提取能力,CNN对于理解和处理复杂数据模式具有重要意义。

# 2. 卷积操作的数学原理

在机器学习和深度学习的领域中,卷积操作是构建卷积神经网络的基础。它是一种强大的数学工具,通常用于图像处理、信号处理等领域。通过本章的详细解读,我们将了解卷积操作背后的数学原理,以及它是如何在深度学习中发挥作用的。

## 2.1 线性代数中的卷积运算

### 2.1.1 卷积的定义和性质

在数学上,卷积是一种特殊的积分运算,用于将两个函数或序列组合成第三个函数或序列。在离散形式中,给定两个一维离散信号\( x[n] \)和\( h[n] \),它们的卷积表示为\( y[n] = (x * h)[n] \),定义如下:

\[ y[n] = \sum_{k=-\infty}^{\infty} x[k] \cdot h[n-k] \]

在这个定义中,\( x \)通常是输入信号,\( h \)是滤波器或卷积核,而\( y \)是经过滤波器处理后的输出信号。卷积运算具有交换律、分配律和结合律的性质,这些性质使它在算法优化中有着重要的应用。

### 2.1.2 卷积矩阵和变换过程

在离散信号处理中,卷积也可以用矩阵乘法的形式来表示。卷积矩阵\( H \)是通过信号\( h[n] \)构造的,并且输出信号\( y[n] \)可以通过将输入信号矩阵\( X \)与卷积矩阵\( H \)相乘得到。例如,对于简单的卷积核,可以得到以下形式的卷积矩阵:

\[ H = \begin{bmatrix}

h[0] & 0 & 0 & \cdots & 0 \\

h[1] & h[0] & 0 & \cdots & 0 \\

\vdots & h[1] & h[0] & \ddots & \vdots \\

0 & \vdots & h[1] & \ddots & 0 \\

0 & 0 & \cdots & h[1] & h[0]

\end{bmatrix} \]

通过这种方式,复杂的卷积运算转变为简单的矩阵乘法,这种变换在计算机实现中非常有用。

```python

import numpy as np

def conv_matrix(h):

# 确定卷积矩阵的大小

size = len(h)

# 初始化卷积矩阵为零矩阵

H = np.zeros((size, size))

# 填充卷积矩阵

for i in range(size):

H[i, :size-i] = h[i:]

return H

# 示例卷积核

h = [1, 2, 3]

# 构造卷积矩阵

H = conv_matrix(h)

print("卷积矩阵 H:")

print(H)

```

## 2.2 卷积核的作用与设计

### 2.2.1 卷积核对图像的影响

在卷积神经网络中,卷积核主要用来提取图像的特征。卷积核的每一个元素可以看作是一个可学习的参数,其在整个图像上滑动时,能够捕捉到不同的视觉特征,如边缘、角点等。通过卷积操作,可以将输入的图像转化为一系列特征图(feature maps),这些特征图对后续的网络层来说包含了丰富的信息。

### 2.2.2 如何设计有效的卷积核

设计有效的卷积核是提高卷积神经网络性能的关键。在传统上,卷积核通常是手动设计的。但在深度学习中,卷积核是通过训练自动学习得到的。为了设计有效的卷积核,通常需要考虑输入数据的类型和分布、网络的深度、模型的复杂度等因素。此外,一些先进的设计方法,例如基于启发式规则的预训练,或者利用神经架构搜索(NAS)来自动化卷积核的设计过程。

## 2.3 深入理解信号处理中的卷积

### 2.3.1 信号的时域和频域卷积

在信号处理中,卷积操作通常发生在时域和频域中。时域卷积已经在前面的章节中讨论过。频域卷积关注的是信号的频率成分,它表明了两个信号的乘积在频域中的卷积等于它们在时域中的卷积的傅里叶变换。这一理论在图像处理和信号分析中非常有用,因为可以利用快速傅里叶变换(FFT)来加快卷积的计算速度。

### 2.3.2 卷积与滤波器的关系

在信号处理领域,滤波器是一种可以筛选特定频率成分的技术,而卷积是实现滤波的一种基本手段。不同的卷积核可以设计成不同的滤波器,比如低通滤波器、高通滤波器、带通滤波器等。在卷积神经网络中,这种滤波器的原理被应用来提取图像中的特征。

通过以上章节的深入分析,我们对卷积操作的数学原理有了一个全面的认识。从线性代数的定义,到在信号处理中的应用,卷积操作为深度学习提供了一个坚实的基础。在下一章中,我们将进一步探讨卷积操作如何在图像识别领域发挥作用,以及卷积神经网络的结构和应用。

# 3. 卷积神经网络在图像识别中的应用

## 3.1 图像处理与特征提取

### 3.1.1 卷积层在图像识别中的角色

卷积神经网络(CNN)是一种深度学习模型,它在图像识别任务中取得了显著成功。卷积层是CNN的核心组成部分之一,其主要功能是从输入图像中提取空间特征。通过对图像进行局部感受野的加权求和操作,并应用激活函数进行非线性变换,卷积层能够检测到图像中的边缘、角点、纹理等基本特征。

卷积操作利用了一组学习得到的滤波器(也称为卷积核或特征检测器),这些滤波器能够捕捉输入图像中的局部模式。卷积层中的每个神经元都与前一层的一个局部区域相连,这样可以减少模型的参数数量,并且引入了平移不变性,即图像中相同特征无论出现在何处都能被检测到。

### 3.1.2 特征映射和激活函数

卷积层通过多个卷积核生成的特征映射(feature maps),捕捉图像中的多样特征。每个卷积核都能够提取一种特定的特征,并且由于卷积核的权重是通过训练学习得到的,因此这些特征映射能够对训练数据集中的模式具有很强的适应性。

激活函数是CNN中的另一个关键元素,它为网络引入非线性。常用的激活函数包括ReLU(Rectified Linear Unit),它能够加速训练过程,并在一定程度上解决梯度消失的问题。卷积层的输出通常会经过一个激活函数,为网络的深层学习提供足够的表达能力。

## 3.2 卷积神经网络结构详解

### 3.2.1 典型的CNN架构:LeNet、AlexNet、VGG

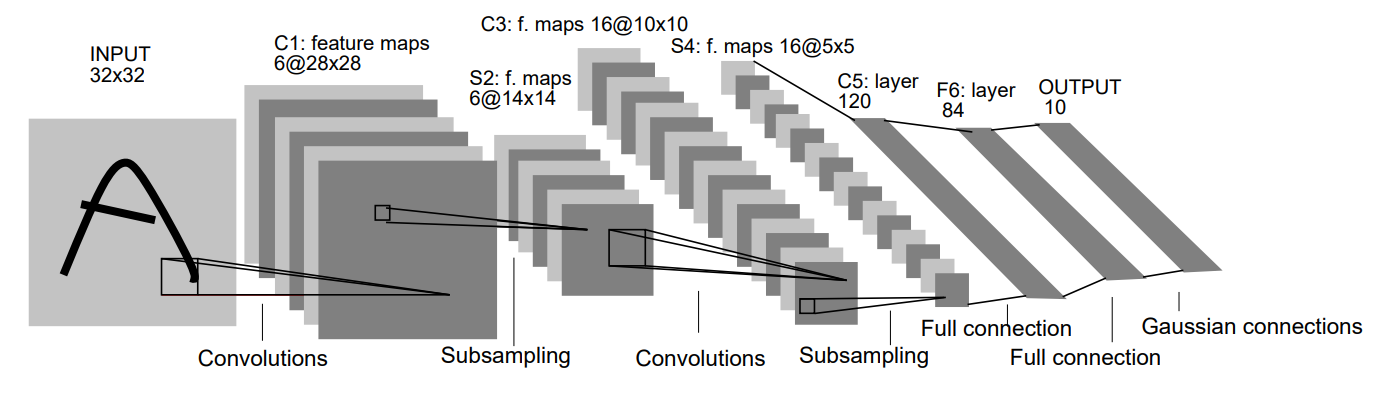

CNN的发展历程中出现了多个经典的网络架构,它们在不同的时期推动了图像识别技术的进步。LeNet-5作为早期的CNN模型之一,它的结构简单但奠定了现代CNN的基础。LeNet-5通过交替的卷积层和池化层,有效地提取了手写数字的特征并进行了分类。

AlexNet在2012年ImageNet挑战赛中取得了突破性成绩,它的网络结构更深,使用了ReLU激活函数和数据增强技术来提高模型的泛化能力。AlexNet的成功证明了深层CNN在大规模图像识别任务中的潜力。

VGGNet进一步扩展了网络深度,使用了重复的小尺寸卷积核(3x3)构建了深层次的网络结构。VGGNet展示了简单而强大的设计原则,即通过增加网络深度可以有效提高模型的性能。

### 3.2.2 各层组件的功能与优化策略

卷积层是CNN的核心,负责从输入图像中提取特征。卷积核的大小、数量和类型直接影响着特征提取的能力。池化层( pooling layer)的作用是降低特征维度,保持特征的尺度不变性,同时减少计算量和防止过拟合。

全连接层(fully connected layers)通常位于网络的末端,它们对特征映射进行整合,进行最终的分类或回归任务。在训练过程中,使用如Dropout等正则化技术能够防止过拟合,提高模型的泛化性能。

在优化方面,学习率调整、权重初始化策

0

0