PyTorch优化器配置:提升模型训练效率的5大技巧

发布时间: 2024-11-22 01:43:14 阅读量: 5 订阅数: 11

# 1. PyTorch优化器配置概述

在深度学习模型的训练过程中,优化器的配置对于模型的收敛速度和最终性能具有决定性的影响。一个优秀的优化器配置可以加快训练效率,改善模型泛化能力,甚至在一定程度上防止过拟合。本章将介绍PyTorch中优化器的基本概念和配置方法,为后续深入探讨优化器的工作机制和效率提升技巧打下基础。

```python

# 一个简单的PyTorch优化器配置示例

import torch.optim as optim

# 假设已经定义好模型(model),损失函数(criterion)和数据加载器(train_loader)

model = ... # 模型实例化

criterion = ... # 损失函数

optimizer = optim.SGD(model.parameters(), lr=0.01, momentum=0.9)

# 开始训练

for epoch in range(num_epochs):

for inputs, targets in train_loader:

optimizer.zero_grad() # 清空梯度

outputs = model(inputs) # 前向传播

loss = criterion(outputs, targets) # 计算损失

loss.backward() # 反向传播计算梯度

optimizer.step() # 更新参数

```

在上述代码中,我们通过`torch.optim`模块配置了标准的随机梯度下降法(SGD)优化器,并设置了学习率(lr)和动量(momentum)参数。理解如何配置优化器,以及每个参数背后的作用机制,是深度学习实践中的关键技能。接下来的章节将深入探讨这些内容。

# 2. PyTorch优化器的理论基础

## 2.1 优化器在深度学习中的作用

### 2.1.1 训练过程中的损失函数与梯度

在深度学习中,优化器的主要职责是调整模型的权重,以最小化损失函数。训练过程可以看作是不断寻找更优权重参数的过程,目标是找到一组参数使得模型在训练数据上的表现最佳。

损失函数衡量了模型的预测输出与真实值之间的差异。模型在训练过程中的每一步都需要计算损失函数关于模型参数(权重和偏置)的梯度。梯度是损失函数相对于参数变化率的度量,它指向损失函数增长最快的方向。优化器的算法利用这些梯度信息来更新权重,朝向减少损失的方向进行迭代。

### 2.1.2 优化算法的数学原理

优化算法通常基于梯度下降法的变种。基本的梯度下降法在每次迭代中都会沿着梯度的反方向更新参数,以减少损失函数值。参数更新公式如下:

```python

θ = θ - η * ∇θJ(θ)

```

其中,`θ` 是模型参数,`η` 是学习率,`∇θJ(θ)` 是损失函数 `J` 关于参数 `θ` 的梯度。

除了基础的梯度下降法,还有许多高级优化算法,例如动量梯度下降、Nesterov加速梯度下降、RMSprop 和 Adam 等。这些算法通过在更新过程中加入额外的项来改善收敛速度和性能。

## 2.2 常用PyTorch优化器简介

### 2.2.1 SGD及其变体

随机梯度下降(SGD)是深度学习中最基础的优化算法之一。它随机选取一小部分数据进行梯度计算,使得更新更加频繁且计算效率更高。SGD的变体包括:

- **带动量(Momentum)的SGD**:引入动量项,使得权重更新能够考虑之前梯度的方向和大小,从而加速收敛并减少震荡。

- **带Nesterov加速(Nesterov Accelerated Gradient, NAG)的SGD**:在动量的基础上改进,能够在更大程度上提前预测梯度方向。

### 2.2.2 Adam和RMSprop等自适应算法

Adam优化算法结合了RMSprop和动量方法的优点,通过计算梯度的一阶矩估计(即动量)和二阶矩估计(即未中心化的方差),自适应地调整每个参数的学习率。Adam的更新公式如下:

```python

m = β1 * m + (1 - β1) * g # 一阶矩估计

v = β2 * v + (1 - β2) * g^2 # 二阶矩估计

θ = θ - α * m / (sqrt(v) + ε) # 更新参数

```

其中,`m` 和 `v` 分别是梯度的一阶和二阶矩估计,`g` 是梯度,`α` 是学习率,`β1` 和 `β2` 是衰减率,`ε` 是一个很小的值以避免除零。

RMSprop是一种自适应学习率的方法,它通过维持一个移动的平均值来调整每个参数的学习率。这些自适应算法在训练深度神经网络时表现出良好的性能,因为它们能够自动调整学习率,使得训练更加稳定和快速。

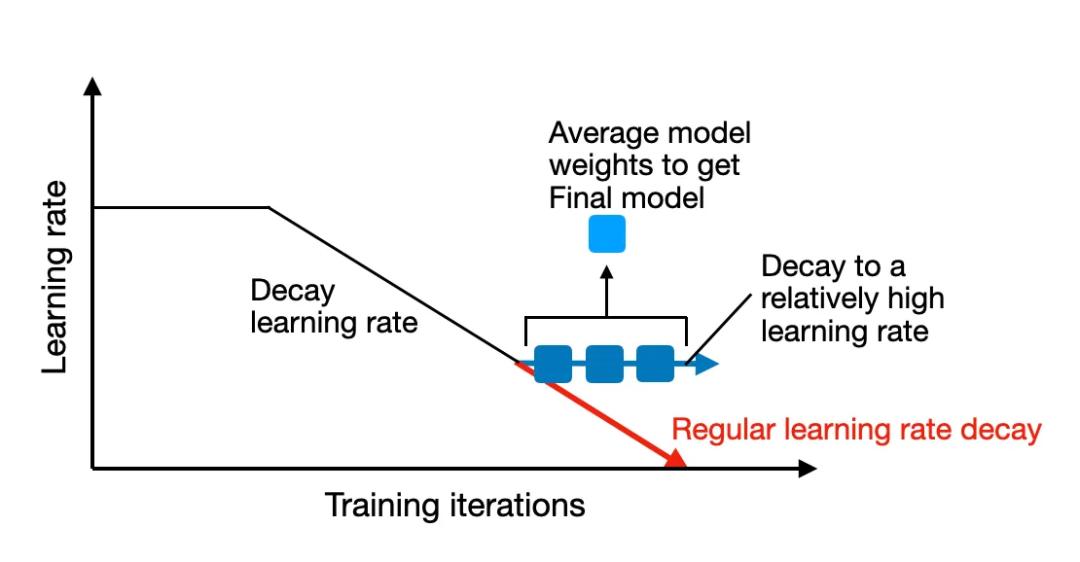

## 2.3 学习率调度策略

### 2.3.1 学习率衰减的原理和方法

学习率衰减是提高模型训练稳定性的一种技术,随着训练的进行,逐渐减小学习率可以帮助模型在局部最小值附近稳定收敛。PyTorch提供了多种学习率衰减策略,例如:

- 固定衰减:在训练过程中每隔固定步数或周期将学习率减小为原来的固定比例。

- 指数衰减:学习率随训练过程按指数形式下降。

- 多阶段衰减:在训练的不同阶段设定不同的学习率。

### 2.3.2 使用学习率预热提升训练稳定性

学习率预热是一种初始化学习率的方法,它在训练的初期阶段使用较小的学习率,之后逐渐增加到预设的学习率。这样做有助于模型在学习开始阶段逐渐调整权重,避免在大的学习率下过度跳跃,提高训练初期的稳定性。例如,可以采用如下步骤实现学习率预热:

1. 将初始学习率设定为较小值。

2. 按照设定的步数或周期逐渐增加学习率,直到达到预设的最大值。

3. 之后,可以采用固定衰减策略或其他衰减策略。

预热的学习率调度器(Scheduler)可以通过PyTorch提供的`LambdaLR`函数实现,其中可以根据训练进度动态调整学习率。

# 3. 提升PyTorch优化器效率的实践技巧

在深度学习模型的训练过程中,优化器扮演着至关重要的角色。它不仅影响模型的收敛速度,还可能影响最终模型的性能。本章将探讨如何通过优化器参数调整、分层优化器技巧以及批量归一化与优化器的协作来提升PyTorch优化器的效率。

## 3.1 优化器参数调整

### 3.1.1 调整学习率的策略和效果

学习率是最为关键的超参数之一,其设置直接影响到模型的收敛速度和性能。学习率太大可能会导致模型无法收敛,而太小则会导致训练效率低下,甚至陷入局部最小值。

调整学习率的一种策略是使用学习率预热(warm-up)。在训练初期,将学习率从小到大逐渐增加,有助于模型逐渐适应训练数据,从而提高训练的稳定性。另一种策略是使用学习率衰减,即在训练过程中的某一点将学习率降低,以促进模型在局部最优解附近微调。

下面是一个使用学习率预热和衰减的代码示例:

```python

import torch.optim as optim

# 定义模型和数据

model = ... # 模型初始化

optimizer = optim.SGD(model.parameters(), lr=0.01)

scheduler = optim.lr_scheduler.StepLR(optimizer, step_size=30, gamma=0.1)

# 训练循环

for epoch in range(num_epochs):

# 学习率预热

warmup_scheduler = optim.lr_scheduler.ExponentialLR(optimizer, gamma=0.1)

for batch in range(num_batches):

# 前5个批次使用较小的学习率

warmup_scheduler.step()

# 模型训练代码...

# 学习率衰减

scheduler.step()

# 模型评估代码...

```

在上述代码中,学习率首先经过预热策略逐渐增长,之后按照固定的步长衰减。需要注意的是,在`warmup_scheduler`和`scheduler`中合理选择参数,以确保学习率变化符合训练需求。

### 3.1.2 动量和权重衰减的应用实例

动量(Momentum)和权重衰减(Weight Decay)是优化过程中常用的两种技术。动量可以帮助模型在面对梯度方向变化时保持前进的惯性,有助于更快地收敛。权重衰减则作为一种正则化手段,用于防止模型过度拟合数据,通过对权重施加L2范数惩罚来实现。

使用动量和权重衰减的代码示例如下:

```python

# 定义具有动量和权重衰减的SGD优化器

optimizer = optim.SGD(model.parameters(), lr=0.01, momentum=0.9, weight_decay=1e-5)

# 训练循环

for epoch in range(num_epochs):

for data in dataloader:

inputs, targets = data

# 前向传播

outputs = model(inputs)

# 计算损失并进行反向传播

loss = criterion(outputs, targets)

optimizer.zero_grad()

loss.backward()

# 使用动量和权重衰减优化模型参数

optimizer.step()

```

在这段代码中,`momentum=0.9`表示动量值,其有助于模型加速在梯度下降方向上的移动;`weight_decay=1e-5`则将权重衰减应用到优化过程中,对模型权重施加了L2正则化的效果。

## 3.2 分层优化器技巧

### 3.2.1 分层优化器的原理和配置

分层优化器(Layer-wise Adaptive Rate Scaling, LARS)是一种能够针对不同层参数采用不同学习率的优化策略。与传统的单一学习率相比,这种策略可以更好地适应不同层参数更新的需要,从而提高训练效率和模型性能。

分层优化器的基本思想是为每个参数分配一个学习率,该学习率与其梯度大小和参数权重的范数相关。这种动态调整学习率的方式可以使得高频特征学习更快,低频特征学习更稳。

实现分层优化器的代码示例如下:

```python

import torch

class LARS(torch.optim.Optimizer):

def __init__(self, params, lr=0.001, weight_decay=0):

defaults = dict(lr=lr, weight_decay=weight_decay)

super(LARS, self).__init__(params, defaults)

def step(self):

for group in self.param_groups:

weight_decay = group['weight_decay']

for p in group['params']:

if p.grad is None:

continue

d_p = p.grad

weight_norm = torch.norm(p.data)

grad_norm = torch.norm(d_p)

# 计算LARS调整后的学习率

trust_ratio = 1.0

if grad_norm != 0:

trust_ratio = torch.where(

weight_norm > 0,

(lr * weight_norm / gra

```

0

0