【PSO-SVM数据预处理】:清洗数据,提升预测结果的关键步骤

发布时间: 2024-11-12 20:05:26 阅读量: 59 订阅数: 16

# 1. PSO-SVM模型简介

本章旨在介绍PSO-SVM模型的核心概念及其在机器学习领域中的应用。粒子群优化-支持向量机(PSO-SVM)模型是一种高效的预测算法,它结合了粒子群优化算法(PSO)与支持向量机(SVM)的优点,通过PSO算法对SVM的参数进行优化,以此提高模型的预测性能。

PSO是一种基于群体智能的优化算法,它模拟鸟群捕食行为,通过粒子间的协作与竞争对问题空间进行搜索。SVM是一种广泛应用于分类和回归分析的机器学习方法,特别擅长处理小样本、高维数据。

通过本章的学习,读者将对PSO-SVM模型有初步的了解,并为接下来的数据预处理和模型构建打下坚实的基础。后续章节将详细探讨数据预处理、PSO算法的具体应用以及SVM的工作原理,最后通过构建PSO-SVM集成模型并对其性能进行评估,展示其在实际问题中的应用案例。

# 2. 数据预处理的理论基础

### 2.1 数据预处理的目的和重要性

#### 2.1.1 数据质量对预测结果的影响

数据预处理是机器学习和数据挖掘流程中的关键步骤,目的是从原始数据中提炼出有价值的信息,并为后续的分析步骤提供准确可靠的数据。数据质量对预测结果的影响是巨大的,因为数据的质量直接决定了模型的性能。低质量的数据会导致模型学习错误的模式和趋势,影响预测准确性和决策质量。

在数据预处理过程中,各种数据问题如噪声、缺失值、异常值和不一致性等都需要被妥善处理。例如,噪声可能会掩盖真实的信号,使得模型无法正确识别数据中的真实关系。缺失值如果不被合理填补,会导致模型无法利用所有可用信息,从而降低预测精度。异常值的存在可能会使模型过度拟合于这些异常点,而不是学习到正常的模式。不一致性问题则会造成数据解释的混淆,影响模型的泛化能力。

#### 2.1.2 数据预处理在机器学习中的角色

数据预处理可以被视为一个准备阶段,它直接影响到机器学习算法的效率和效果。在这一阶段,数据会经过清洗、集成、变换和规约等步骤,从而提升数据的整体质量,为构建高效的预测模型打下坚实的基础。

清洗数据主要解决不一致性问题,确保数据的准确性。集成数据涉及将多个数据源结合起来,以提供更全面的信息视角。数据变换旨在改善数据的表示形式,使其更适用于特定的算法。最后,数据规约用于减少数据规模,同时保留数据的关键信息。

在机器学习中,数据预处理的角色可以类比于建筑工程中的地基,只有坚实的基础才能支撑起高耸的建筑。数据预处理确保了数据的质量,让模型能够学习到正确的模式,避免了过拟合或欠拟合的问题,并最终提升预测性能。

### 2.2 数据预处理的基本步骤

#### 2.2.1 数据清洗

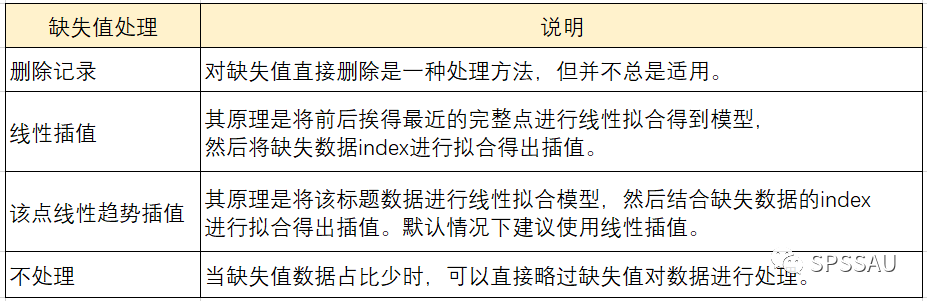

数据清洗的目标是识别并纠正数据集中的错误或不一致。它涉及到一系列的操作,包括处理缺失值、纠正错误、处理异常值以及去重等。

处理缺失值可以采用多种策略,例如删除含有缺失值的记录、用平均值或中位数填充、或使用模型预测缺失值。处理错误通常需要手动检查数据来源,确保输入的准确性。对于异常值的处理,可以使用统计方法识别它们,例如箱型图分析或标准差方法,然后决定是删除、修正还是保留这些值。去重则确保数据集中没有重复的记录,避免对分析结果造成影响。

```python

import pandas as pd

# 示例代码:使用Pandas进行数据清洗

# 加载数据

df = pd.read_csv('data.csv')

# 处理缺失值

df.fillna(df.mean(), inplace=True) # 使用均值填充缺失值

# 或者

df.dropna(inplace=True) # 删除缺失值

# 识别并处理异常值

# 使用3倍标准差规则

z_scores = (df - df.mean()) / df.std()

outliers = (z_scores.abs() > 3).any(axis=1)

df_clean = df[~outliers] # 删除异常值

# 保存清洗后的数据

df_clean.to_csv('cleaned_data.csv', index=False)

```

在上述Python代码块中,使用了Pandas库来加载数据,并对数据进行了清洗。通过填充缺失值、删除异常值等步骤,我们确保了数据集的质量。

#### 2.2.2 数据集成

数据集成是将来自多个源的数据合并成一个一致的数据集的过程。这个步骤至关重要,因为数据往往分散在不同的数据源中,例如数据库、数据仓库和数据湖。

数据集成的挑战之一是解决数据之间的冲突问题,比如不同的数据类型、格式不一致和命名冲突等。此外,数据集成还需要考虑数据的完整性和一致性问题,确保在合并过程中不丢失重要的信息。

#### 2.2.3 数据变换

数据变换是对数据进行的某种形式的数学变换,以改善数据的分布和可读性。常用的变换方法包括标准化、归一化、对数变换等。

标准化(或称Z-score标准化)是将数据转换为均值为0,标准差为1的分布。归一化则是将数据缩放到一个特定的范围,通常是0到1。对数变换可以用来减少数据的偏斜度,使其更接近正态分布。

```mermaid

graph LR

A[原始数据] --> B[标准化]

B --> C[归一化]

C --> D[对数变换]

D --> E[变换后的数据]

```

在mermaid格式的流程图中,展示了数据变换的过程,从原始数据开始,经过标准化、归一化、对数变换等步骤,最终得到变换后的数据。

#### 2.2.4 数据规约

数据规约的目标是在尽可能保持数据完整性的同时,减少数据量。数据规约可以通过维度规约和数据压缩两种方式进行。

维度规约是通过减少数据集的特征数量来简化数据,常用的技术包括特征选择和特征抽取。数据压缩则是寻找数据的更紧凑的表示,例如通过PCA(主成分分析)等方法。

通过数据规约,可以减少计算量,提高机器学习模型的运行效率,同时减少存储空间的需求。这在处理大数据集时尤其重要。

```python

from sklearn.decomposition import PCA

# 示例代码:使用PCA进行数据规约

# 假设X是原始特征矩阵

pca = PCA(n_components=0.95) # 保留95%的方差

X_r = pca.fit_transform(X) # 对数据进行变换

```

在上述代码中,使用了PCA方法对数据进行了规约,通过保留95%的方差来确保变换后数据的信息损失最小化。

数据预处理对于机器学习模型的构建至关重要。高质量的数据是实现高性能模型的基石。在下一章节中,我们将深入探讨粒子群优化算法(PSO)在数据预处理中的具体应用,以及它如何与特征选择和数据清洗等步骤相结合,以进一步提升数据处理的效率和模型的性能。

# 3. 粒子群优化算法(PSO)在数据预处理中的应用

## 3.1 粒子群优化算法的原理与实现

### 3.1.1 粒子群优化算法概述

粒子群优化(Particle Swarm Optimization,PSO)是一种基于群体智能的优化算法,借鉴了鸟群捕食行为的模式。在PSO算法中,每个粒子代表问题空间中的一个潜在解,并具有自己的位置和速度。粒子通过跟踪个体历史最佳位置和群体历史最佳位置来更新自己的速度和位置,以此方式搜索解空间,直至找到最优解。

粒子群优化算法的核心思想是迭代地改进候选解,每个粒子通过以下公式来更新自己的速度和位置:

```

v = w * v + c1 * rand() * (pbest - x) + c2 * rand() * (gbest - x)

x = x + v

```

其中,`v`是粒子的速度,`x`是粒子的位置,`w`是惯性权重,`c1`和`c2`是学习因子,`rand()`是0到1之间的随机数,`pbest`是个体最优位置,`gbest`是全局最优位置。通过迭代更新,粒子在搜索空间内不断向更优的位置聚集。

### 3.1.2 粒子群优化算法的关键参数和优化策略

PSO算法的性能很大程度上取决于其参数的设置,主要包括:

- 惯性权重(w):控制粒子先前速度对当前位置的影响,影响算法的全局和局部搜索能力。

- 学习因子(c1和c2):分别控制个体经验和社会信息对粒子搜索行为的影响。

- 粒子群规模:影响算法的多样性与计算负担。

- 最大迭代次数:决定算法的运行时间。

优化策略包括参数自适应调整和多样性的保持。参数自适应意味着在算法运行过程中动态地调整`w`、`c1`和`c2`的值,以期望在算法初期提高探索能力,在算法后期加强开发能力。多样性保持是为了避免粒子群过早收敛到局部最优解,通常通过引入随机扰动或其他机制实现。

### 3.1.3 代码实现粒子群优化

以下是一个简单的Python代码示例,展示了PSO算法的基本框架:

```python

import random

# PSO parameters

w = 0.5 # Inertia weight

c1 = 1 # Cognitive coefficient

c2 = 2 # Social coefficient

num_particles = 30

num_dimensions = 2

# Initialize particles and gbest

particles = [{'position': [random.uniform(-1, 1), random.uniform(-1, 1)],

'velocity': [0, 0],

'pbest': None,

'gbest': None}

for _ in range(num_particles)]

gbest = None

# Objective function

def objective_function(x):

return x[0]**2 + x[1]**2 # Example: Rosenbrock function

# PSO algorithm

for iteration in range(max_iterations):

for particle in particles:

# Evaluate the objective function at the current position

current_value = objective_function(particle['position'])

# Update the particle's pbest if current position is better

if particle['pbest'] is None or current_value < particle['pbest']:

particle['pbest'] = current_value

particle['pbest_position'] = list(particle['position'])

# Update the global best

if gbest is None or current_value < gbest:

gbest = current_value

gbest_position = list(particle['position'])

for particle in particles:

# Update velocity and position of each particle

particle['velocity'][0] = w * particle['velocity'][0] \

+ c1 * random.random() * (particle['pbest_position'][0] - particle['position'][0]) \

+ c2 * random.random() * (gbest_position[0] - particle['position'][0])

particle['velocity'][1] = w * particle['velocity'][1] \

+ c1 * random.random() * (particle['pbest_position'][1] - particle['position'][1]) \

+ c2 * random.random() * (gbest_position[1] - particle['position'][1])

particle['position'][0] += particle['velocity'][0]

particle['position'][1] += particle['velocity'][1]

# Ensure particles stay within bounds

particle['position'][0] = max(min(particle['position'][0], 1), -1)

particle['position'][1] = m

```

0

0