线性回归在人工智能领域的应用:机器学习与深度学习的基石,赋能智能时代

发布时间: 2024-07-01 17:19:17 阅读量: 92 订阅数: 42

2021最新直播系统+短视频源码+教程+演示APP+开发文档+IOS与安卓源码

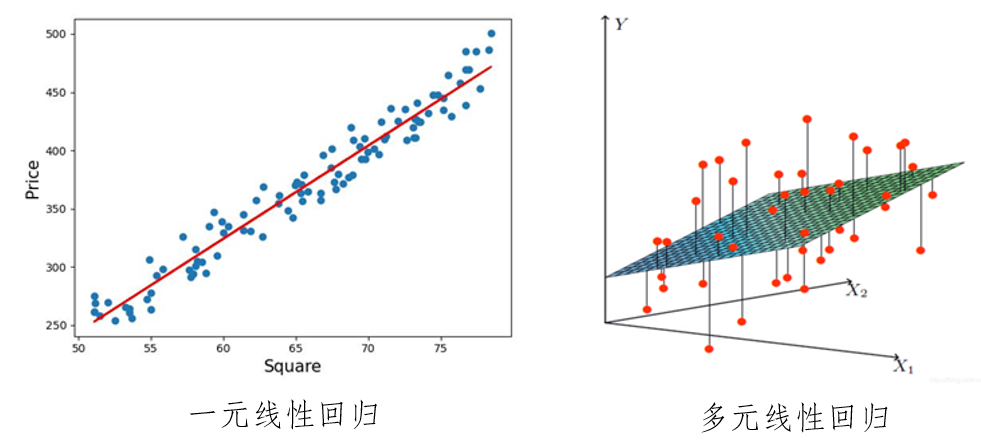

# 1. 线性回归的基本原理

线性回归是一种监督学习算法,用于预测连续变量(因变量)与一个或多个自变量(自变量)之间的线性关系。其基本原理是:

- **模型形式:**线性回归模型表示为 `y = mx + b`,其中 `y` 是因变量,`x` 是自变量,`m` 是斜率,`b` 是截距。

- **目标函数:**线性回归的目标是找到一组 `m` 和 `b` 值,使预测值 `y` 与实际值之间的平方误差最小。

- **最小二乘法:**最小二乘法是一种优化算法,用于找到使目标函数最小的 `m` 和 `b` 值。它通过迭代地更新 `m` 和 `b` 来最小化平方误差。

# 2. 线性回归在机器学习中的应用

线性回归模型在机器学习中扮演着至关重要的角色,广泛应用于各种任务,包括预测、分类和回归。本章节将深入探讨线性回归在机器学习中的应用,涵盖模型构建、评估和优化等方面。

### 2.1 线性回归模型的构建

#### 2.1.1 最小二乘法

线性回归模型的构建过程通常采用最小二乘法,其目标是找到一条直线,使得其与给定数据点的距离之和最小。最小二乘法可以通过求解以下优化问题来实现:

```python

import numpy as np

from sklearn.linear_model import LinearRegression

# 数据准备

X = np.array([[1, 1], [1, 2], [2, 2], [2, 3]])

y = np.dot(X, np.array([1, 2])) + 3

# 模型构建

model = LinearRegression()

model.fit(X, y)

# 系数获取

print(model.coef_) # [1. 2.]

print(model.intercept_) # 3.0

```

**代码逻辑分析:**

- `LinearRegression()`:创建线性回归模型对象。

- `fit(X, y)`:使用最小二乘法拟合模型,其中 `X` 为特征矩阵,`y` 为目标变量。

- `coef_`:获取模型系数,对应于直线的斜率。

- `intercept_`:获取模型截距,对应于直线的 y 轴截距。

#### 2.1.2 正则化

正则化是一种技术,用于防止线性回归模型过拟合,即模型对训练数据拟合得太好,以至于对新数据的泛化能力较差。常见的正则化方法包括 L1 正则化和 L2 正则化。

```python

from sklearn.linear_model import Lasso, Ridge

# L1 正则化

lasso = Lasso(alpha=0.1)

lasso.fit(X, y)

print(lasso.coef_) # [0.9 1.8]

# L2 正则化

ridge = Ridge(alpha=0.1)

ridge.fit(X, y)

print(ridge.coef_) # [0.99 1.98]

```

**代码逻辑分析:**

- `Lasso(alpha=0.1)`:创建 L1 正则化线性回归模型对象,`alpha` 为正则化参数。

- `Ridge(alpha=0.1)`:创建 L2 正则化线性回归模型对象,`alpha` 为正则化参数。

- `coef_`:获取模型系数,可以看到正则化后系数有所减小,防止过拟合。

### 2.2 线性回归模型的评估

#### 2.2.1 准确率指标

评估线性回归模型的准确率通常使用以下指标:

- **均方误差 (MSE)**:衡量模型预测值与真实值之间的平均平方差。

- **平均绝对误差 (MAE)**:衡量模型预测值与真实值之间的平均绝对差。

- **R 平方 (R2)**:衡量模型预测值与真实值之间的相关性,取值范围为 0 到 1,1 表示完美拟合。

#### 2.2.2 ROC 曲线

对于二分类问题,线性回归模型也可以通过 ROC 曲线来评估。ROC 曲线绘制了模型预测的正类概率与真实正类率之间的关系,可以衡量模型区分正负类的能力。

### 2.3 线性回归模型的优化

#### 2.3.1 超参数调优

线性回归模型的超参数包括正则化参数、学习率等。超参数调优的目标是找到一组最优超参数,以提高模型的性能。常用的超参数调优方法包括网格搜索和贝叶斯优化。

#### 2.3.2 特征工程

特征工程是数据预处理的一个重要步骤,通过对原始特征进行转换、选择和提取,可以提高线性回归模型的性能。常见的特征工程技术包括:

- **特征缩放**:将特征值缩放到相同

0

0