MATLAB中的信号分解与重构:EMD和PCA的应用

发布时间: 2024-08-30 11:40:40 阅读量: 51 订阅数: 26

# 1. 信号处理与分解的基本概念

在现代信息技术领域,信号处理与分解是理解和利用信号的核心技术。信号处理涉及一系列方法,用于从观测数据中提取有用信息,而信号分解则是把复杂的信号分解为更易于分析的组成部分。理解信号的基本属性,如频率、幅度和相位,是进行有效分析的基础。本章节将介绍信号处理与分解的基本概念,为后续章节中深入探讨经验模态分解(EMD)和主成分分析(PCA)打下坚实基础。我们会从信号的基本性质讲起,逐步展开,帮助读者建立起对信号分析全貌的认识。

# 2. ```

# 第二章:经验模态分解(EMD)的理论与实践

经验模态分解(EMD)是一种处理非线性、非平稳信号的方法,它能够将复杂的信号分解为一系列本征模态函数(IMFs),这些IMFs可以是线性或非线性的,但是具有明确的物理意义。EMD在信号处理领域具有重要地位,是理解后续章节内容的基础。

## 2.1 EMD方法的理论基础

### 2.1.1 瞬时频率与希尔伯特变换

瞬时频率的概念是理解EMD的关键。在传统傅里叶变换中,频率被认为是恒定的,这在处理平稳信号时是合适的,但对于非平稳信号却显得力不从心。瞬时频率的引入允许频率随时间变化,这为EMD提供了理论基础。

希尔伯特变换是获取瞬时频率的一种常用数学工具,它能够将一个信号转换为解析信号,从而获得瞬时幅度和瞬时频率。希尔伯特变换通常应用于信号处理,例如AM和FM调制解调,以及在EMD中用于确定IMF的瞬时频率。

### 2.1.2 本征模态函数(IMF)的产生

IMF是EMD过程中的核心概念,它指的是信号中具有物理意义的振荡模式。理想的IMF必须满足两个条件:在任意点,局部极大值和极小值的数目必须相等或相差最多一个;在任意点,由局部极大值定义的上包络线和由局部极小值定义的下包络线的平均值必须为零。

IMF的产生通过一个被称为“筛选”过程的迭代算法实现。这个过程不断迭代,直到满足IMF的条件。每一步筛选,都会从原始信号中提取出一个IMF分量。

## 2.2 EMD在信号分解中的应用

### 2.2.1 分解过程与步骤

EMD分解步骤通常如下:

1. **初始化:** 从原始信号中识别所有的极大值和极小值,然后构造上下包络线。

2. **筛选过程:** 通过计算上下包络线的平均值并从原信号中减去,获得一个残差。

3. **迭代:** 将残差视为新的信号重复上述过程,直到满足IMF的定义。

4. **提取IMF:** 每次迭代产生一个IMF分量,将IMF依次从原信号中分离出来,最终得到IMF和残余趋势项。

### 2.2.2 分解结果的物理意义

EMD的分解结果是对原始信号的不同时间尺度的局部特性进行描述。每个IMF代表了信号中的一个基本振荡模式,其频率随时间变化,从而能够揭示信号在不同时间尺度上的动态特性。

分解结果的物理意义主要体现在能够更准确地分析非平稳信号。例如,通过EMD可以识别出信号中的突变点、趋势变化,以及周期性变化等特征,这是传统线性分析方法难以实现的。

## 2.3 EMD的局限性与改进方法

### 2.3.1 端点效应与包络拟合

在EMD的分解过程中,端点效应是不可避免的问题。端点效应主要表现为边界附近的IMFs受到干扰,这可能导致分解结果的不准确。一种改进方法是采用反射边界条件,即通过镜像原始信号的端点来扩展信号,从而降低端点效应的影响。

包络拟合的准确性也直接影响EMD的效果。通常采用三次样条插值来拟合包络,这需要细致的参数调整以保证拟合的质量。

### 2.3.2 理论到实际应用的优化策略

将EMD应用到实际问题中时,需要根据具体情况对算法进行调整和优化。例如,对于噪声水平较高的信号,可以先进行滤波处理以减少噪声的影响;对于需要分析的特定频率范围的信号,可以预先定义筛选停止条件,以获取特定尺度的IMF分量。

优化策略还涉及到选择合适的停止准则,以避免过度分解导致IMF失去物理意义。在实际应用中,需要不断地尝试和验证,找到最佳的分解方案。

```

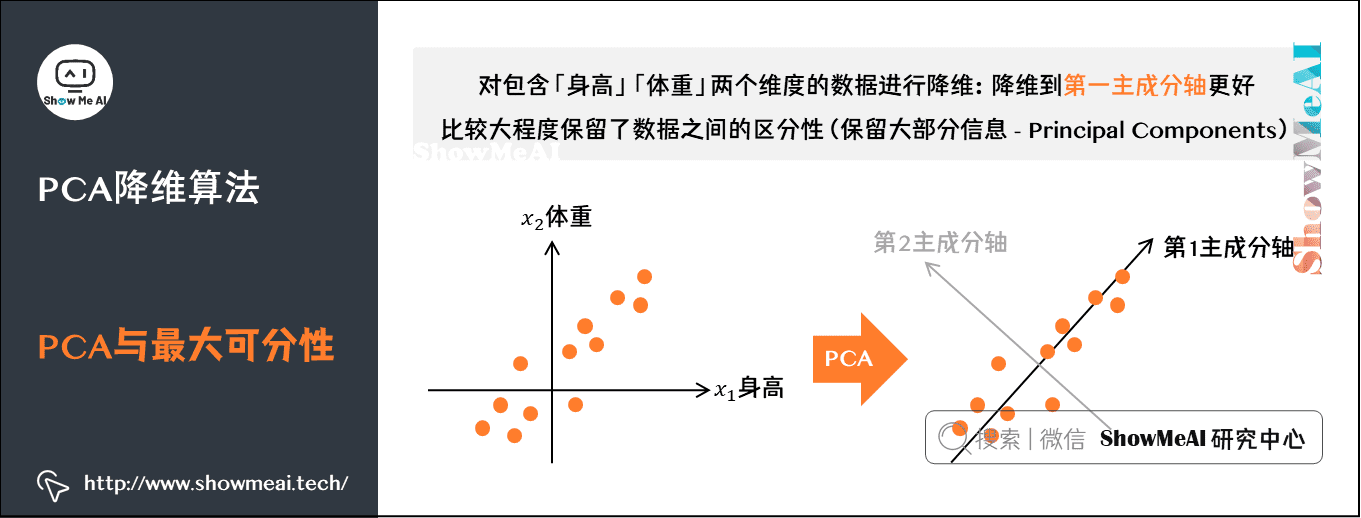

# 3. 主成分分析(PCA)的基础与实现

## 3.1 PCA方法的数学原理

### 3.1.1 协方差矩阵与特征值分解

主成分分析(PCA)是一种广泛用于降维的技术,它能够通过线性变换将原始数据变换到一组线性无关的新坐标系中,其方向对应于数据的协方差矩阵的特征向量。在该新空间中,第一主成分具有最大的方差,每个后续的成分都有最大的剩余方差,并且与前面的所有成分正交。

数据集的协方差矩阵是描述数据集中各个变量之间相关关系的矩阵。具体来说,对于一个数据集 $X$ ,其中包含 $m$ 个样本,每个样本 $n$ 维,其协方差矩阵 $C$ 可以用以下公式表示:

C = \frac{1}{m-1} X^T X

其中,$X^T$ 表示矩阵 $X$ 的转置。计算得到的协方差矩阵是 $n \times n$ 的对称矩阵。

### 3.1.2 主成分的提取与解释

接下来,PCA通过特征值分解来提取数据的主成分。特征值分解的过程如下:

1. 计算协方差矩阵 $C$ 的特征值 $\lambda_i$ 以及对应的特征向量 $e_i$。

2. 对特征值进行排序,从大到小依次排列。

3. 特征向量构成新的基向量,它们排列成一个矩阵 $P$,用于转换原始数据。

将原始数据集 $X$ 投影到特征向量上,可以得到新的数据集 $Y$:

Y = X P

其中,$Y$ 是原始数据在新的特征空间的表示,其维度为 $m \times n$,并且通常前 $k$ 个特征向量($k < n$)就能够解释大部分的数据方差。

## 3.2 PCA在数据降维中的应用

### 3.2.1 数据预处理与标准化

在使用PCA之前,通常需要对数据进行预处理和标准化。数据预处理的目的是为了消除数据的不同尺度对PCA结果的影响,常见的方法包括中心化和缩放:

- **中心化**:减去每个特征的均值,使数据的中心为原点。

- **缩放**:将每个特征的方差标准化到1,使每个特征具有相同的尺度。

标准化的公式如下:

x_{\text{normalized}} = \frac{x - \mu}{\sigma}

其中,$x$ 是原始特征值,$\mu$ 是该特征的均值,$\sigma$ 是该特征的标准差。

### 3.2.2 降维效果的评估与选择

评估降维效果的一个常用指标是解释方差的比率,它表示了每一个主成分包含的原始数据的方差信息量。通过累积解释方差的比率,可以决定使用多少个主成分来满足数据压缩和解释的需求。通常,我们选择解释方差比率累计到一个特定阈值(如95%)的主成分数目。

## 3.3 PCA的实现与案例分析

### 3.3.1 MATLAB中的PCA实现步骤

在MATLAB中,可以使用内置函数 `pca` 来进行PCA分析。以下是使用MATLAB进行PCA分析的基本步骤:

1. 准备数据集 `X`,并确保其为一个矩阵格式。

2. 使用 `pca` 函数执行PCA分析:

```matlab

[coeff, score, latent] = pca(X);

```

这里,`coeff` 是特征向量矩阵,`score` 是变换后的数据矩阵,而 `latent` 包含了每个特征值。

3. 分析输出结果,包括主成分的解释方差比率等。

### 3.3.2 典型数据集的应用实例

举一个使用PCA对鸢尾花(Iris)数据集进行降维的实例。鸢尾花数据集是机器学习领域的经典数据集,包含了150个样本,每个样本有4个特征。

首先,读取数据并进行中心化处理:

```matlab

load fisheriris

X = meas;

X = bsxfun(@minus, X, mean(X));

```

然后,执行PCA分析并获取前两个主成分:

```m

```

0

0