主成分分析(PCA)实战指南:从原理到应用,一文搞定

发布时间: 2024-07-22 14:19:56 阅读量: 296 订阅数: 40

# 1. 主成分分析(PCA)概述**

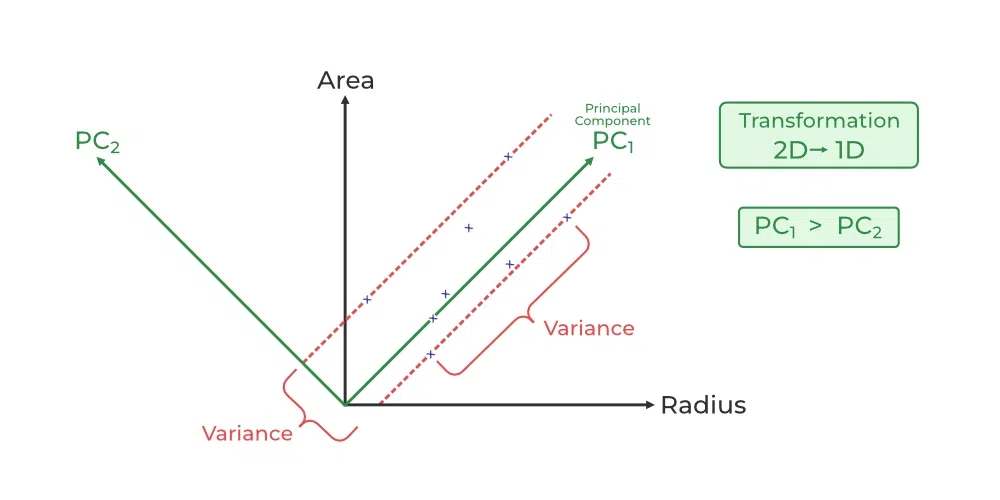

主成分分析(PCA)是一种广泛应用于数据降维和特征提取的统计技术。它通过对原始数据进行线性变换,将数据投影到一个新的坐标系中,使得新的坐标轴与数据中的最大方差方向对齐。通过这种方式,PCA可以有效地降低数据的维度,同时保留其主要信息。

PCA广泛应用于各种领域,包括图像处理、自然语言处理和生物信息学。它可以用于数据可视化、模式识别、异常检测和数据压缩等任务。

# 2. PCA原理**

**2.1 线性代数基础**

PCA是建立在线性代数基础之上的,因此理解PCA原理需要一些线性代数知识。

**向量和矩阵**

向量是一个有序的数字序列,矩阵是一个由数字组成的矩形数组。在PCA中,数据通常表示为一个矩阵,其中每一行代表一个数据点,每一列代表一个特征。

**协方差**

协方差衡量两个变量之间的相关性。对于两个变量x和y,协方差定义为:

```

Cov(x, y) = E[(x - E[x]) * (y - E[y])]

```

其中E[·]表示期望值。

**特征值和特征向量**

特征值和特征向量是描述矩阵性质的重要概念。对于一个矩阵A,其特征值λ和特征向量v满足以下方程:

```

Av = λv

```

特征值表示矩阵沿其特征向量方向的缩放因子,而特征向量表示矩阵沿该方向的单位向量。

**2.2 PCA数学原理**

**2.2.1 协方差矩阵和特征值分解**

PCA的核心步骤是计算数据的协方差矩阵。协方差矩阵是一个对称矩阵,其对角线元素表示各个特征的方差,非对角线元素表示特征之间的协方差。

通过对协方差矩阵进行特征值分解,可以得到一组特征值和特征向量。特征值按从大到小的顺序排列,表示数据在不同方向上的方差。

**2.2.2 主成分的计算**

主成分是协方差矩阵特征向量对应的方向。通过将数据投影到主成分上,可以得到一组新的变量,称为主成分得分。

主成分得分矩阵P由以下公式计算:

```

P = X * V

```

其中X是原始数据矩阵,V是协方差矩阵的特征向量矩阵。

**代码块:协方差矩阵特征值分解**

```python

import numpy as np

# 原始数据矩阵

X = np.array([[1, 2, 3], [4, 5, 6], [7, 8, 9]])

# 计算协方差矩阵

cov_matrix = np.cov(X.T)

# 特征值分解

eig_vals, eig_vecs = np.linalg.eig(cov_matrix)

# 打印特征值和特征向量

print("特征值:", eig_vals)

print("特征向量:", eig_vecs)

```

**逻辑分析:**

该代码块计算了协方差矩阵的特征值和特征向量。特征值表示数据在不同方向上的方差,特征向量表示数据在该方向上的单位向量。

**参数说明:**

* `X`:原始数据矩阵

* `cov_matrix`:协方差矩阵

* `eig_vals`:特征值

* `eig_vecs`:特征向量

# 3. PCA实战应用**

### 3.1 数据预处理

#### 3.1.1 数据标准化

**目标:**消除数据单位不一致带来的影响,使不同特征具有可比性。

**方法:**将每个特征减去其均值,再除以其标准差。

**公式:**

```python

x_std = (x - x.mean()) / x.std()

```

**代码解释:**

* `x` 为原始数据。

* `x.mean()` 为原始数据的均值。

* `x.std()` 为原始数据的标准差。

**参数说明:**

* `x`:输入数据,类型为 NumPy 数组。

* `x_std`:标准化后的数据,类型为 NumPy 数组。

#### 3.1.2 数据归一化

**目标:**将数据缩放到特定范围内(通常为 [0, 1]),消除不同特征量纲的影响。

**方法:**

```python

x_norm = (x - x.min()) / (x.max() - x.min())

```

**代码解释:**

* `x` 为原始数据。

* `x.min()` 为原始数据的最小值。

* `x.max()` 为原始数据的最大值。

**参数说明:**

* `x`:输入数据,类型为 NumPy 数组。

* `x_norm`:归一化后的数据,类型为 NumPy 数组。

### 3.2 PCA模型构建

#### 3.2.1 主成分数量选择

**目标:**确定保留多少个主成分,以达到最佳的数据表示和降维效果。

**方法:**

* **累积方差贡献率:**计算每个主成分的方差贡献率,并选择累积贡献率达到某个阈值(如 95%)的主成分。

* **奇异值阈值:**选择奇异值大于某个阈值的主成分。

* **肘部法则:**绘制主成分的方差贡献率曲线,选择曲线拐点(肘部)对应的主成分数量。

#### 3.2.2 模型训练

**目标:**根据选定的主成分数量,将原始数据投影到主成分空间。

**方法:**

```python

pca = PCA(n_components=n_components)

pca.fit(x_std)

```

**代码解释:**

* `PCA(n_components=n_components)` 创建一个 PCA 模型,其中 `n_components` 为保留的主成分数量。

* `pca.fit(x_std)` 将标准化后的数据 `x_std` 拟合到 PCA 模型中。

**参数说明:**

* `n_components`:保留的主成分数量,类型为整数。

* `x_std`:输入数据,类型为 NumPy 数组。

# 4. PCA数据可视化

### 4.1 散点图和折线图

PCA数据可视化的一种常见方法是使用散点图和折线图。散点图可以显示不同主成分之间的关系,而折线图可以显示主成分值随时间或其他变量的变化情况。

**散点图**

散点图可以用来显示两个或更多主成分之间的关系。每个数据点代表一个观察值,其位置由其在不同主成分上的值决定。通过观察散点图,可以发现数据中的模式和聚类。

**折线图**

折线图可以用来显示主成分值随时间或其他变量的变化情况。这对于了解数据是如何随时间变化的或如何受到其他变量影响的非常有用。

### 4.2 降维后的数据分布

PCA可以用来降维,即减少数据的维度。降维后的数据分布可以通过散点图或其他可视化技术进行可视化。通过观察降维后的数据分布,可以了解数据的整体结构和模式。

### 4.3 主成分加载量图

主成分加载量图是一种可视化主成分与原始变量之间关系的图表。每个主成分用一个向量表示,向量的每个元素表示主成分与原始变量之间的相关性。通过观察主成分加载量图,可以了解哪些原始变量对每个主成分的贡献最大。

**代码块:**

```python

import numpy as np

import pandas as pd

import matplotlib.pyplot as plt

# 加载数据

data = pd.read_csv('data.csv')

# 标准化数据

data_scaled = (data - data.mean()) / data.std()

# 构建PCA模型

pca = PCA(n_components=2)

pca.fit(data_scaled)

# 获取主成分

principal_components = pca.components_

# 获取主成分加载量

loadings = pca.components_

# 绘制散点图

plt.scatter(principal_components[:, 0], principal_components[:, 1])

plt.xlabel('Principal Component 1')

plt.ylabel('Principal Component 2')

plt.show()

# 绘制折线图

plt.plot(principal_components[:, 0])

plt.xlabel('Observation')

plt.ylabel('Principal Component 1')

plt.show()

# 绘制主成分加载量图

plt.bar(data.columns, loadings[0, :])

plt.xlabel('Variable')

plt.ylabel('Loading on Principal Component 1')

plt.show()

```

**逻辑分析:**

* `PCA(n_components=2)`:创建一个具有两个主成分的PCA模型。

* `pca.fit(data_scaled)`:将标准化后的数据拟合到PCA模型中。

* `principal_components`:获取主成分,每个主成分是一个向量,表示数据在该主成分上的投影。

* `loadings`:获取主成分加载量,每个加载量表示主成分与原始变量之间的相关性。

* 散点图显示了数据在两个主成分上的分布。

* 折线图显示了第一个主成分值随观察值的變化。

* 主成分加载量图显示了每个原始变量对第一个主成分的贡献。

# 5. PCA在不同领域的应用

PCA是一种强大的降维技术,在各个领域都有着广泛的应用。本章将介绍PCA在图像处理、自然语言处理和生物信息学中的具体应用场景,展示其在这些领域中的价值和优势。

### 5.1 图像处理

在图像处理中,PCA常用于图像压缩、降噪和特征提取。

**图像压缩:**PCA可以将高维图像数据降维到低维空间,从而减少图像文件的大小。这在图像传输和存储中具有重要意义,可以节省存储空间和传输带宽。

**图像降噪:**PCA可以将图像中的噪声与有价值的信息分开。通过去除噪声成分,可以提高图像的清晰度和信噪比。

**特征提取:**PCA可以提取图像中具有代表性的特征,这些特征可以用于图像识别、分类和检索。通过降维,可以减少特征的维度,简化后续的处理和分析过程。

### 5.2 自然语言处理

在自然语言处理中,PCA常用于文本分类、主题建模和文档聚类。

**文本分类:**PCA可以将高维文本数据降维到低维空间,从而提取文本中的关键特征。这些特征可以用于训练分类器,对文本进行分类。

**主题建模:**PCA可以将文本数据分解成多个主题,每个主题代表文本中的一组相关单词。这有助于理解文本的主题和结构。

**文档聚类:**PCA可以将文本数据降维到低维空间,从而计算文档之间的相似度。基于相似度,可以将文档聚类到不同的组中。

### 5.3 生物信息学

在生物信息学中,PCA常用于基因表达分析、疾病诊断和药物发现。

**基因表达分析:**PCA可以将高维基因表达数据降维到低维空间,从而识别基因表达模式和差异表达基因。这有助于了解基因调控机制和疾病的发生发展。

**疾病诊断:**PCA可以将患者的生物标志物数据降维到低维空间,从而识别疾病的特征模式。这有助于疾病的早期诊断和鉴别诊断。

**药物发现:**PCA可以将高维药物数据降维到低维空间,从而识别具有相似结构和性质的药物。这有助于药物的筛选和设计。

# 6. PCA进阶应用**

### 6.1 核PCA

**原理:**

核PCA是一种非线性降维技术,它通过将数据映射到高维特征空间,在该空间中数据可能是线性的,从而实现降维。核函数用于计算高维特征空间中的内积,而不显式地映射数据。

**代码示例:**

```python

import numpy as np

from sklearn.decomposition import KernelPCA

# 加载数据

data = np.loadtxt('data.csv', delimiter=',')

# 构建核PCA模型

kpca = KernelPCA(kernel='rbf', gamma=1.0)

# 拟合数据

kpca.fit(data)

# 降维

data_reduced = kpca.transform(data)

```

### 6.2 流式PCA

**原理:**

流式PCA是一种在线降维算法,它可以处理不断增长的数据流。它通过使用随机投影矩阵来近似主成分,避免了存储整个数据矩阵的需要。

**代码示例:**

```python

import numpy as np

from sklearn.decomposition import IncrementalPCA

# 加载数据

data_stream = np.loadtxt('data_stream.csv', delimiter=',')

# 构建流式PCA模型

ipca = IncrementalPCA(n_components=2)

# 逐个处理数据

for data_chunk in data_stream:

ipca.partial_fit(data_chunk)

# 降维

data_reduced = ipca.transform(data_stream)

```

### 6.3 增量PCA

**原理:**

增量PCA是一种在线降维算法,它可以处理增量式更新的数据。它通过更新主成分和协方差矩阵来适应新数据,而不需要重新计算整个模型。

**代码示例:**

```python

import numpy as np

from sklearn.decomposition import PCA

# 加载数据

data = np.loadtxt('data.csv', delimiter=',')

# 构建增量PCA模型

ipca = PCA(n_components=2, svd_solver='randomized')

# 拟合数据

ipca.fit(data)

# 增量更新数据

new_data = np.loadtxt('new_data.csv', delimiter=',')

ipca.update(new_data)

# 降维

data_reduced = ipca.transform(data)

```

0

0