探索随机森林可视化:深入理解决策树,洞察特征重要性

发布时间: 2024-06-15 08:16:00 阅读量: 231 订阅数: 70

决策树和随机森林

# 1. 随机森林简介

随机森林是一种强大的机器学习算法,它由多个决策树组成。这些决策树是通过随机抽样训练数据集和特征子集而创建的。随机森林通过对每个决策树的预测进行平均或投票来做出预测。

随机森林具有以下优点:

- **准确性高:**随机森林通常比单个决策树更准确,因为它们可以减少过拟合。

- **鲁棒性强:**随机森林对异常值和噪声数据具有鲁棒性,因为它们依赖于多个决策树。

- **可解释性强:**随机森林易于解释,因为它们由多个易于理解的决策树组成。

# 2. 随机森林可视化理论**

## 2.1 决策树的可视化

### 2.1.1 决策树的结构和表示

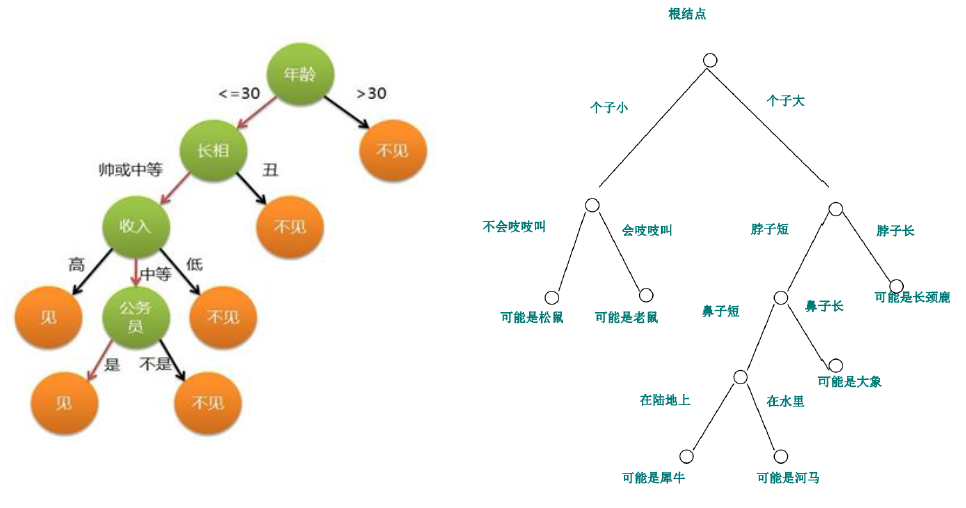

决策树是一种树形结构,其中每个节点代表一个特征,每个分支代表一个决策。决策树从根节点开始,根据特征值将数据分割成不同的子集,并递归地应用相同的过程直到达到叶节点。

### 2.1.2 决策树的可视化技术

决策树的可视化通常使用以下技术:

- **树形图:**以树形结构显示决策树,其中节点用方框或圆圈表示,分支用线段连接。

- **表格:**以表格形式显示决策树,其中每一行代表一个节点,每一列代表一个特征。

- **文本表示:**使用缩进和分隔符以文本形式表示决策树,类似于JSON或XML。

## 2.2 特征重要性的可视化

### 2.2.1 特征重要性的度量

特征重要性衡量每个特征对决策树模型的影响程度。常用的度量方法包括:

- **信息增益:**衡量特征将数据分割成更纯子集的程度。

- **基尼不纯度:**衡量数据集中不同类别的混合程度。

- **均方差:**衡量特征将连续值数据分割成更均等子集的程度。

### 2.2.2 特征重要性可视化方法

特征重要性可视化通常使用以下方法:

- **条形图:**以条形图的形式显示每个特征的重要性分数,其中条形的高度表示重要性。

- **折线图:**以折线图的形式显示特征重要性随树深度的变化。

- **热图:**以热图的形式显示特征重要性与其他特征的关系。

# 3. 随机森林可视化实践**

### 3.1 使用Python进行决策树可视化

#### 3.1.1 Matplotlib库

Matplotlib是Python中一个强大的数据可视化库,可用于创建各种类型的图表,包括决策树可视化。

```python

import matplotlib.pyplot as plt

from sklearn import tree

# 创建决策树模型

clf = tree.DecisionTreeClassifier()

clf.fit(X_train, y_train)

# 可视化决策树

tree.plot_tree(clf, feature_names=feature_names, class_names=class_names)

plt.show()

```

**代码逻辑:**

* 导入必要的库。

* 创建决策树分类器并训练模型。

* 使用`plot_tree`函数可视化决策树,指定特征名称和类名称。

* 显示可视化结果。

#### 3.1.2 Seaborn库

Seaborn是基于Matplotlib构建的一个高级数据可视化库,提供更高级别的接口和更美观的图表。

```python

import seaborn as sns

from sklearn import tree

# 创建决策树模型

clf = tree.DecisionTreeClassifier()

clf.fit(X_train, y_train)

# 可视化决策树

sns.tree.plot_tree(clf, feature_names=feature_names, class_names=class_names)

plt.show()

```

**代码逻辑:**

* 导入Seaborn库。

* 创建决策树分类器并训练模型。

* 使用`plot_tree`函数可视化决策树,指定特征名称和类名称。

* 显示可视化结果。

### 3.2 使用R进行特征重要性可视化

#### 3.2.1 ggplot2库

ggplot2是R中一个流行的数据可视化库,以其语法简洁和美观的图表而闻名。

```r

library(ggplot2)

library(caret)

# 创建决策树模型

model <- train(y ~ ., data = df, me

```

0

0