【内存管理的智慧】:散列数据结构内存泄漏的预防与解决策略

发布时间: 2024-09-11 03:04:21 阅读量: 35 订阅数: 24

# 1. 内存管理的理论基础

内存管理是计算机科学中的一个核心话题,它关系到计算机系统的稳定运行和资源的有效利用。在操作系统和编程语言层面,合理的内存管理机制能够提高程序运行效率,减少内存碎片,并有效防止内存泄漏等问题。

## 1.1 计算机内存概述

计算机内存可以看作是数据存储和访问的场所。物理上,它是一块由多个单元组成的存储设备,每个单元都有唯一的地址。逻辑上,内存被划分为多个区域,例如堆、栈和静态区域等,不同的区域用于存放不同类型的数据。

## 1.2 内存管理的目标与挑战

内存管理的目标包括:确保数据的快速存取、有效分配与回收内存资源以及防止内存碎片的产生。面临的挑战包括内存泄漏、内存碎片化、越界访问等问题。一个高效且鲁棒的内存管理策略对于系统的性能至关重要。

## 1.3 常用内存管理技术

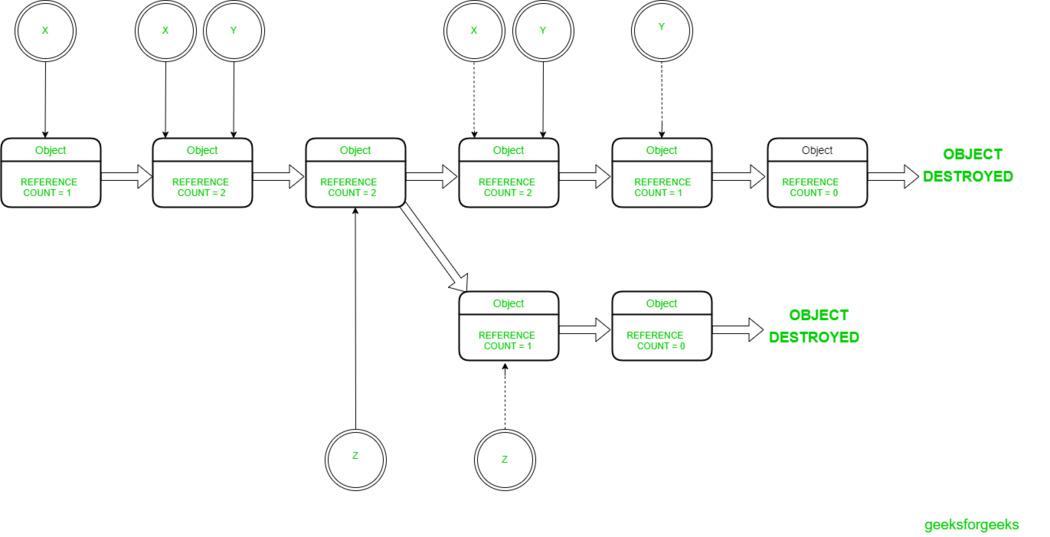

常用的内存管理技术有手动分配与释放、垃圾回收和内存池等。手动分配与释放赋予程序员更高的控制权,但容易引发错误。垃圾回收机制可以自动回收不再使用的内存,简化了程序员的工作,但可能会引入额外的性能开销。内存池则是预分配一块内存空间,之后在此范围内快速分配和回收,它在内存使用密集型的应用中表现出高效性。

# 2. 散列数据结构的原理与应用

## 2.1 散列数据结构概述

### 2.1.1 散列的概念及其优势

在计算机科学中,散列是一种将给定的关键字转换为一个固定长度值的过程,这个过程通常被称为散列函数。散列函数的目标是将数据的“关键部分”映射到一个称为“哈希值”的小范围值集合中。散列技术在数据存储和检索中扮演着重要角色,它通过减少搜索时间来提高效率,这使得散列成为构建诸如哈希表这样的数据结构的基础。

散列数据结构的优势主要体现在其高效的数据访问速度。理想情况下,一个良好的散列函数可以保证数据均匀分布,从而将哈希表的查找时间复杂度降低至O(1)。这与数组的索引操作一样快,而且比二叉树查找更快。因此,散列在需要频繁查询、插入和删除操作的场景中表现尤为突出,如数据库索引、缓存系统和键值存储等。

### 2.1.2 散列函数的设计要点

设计一个好的散列函数需要考虑的关键要点包括:

- **计算效率**:函数必须足够快,以便能够快速生成哈希值。

- **键的唯一性**:理想情况下,不同的键应该产生不同的哈希值,尽管这在实际中难以完全实现,但好的散列函数应该尽可能减少冲突。

- **均匀分布**:哈希值应该均匀分布在哈希空间中,避免数据聚集到特定区域,这有助于降低冲突率。

- **动态调整**:在数据动态变化的应用中,一个好的散列函数能够适应数据的增删变化,保证系统的伸缩性。

## 2.2 散列数据结构的关键操作

### 2.2.1 插入操作的内存管理

插入操作是散列数据结构的基本操作之一。当需要将一个新元素添加到散列表中时,首先通过散列函数计算该元素的哈希值,然后根据这个值将元素放置在表中相应的位置。在执行插入操作时,需要注意内存的分配和管理。通常情况下,散列表的大小会预先分配,以避免频繁的内存重分配操作,因为这些操作是耗时的。

### 2.2.2 查找操作的内存效率

查找操作的内存效率是评价散列表性能的关键指标。通过使用哈希函数,散列数据结构能将查找时间减少到接近O(1)的水平。这意味着,无论散列表中有多少数据项,查找特定元素所需的时间几乎是恒定的。这在处理大量数据时尤其重要,因为它能显著提高系统的响应速度。

### 2.2.3 删除操作的内存回收

删除操作通常比插入和查找操作更复杂,特别是当使用开放定址法解决冲突时。在删除一个元素后,需要适当标记该位置,以便其他元素在冲突解决过程中能正确处理。对于链表法,删除操作涉及从链表中移除节点,并释放相应的内存空间。

```c

// 示例代码:散列数据结构中的删除操作

void hash_table_delete(hash_table_t *table, const key_t key) {

int index = hash_function(key) % table->capacity;

list_t *list = table->buckets[index];

// 在链表中查找并删除对应的节点

node_t *prev = NULL, *current = list->head;

while (current != NULL) {

if (compare_keys(current->key, key) == 0) {

if (prev == NULL) {

list->head = current->next;

} else {

prev->next = current->next;

}

free(current);

return;

}

prev = current;

current = current->next;

}

}

```

在上述代码中,`hash_table_delete` 函数首先根据散列函数计算键的索引位置,然后在对应索引位置的链表中查找并删除元素。注意释放内存是必要的,以避免内存泄漏。

## 2.3 散列数据结构的冲突解决方法

### 2.3.1 开放定址法与链表法

开放定址法和链表法是解决散列冲突的两种主要方法。开放定址法是在发现冲突时,利用某种探测技术找到表中的下一个空位置,并将元素插入到那里。这种方法要求散列表预留足够大的空间来容纳所有可能的冲突解决情况。

链表法则是在每个哈希桶中维护一个链表,当发生冲突时,就将元素添加到对应链表的尾部。链表法的优点是它能很好地处理大量冲突,但它在删除操作中可能需要遍历链表,这可能导致时间复杂度增加。

### 2.3.2 冲突率与负载因子分析

冲突率是衡量散列表性能的一个重要指标,它表示在散列表中因哈希值相同而导致的冲突发生的频率。负载因子是另一个重要概念,它等于散列表中元素数量与表总容量的比值。随着负载因子的增加,冲突率也会上升,从而导致性能下降。因此,动态调整散列表的大小是一个重要的内存管理策略,特别是当散列表的负载因子超过某个阈值时。

```c

// 示例代码:调整散列表大小

void resize_hash_table(hash_table_t *table) {

// 计算新的容量

int new_capacity = table->capacity * RESIZE_FACTOR;

hash_table_t new_ta

```

0

0