Python内存管理技巧:减少占用与提升数据处理速度的妙招

发布时间: 2024-09-12 11:39:17 阅读量: 139 订阅数: 55

# 1. Python内存管理基础

Python是一门高级编程语言,以其简洁和高效著称。在使用Python开发程序时,内存管理通常是开发者不需要直接关注的问题,因为Python提供了一个自动垃圾回收机制来处理不再使用的内存。然而,理解Python内存管理的基本原理对于编写高效且资源友好的代码是很有帮助的。本章将简要介绍Python内存管理的基础知识,为之后更深入的内存优化方法打下基础。

## 1.1 内存管理概述

在Python中,内存管理包括了内存的分配和释放,以及对内存使用的监控。Python使用了自动内存管理机制,即引用计数(reference counting)配合循环垃圾收集器(cyclic garbage collector)来处理内存的回收。这大大简化了开发者的负担,降低了内存泄漏的风险。

## 1.2 引用计数机制

引用计数是Python实现内存管理的一种方式。每个对象都包含了一个计数器,用来记录有多少引用指向该对象。当引用计数降到零时,意味着没有任何引用指向该对象,其内存就可以被回收。这种方法简单直观,但也有其局限性,特别是无法处理循环引用导致的内存泄漏。

## 1.3 垃圾回收机制

为了解决引用计数无法处理的循环引用问题,Python还引入了垃圾回收机制。当检测到不可达的循环引用时,垃圾回收器会介入,断开这些循环引用,释放内存。理解垃圾回收的工作原理对于分析和优化程序的内存使用至关重要。

通过本章的介绍,我们对Python的内存管理有了初步的了解。下一章我们将深入探讨内存优化的理论与实践,涵盖内存分配机制、优化技巧以及内存泄漏的诊断与预防。

# 2. 内存优化的理论与实践

## 2.1 Python中的内存分配机制

### 2.1.1 对象内存分配基础

Python是一种高级编程语言,它在内存管理方面提供了极大的便利性。Python的对象内存分配是自动进行的,这是通过Python虚拟机(PVM)和Python内存管理器实现的。当创建一个新的对象时,解释器会计算所需的内存大小,然后分配相应大小的空间。

对象内存分配依赖于`PyObject`这一基础结构,所有的Python对象都继承自此结构。一个`PyObject`包含了几个关键字段,其中包括类型标识符(ob_type)和引用计数(ob_refcnt)。类型标识符用于标识对象的类型,而引用计数用于垃圾回收机制,记录有多少变量指向该对象,当引用计数为零时,对象占用的内存会被释放。

在Python中,创建变量不需要显式声明类型,这为开发者带来了极大的便利,但同时也隐藏了内存分配的细节。例如:

```python

number = 12345 # 整数对象被创建并分配内存

number = "hello" # 字符串对象被创建,并替换原有的整数对象

```

在上述代码中,整数对象和字符串对象分别被分配和释放,而这一切都是由Python的内存管理机制在背后自动处理的。对于更复杂的对象,如列表或字典,Python会为对象及其元素分别分配内存。

### 2.1.2 垃圾回收机制概述

Python的垃圾回收机制主要是引用计数算法,其基本原理是跟踪每个对象的所有引用。一旦一个对象的引用计数降到0,意味着没有任何引用指向这个对象,这个对象就变成了垃圾,Python的内存管理器会回收它占用的内存。这种机制简单且效率较高,适用于大多数情况。

除了引用计数外,Python还提供了循环垃圾回收器(Cyclic GC),用于处理引用计数无法回收的循环引用问题。当某个对象的引用计数长时间不变时,循环垃圾回收器会介入,通过查找循环引用并释放对象。

虽然垃圾回收机制简化了内存管理,但开发者仍然需要了解其工作原理,以避免不必要的性能开销。例如:

```python

import gc

# 启用垃圾回收器的跟踪功能

gc.set_debug(gc.DEBUG_LEAK)

# 创建一个循环引用的例子

a = []

b = [a]

a.append(b)

del a # a的引用计数从1变到0

del b # b的引用计数从1变到0

# 运行垃圾回收

gc.collect()

```

在上述例子中,即使删除了`a`和`b`的引用,由于循环引用的存在,这两个列表并没有被垃圾回收。运行`gc.collect()`后,循环垃圾回收器会检测到循环引用并清理它们。

## 2.2 内存优化技巧

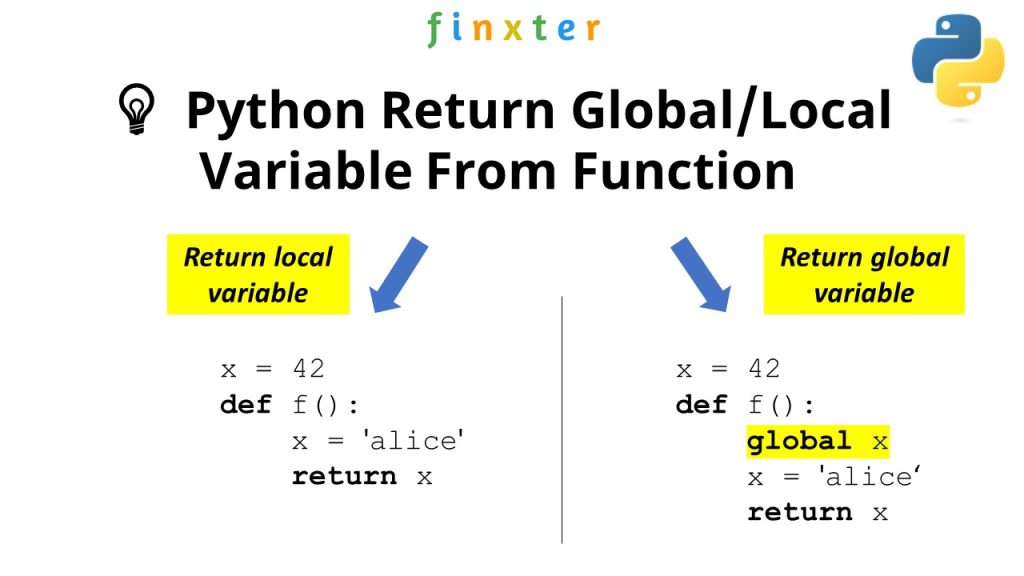

### 2.2.1 变量作用域的影响

在Python中,变量的作用域会影响内存的使用。局部变量通常存储在栈上,而全局变量和类属性则存储在堆上。理解这些差异可以帮助我们更好地优化内存使用。

局部变量在函数执行完毕后,如果不再被引用,它们占用的内存可以被快速释放。而全局变量在模块级别定义,直到程序结束才会被释放,因此过多的全局变量可能会占用不必要的内存。

变量作用域的管理可以通过`global`和`nonlocal`关键字来控制,它们允许在函数内部修改全局变量和外部嵌套函数的变量。

```python

def example():

global global_var

global_var = "I am global"

global_var = None

example()

print(global_var) # 输出: I am global

```

在上述代码中,`global_var`是一个全局变量,通过在函数`example`内部使用`global`关键字,我们改变了全局变量的值。

### 2.2.2 循环中的内存优化策略

循环是程序中常见的结构,但不当的使用可能会导致内存使用迅速增加,尤其是在处理大量数据时。一个常见的优化策略是减少循环内部的变量作用域,避免在每次迭代时创建不必要的对象。

使用生成器表达式代替列表推导式是另一种优化内存使用的方法。生成器表达式在Python中是惰性求值的,它们一次只产生一个元素,不会像列表推导式那样一次性创建整个列表。

```python

# 列表推导式

data_list = [x**2 for x in range(1000000)]

# 生成器表达式

data_generator = (x**2 for x in range(1000000))

```

在上述例子中,列表推导式会立即计算出所有元素并占用相应内存,而生成器表达式仅在迭代时计算并产生每个元素。

### 2.2.3 利用内置函数与数据结构

Python的内置函数和数据结构经过高度优化,使用得当可以大幅提升程序性能和减少内存占用。例如,`map()`和`filter()`函数相比传统的循环结构,可以更加高效地处理数据。

列表推导式也比使用循环添加元素到列表更加高效。此外,使用`set`而非`list`可以避免不必要的重复元素,减少内存使用。

```python

# 使用列表推导式代替循环添加元素

squares = [x**2 for x in range(1000)]

# 使用集合避免重复元素

unique_elements = {x for x in range(1000) if x % 2 == 0}

```

在上述例子中,使用集合而非列表可以快速去除重复的元素,因为集合在Python中是基于哈希表实现的,其查找和插入操作平均时间复杂度为O(1)。

## 2.3 内存泄漏诊断与预防

### 2.3.1 内存泄漏的常见原因

内存泄漏是指程序在申请内存后,未能在不再需要时释放,导致内存的逐渐减少,最终可能导致程序可用内存耗尽。在Python中,内存泄漏可能由以下几个常见原因引起:

1. **循环引用**:尤其是在自定义类实例之间形成的循环引用,这些对象将不会被垃圾回收。

2. **动态库**:使用动态加载的C扩展或库时,未能正确释放资源。

3. **大对象缓存**:不当的缓存机制可能导致大对象一直留在内存中,造成泄漏。

4. **全局变量**:由于全局变量在整个程序运行期间都存在,因此可能会积累无用的数据。

### 2.3.2 使用工具进行内存泄漏检测

Python中存在一些工具可以帮助开发者检测内存泄漏,其中比较著名的包括`memory_profiler`和`objg

0

0