MapReduce日志分析大师:如何利用日志跟踪整个数据处理流程

发布时间: 2024-10-31 03:38:46 阅读量: 2 订阅数: 5

# 1. MapReduce日志分析概述

MapReduce是分布式计算领域的一项核心技术,能够处理和生成大数据集的并行运算。在日志分析方面,MapReduce以其出色的扩展性和容错性成为重要的分析工具。本章将介绍MapReduce在日志分析中的应用,以及它如何帮助IT专业人员从海量的日志数据中提取有价值的信息。

MapReduce的日志分析过程涉及到数据的采集、存储、处理和结果的可视化等关键步骤。首先,系统会收集日志数据并进行初步的格式化,然后利用MapReduce框架将数据分散到多个节点上进行独立处理(Map阶段),随后对结果进行汇总与合并(Reduce阶段)。整个过程通过高效的并行处理,能够显著提升日志分析的处理速度和扩展性。

在实际应用中,MapReduce可以处理来自不同服务和应用的日志文件,无论这些日志是记录用户行为、系统性能还是安全事件等。而本章的重点是为读者提供一个MapReduce日志分析的概览,并在后续章节中深入探讨MapReduce日志分析的具体技术细节和应用场景。

# 2. MapReduce日志分析基础

### 2.1 MapReduce工作原理

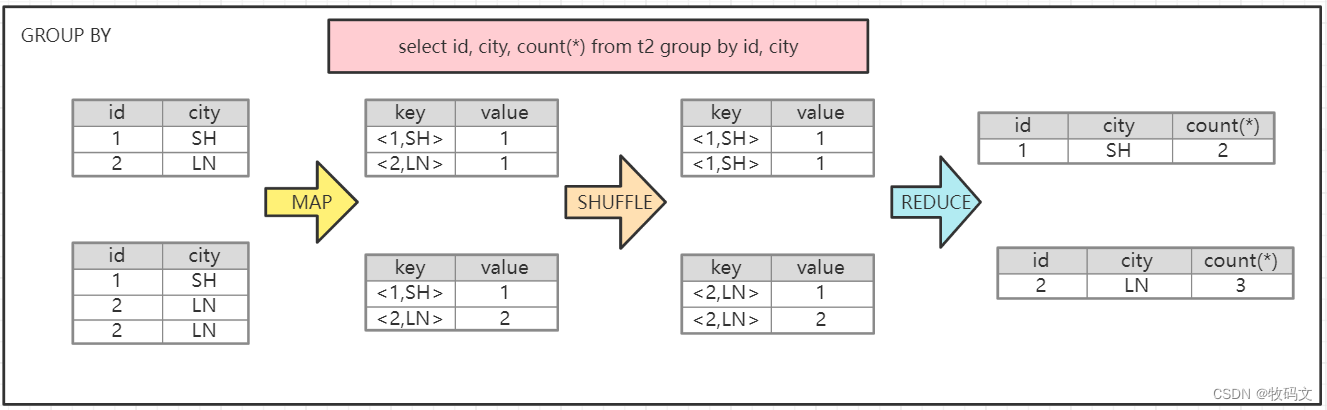

MapReduce是一种编程模型,用于处理和生成大数据集。用户可以通过编写Map()和Reduce()函数来实现自己的业务逻辑。在MapReduce中,数据通常分为两个阶段进行处理:Map阶段和Reduce阶段。

#### 2.1.1 Map阶段的数据处理

在Map阶段,输入的数据被分割成固定大小的块,这些块由不同的Map任务并行处理。Map任务读取输入数据,并将其转换成一系列的键值对(key-value pairs)。这一步骤中,数据经过滤、转换和映射操作,最终形成了中间的键值对数据集。

一个典型的Map函数的代码示例如下:

```java

map(String key, String value):

// key: document name

// value: document contents

for each word w in value:

EmitIntermediate(w, "1");

```

这段代码展示了一个简单的Map操作,它将文档中的每个单词作为key,并将值设置为字符串"1"。Map函数的主要任务是将输入数据转换成适合于后续处理的形式。

#### 2.1.2 Reduce阶段的数据聚合

Reduce阶段则在Map阶段的基础上,对相同key的所有键值对进行合并。在执行Reduce任务之前,系统会先对Map任务输出的键值对进行排序和分组,然后将相同key的键值对传递给同一个Reduce任务。

一个典型的Reduce函数的代码示例如下:

```java

reduce(String key, Iterator values):

// key: a word

// values: a list of counts

int result = 0;

for each v in values:

result += ParseInt(v);

Emit(key, IntToString(result));

```

这段代码表示一个简单的Reduce操作,它将所有相同的key的值进行累加,得到最终的结果。

### 2.2 日志数据的收集与存储

在进行日志分析前,需要一个有效的机制来收集和存储日志数据。这些数据可能是服务器、应用或网络设备所产生的。

#### 2.2.1 日志数据的分类和格式

为了便于处理和分析,日志数据通常需要按照一定的分类标准进行组织,并采取合适的格式来存储。常见的日志数据分类有操作日志、系统日志、安全日志等。而格式方面,通常使用文本格式,例如CSV、JSON或XML。

#### 2.2.2 日志数据的存储解决方案

存储日志数据时,需要考虑到数据量可能非常庞大。Hadoop的HDFS因其高可靠性和高容错性成为了一个受欢迎的选择。此外,对于结构化数据,还可以使用如Hive这样的数据仓库来存储和分析。

### 2.3 日志分析的工具和方法

在MapReduce框架下,Hadoop生态中提供了多种工具来辅助进行日志分析。

#### 2.3.1 利用Hadoop生态中的工具进行日志分析

Hadoop生态系统提供了多种工具,如Hive、Pig、HBase等,它们通过与MapReduce结合,可以更高效地进行日志数据的查询和分析。例如,可以使用Hive来简化MapReduce作业的编写过程,它允许用户使用类SQL语言来操作数据。

#### 2.3.2 日志分析的常见问题和挑战

在进行日志分析时,可能面临数据格式不一致、数据量过大和处理速度慢等挑战。因此,需要采用合适的数据处理和分析技术,并对MapReduce程序进行性能优化。

## 第三章:MapReduce日志分析的实践应用

### 3.1 日志数据的预处理技术

日志分析的第一步是预处理,这包括数据清洗和转换。

#### 3.1.1 数据清洗

数据清洗是去除日志中的噪声数据,确保分析结果的准确性。常见的清洗操作包括过滤掉无效记录、移除重复数据和纠正错误。

#### 3.1.2 数据转换

数据转换是指将原始日志数据转换成适合分析的格式。例如,可以将日志中的时间戳转换为统一的时间格式,或者将不同来源的日志数据进行格式统一。

### 3.2 日志数据的MapReduce分析实践

在MapReduce框架下,实际的日志分析操作会涉及到编写MapReduce程序,并进行性能优化和调试。

#### 3.2.1 编写MapReduce程序分析日志

编写MapReduce程序分析日志数据需要了解如何编写Map()和Reduce()函数,以及如何配置输入和输出格式。程序通常包括以下部分:

```java

// Map Function

map(String key, String value):

// key: document name

// value: document contents

for each word w in value:

EmitIntermediate(w, "1");

// Reduce Function

reduce(String key, Iterator values):

// key: a word

// values: a list of counts

int result = 0;

for each v in values:

result += ParseInt(v);

Emit(key, IntToString(result));

```

#### 3.2.2 性能优化和调试技巧

性能优化的目标是提高MapReduce作业的执行效率。优化手段可能包括数据本地化优化、Map和Reduce任务数量的合理配置、Combiner函数的使用等。

### 3.3 可视化日志分析结果

分析结果的展示对于理解数据非常关键。

#### 3.3.1 日志分析结果的展示方法

结果展示可以通过表格、图表等形式,帮助用户快速理解分析结果。

#### 3.3.2 结果的可视化工具和实践案例

有许多工具可以帮助实现日志分析结果的可视化,如Tableau、Grafana等。在实际案例中,可视化工具能够将复杂的日志数据转化为直观的图形和报表。

通过结合本章的内容,读者应能掌握MapReduce进行日志分析的基础知识和实践操作。接下来的章节将深入探讨MapReduce日志分析的高级技巧。

# 3. MapReduce日志分析的实践应用

## 3.1 日志数据的预处理技术

### 3.1.1 数据清洗

在进行日志分析之前,数据清洗是一个至关重要的步骤。数据清洗的目标是提高数据的质量,确保分析的准确性。在日志分析的背景下,数据清洗通常涉及以下几个方面:

- 删除重复记录:在日志记录过程中可能会产生重复的日志条目,这些记录需要被识别并删除。

- 修正错误:日志文件可能会因为格式错误、损坏的数据或

0

0